Clear Sky Science · de

Ein neuartiger Ansatz auf Basis von Reinforcement Learning zur kurzfristigen Last‑ und Preisprognose in Energiemärkten

Warum die Vorhersage des morgigen Strombedarfs wichtig ist

Jedes Mal, wenn Sie einen Lichtschalter betätigen, arbeitet im Hintergrund ein weites Netz aus Kraftwerken, Märkten und Rechnern, um Strom verfügbar und bezahlbar zu halten. Können Netzbetreiber genau vorhersagen, wie viel Strom in den nächsten Stunden benötigt wird und wie sich die Preise entwickeln, lassen sich Blackouts vermeiden, Verschwendung reduzieren und Kosten für alle senken. Dieser Artikel untersucht eine neue Methode, um diese kurzfristigen Prognosen zu erstellen, basierend auf Techniken, die ursprünglich zum Erlernen von Spielen und zur Steuerung von Robotern entwickelt wurden.

Klügere Prognosen für eine sich wandelnde Energiewelt

Stromnachfrage und Preise können Stunde für Stunde stark schwanken. Hitzewellen, Kälteeinbrüche, Feiertage und Brennstoffkosten treiben das System in unterschiedliche Richtungen. Traditionelle Prognosewerkzeuge, etwa einfache Trendlinien oder auch Standard‑Machine‑Learning‑Modelle, behandeln das Problem oft als einmalige Anpassung an vergangene Daten. Sie tun sich schwer, wenn sich die Bedingungen schnell ändern oder viele Faktoren auf komplexe Weise zusammenwirken. Die Autoren argumentieren, dass moderne Stromnetze, insbesondere mit wachsendem Anteil erneuerbarer Energien, Prognosetools benötigen, die sich unterwegs anpassen und direkt aus ihren Erfolgen und Fehlern lernen können.

Ein lernender Agent am Energiemarkt

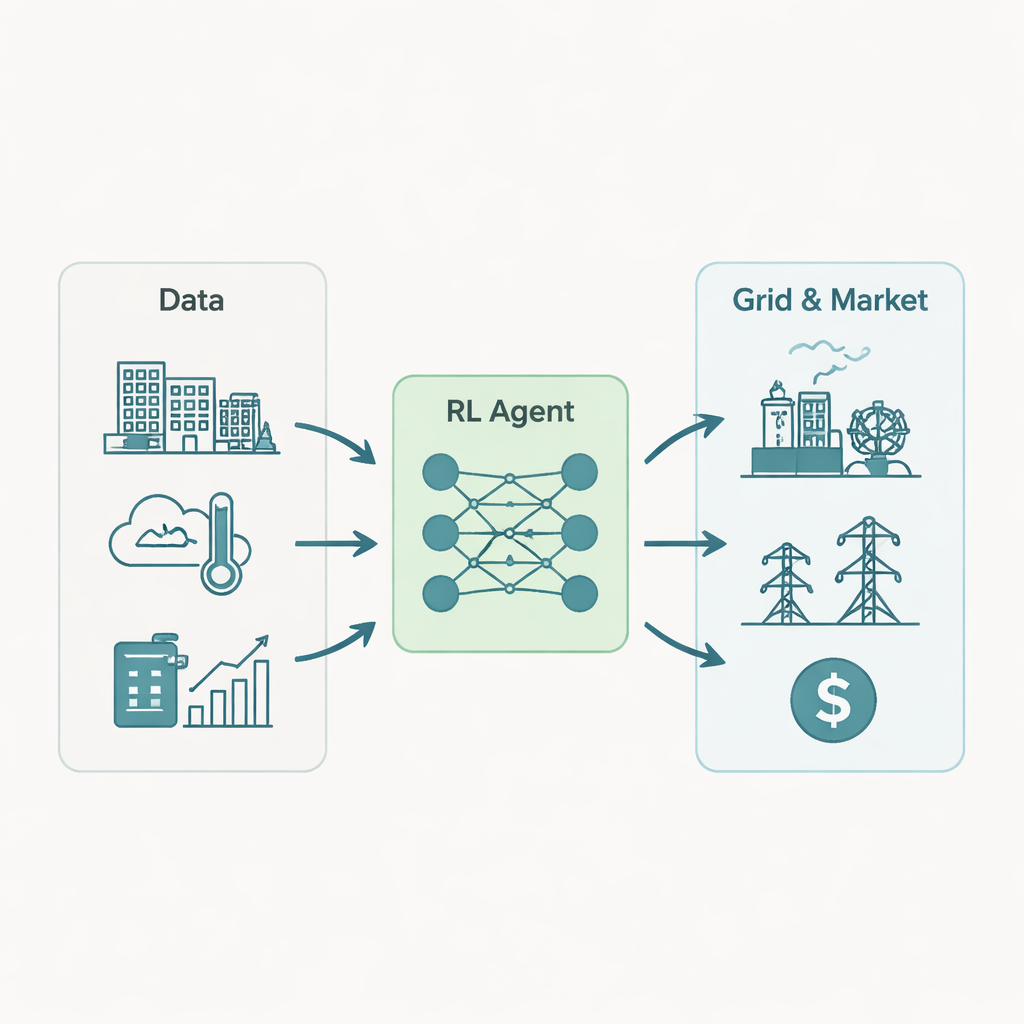

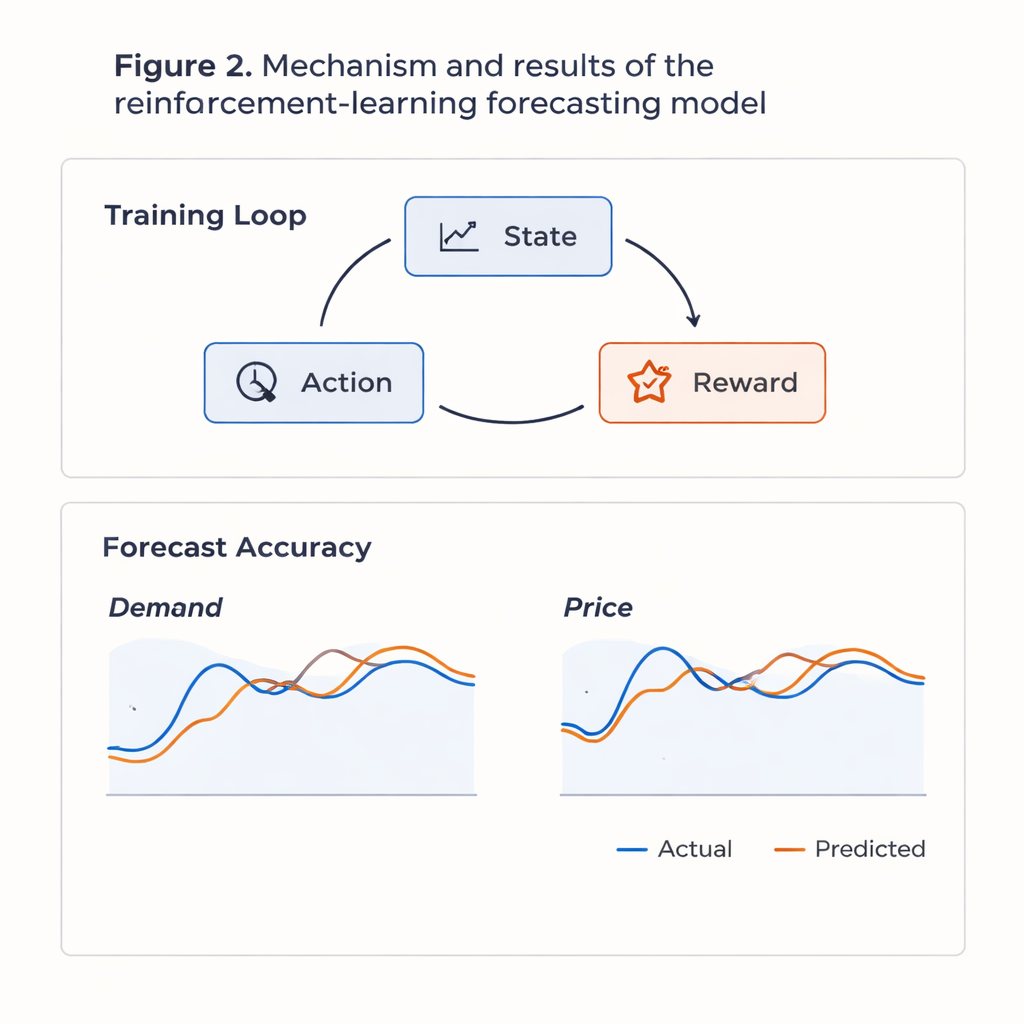

Die Forscher formulieren die Vorhersage als Entscheidungsfindungsspiel. In jeder Stunde sieht ein Computer‑„Agent“ die aktuelle Lage: jüngste Stromnachfrage, vergangene Preise, Temperatur, Luftfeuchte, Wochentag, Feiertage und Brennstoffkosten. Er wählt dann eine Aktion: seine beste Schätzung für die Stromnachfrage und den Preis in der nächsten Stunde. Sobald die tatsächlichen Werte bekannt sind, erhält der Agent eine Bewertung, die davon abhängt, wie weit seine Schätzung danebenlag – große Fehler werden bestraft, kleine Fehler belohnt. Im Laufe der Zeit sucht das System nach einer Strategie, die seinen langfristigen Punktestand maximiert, nicht nur die Genauigkeit eines einzelnen Schritts. Um die vielen Eingangsgrößen zu handhaben, verwenden die Autoren ein Deep‑Reinforcement‑Learning‑Setup auf Basis eines Deep Q‑Networks, einer Art neuronalen Netzes, das abschätzt, wie gut jede mögliche Aktion in einer Situation ist.

Von Rohdaten zu verlässlichen Prognosen

Zur Prüfung ihres Ansatzes nutzte das Team echte Daten der PJM Interconnection, eines großen US‑Strommarkts, der Teile des Mittleren Westens und der Ostküste abdeckt. Sie verwendeten etwa drei Jahre stündlicher Aufzeichnungen (2021–2023), darunter Markpreise, Stromnachfrage, Wetterbeobachtungen und Brennstoffpreisindizes. Vor dem Training bereinigten sie die Daten, füllten seltene fehlende Werte auf, entfernten ungewöhnliche Ausreißer und skalieren alles in vergleichbare Bereiche. Außerdem setzten sie statistische Techniken ein, um die große Menge an Eingangsmerkmalen zu komprimieren, während die meiste nützliche Variation erhalten blieb. Der Lernagent wurde dann in wiederholten Durchläufen über diese Historie trainiert und ging dabei schrittweise von zufälligem Ausprobieren zur Nutzung entdeckter Muster über.

Wie gut der Lernagent abgeschnitten hat

Im Vergleich mit weit verbreiteten Prognoseverfahren – darunter ARIMA (ein traditionelles Zeitreihenmodell), LSTM‑Neuronale Netze und der populäre XGBoost‑Algorithmus – schnitt das Reinforcement‑Learning‑System besser ab. Auf zurückgehaltenen Testdaten, die das Modell zuvor nie gesehen hatte, reduzierte es die durchschnittlichen prozentualen Fehler bei Nachfrage und Preis um rund 15–20 Prozent gegenüber diesen Baselines. Die Vorhersagen erfassten sowohl winterliche als auch sommerliche Tageszyklen genau und folgten allgemeinen Preisschwankungen, obwohl das Modell weiterhin Schwierigkeiten mit den schärfsten, seltenen Preisspitzen und ungewöhnlichem Feiertagsverhalten hatte. Die Analyse der gelernten Strategie zeigte, dass der Agent implizit ein ökonomisch sinnvolles Muster entdeckte: Nach sehr hohen Preisen erwartete er tendenziell eine etwas geringere Nachfrage in der nächsten Stunde, was einer realen Nachfrageantwort ähnelt, ohne dass ihm dies explizit vorgegeben wurde.

Was das für den täglichen Energieverbrauch bedeutet

Für Nicht‑Spezialisten ist die Kernbotschaft, dass dieser lernbasierte Ansatz Netzbetreibern helfen kann, Stromsysteme reibungsloser und kostengünstiger zu betreiben. Genauere kurzfristige Prognosen ermöglichen es Erzeugern und Marktbetreibern, Kraftwerke effizienter zu planen, erneuerbare Quellen mit weniger Überraschungen zu integrieren und das Risiko plötzlicher Preisspitzen oder Engpässe zu senken. Während die Methode datenhungrig und rechenintensiv ist und weiter verfeinert werden muss, um extreme Ereignisse abzudecken, weist sie in eine Zukunft, in der Strommärkte von adaptiven, sich selbst verbessernden Werkzeugen geleitet werden, die kontinuierlich aus dem sich ständig ändernden Verhalten von Verbrauchern, Wetter und Brennstoffkosten lernen.

Zitation: Wu, Y., Ma, Y. & Aliev, H. A novel reinforcement learning-based approach for short-term load and price forecasting in energy markets. Sci Rep 16, 5141 (2026). https://doi.org/10.1038/s41598-026-37366-5

Schlüsselwörter: Prognosen für intelligente Stromnetze, Vorhersage von Strompreisen, Reinforcement Learning, Lastprognose im Energiesektor, Deep Q‑Network