Clear Sky Science · de

RiemannInfer: Verbesserung der Transformer‑Inference durch riemannsche Geometrie

Warum das für Alltags‑KI‑Nutzer wichtig ist

Moderne Chatbots und KI‑Assistenten können Mathematikaufgaben lösen, Aufsätze schreiben und sogar medizinische Themen erklären, doch wir wissen immer noch nicht genau, wie sie zu ihren Schlussfolgerungen gelangen — oder wie man ihr Schlussfolgern zuverlässiger macht. Dieses Paper stellt „RiemannInfer“ vor, eine neue Sichtweise auf große Sprachmodelle (LLMs), bei der ihre interne Aktivität als Bewegung auf einer gekrümmten geometrischen Fläche behandelt wird. Diese Perspektive liefert nicht nur ein anschaulicheres Bild davon, wie diese Systeme „denken“, sondern macht ihr Schlussfolgern auch schneller und genauer.

KI‑Denken als geometrische Reise

Innerhalb eines LLM wie GPT‑4 oder Llama wird jedes Wort in einem Satz durch einen hochdimensionalen Vektor dargestellt, und Schichten von „Attention“ entscheiden, wie stark Wörter einander beeinflussen. Die Autoren beobachten, dass sich diese versteckten Zustände als Punkte in einem gewaltigen Raum betrachten lassen, dessen Gesamtform das Sprachverständnis des Modells kodiert. Statt Schlussfolgern als Reihe von Wahrscheinlichkeitsberechnungen über Text zu sehen, interpretieren sie es als Problem der Pfadsuche: Das Modell bewegt sich von einem Anfangszustand (der Frage) zu einem Endzustand (der Antwort) entlang einer Route in diesem Raum. Mit Werkzeugen der riemannschen Geometrie — der Mathematik gekrümmter Flächen — konstruieren sie eine gekrümmte Mannigfaltigkeit, die einfängt, wie Aufmerksamkeitsmuster diese innere Landschaft biegen und dehnen.

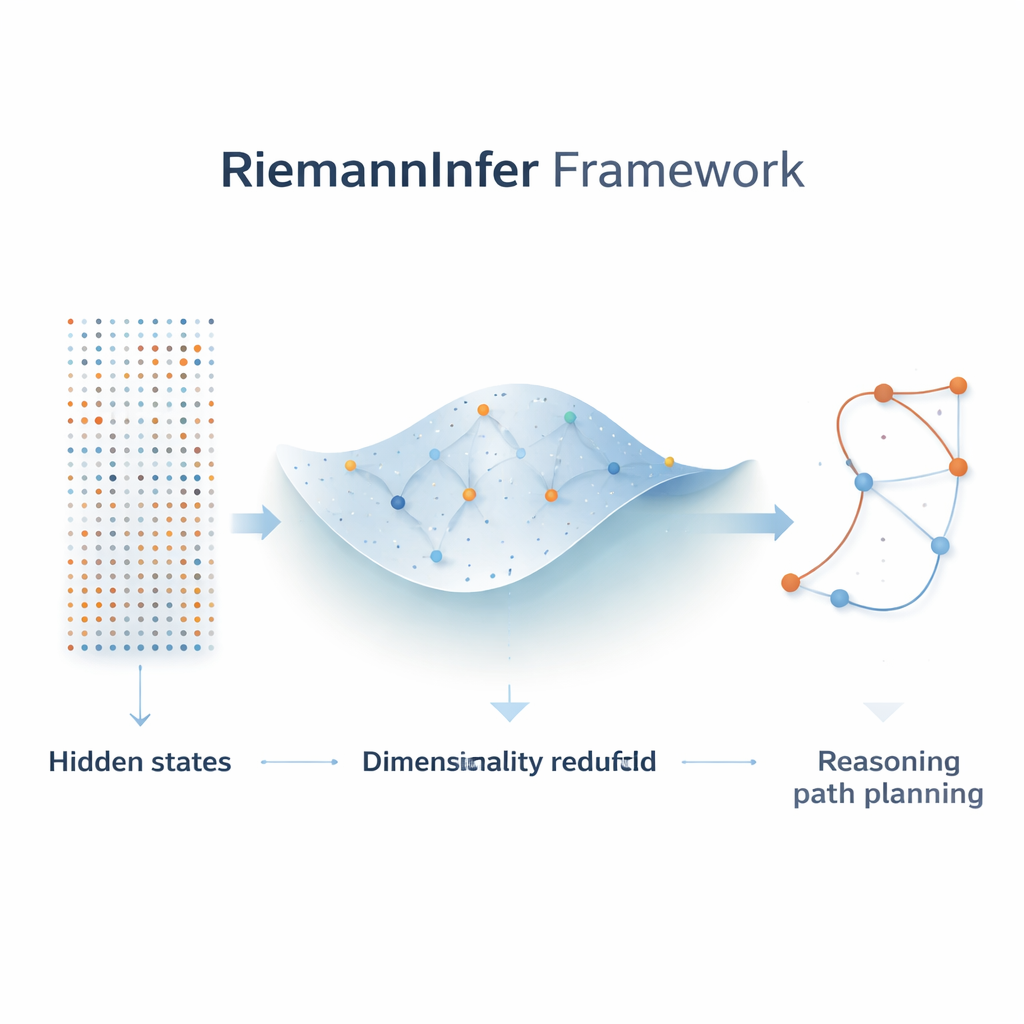

Komplexität komprimieren, ohne das Wesentliche zu verlieren

Da der rohe Innenraum eines LLM enorm groß ist, besteht der erste Schritt in RiemannInfer darin, ihn zu schrumpfen und trotzdem seine essentielle Struktur zu bewahren. Die Autoren kombinieren Techniken aus der Topologie, die untersucht, wie Punkte verbunden sind, mit einem populären Dimensionalitätsreduktionsverfahren namens UMAP. Vor der Reduktion der Dimensionen analysieren sie die „Form“ der Wolke von versteckten Zuständen, um sicherzustellen, dass wichtige Konnektivitätsmuster die Kompression überstehen. Das Ergebnis ist ein nieder‑dimensionalerer Raum, in dem wichtige Beziehungen zwischen Token — etwa welche Wörter stark aufeinander achten — weitgehend erhalten bleiben. Diese kompakte geometrische Karte macht präzise Berechnungen zu Abständen, kürzesten Wegen und Krümmung praktikabel.

Eine gekrümmte Karte aus Attention bauen

Die Kerninnovation besteht darin, Aufmerksamkeitsgewichte in ein geometrisches Distanzmaß zu übersetzen. Wenn das Modell starke Attention zwischen zwei Token zeigt, behandelt RiemannInfer sie als nahe beieinander auf der Mannigfaltigkeit; schwache Attention platziert sie weiter auseinander. Aus diesen Beziehungen definieren die Autoren ein Metrik‑Tensor — eine mathematische Regel, die Längen und Winkel bestimmt — und nutzen ihn, um Geodäten zu berechnen, die gekrümmten Entsprechungen gerader Linien, sowie die Krümmung, die misst, wie stark der Raum sich biegt. Multi‑Head‑Attention wird dabei natürlich zu einer Mischung mehrerer Metriken, von denen jede einen anderen Aspekt linguistischer Struktur einfängt, etwa Grammatik oder Bedeutung. Mit dieser Konstruktion lassen sich Modellentscheidungen als Wahl bestimmter Pfade durch eine Landschaft interpretieren, deren Gipfel und Täler widerspiegeln, wo Informationen dicht oder dünn verteilt sind.

Wegplanung für energiearmes Schlussfolgern

Sobald die Mannigfaltigkeit aufgebaut ist, formulieren die Autoren Schlussfolgern neu als die Suche nach einem „einfachen“ Weg von Frage zur Antwort — einem Pfad, der die insgesamt verrichtete Arbeit minimiert. Sie bedienen sich einer Analogie aus dem Bergsteigen: Eine steile, zerklüftete Route erfordert mehr Energie als das Folgen eines glatteren Grats zum gleichen Gipfel. Im LLM‑Kontext spielt die Krümmung die Rolle der Steilheit, und die Arbeitsmenge des Modells entspricht der Reduktion seiner internen Unsicherheit entlang eines Pfades. Mithilfe approximativer Formeln für Geodäten und Krümmung, kombiniert mit einem effizienten Graphsuchalgorithmus (Dijkstras Algorithmus), identifiziert RiemannInfer schnell Routen, die diese Arbeit minimieren, und leitet das Modell so effektiv zu effizienteren Gedankenketten.

Was die Experimente an realen Modellen zeigen

Die Autoren testen RiemannInfer an mehreren State‑of‑the‑Art‑LLMs, darunter GPT‑4o, Llama‑3‑405B und DeepSeek‑V2‑400B, auf anspruchsvollen Mathe‑ und Reasoning‑Benchmarks wie GSM8K, MATH500, StrategyQA und AGIEval. In allen Fällen steigert das Einbetten dieser Modelle in das RiemannInfer‑Framework deren Genauigkeit um einige Prozentpunkte — kleine Zahlen, die an der Leistungsgrenze dennoch bedeutsam sind — und erhält dabei die Geschwindigkeit oder verbessert sie leicht. Ein Vergleich mit einer einfacheren, rein linearen Methode zeigt, dass das Ignorieren der gekrümmten Geometrie der versteckten Zustände die Leistung drastisch verschlechtert, was die Bedeutung der Mannigfaltigkeits‑Sicht unterstreicht.

Gesamtbild: dem KI‑Schlussfolgern eine physische Anschauung geben

Für eine nichtfachliche Leserschaft lautet die zentrale Erkenntnis, dass die Autoren die undurchsichtigen inneren Abläufe großer Sprachmodelle in etwas Greifbareres verwandelt haben: eine Reise über eine gekrümmte Landschaft, in der gutes Schlussfolgern dem Folgen glatter, energiearmer Pfade entspricht. Indem Attention‑Muster und Schlussfolgerungsschritte in geometrische und physikalische Konzepte wie Distanz, Krümmung und Arbeit überführt werden, bietet RiemannInfer sowohl einen praktischen Weg zur Leistungsverbesserung als auch eine konzeptionelle Brücke zwischen KI und der Physik kontinuierlicher Räume. Zwar sind die aktuellen Methoden approximativ und viele Details müssen noch verfeinert werden, doch das Framework weist in Richtung zukünftiger KI‑Systeme, deren Denkprozesse analysiert, optimiert und vielleicht sogar mit der Sprache der Geometrie und Physik entworfen werden können.

Zitation: Mao, R., Zhang, Z., Yang, M. et al. RiemannInfer: improving transformer inference through Riemannian geometry. Sci Rep 16, 6636 (2026). https://doi.org/10.1038/s41598-026-37328-x

Schlüsselwörter: große Sprachmodelle, geometrisches Deep Learning, riemannsche Mannigfaltigkeit, Aufmerksamkeitsmechanismen, Effizienz des Denkens