Clear Sky Science · de

Anwendung hierarchischen selbstüberwachten kontrastiven Lernens zur Domänenanpassung beim Abgleichen multimodaler Fernerkundungsbilder

Die Erde mit anderen Augen sehen

Wettersatelliten, Radarmissionen und hochauflösende Kameras im All betrachten denselben Planeten auf sehr unterschiedliche Weise. Diese Vielfalt ist eine Stärke für Aufgaben wie das Verfolgen von Überschwemmungen, die Kartierung von Städten oder die Überwachung von Wäldern — vorausgesetzt, wir können die Bilder verlässlich aufeinander abstimmen. Die hier zusammengefasste Studie stellt eine neue Methode der künstlichen Intelligenz vor, die Computern beibringt, diese sehr verschiedenen Ansichten der Erde genauer und mit deutlich weniger menschlicher Beschriftung zu paaren, und schafft damit die Grundlage für schnellere und robustere Umweltüberwachung.

Warum das Abgleichen unterschiedlicher Bilder so schwer ist

Fernerkundungsbilder stammen von vielen Sensortypen: optische Kameras, die ähnlich wie das menschliche Auge sehen, Radarsysteme, die die Oberflächenrauheit messen, und multispektrale Instrumente, die feine Farbunterschiede erfassen. Da jeder Sensor auf seine Weise „sieht“, kann dasselbe Gebäude, Schiff oder Feld in unterschiedlichen Bildern völlig anders aussehen — körnig im Radar, scharf im Optischen oder ungewöhnlich eingefärbt in multispektralen Ansichten. Herkömmliche Abgleichverfahren stützen sich entweder auf handgefertigte visuelle Merkmale oder auf vollständig überwachte Deep‑Learning‑Modelle, die große Mengen sorgfältig gelabelter Daten benötigen. Beide Ansätze versagen häufig, wenn die Erscheinungsunterschiede zwischen Sensoren groß sind oder wenn gelabelte Beispiele rar sind, wie es oft bei Katastrophen oder in abgelegenen Regionen der Fall ist.

Ein gestaffelter Ansatz, Computern das Vergleichen beizubringen

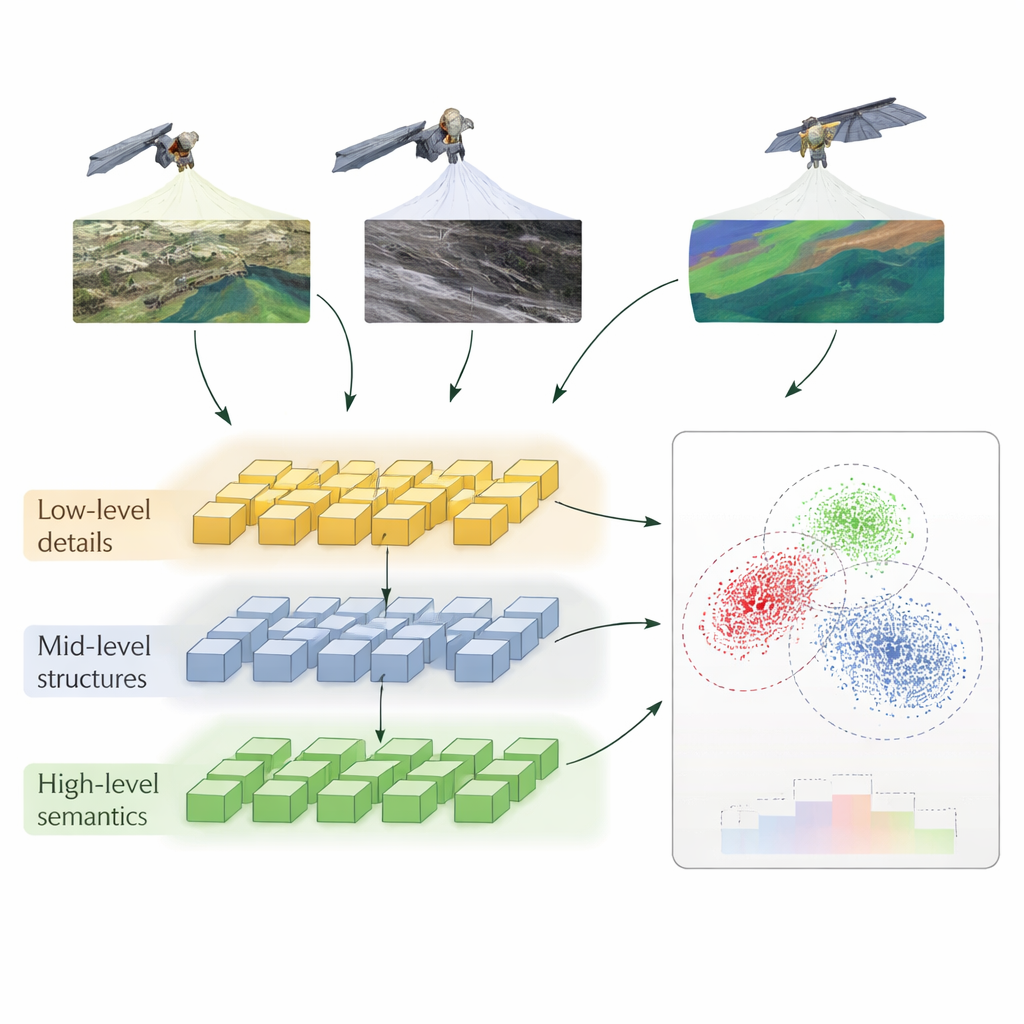

Die Autoren schlagen eine Methode namens Hierarchical Self‑Supervised Contrastive Learning (HSSCL) vor, die verändert, wie ein neuronales Netz lernt, Bilder zu vergleichen. Anstatt nur eine einzige Zusammenfassung jedes Bildes zu betrachten, extrahiert das Netzwerk Informationen auf drei Ebenen: feine Details wie Kanten und Texturen, mittlere Muster wie Straßen und Gebäudekonturen sowie breit angelegte Strukturen wie Stadtgrundrisse oder Landbedeckungstypen. Auf jeder Ebene fördert das System, dass Merkmale aus verschiedenen Sensoren, die dasselbe Gebiet zeigen, einander ähnlicher werden, während Merkmale aus nicht zusammenhängenden Bereichen weiter auseinander gedrängt werden. Dieses „kontrastive“ Training erfolgt ohne menschliche Labels: Das Modell nutzt die bekannte Paarung von Bildern verschiedener Sensoren desselben Ortes sowie automatisch gefundene ähnliche Beispiele, um ein reiches Verständnis davon zu entwickeln, wie „derselbe Ort“ über Modalitäten hinweg aussieht.

Rauschen bereinigen und Geometrie bewahren

Reale Fernerkundungsdaten sind unordentlich — Radaraufnahmen enthalten Speckle‑Rauschen, optische Bilder können diesig sein, und alle können um einige Pixel verschoben sein. HSSCL begegnet dem, indem es Bilder zunächst in kleine Blöcke unterteilt und gezielte Rauschunterdrückung anwendet, was dem Netzwerk hilft, sich auf sinnvolle Strukturen statt auf zufällige Schwankungen zu konzentrieren. Anschließend speist es Merkmale aus verschiedenen Blöcken in ein graphbasiertes Modul ein, das jede Region als Knoten behandelt und Regionen verbindet, die nahe beieinander liegen und ähnlich aussehen. Durch das Arbeiten auf diesem Graphen stärkt ein spezialisiertes Graph‑Neural‑Network die geometrische Konsistenz der Zuordnungen, wodurch Straßen eher mit Straßen und Gebäude mit Gebäuden übereinstimmen — auch unter schwierigen Bedingungen.

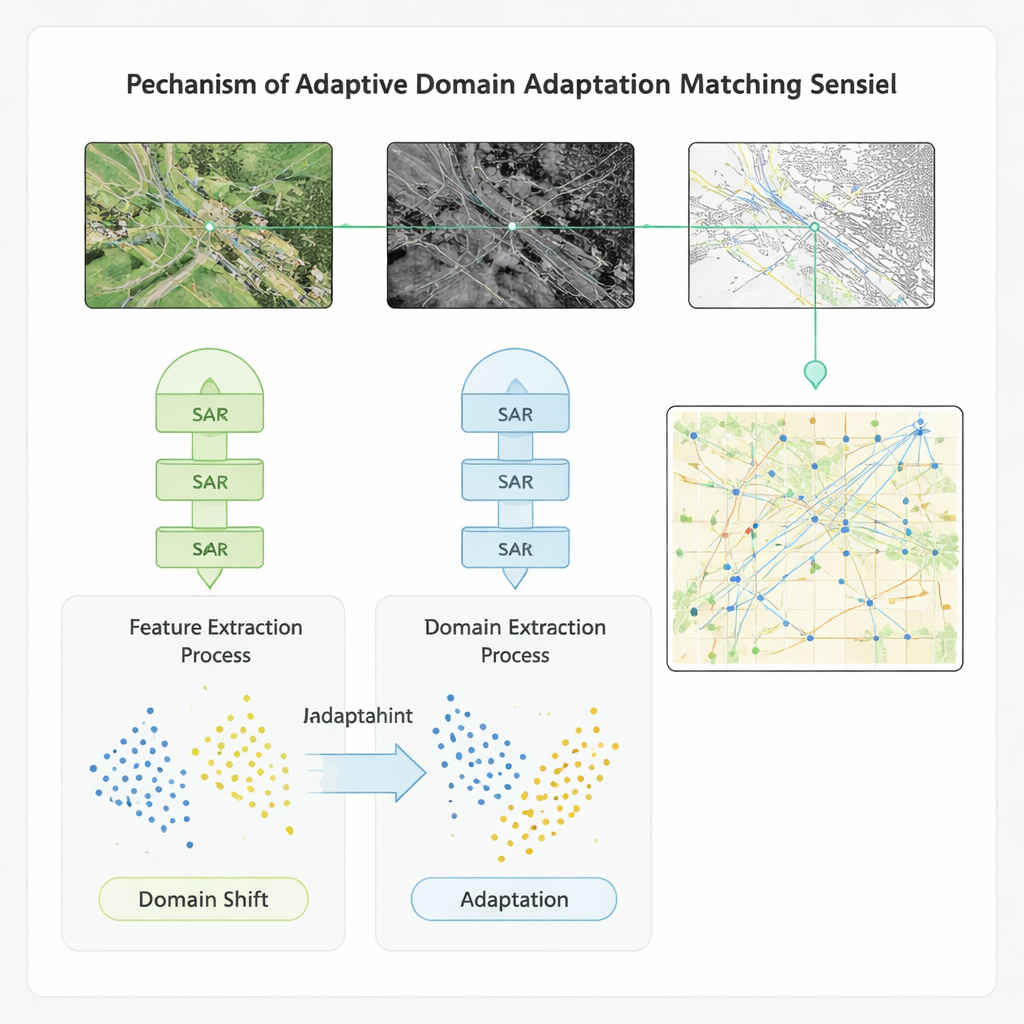

Anpassung über Datensätze und Bedingungen hinweg

Um sicherzustellen, dass die Methode über einen einzelnen Benchmark hinaus funktioniert, betten die Autoren ihr Lernschema in ein Domänenanpassungsmodell ein. Diese Komponente verringert explizit die Lücke zwischen den statistischen Eigenschaften von Merkmalen aus verschiedenen Sensoren und Datensätzen, sodass ein Modell, das in einer Region oder für ein Instrument trainiert wurde, mit minimalem Genauigkeitsverlust in einer anderen Region angewendet werden kann. Getestet an vier öffentlichen Datensätzen, die globale multispektrale Bilddaten, hochauflösende Radar‑Optik‑Paare, Landbedeckungsszenen und Schiffsaufnahmen umfassen, übertrifft der neue Ansatz mehrere fortgeschrittene Baselines. Er verbessert Genauigkeit, Recall und F1‑Score um etwa 20 Prozentpunkte, beschleunigt das Matching um mehr als 20 % und steigert die Video‑artige Defekterkennungsgenauigkeit — wichtig für die Überwachung zeitlicher Veränderungen — um über 40 %. Die Methode zeigt zudem eine stärkere Widerstandsfähigkeit gegenüber Rauschen und Verschiebungen zwischen Trainings‑ und Einsatzbedingungen.

Was das für die praktische Überwachung bedeutet

Für Laien verdeutlicht die Studie, wie Computer darin trainiert werden können, „dieser Ort ist derselbe“ über Bilder hinweg zu erkennen, die für menschliche Augen völlig unterschiedlich aussehen. Indem sie auf mehreren Detailebenen lernt, Rauschen entfernt und sich explizit an neue Sensoren und Regionen anpasst, erleichtert die HSSCL‑Methode die Zusammenführung vieler Satellitendatenströme zu einem kohärenten Gesamtbild. Das kann Einsatzkräften helfen, Radar‑ und Optikbilder nach einem Sturm schneller auszurichten, Planer beim Verfolgen von Stadt‑ oder Waldbestandveränderungen über Jahre unterstützen und die kontinuierliche Schiffsüberwachung auf See verbessern. Obwohl die Autoren darauf hinweisen, dass extremes Rauschen und sehr große Verzerrungen weiterhin Herausforderungen bleiben, bietet ihre Arbeit einen vielversprechenden und praktischen Weg zu schnellerem, verlässlicherem Abgleichen der vielen Augen, die wir im Orbit haben.

Zitation: Li, Y., Luo, Z., Zhu, G. et al. Application of hierarchical self-supervised contrastive learning in domain adaptation matching of multimodal remote sensing image. Sci Rep 16, 6445 (2026). https://doi.org/10.1038/s41598-026-37312-5

Schlüsselwörter: Fernerkundung, multimodale Bildgebung, selbstüberwachtes Lernen, kontrastives Lernen, Domänenanpassung