Clear Sky Science · de

Wenn LLMs ZigBee sprechen: Erforschung von latenzarmen und denkenden Modellen zur Generierung von Netzwerkverkehr

Smart Homes brauchen glaubwürdige Probeläufe

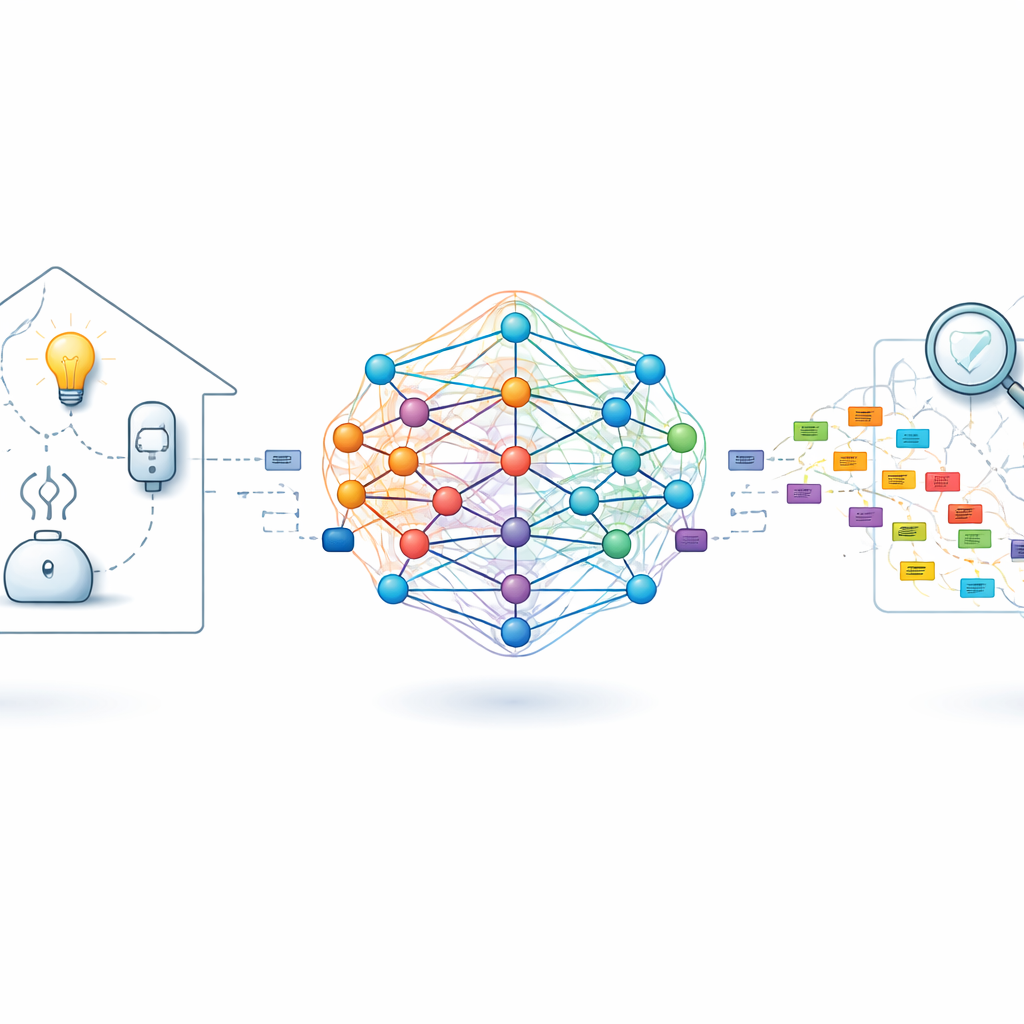

Während unsere Wohnungen sich mit smarten Lampen, Steckern und Sensoren füllen, wird das unsichtbare Geschehen zwischen diesen Geräten sowohl zur Bequemlichkeit als auch zu einer potenziellen Schwachstelle. Ingenieure, die diese Systeme entwickeln und absichern, benötigen sichere Möglichkeiten, um „Probeabläufe“ zu simulieren, wie Netzwerke unter realen Bedingungen reagieren—einschließlich seltener Störungen und Cyberangriffe. Diese Arbeit untersucht, ob moderne KI‑Sprachmodelle—die gleichen, die in Chatbots verwendet werden—umfunktioniert werden können, um realistischen Smart‑Home‑Netzwerkverkehr zu erzeugen. Das würde Forschern ein mächtiges Testfeld bieten, ohne dass man jedes mögliche Szenario aus echten Haushalten aufzeichnen muss.

Von menschlicher Sprache zu Gerätedialogen

Die Studie konzentriert sich auf ZigBee, einen verbreiteten Funkstandard, der in smarten Lampen, Steckdosen und Bewegungsmeldern eingesetzt wird. Anstatt gewöhnlichen Text zu erzeugen, füttern die Autorinnen und Autoren Stichproben von ZigBee‑Paketen—zeitgestempelte Aufzeichnungen, wer mit wem kommuniziert hat und welche Protokollfelder benutzt wurden—an große Sprachmodelle (LLMs) von OpenAI, konkret GPT‑4.1 und GPT‑5. Diese Modelle behandeln jedes Paket als eine strukturierte „Satz“-Einheit und lernen Muster darin, wie Geräte und die zentrale Zentrale über die Zeit miteinander kommunizieren. Ziel ist nicht nur, grundlegende Statistiken wie durchschnittliche Paketgröße nachzuahmen, sondern neuen Verkehr zu erzeugen, der ZigBees strengen Regeln folgt, gültige Geräteadressen verwendet und realistische Zeitabläufe sowie Anforderungs–Antwort‑Muster bewahrt.

Zwei Experimente: Einweg‑Sendung und vollständiger Dialog

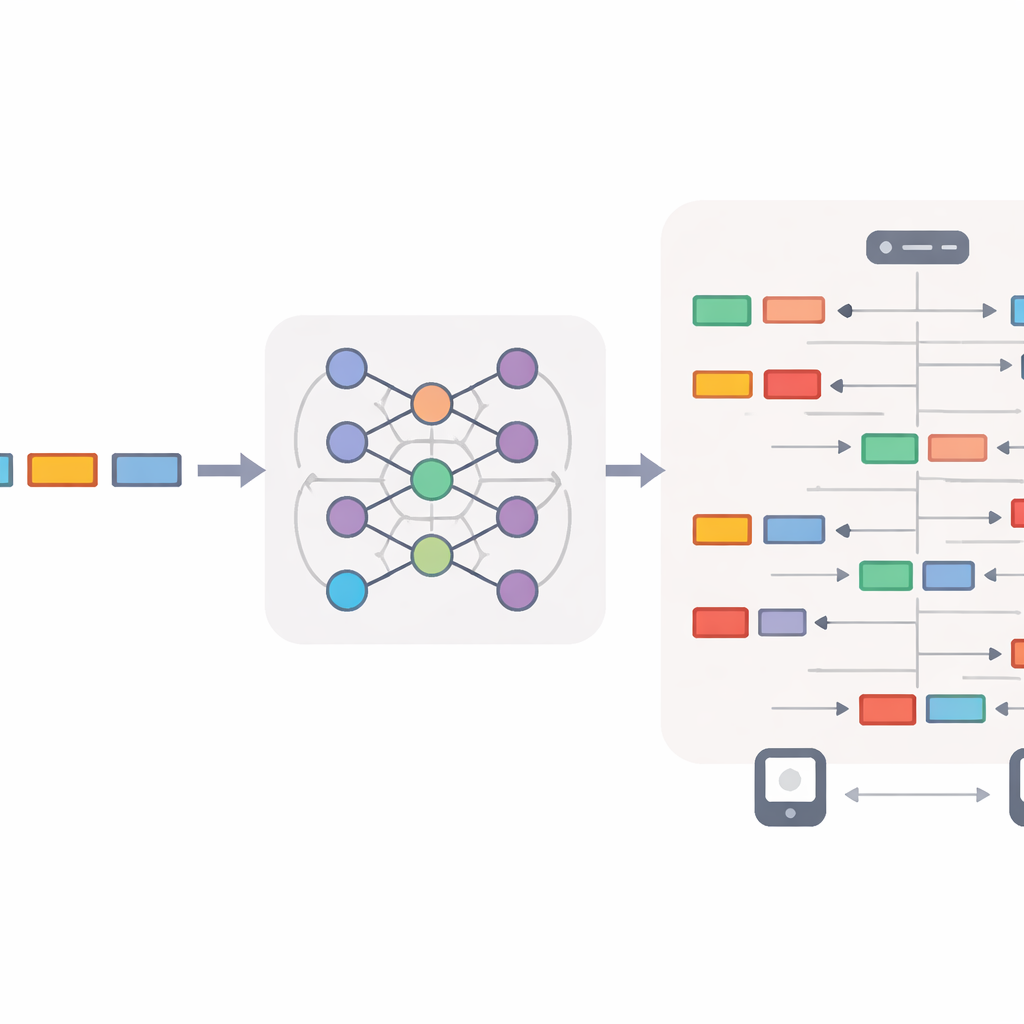

Um diese Idee zu prüfen, entwerfen die Forschenden zwei Hauptexperimente mit einem großen, realen Smart‑Home‑Datensatz namens ZigBeeNet, der etwa 25 Millionen Pakete von 15 Geräten über 20 Tage enthält. Im ersten Experiment untersuchen sie Einwegkommunikation von einer einzelnen smarten Birne zur Zentrale und trainieren das LLM nur mit den ersten zehn Minuten realen Verkehrs als Beispiele. Im zweiten Experiment übertragen sie das Setting auf eine realistischere Umgebung, in der Birne und Zentrale Nachrichten in beide Richtungen austauschen, einschließlich Broadcasts von der Zentrale. In beiden Fällen wird dem Modell eine kleine Menge Beispielpakete im Prompt gezeigt (few‑shot‑Lernen) und das Modell aufgefordert, längere Abschnitte völlig neuen Verkehrs zu erzeugen, die wieder in standardisierte Paketaufzeichnungsdateien konvertiert und mit gängigen Netzwerkanalysetools untersucht werden können.

Das Modell mit Regeln und menschlichen Prüfungen steuern

Weil ein fehlplatziertes Feld oder ein außer‑Reihen‑Zeitstempel die Wirklichkeitsnähe zerstören kann, baut das Team ein sorgfältiges Prompting‑ und Feedback‑Setup auf. Zuerst filtern und exportieren sie die realen Pakete, dann formulieren sie Prompts, die erlaubte Geräteadressen, Nachrichtentypen und Zeitformate explizit angeben. In einer Anfangsphase überprüft ein menschlicher Experte die Ausgaben des Modells und sucht nach Problemen wie ungültigen Adressen, unmöglichen Sequenznummern oder Zeitlücken. Anstatt die Pakete manuell zu korrigieren, übersetzen sie diese Befunde in strengere Prompt‑Regeln—beispielsweise das Verbot, dass ein Gerät an sich selbst sendet, oder die Anforderung, dass Paketanzahlen in einem realistischen Bereich bleiben. Sobald die Regeln stabil sind, werden die Prompts „eingefroren“ und unverändert wiederverwendet, sodass spätere Experimente vollautomatisch und reproduzierbar ablaufen.

LLMs gegen klassische Generatoren antreten lassen

Um zu prüfen, ob LLMs wirklich einen Mehrwert bieten, vergleichen die Autorinnen und Autoren GPT‑4.1 und GPT‑5 mit zwei klassischen Deep‑Learning‑Ansätzen: rekurrenten neuronalen Netzen (RNNs) und generativen gegnerischen Netzen (GANs), jeweils angepasst zur Erzeugung ZigBee‑ähnlicher Sequenzen. Sie bewerten alle Modelle entlang vieler Dimensionen: wie gut die Inter‑Arrival‑Times dem echten Verkehr entsprechen, ob Pakete in Standardtools sauber dekodieren, ob Protokollregeln und Geräterollen respektiert werden, wie oft Pakete sich wiederholen und wie oft Trainingsbeispiele exakt kopiert werden. Die Ergebnisse zeigen, dass beide GPT‑Modelle nahezu perfekt dekodierbaren und protokollkonformen Verkehr mit geringer Divergenz zu realen Zeitmustern erzeugen, während RNNs mit langfristiger Ordnung kämpfen und GANs oft unrealistisch dichten oder semantisch ungültigen Verkehr herstellen, insbesondere bei bidirektionaler Kommunikation und längeren Zeiträumen.

Wenn mehr „Denkarbeit“ nicht hilft

Die Studie untersucht außerdem eine überraschende Frage: Verbessert mehr interne „Denkarbeit“ des reasoning‑orientierten GPT‑5 die Realitätsnähe des Netzverkehrs? Indem sie den versteckten Reasoning‑Aufwand von GPT‑5 von niedrig bis hoch variieren, finden die Autorinnen und Autoren heraus, dass höherer Aufwand das Modell langsamer und wortreicher macht, aber die Ähnlichkeit des erzeugten Verkehrs zur Realität nicht verbessert und teils sogar verschlechtert. GPT‑4.1, ein schnelleres, nicht‑reasoning‑orientiertes Modell, erreicht in den wichtigsten Qualitätsmetriken konstant Gleiches oder Besseres als GPT‑5 bei geringerem Rechenaufwand. Über erweiterte 30‑minütige Simulationen behalten beide LLMs korrektes ZigBee‑Verhalten bei, während klassische RNN‑ und GAN‑Baselines in Timing und Protokollkorrektheit stark abdriften.

Was das für sicherere Smart Homes bedeutet

Für Nicht‑Fachleute ist die Hauptbotschaft, dass moderne Sprachmodelle nicht nur menschliche Gespräche lernen können, sondern auch die „Sprache“ von Smart‑Home‑Geräten und auf Abruf glaubwürdigen, regelkonformen Verkehr erzeugen. Die Arbeit zeigt, dass ein relativ schnelles, latenzarmes Modell wie GPT‑4.1 bereits als hochrealistischer Verkehrsgenerator für Tests und Sicherheitsbewertungen dienen kann und so möglicherweise die Notwendigkeit reduziert, sensible Echtweltdaten zu erfassen. Sie betont außerdem, dass komplexeres, ressourcenintensiveres Reasoning nicht immer überlegen ist: Bei eng strukturierten technischen Aufgaben können einfachere, effiziente Modelle die klügere Wahl sein. Mit der Veröffentlichung von Code und Datensatz könnte dieser Ansatz Forschenden weltweit helfen, Smart‑Home‑Systeme sicher zu stress‑testen, die Eindringungserkennung zu verbessern und neue Netzwerkdesigns in einer sicheren, synthetischen Umgebung zu erkunden.

Zitation: Keleşoğlu, N., Sobczak, Ł. & Domańska, J. When LLMs speak ZigBee: exploring low-latency and reasoning models for network traffic generation. Sci Rep 16, 8036 (2026). https://doi.org/10.1038/s41598-026-37246-y

Schlüsselwörter: Smart‑Home‑IoT, ZigBee‑Verkehrsgenerierung, große Sprachmodelle, Netzwerksicherheitstests, synthetische Netzwerkdaten