Clear Sky Science · de

Unterschiedliche BI-RADS-Brustkrebsdiagnose mit MobileNetV1 und Vision Transformer basierend auf erklärbarer künstlicher Intelligenz (XAI)

Krebsrisiko früher erkennen

Brustkrebs ist am besten behandelbar, wenn er früh entdeckt wird, doch das Lesen von Mammographien ist anspruchsvoll und unter Zeitdruck. Diese Studie beschreibt ein neues System der künstlichen Intelligenz (KI), das nicht nur sehr genau Krebsanzeichen auf Mammographien erkennt, sondern Ärzten auch genau zeigt, welche Bereiche des Brustbildes seine Entscheidungen beeinflusst haben. Durch die geschickte Kombination zweier moderner Bildanalyseverfahren soll das System Radiologen mit schnellen, verlässlichen und transparenten Zweitmeinungen unterstützen.

Warum das Lesen von Mammographien so schwierig ist

Mammographien sind Röntgenaufnahmen der Brust, die verwendet werden, um frühe Anzeichen von Krebs zu erkennen. Radiologen vergeben für jede Untersuchung eine BI-RADS-Klassifikation, eine standardisierte Skala, die von unauffälligen Befunden bis zu eindeutig krebsverdächtigen reicht. Bei dichtem Brustgewebe, in dem viel Drüsengewebe vorhanden ist, können verdächtige Stellen verborgen sein oder harmlose Strukturen ähneln. Viele frühere computergestützte Werkzeuge konzentrierten sich entweder nur auf einfache Ja‑/Nein‑Krebssignale, hatten Schwierigkeiten mit dem ganzen Spektrum der BI-RADS‑Kategorien oder arbeiteten wie eine Black Box, sodass Ärzte nicht genau wussten, warum eine bestimmte Entscheidung getroffen wurde.

Zwei Arten, ein Bild zu «sehen», kombinieren

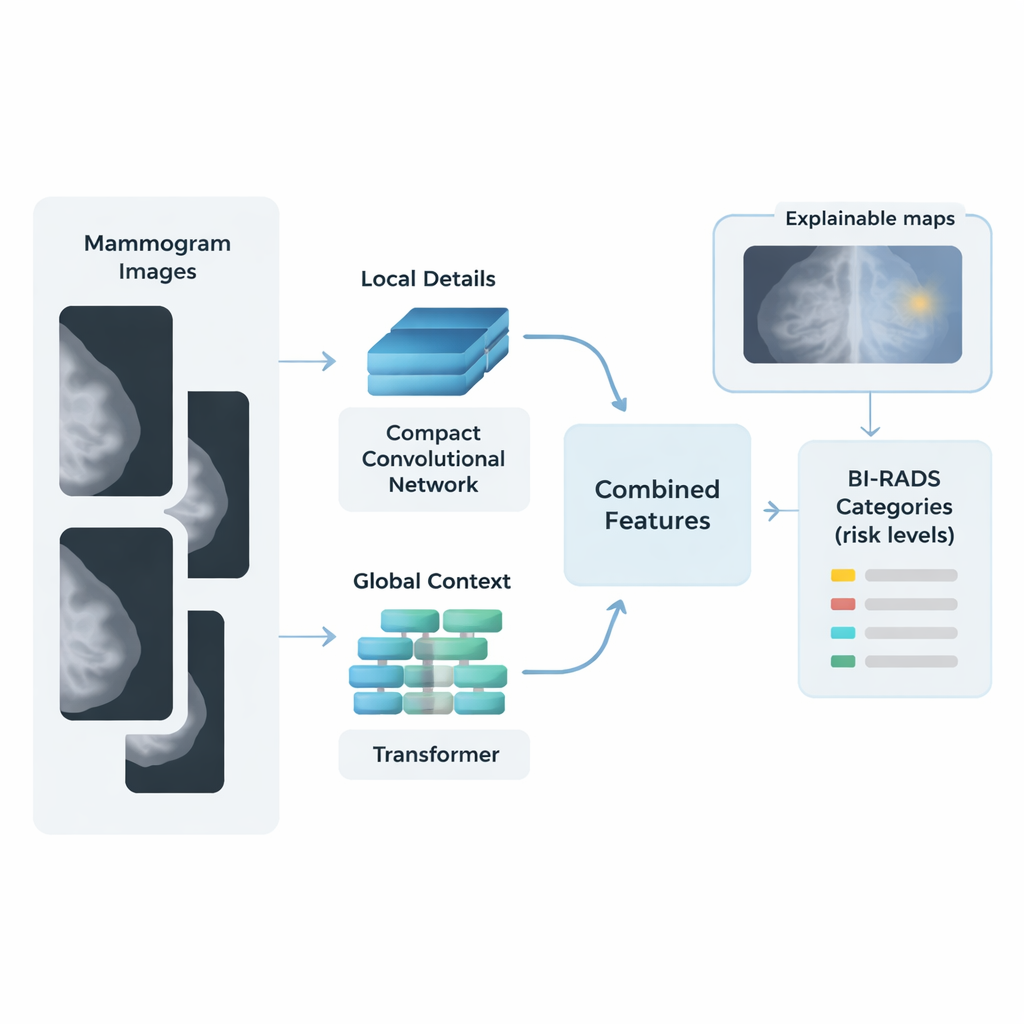

Die Forscher entwickelten ein hybrides KI‑Framework, das nachahmt, wie ein sorgfältiger menschlicher Leser eine Mammographie abtasten könnte: zunächst Feinheiten betrachten, dann das Gesamtbild berücksichtigen. Ein Teil des Systems, basierend auf einem kompakten Netzwerk namens MobileNetV1, konzentriert sich auf lokale Details wie winzige Verkalkungen und scharfe Läsionsränder. Ein zweiter Teil, ein Vision Transformer, zerlegt das Bild in Patches und analysiert, wie Muster über die ganze Brust hinweg zusammenhängen, wodurch die Gesamtstruktur des Gewebes und subtile Verzerrungen erfasst werden. Die Merkmale aus diesen beiden „Strömen“ werden dann zu einer einzigen, aussagekräftigen Beschreibung jedes Bildes zusammengeführt.

Daten bereinigen, ausgleichen und vereinfachen

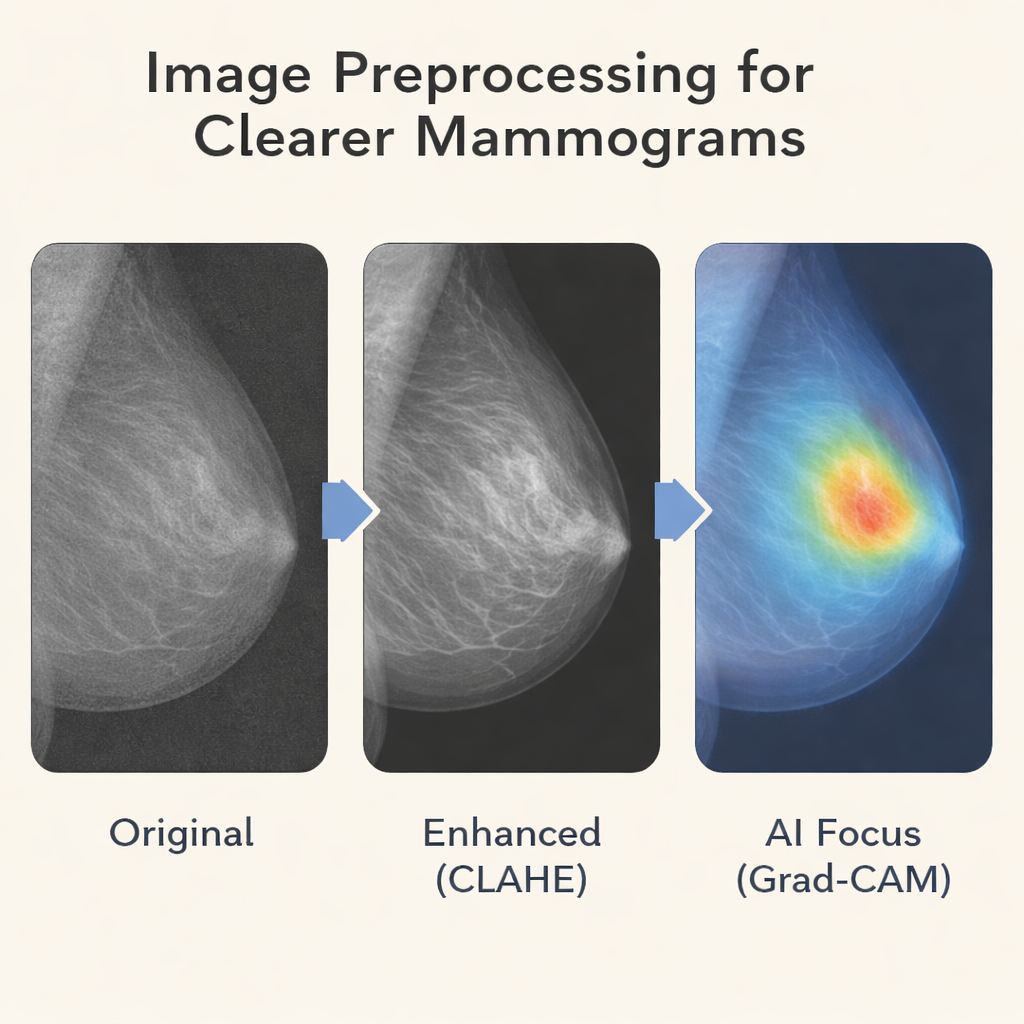

Bevor die Bilder in die KI‑Pipeline gelangen, durchlaufen sie mehrere Vorverarbeitungsschritte. Das Team verbessert den Kontrast mit einer Methode, die feine Strukturen aufhellt, ohne das Rauschen zu übertreiben, sodass schwache Auffälligkeiten leichter erkennbar werden. Bilder werden skaliert und normalisiert, damit das System sie konsistent sieht. Um der Tatsache entgegenzuwirken, dass einige BI-RADS‑Kategorien, etwa eindeutig maligne Fälle, relativ selten sind, verwenden die Autoren Datenaugmentierungstricks wie kleine Drehungen und Spiegelungen und wenden klassenbewusstes Training an, sodass weniger verbreitete Kategorien beim Lernen trotzdem Gewicht haben. Nachdem die beiden Ströme Merkmale extrahiert haben, komprimiert ein mathematisches Verfahren, die Hauptkomponentenanalyse, diese Informationen, bewahrt das Wesentliche und reduziert die Komplexität.

Von Merkmalen zu Risikowerte, mit Erklärungen

Für den letzten Schritt setzen die Autoren statt auf einen schweren, intransparenten neuronalen Klassifikator auf viele einfache logistische Regressionsmodelle in einem „Bagging“-Ensemble. Jedes Modell bietet eine direkte Verbindung zwischen Bildmerkmalen und BI-RADS‑Risikostufen, und die Mehrheitsentscheidung sorgt für Stabilität und Widerstandsfähigkeit gegen Überanpassung auf dem relativ kleinen Datensatz. Getestet an mehr als 6.000 Mammographien aus dem King Abdulaziz University Breast Cancer Dataset erreichte das hybride System über 99 % Genauigkeit, Sensitivität und Spezifität über die vier zentralen BI-RADS‑Kategorien, auf die es abzielte: normal, wahrscheinlich gutartig, verdächtig und malign.

Ärzten zeigen, was die KI sieht

Um seine Entscheidungen nachvollziehbar zu machen, nutzt das System erklärbare KI‑Techniken wie Grad‑CAM und Grad‑CAM++. Diese erzeugen farbige Heatmaps, die auf die Mammographie überlagert werden und die Regionen hervorheben, die die prognostizierte BI-RADS‑Einstufung am stärksten beeinflusst haben. Bei malignen Fällen stimmen die hervorgehobenen Bereiche typischerweise mit Massen oder Verkalkungskonzentrationen überein, die von erfahrenen Radiologen notiert wurden; bei normalen Bildern gibt es wenig bis gar keine fokussierte Aktivierung. Dieses visuelle Feedback hilft Klinikern zu beurteilen, ob das Modell auf medizinisch sinnvolle Merkmale achtet, und kann erklären, warum bestimmte Grenzfälle — etwa dichtes Gewebe, das eine Läsion nachahmt — selbst für Experten schwierig sind.

Was das für Patientinnen bedeuten könnte

Die Studie zeigt, dass dieses duale, erklärbare KI‑System auf einem einzelnen klinischen Datensatz Mammographien in mehrere Risikostufen mit einer Genauigkeit klassifizieren kann, die mit vielen früheren Methoden vergleichbar ist und sie in mancher Hinsicht übertrifft. Obwohl es noch an vielfältigeren Populationen und in anderen Krankenhäusern getestet werden muss, weist der Ansatz auf KI‑Werkzeuge hin, die nicht nur sehr genau, sondern auch schnell genug für vielbeschäftigte Kliniken und transparent genug sind, um das Vertrauen von Radiologen und Patientinnen zu gewinnen. In der Praxis könnten solche Systeme als zusätzliches Paar fachkundiger Augen dienen — subtile Befunde markieren, fehlende Krebsfälle reduzieren und klarere, selbstbewusstere Gespräche über das Brustkrebsrisiko unterstützen.

Zitation: Abdelsabour, I., Elgarayhi, A., Sallah, M. et al. Different BI-RADS breast cancer diagnosis using MobileNetV1 and vision transformer based on explainable artificial intelligence (XAI). Sci Rep 16, 7190 (2026). https://doi.org/10.1038/s41598-026-37199-2

Schlüsselwörter: Brustkrebs, Mammographie, künstliche Intelligenz, Vision Transformer, erklärbare KI