Clear Sky Science · de

YOLO-DC zur Fahrzeugerkennung mit deformierbaren Faltungsnetzen und kanalübergreifender Koordinatenaufmerksamkeit

Warum das Erkennen von Autos aus Kamerabildern wirklich wichtig ist

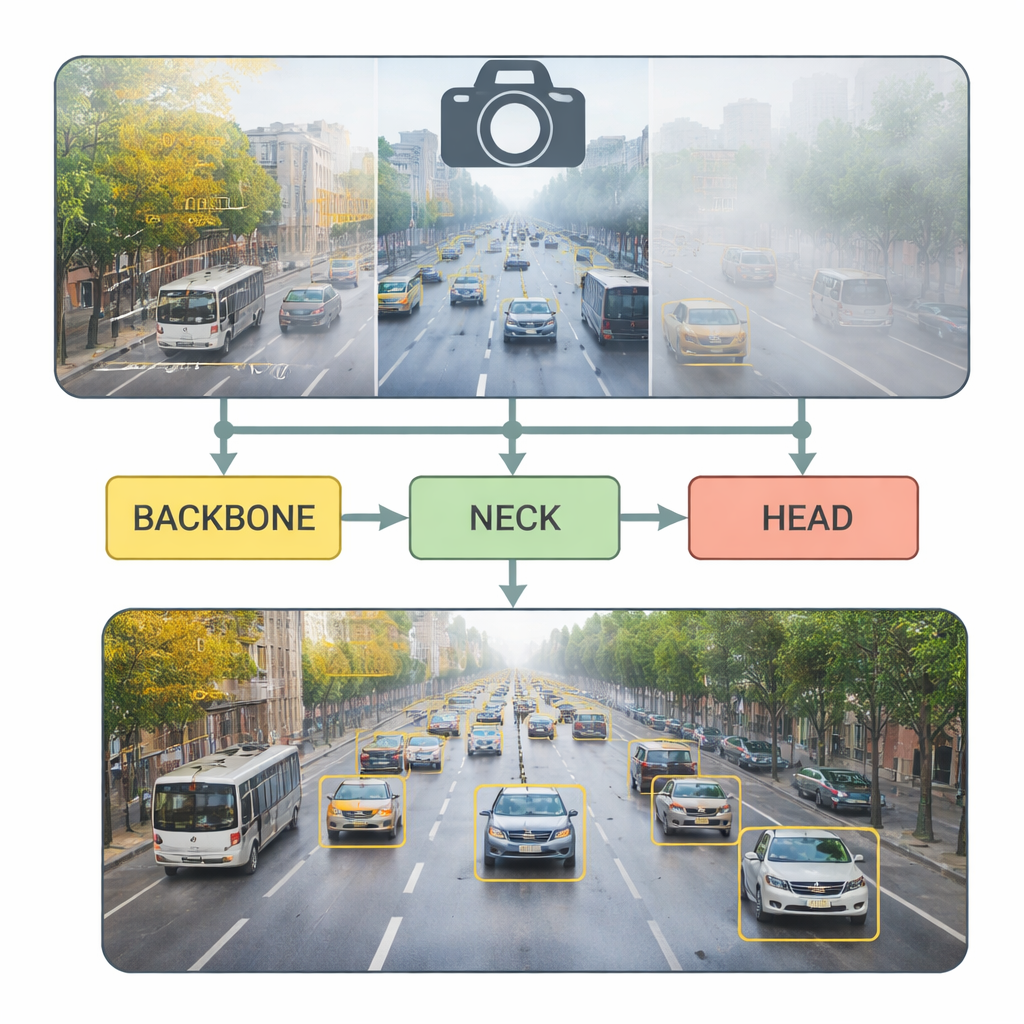

Moderne Städte sind auf Kameras angewiesen, die belebte Straßen überwachen, bei der Verkehrsflusssteuerung helfen und die Grundlage für autonome Fahrzeuge legen. Trotzdem ist es überraschend schwierig, in diesen Kamerabildern zuverlässig alle Fahrzeuge zu erkennen — besonders wenn Autos in der Ferne winzig sind, in Staus teilweise verdeckt werden oder durch Regen, Nebel oder Dunkelheit verschwimmen. Dieses Papier stellt YOLO‑DC vor, ein neues Computer‑Vision‑System, das darauf abzielt, Pkw, Busse und andere Fahrzeuge schnell und präzise zu erkennen, selbst unter schwierigen realen Bedingungen und auf Geräten mit begrenzter Rechenleistung.

Das Verkehrsproblem hinter der Forschung

Wachsende Städte sehen sich mit verstopften Straßen, mehr Unfällen und steigenden Emissionen konfrontiert. Intelligente Verkehrssysteme versprechen Abhilfe, indem sie den Verkehr in Echtzeit überwachen und sowohl menschliche als auch autonome Fahrer lenken. Die zentrale Komponente ist eine schnelle, zuverlässige Fahrzeugerkennung in Videobildern. Frühere „zweistufige“ Algorithmen durchsuchen Bilder in mehreren Durchgängen und können sehr genau sein, sind aber oft zu langsam für den Echtzeiteinsatz an Straßenkameras oder in Fahrzeugen. Neuere „einphasige“ Systeme wie die YOLO‑Familie ("You Only Look Once") tauschen etwas komplexere Modelle gegen deutlich höhere Geschwindigkeit — das macht sie in der Praxis beliebt. Dennoch haben sie weiterhin Probleme mit kleinen, überlappenden Fahrzeugen und mit widrigem Wetter, das Details verschleiert. YOLO‑DC baut auf dem aktuellen YOLOv8‑Modell auf und überarbeitet dessen innere Schichten, um diese Herausforderungen besser zu bewältigen.

Wie YOLO‑DC mehr sieht durch intelligentere Fokussierung

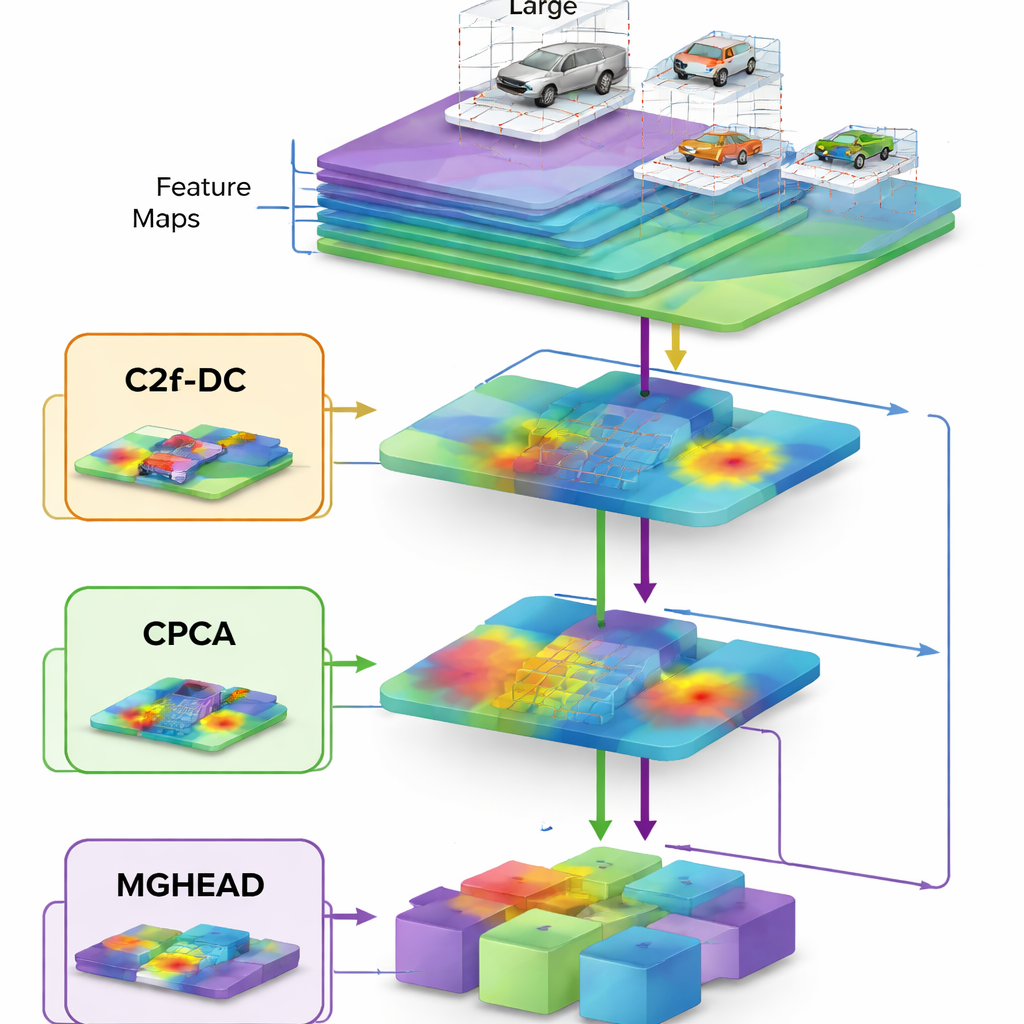

Im Kern von YOLO‑DC steht ein überarbeitetes „Backbone“-Netzwerk, der Teil, der rohe Bilder zuerst in abstrakte Merkmale umwandelt. Die Autoren führen einen Mechanismus namens kanalübergreifende Koordinatenaufmerksamkeit ein, der dem Netzwerk effektiv beibringt, nicht nur wo im Bild es hinschauen soll, sondern auch welche Arten visueller Muster stärker gewichtet werden sollten. Kombiniert mit sogenannten deformierbaren Faltungen — Filtern, die ihre Abtastmuster biegen können, um schrägen oder ungewöhnlich geformten Fahrzeugen zu folgen — kann dieses Backbone besser auf Fahrzeuge aus verschiedenen Blickwinkeln, Maßstäben und Positionen reagieren. Statt jeden Straßenbereich gleich zu behandeln, lernt das System, die aussagekräftigen Konturen und Texturen hervorzuheben, die echte Fahrzeuge von Gebäuden, Bäumen oder Fahrbahnmarkierungen unterscheiden.

Kleine und entfernte Fahrzeuge erfassen, ohne langsamer zu werden

Der mittlere Teil des Modells, bekannt als Neck, ist dafür verantwortlich, Informationen aus groben, weitwinkligen Ansichten mit feinen Nahdetails zu verschmelzen. YOLO‑DC verbessert diese Stufe auf zwei Arten. Erstens hilft ein Channel‑Prior‑Attention‑Modul dem Netzwerk, Rauschen zu unterdrücken und subtile Hinweise von weit entfernten, kleinen Fahrzeugen im Bild hervorzuheben. Zweitens reduziert ein neu gestalteter Block, inspiriert von der leichten FasterNet‑Architektur, die Anzahl der Operationen, indem vollständige Faltungen nur auf einen Teil der Daten angewendet und dann effizient gemischt werden. Diese sorgfältige Überarbeitung verringert sowohl die Anzahl der Parameter als auch den Speicherverkehr, wodurch das Modell schneller läuft und gleichzeitig die Genauigkeit verbessert — eine ungewöhnliche, aber sehr wünschenswerte Kombination für Edge‑Geräte wie Verkehrskameras und Bordcomputer.

Fahrzeuge in vielen Größen und bei schlechtem Wetter erkennen

Die letzte Stufe, der Head, entscheidet, wo Objekte sind und was sie sind. YOLO‑DC führt hier mehrskalige gruppierte Faltungen ein, indem Merkmalskarten in mehrere Kanalgruppen aufgeteilt werden, die jeweils unterschiedliche Filtergrößen verwenden, bevor sie wieder zusammengeführt werden. Das verleiht dem Detektor ein reichhaltigeres Größenverständnis, sodass er gleichzeitig große Busse, mittelgroße Lkw und winzige, kaum sichtbare Autos in der Ferne erkennen kann. In umfangreichen Tests auf dem UA‑DETRAC‑Datensatz, der Straßenszenen bei bewölktem, sonnigem, regnerischem und nächtlichem Wetter enthält, erreichte YOLO‑DC die Genauigkeit erstklassiger Detektoren oder übertraf sie, während es nur einen Bruchteil ihrer Rechenleistung nutzte und auf moderner Hardware hunderte Bilder pro Sekunde verarbeitete. Auf dem DAWN‑Datensatz, der speziell für Nebel, Regen, Schnee und Sandstürme konzipiert ist, zeigte das neue Modell besonders große Verbesserungen bei kräftigem Regen und dichtem Nebel, Bedingungen, in denen herkömmliche Systeme oft versagen.

Was die Ergebnisse für den Alltag auf Straßen bedeuten

Für Nicht‑Experten lautet die Kernbotschaft, dass YOLO‑DC den realen Verkehr besser „sieht“, wie er tatsächlich aussieht: überfüllt, unordentlich und oft durch schlechtes Wetter oder ungünstige Beleuchtung verdeckt. Durch die Kombination flexibler Filter, die Fahrzeugformen folgen, mit Aufmerksamkeitsmechanismen, die sich auf die informativsten Regionen konzentrieren, erkennt das System mehr Fahrzeuge, verpasst weniger und läuft schnell genug für Live‑Videoanalyse auf moderater Hardware. Das macht es zu einem vielversprechenden Baustein für intelligenteres Verkehrsmanagement, zuverlässigere Unfallüberwachung und sichereres autonomes Fahren — und das bei niedrigen Verarbeitungskosten, sodass eine breite Einführung in Städten und zukünftigen Fahrzeugen möglich bleibt.

Zitation: Liu, Z., Zhu, M., Gao, B. et al. YOLO-DC for vehicle detection using deformable convolutional networks and cross-channel coordinate attention. Sci Rep 16, 6284 (2026). https://doi.org/10.1038/s41598-026-37094-w

Schlüsselwörter: Fahrzeugerkennung, intelligenter Verkehr, YOLO, widriges Wetter, Echtzeit-Bildverarbeitung