Clear Sky Science · de

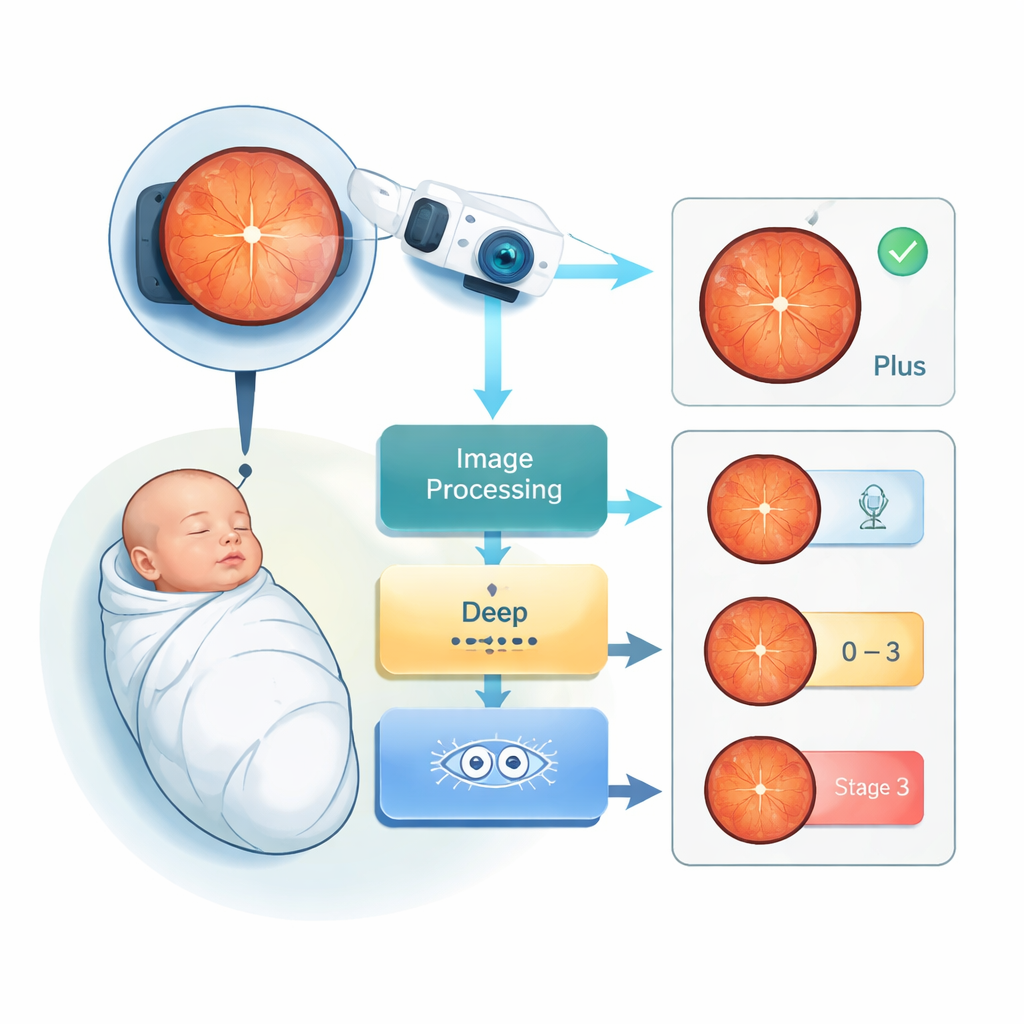

Automatisierte Diagnose der Plus-Form und frühe Stadien der Frühgeborenen-Retinopathie mithilfe von Deep-Learning-Modellen

Warum winzige Augen und kluge Computer wichtig sind

Jedes Jahr sind Tausende Frühgeborene durch den Verlust ihres Sehvermögens bedroht, weil sich die Blutgefäße im hinteren Teil des Auges nicht normal entwickeln – ein Zustand, der als Retinopathie der Frühgeborenen (ROP) bezeichnet wird. Wenn dieses Problem früh erkannt wird, kann das Sehen gerettet werden; dazu sind jedoch häufige Augenuntersuchungen durch hochspezialisierte Fachkräfte nötig – Experten, die in vielen Teilen der Welt knapp sind. Diese Studie untersucht, wie moderne künstliche Intelligenz (KI) Ärzten dabei helfen kann, Frühwarnzeichen in Netzhautfotografien zu erkennen, und so fachärztliche Screening-Fähigkeiten in Krankenhäuser und Kliniken bringen könnte, die keine Spezialversorgung haben.

Das Problem: fragile Sehkraft bei den kleinsten Patienten

ROP entsteht, wenn eine Frühgeburt das normale Wachstum der Blutgefäße in der Netzhaut – der lichtempfindlichen Schicht im hinteren Augenbereich – unterbricht. Besonders gefährdet sind sehr früh geborene Babys oder solche mit sehr niedrigem Geburtsgewicht. In leichten Fällen erholt sich das Auge von selbst. In schweren Fällen können abnorme Gefäße an der Netzhaut ziehen und zu bleibender Erblindung führen. Weltweit führt ROP schätzungsweise bei 50.000 Menschen zur Erblindung, vor allem in Regionen, in denen die neonatale Versorgung das Überleben verbessert hat, Screening-Programme und Spezialisten für Augen jedoch nicht Schritt gehalten haben. Die bisherige Untersuchung ist arbeitsintensiv, kostenintensiv und subjektiv: Zwei Experten können sich manchmal darüber uneinig sein, wie schwer die Erkrankung eines Babys tatsächlich ist.

Worauf Ärzte achten: verdrehte Gefäße und frühe Stadien

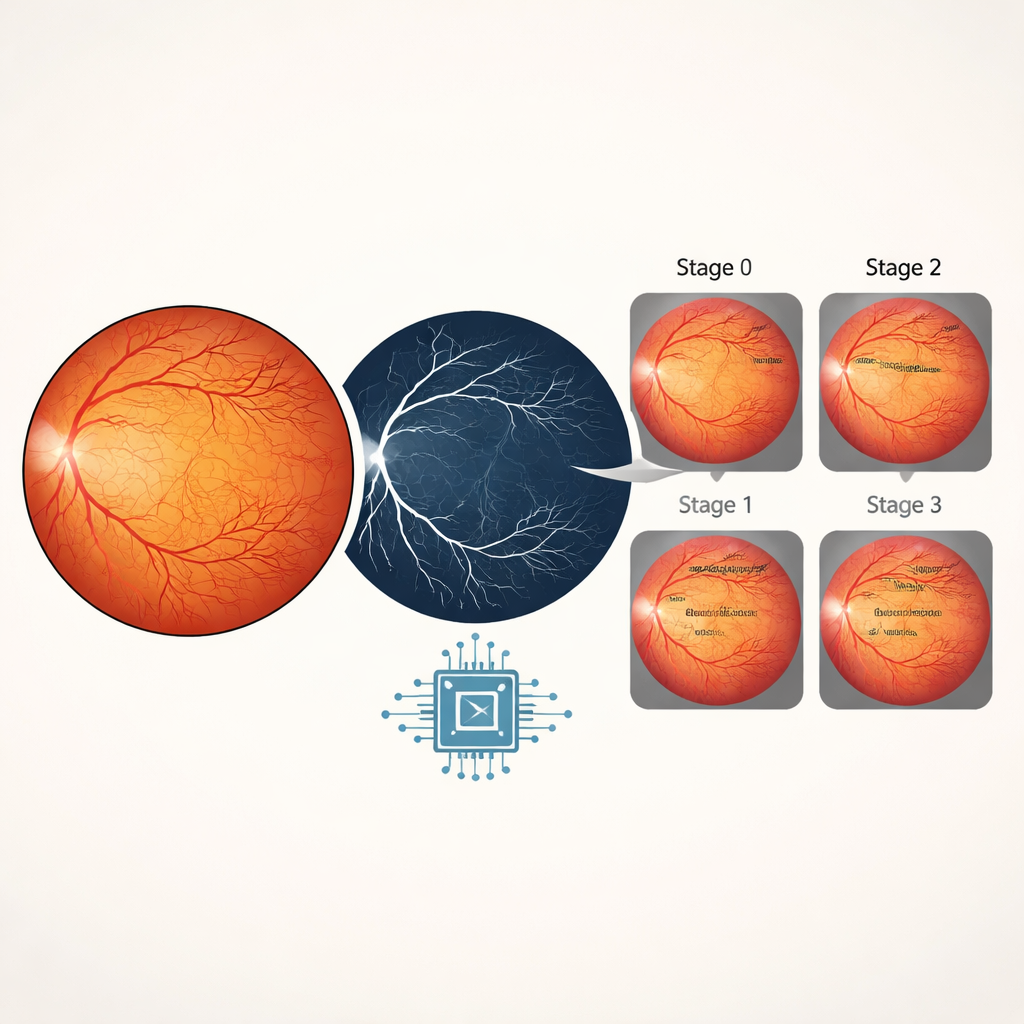

Augenärzte beurteilen ROP anhand von zwei Hauptmerkmalen in Netzhautaufnahmen. Zum einen der allgemeine Krankheitsgrad, von Stadium 0 (keine sichtbaren Veränderungen) bis zu den frühen Stadien (1–3). Zum anderen die sogenannte Plus-Erkrankung, ein Warnzeichen, bei dem die Blutgefäße auf der Netzhaut ungewöhnlich erweitert und verdreht sind. Plus-Erkrankung weist auf ein höheres Risiko schwerer Schäden hin und löst oft eine Behandlung wie Lasertherapie oder Injektionen aus. Die Beurteilung dieser Merkmale durch das Auge ist schwierig, besonders wenn Bilder unscharf sind oder wenn Säuglinge Woche für Woche wiederholt untersucht werden müssen. Ein System, das Plus-Erkrankung automatisch markiert und allein aus Bildern das ROP-Stadium schätzt, wäre ein mächtiges Hilfsmittel für Klinikpersonal.

Wie die KI sieht: Gefäßkarten aus Augenfotos erstellen

Die Forscher bauten eine zweistufige KI-Pipeline auf Grundlage von mehr als 6.000 Netzhautbildern von 188 Säuglingen. Zunächst trainierten sie ein neuronales Netzwerk, um eine präzise "Gefäßkarte" jeder Netzhaut zu zeichnen und alle sichtbaren Blutgefäße bis in die feinsten Verzweigungen hervorzuheben. Unter mehreren konkurrierenden Bildverarbeitungsmodellen erwies sich eine Variante namens U-Net++ als am besten geeignet, detaillierte Gefäßmuster zu erfassen, insbesondere bei verrauschten oder kontrastschwachen Bildern. Zur Verbesserung der Klarheit verstärkte das Team jedes Foto vor der Segmentierung mit kontraststeigernden Filtern und Rauschunterdrückung. Für die Erkennung der Plus-Erkrankung fütterten sie dann ausschließlich die Gefäßkarten – nicht die vollständigen Farbaufnahmen – in ein zweites neuronales Netzwerk, weil die Plus-Erkrankung nahezu ausschließlich durch Gefäßdicke und -krümmung definiert ist.

Dem Netzwerk beibringen, die Schwere der Erkrankung zu stufen

Zur Beurteilung des ROP-Stadiums reichten die Gefäßformen allein nicht aus. Das System kombinierte daher die ursprünglichen farbigen Netzhautbilder mit den dazugehörigen Gefäßkarten, sodass das Modell sowohl die Gesamtansicht der Netzhaut als auch eine geschärfte Darstellung der Gefäße erhielt. Das Team testete mehrere bekannte Deep-Learning-Backbones und stellte fest, dass ein Modell namens EfficientNetB4 das beste Gleichgewicht zwischen Genauigkeit und Effizienz bot. Bei unabhängigen Validierungsbildern erreichte der Plus-Erkennungsalgorithmus eine Genauigkeit von 99,6 Prozent, während der Stadien-Klassifikator eine Genauigkeit von 98 Prozent über die Stadien 0 bis 3 erzielte. Weitere Prüfungen, darunter Precision-Recall-Kurven und ROC-Kurven, zeigten, dass das Modell sowohl eine hohe Sensitivität (seltenes Übersehen von Erkrankung) als auch eine hohe Spezifität (selten falsche Alarme) beibehielt, obwohl Plus-Erkrankungen deutlich seltener waren als normale Bilder.

Ein Blick in die "Black Box"

Da Kliniker jedem Werkzeug, das Behandlungsentscheidungen beeinflusst, vertrauen müssen, untersuchten die Autoren, wie ihre KI zu ihren Entscheidungen kam. Mit Visualisierungsmethoden wie t-SNE zeigten sie, dass Bilder aus verschiedenen Klassen (z. B. Plus vs. Normal oder Stadium 1 vs. Stadium 3) im internen Merkmalsraum des Modells gut getrennte Cluster bildeten. Mit Heatmap-Techniken wie Grad-CAM hoben sie die Bereiche jeder Netzhaut hervor, die eine Vorhersage am stärksten beeinflussten. Bei der Plus-Erkrankung fokussierte sich das Modell auf Bereiche, in denen Gefäße ungewöhnlich breit oder verdreht waren – genau das, wonach Experten suchen. Bei der Stadienbewertung achtete es zudem auf andere Regionen wie die Papille und die Makula, was darauf hindeutet, dass seine Entscheidungsfindung eng mit etablierten medizinischen Kriterien übereinstimmt und nicht auf zufälligen Bildartefakten beruht.

Was das für Babys und Kliniken bedeutet

Einfach gesagt zeigt diese Arbeit, dass ein sorgfältig konzipiertes KI-System Netzhautbilder von Frühgeborenen mit nahezu Expertenniveau lesen kann – sowohl um gefährliche Gefäßveränderungen zu erkennen als auch um das Fortschreiten der Erkrankung einzuschätzen. Die Studie wurde an einem einzigen medizinischen Zentrum durchgeführt und umfasste nur frühe bis mittlere Stadien; größere multizentrische Prüfungen und Daten aus fortgeschritteneren Fällen sind daher noch erforderlich. Die Ergebnisse deuten jedoch darauf hin, dass solche Werkzeuge mit weiterer Validierung und einer sorgfältigen Integration in Telemedizin-Plattformen überlasteten Gesundheitssystemen helfen könnten, deutlich mehr Säuglinge konsistenter und kostengünstiger zu screenen. Das könnte frühere Behandlungen ermöglichen und die Chance verbessern, das Sehvermögen einiger der verletzlichsten Patienten in der neonatologischen Versorgung zu erhalten.

Zitation: Vahidmoghadam, M., Ghorbani, P., Ahmadi, M.J. et al. Automated diagnosis of plus form and early stages of ROP using deep learning models. Sci Rep 16, 7234 (2026). https://doi.org/10.1038/s41598-026-37064-2

Schlüsselwörter: Retinopathie der Frühgeborenen, künstliche Intelligenz, Deep Learning, medizinische Bildgebung, neonatale Augenerkrankung