Clear Sky Science · de

Bewertung von Schwachstellen in Gangerkennungssystemen durch PPO- und GAN-erzeugte adversariale Angriffe

Warum es wichtig ist, Gangmuster zu täuschen

Die meisten von uns erkennen Freunde und Familienmitglieder an ihrer Art zu gehen, oft sogar aus der Distanz. Computer können inzwischen Ähnliches leisten: "Gangerkennung"-Systeme analysieren den Gang einer Person, um sie zu identifizieren, ohne Fingerabdrücke oder Gesichtsscans. Diese Werkzeuge werden zunehmend in Sicherheit und Überwachung eingesetzt. Die Studie stellt eine beunruhigende Frage: Wie leicht lassen sich solche Systeme mit winzigen, gezielt gefertigten Veränderungen austricksen, die Menschen kaum bemerken — Maschinen aber schon? Die Antwort hat weitreichende Folgen für Privatsphäre, Sicherheit und das Vertrauen in künstliche Intelligenz in risikobehafteten Bereichen.

Wie Computer unsere Art zu gehen lesen

Moderne Gangerkennung basiert auf Deep Learning, derselben Technikfamilie, die auch hinter Gesichtserkennung und autonomen Fahrzeugen steht. Anstatt ein einzelnes Standbild zu betrachten, fassen diese Systeme viele Frames einer gehenden Person in ein einziges "Gait Energy Image" zusammen — eine Art verschwommene Silhouette, die erfasst, wie sich Körperteile über einen vollständigen Schrittablauf bewegen. Ein speziell entwickeltes neuronales Netzwerk lernt dann, den Gang einer Person vom eines anderen zu unterscheiden, selbst wenn Kleidung oder mitgeführte Gegenstände variieren. In Tests auf zwei großen Forschungsdatensätzen mit Gehvideos (den CASIA-B- und OU-ISIR-Datensätzen) identifizierte das Basis-Modell der Autoren die Personen in mehr als 97 % der Fälle korrekt — eine starke Leistung, die suggerieren könnte, dass die Technik bereit für den praktischen Einsatz ist.

Die unsichtbaren Aufkleber, die smarte Kameras täuschen

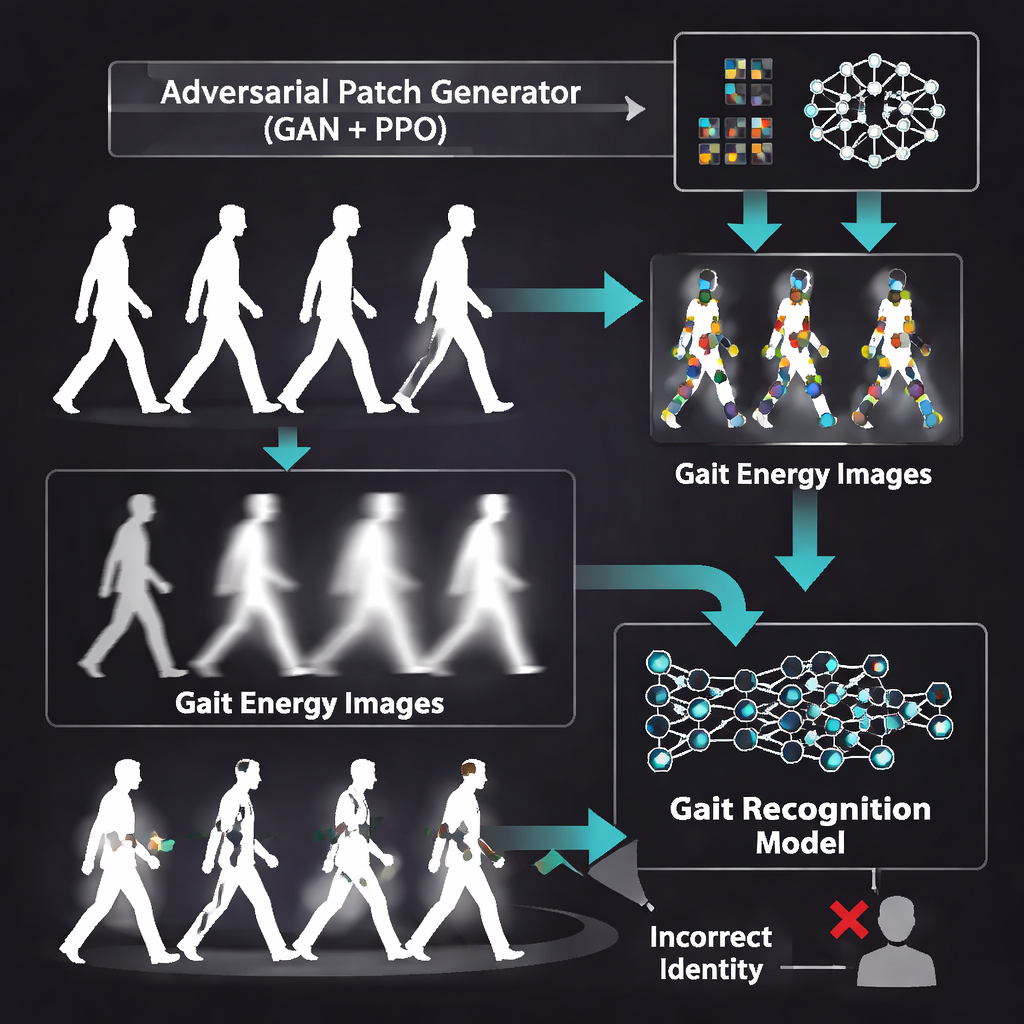

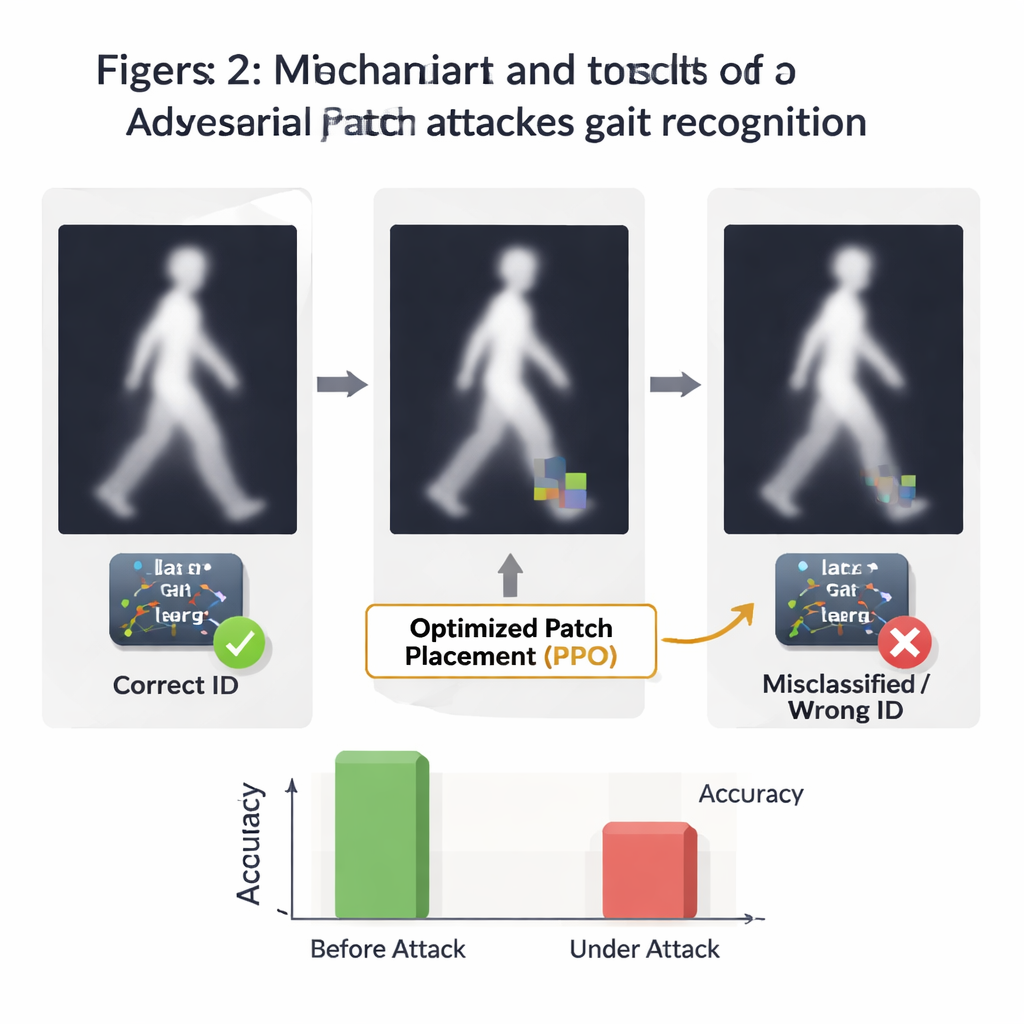

Der Kern der Arbeit besteht weniger darin, ein besseres Identifikationssystem zu bauen, als es absichtlich zu brechen, um Schwachstellen offenzulegen. Die Forschenden erzeugen kleine "adversariale Patches" — quadratische Bereiche veränderter Pixel, die harmlos aussehen, aber mathematisch so abgestimmt sind, dass sie das neuronale Netzwerk verwirren. Zur Erzeugung dieser Patches verwenden sie ein Generative Adversarial Network (GAN), eine Art KI, die durch Wettbewerb mit einem internen Kritiker realistisch wirkende Bilder produziert. Das GAN wird direkt auf Gait Energy Images trainiert, sodass seine Ausgaben sich natürlich in die gespenstischen Silhouetten einfügen. Diese Patches sind so gestaltet, dass sie so subtil sind, dass ein flüchtiger Mensch beim Betrachten des Gangbilds wahrscheinlich nichts Auffälliges bemerken würde.

Ein lernender Agent findet die Schwachstellen

Wo ein Patch platziert wird, kann genauso wichtig sein wie sein Aussehen. Um die schädlichsten Positionen zu entdecken, wenden die Autoren eine Methode des verstärkenden Lernens namens Proximal Policy Optimization (PPO) an. Sie behandeln jedes Gangbild wie eine gitterförmige Umgebung und lassen einen Software-"Agenten" den Patch verschieben — nach oben, unten, links oder rechts — während er beobachtet, wie stark das Vertrauen des Erkennungssystems sinkt. Führt eine Position dazu, dass das Modell die Person falsch erkennt, wird der Agent belohnt; gelingt das nicht, wird er bestraft. Über viele Episoden hinweg lernt der Agent eine Strategie zur Platzierung der Patches in besonders verwundbaren Bereichen des Gangbilds, oft in der Nähe bewegter Körperpartien, auf die das Modell am meisten vertraut.

Was passiert, wenn der Angriff entfesselt wird

Nachdem sowohl der Patch-Generator als auch die Platzierungsstrategie trainiert wurden, attackiert das Team seinen eigenen leistungsstarken Gangerkenner. Unter normalen Bedingungen zeigt das System eine ausgezeichnete Genauigkeit, wenige Fehlalarme und eine starke Trennung zwischen korrekten und inkorrekten Übereinstimmungen. Sobald jedoch adversariale Patches hinzugefügt werden, fällt die Leistung deutlich ab. Abhängig davon, wie weit der Patch über das Bild bewegt werden darf, steigen die Erfolgsraten der Angriffe auf über 60 % und der Anteil korrekt identifizierter Personen kann auf nahezu ein Drittel des ursprünglichen Niveaus absinken. Kurven, die zuvor eine nahezu perfekte Unterscheidung zwischen echten Nutzern und Eindringlingen zeigten, sinken in Richtung der Zufallsentscheidung und legen offen, wie leicht das Modell ohne sichtbare Verzerrungen vom Kurs gebracht werden kann.

Was das für die alltägliche Sicherheit bedeutet

Für Nichtfachleute ist die Botschaft klar: Ein Gangerkennungssystem, das im Labor hoch genau erscheint, kann gegenüber cleveren, maschinell entworfenen Manipulationen überraschend fragil sein. Die Studie zeigt, dass die Kombination aus generativen Bildwerkzeugen und Trial-and-Error-Lernen winzige, nahezu unsichtbare Veränderungen hervorbringen kann, die zu gravierenden Identifikationsfehlern führen. Die Arbeit ist weniger ein Fahrplan für Missbrauch in der Praxis als vielmehr eine Warnung und ein Prüfrahmen. Sie gibt Systementwicklern ein Werkzeug an die Hand, um die Verwundbarkeit ihrer Modelle zu prüfen und zu messen, und unterstreicht die Notwendigkeit, Schutzmaßnahmen gegen solche Angriffe zu entwickeln, bevor Gangerkennung breit für Überwachung, Zugangskontrolle oder andere kritische Anwendungen vertraut wird.

Zitation: Saoudi, E.M., Jaafari, J. & Jai Andaloussi, S. Evaluating gait system vulnerabilities through PPO and GAN-generated adversarial attacks. Sci Rep 16, 6039 (2026). https://doi.org/10.1038/s41598-026-37011-1

Schlüsselwörter: Gangerkennung, biometrische Sicherheit, adversariale Angriffe, Deep Learning, Verstärkendes Lernen