Clear Sky Science · de

Kollaborative Repräsentation und vertrauensgesteuertes semi‑überwachtes Lernen für die Klassifikation hyperspektraler Bilder

Scharfere Augen für die verborgenen Farben der Erde

Von der Überwachung der Pflanzengesundheit bis zur Beobachtung von Feuchtgebieten stützen sich Forschende zunehmend auf hyperspektrale Bilder — detailreiche Aufnahmen, die Dutzende bis Hunderte von Farben erfassen, die unser Auge nicht wahrnimmt. Diese reichen Daten versprechen genauere Karten zur Landnutzung und Vegetation, sind aber notorisch schwer zu analysieren. Diese Studie stellt eine neue Methode vor, genannt GCN‑ARE, die diese komplexen Bilder zuverlässiger und effizienter auswertet und damit die Grundlage für bessere Umweltbeobachtung, intelligentere Landwirtschaft und vorausschauendere Stadtplanung legt.

Warum hyperspektrale Bilder so kompliziert sind

Im Gegensatz zu einem normalen Foto erfasst ein hyperspektrales Bild für jeden Pixel ein vollständiges Farbspektrum. Das ermöglicht es Forschenden, etwa gesunden von gestresstem Gras zu unterscheiden oder verschiedene Kulturpflanzen zu erkennen, die in gewöhnlichen Aufnahmen fast identisch wirken. Diese Informationsdichte bringt jedoch Herausforderungen mit sich. Nachbarregionen können viele Landnutzungen mischen, Klassen sind oft unausgewogen (einige Landbedeckungen sind selten), und das Gelände kann unregelmäßig sein — man denke an zerklüftete Feldgrenzen oder verwobene Stadtstrukturen. Traditionelle Maschinenlernverfahren beruhen auf handgefertigten Merkmalen und übersehen häufig subtile Muster, während moderne tiefe Netze wie Faltungsnetze und Transformer mit unregelmäßigen Formen kämpfen und hohen Rechenaufwand erfordern. Deshalb funktionieren Modelle, die in einer Szene gut sind, in einer anderen oft nicht.

Pixel als intelligentes Netzwerk denken

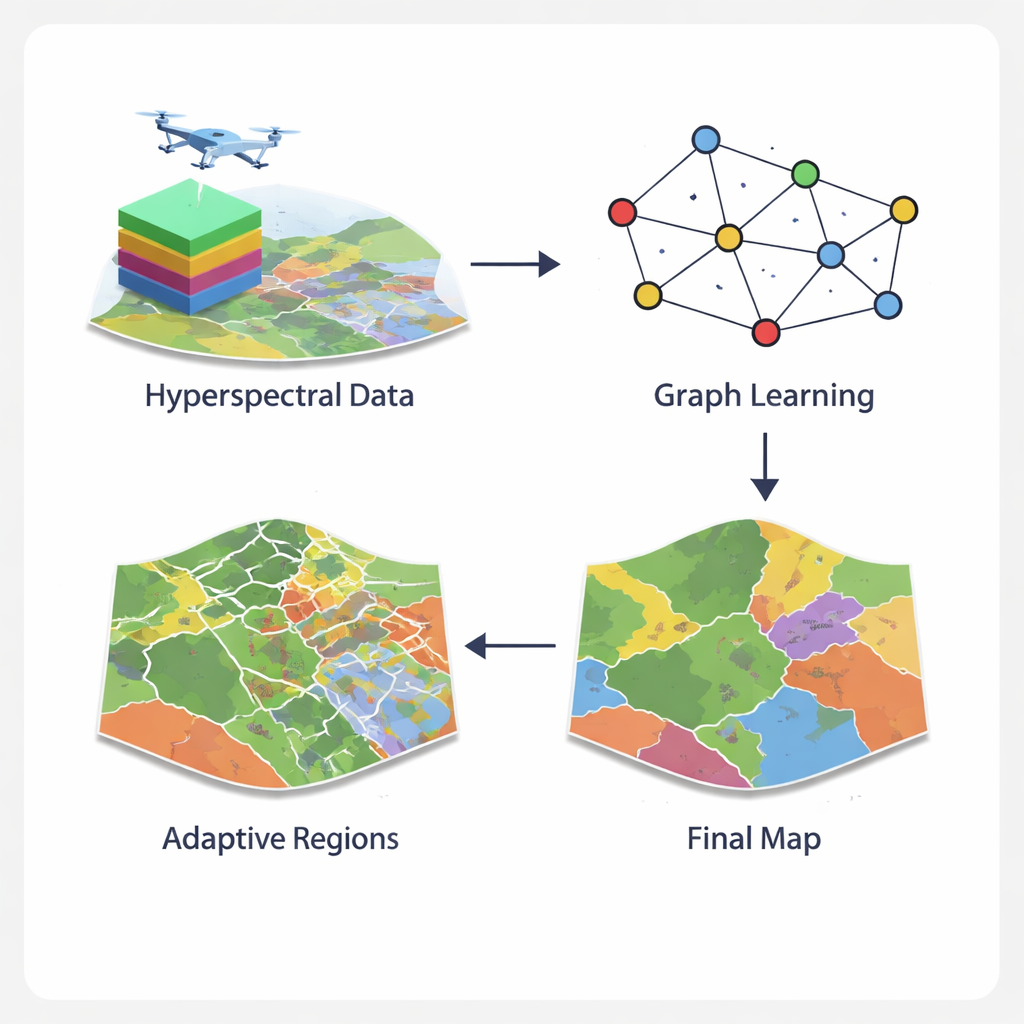

Das GCN‑ARE‑Framework begegnet diesen Problemen, indem es die Repräsentation hyperspektraler Bilder neu denkt. Anstatt jeden Pixel isoliert zu behandeln oder ihn starren quadratischen Nachbarschaften zuzuordnen, baut die Methode einen Graphen — ein Netzwerk, in dem Pixel Knoten sind und benachbarte Pixel verbunden werden. Ein spezialisierter Graphoperator hält den Informationsfluss stabil und verhindert numerische Probleme, die das Training entgleisen lassen können, wenn das Gelände uneinheitlich ist. Ein graphkonvolutionales Netz verbreitet und verfeinert dann Informationen entlang dieses Netzwerks und kombiniert, was jeder Pixel in seinem Spektrum „sieht“, mit dem, was die Nachbarn verraten. Diese Graphsicht erfasst komplexe räumliche Strukturen, etwa gezackte Feldgrenzen oder fragmentierte städtische Vegetation, natürlicher als Standardbildfilter.

Komplexe Regionen zurechtschneiden

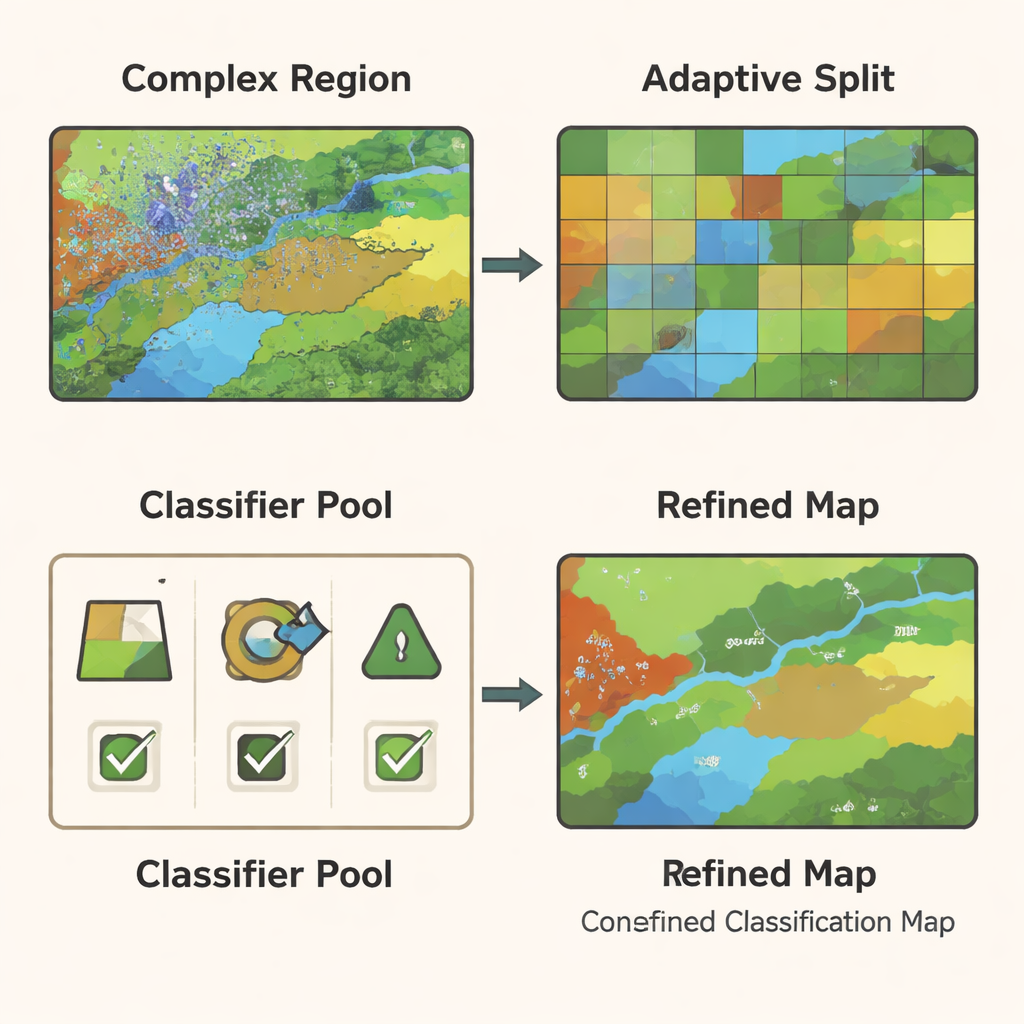

Selbst mit einem leistungsfähigen Graphmodell bleiben manche Teile eines Bildes schwer zu klassifizieren — etwa Übergangszonen, in denen Felder an Straßen grenzen oder Vegetation mit freiem Boden vermischt ist. GCN‑ARE löst das, indem es die Szene adaptiv in Regionen unterteilt, basierend darauf, wie gut sie klassifiziert werden. Leistet eine Region schlechte Ergebnisse, wird sie automatisch in kleinere, homogenerere Teile unterteilt, mithilfe eines Clusterings, das ähnliche Pixel gruppiert. Dieser Prozess folgt statistischen Regeln und ist nicht bloß visuell: Die Autoren zeigen, dass diese Teilungen theoretisch den erwarteten Fehler des Modells verringern, sodass es feine Unterschiede in der Landbedeckung zuverlässiger unterscheiden kann.

Mehrere Klassifikatoren abstimmen lassen — aber intelligent

Verschiedene Klassifikatoren — etwa Entscheidungsbäume, Support‑Vector‑Machines und Random Forests — sind in unterschiedlichen Situationen stark. Anstatt auf ein einzelnes Modell zu setzen, trainiert GCN‑ARE einen kleinen Pool dieser Klassifikatoren auf den graphbasierten Merkmalen und wählt dann regionsweise aus. Die Wahl beruht nicht auf Schätzung: Ein mathematisches Werkzeug, die Hoeffding‑Ungleichung, zeigt, dass mit wachsender Datenmenge in einer Region die Wahrscheinlichkeit steigt, den tatsächlich besten Klassifikator zu wählen. Im Einsatz vergleicht das System die Vorhersagen der Klassifikatoren: Stimmen sie überein, wird die Konsensentscheidung angenommen; widersprechen sie sich, wird der als „bester“ gewählte Klassifikator der Region aktiviert. Dieses adaptive Ensemble macht die finale Karte sowohl stabil in einfachen Bereichen als auch präziser in schwierigen.

Nachweis der Praxistauglichkeit

Die Autoren testeten GCN‑ARE auf vier bekannten Datensätzen: Feuchtgebiete in Botswana, ein urbanes Gebiet rund um Houston, Ackerland in Indiana (Indian Pines) und eine hochauflösende Anbaufläche in China (WHU‑Hi‑LongKou). In all diesen Fällen erreichte ihre Methode höhere Gesamterkennungsraten, bessere durchschnittliche Klassengenauigkeit und stärkere Übereinstimmungsmaße als führende Ansätze wie Graph Attention Networks und Vision Transformers — typischerweise eine Verbesserung der Gesamtgenauigkeit um etwa 1,5 bis 5,7 Prozentpunkte. Besonders gut war sie beim Erkennen seltener Klassen und komplexer Grenzen und das bei moderatem Zeit‑ und Speicherbedarf. Ablationsversuche zeigten, dass sowohl die adaptive Regionsteilung als auch das dynamische Ensemble wesentlich sind — das Entfernen einer Komponente reduzierte die Leistung merklich.

Was das für Anwendungen im Alltag bedeutet

Praktisch ist GCN‑ARE ein klügerer Weg, rohe hyperspektrale Daten in verlässliche Karten zu verwandeln. Durch die Kombination einer stabilen Graphrepräsentation, gezielter Regionsverfeinerung und statistisch begründeter Modellwahl liefert es klarere Landbedeckungskarten, selbst wenn gelabelte Trainingsdaten knapp sind und die Landschaft unübersichtlich. Für Landwirtinnen und Landwirte könnte das präzisere Feldüberwachung mit weniger Bodenerhebungen bedeuten; für Umweltbehörden zuverlässigere Nachverfolgung von Feuchtgebieten, Wäldern oder städtischer Ausdehnung. Zwar stehen Herausforderungen bei wirklich großen Skalen noch aus, doch die Autoren skizzieren Wege, die Methode schneller und ressourcenschonender zu machen, und deuten an, dass solche adaptiven, vertrauensbasierten Kartierungswerkzeuge mit der Ausbreitung hyperspektraler Sensoren auf Satelliten, Flugzeuge und Drohnen an Bedeutung gewinnen werden.

Zitation: Chen, Y., Lu, H. & Huang, X. Collaborative representation and confidence-driven semi-supervised learning for hyperspectral image classification. Sci Rep 16, 6180 (2026). https://doi.org/10.1038/s41598-026-36806-6

Schlüsselwörter: hyperspektrale Bildgebung, Landbedeckungskartierung, Graphneuronale Netze, Ensemble‑Lernen, Fernerkundung