Clear Sky Science · de

Untersuchung der Emotionserkennung von Studierenden und des Lehrfeedbacks von Lehrkräften im universitären Fremdsprachenunterricht basierend auf dem AFCNN‑Modell

Warum Ihre Lehrkraft bald mit KI die Stimmung im Raum lesen könnte

Wer schon einmal einem langweiligen Unterricht beigewohnt hat, weiß, dass Langeweile das Lernen still und heimlich untergräbt. Lehrkräfte müssen sich aber oft auf ihr Bauchgefühl verlassen, um einzuschätzen, wie Studierende sich gerade fühlen. Diese Studie untersucht einen neuen Weg, Hochschullehrenden für Fremdsprachen eine Art „emotionales Armaturenbrett“ bereitzustellen, das von künstlicher Intelligenz (KI) angetrieben wird. Indem es die Gesichtsausdrücke der Studierenden in Echtzeit liest, hilft das System Lehrenden, den Unterricht sofort anzupassen und langfristig ihre professionelle Entwicklung zu unterstützen.

Gefühle zählen genauso wie Grammatik

Fremdsprachenunterricht dreht sich nicht nur um Wortlisten und Grammatikregeln. Er ist ein sozialer Raum, in dem Selbstvertrauen, Angst, Neugier und Langeweile das Lernen beeinflussen. Frühere Untersuchungen zeigen, dass Lehrkräftefortbildungen meist Methoden und Fachwissen in den Mittelpunkt stellen und den Emotionen der Lernenden im Unterricht weniger Beachtung schenken. Traditionelle Werkzeuge wie Semesterend‑Umfragen oder Nachgespräche kommen zu spät, um eine schwächelnde Stunde noch zu retten. Die Autor:innen argumentieren, dass Lehrende, wenn sie sehen könnten, wie sich Emotionen minütlich verändern, schneller reagieren könnten – beschleunigen, abbremsen oder Aktivitäten wechseln, bevor die Studierenden innerlich abschalten.

Gesichter als nützliche Signale nutzen

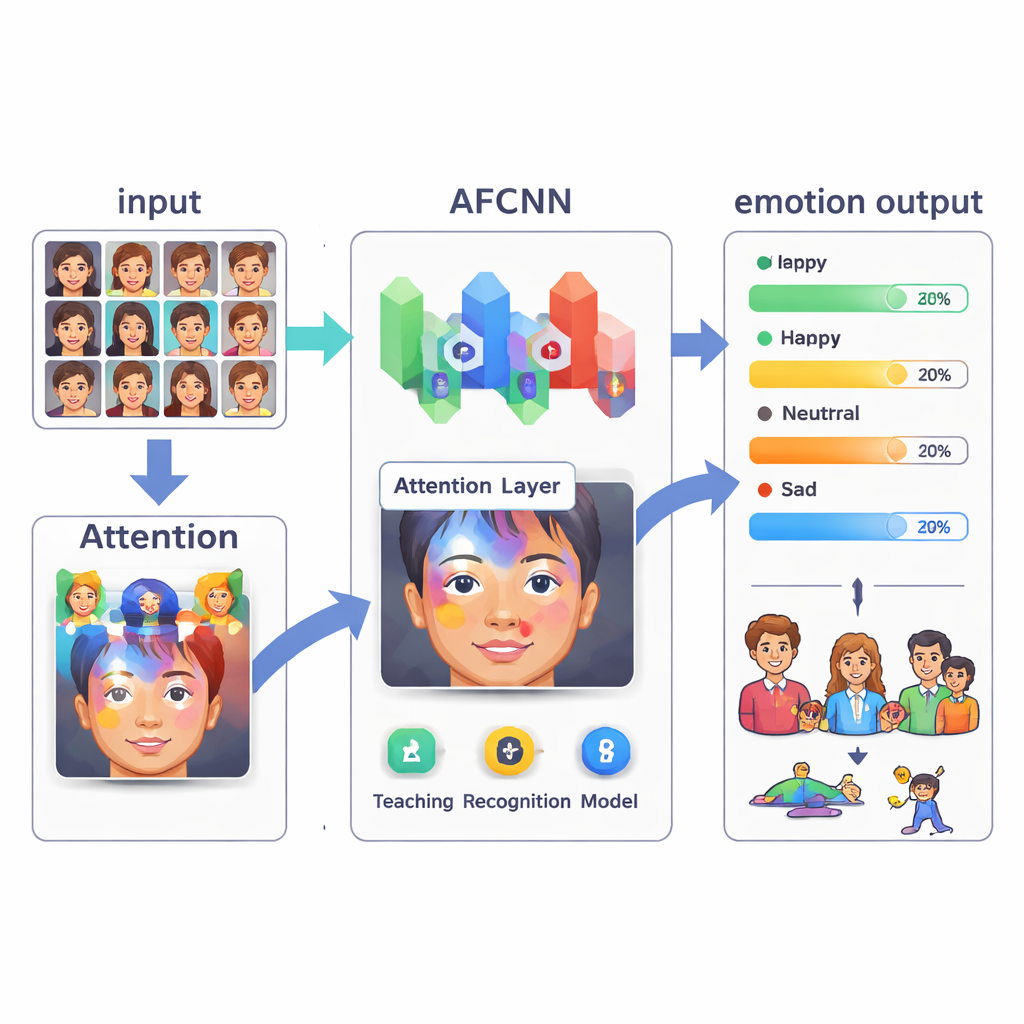

Im Zentrum der Studie steht ein Tiefenlernmodell, das Attention Feature Convolutional Neural Network (AFCNN) genannt wird. Vereinfacht gesagt erfasst eine Kamera im Klassenraum die Gesichter der Lernenden während des Unterrichts. Das Modell durchläuft dann drei Schritte: Es erkennt jedes Gesicht, extrahiert Merkmale, die mit Mimik zusammenhängen, und klassifiziert diese in eine von sieben Basisemotionen, etwa Freude, Traurigkeit, Angst oder einen neutralen Zustand. Ein spezieller „Attention“-Mechanismus hilft der KI, sich auf die informationsreichsten Gesichtsbereiche – etwa Augen oder Mund – zu konzentrieren und Ablenkungen zu ignorieren. Im Gegensatz zu älteren Ansätzen, die mit sauberen, frontalen Fotos am besten funktionieren, ist dieses System so konzipiert, dass es realistischer Bedingungen gewachsen ist, etwa teilweisen Blicken, Händen im Gesicht oder seitlich blickenden Studierenden.

Wie gut das System tatsächlich funktioniert

Um das AFCNN zu testen, trainierten die Forschenden es auf einer bekannten Sammlung von Gesichtsaufnahmen, die mit Emotionskategorien etikettiert sind, und erweiterten die Daten durch einfache Anpassungen wie Rotation und Helligkeitsänderungen. Anschließend verglichen sie die Leistung mit zwei etablierten Bilderkennungsmodellen, VGG16 und ResNet18. Unter klaren Bedingungen ohne Verdeckung erkannte das neue Modell Emotionen in etwa 81 % der Fälle korrekt und war besonders gut darin, glückliche und neutrale Ausdrücke zu identifizieren, mit Genauigkeiten im mittleren 80‑Prozent‑Bereich. Wenn Gesichter teilweise verdeckt waren – durch Haare, Hände oder Hüte – sank die Genauigkeit bei allen Systemen, doch das AFCNN übertraf die anderen und zeigte ausgewogenere Ergebnisse über die verschiedenen Emotionen hinweg, was darauf hindeutet, dass es für reale Klassenzimmer robuster ist.

Von emotionalen Anzeigen zu besseren Lektionen

Die Studie geht über reine Genauigkeitswerte hinaus und fragt, ob diese Technologie den Unterricht tatsächlich verbessert. In einem einmonatigen Versuch mit 200 Hochschullehrkräften im Fremdsprachenbereich nutzte die eine Hälfte das Emotionserkennungssystem, die andere Hälfte unterrichtete wie bisher. Lehrkräfte mit Zugriff auf Echtzeit‑Emotionen änderten ihre Unterrichtsplanung während einer Stunde mehr als doppelt so häufig, berichteten über höhere Zufriedenheit mit ihrem Unterricht und beobachteten größere Teilnahme und Interaktion der Studierenden. Die Forschenden entwarfen außerdem eine einfache Zuordnung von Emotionsmustern zu vorgeschlagenen Reaktionen – zum Beispiel der Wechsel zu Diskussion oder Wiederholung, wenn Anzeichen von Verwirrung oder Frustration auftreten – wodurch das System von der bloßen Beobachtung von Emotionen zu einer aktiven Anleitung des Verhaltens übergeht.

Was das für künftige Klassenzimmer bedeutet

Alltagsnah formuliert deutet diese Forschung darauf hin, dass künftige Klassenzimmer einen stillen Assistenten haben könnten, der die Gesichter der Studierenden beobachtet und der Lehrkraft zuflüstert, wenn der Raum Energie verliert oder viele Studierende ratlos wirken. Das AFCNN‑System ist nicht perfekt – es hat weiterhin Schwierigkeiten mit subtilen Emotionen wie Ekel oder Angst und ist auf hochwertig gelabelte Bilder angewiesen – doch es zeigt, dass KI emotionale Trends verlässlich erfassen kann und Lehrkräfte diese Informationen nutzen können, um reaktiver zu unterrichten. Für Studierende könnten das engagiertere und unterstützendere Stunden bedeuten; für Lehrkräfte bietet es ein neues Werkzeug zur Professionalisierung, das Psychologie, Pädagogik und KI zu einer intelligenteren, menschorientierteren Lernumgebung verbindet.

Zitation: Shi, L. Exploring students’ emotion recognition and teachers’ teaching feedback in college foreign language classroom based on AFCNN model. Sci Rep 16, 5657 (2026). https://doi.org/10.1038/s41598-026-36747-0

Schlüsselwörter: Emotionserkennung im Klassenraum, KI in der Bildung, Fremdsprachenunterricht, Professionalisierung von Lehrkräften, Tiefenlernmodelle