Clear Sky Science · de

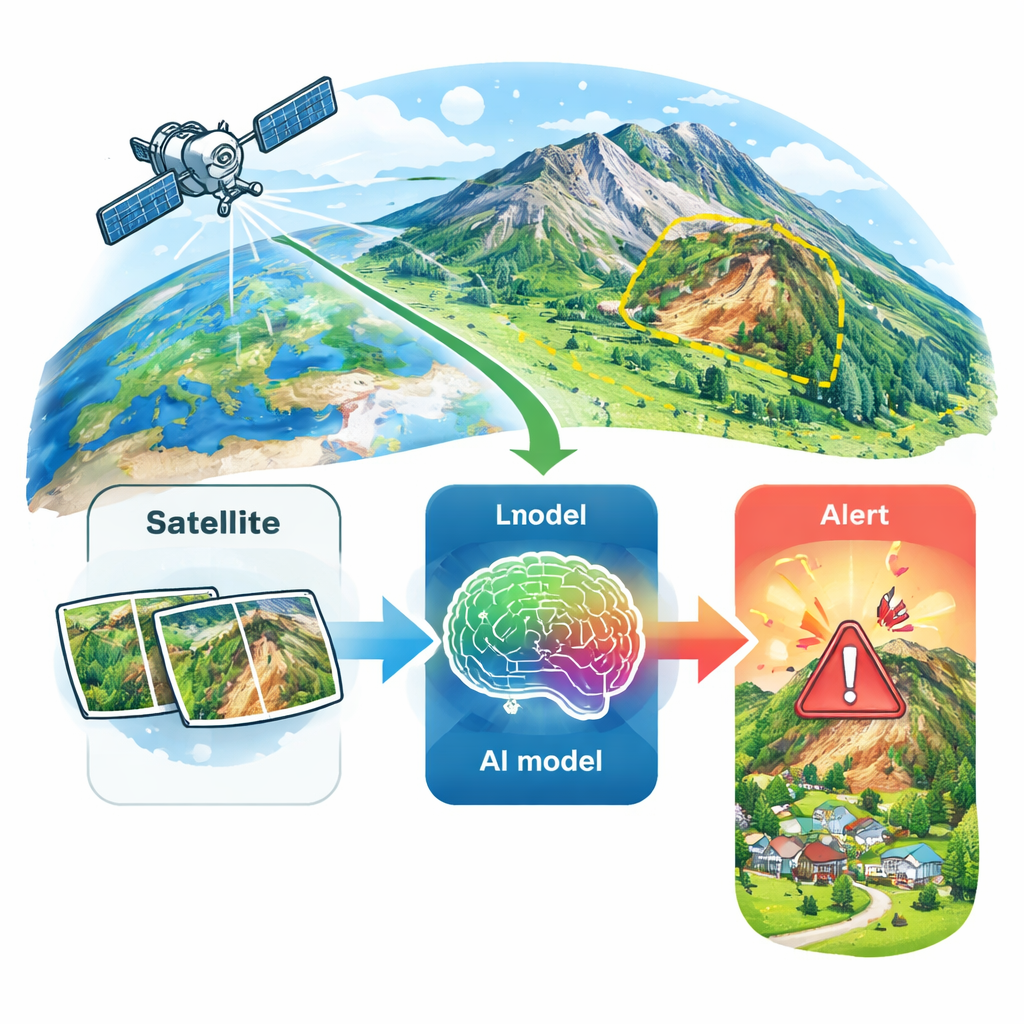

Auf Aufmerksamkeit ausgerichtetes tiefes Faltungsnetz mit optimiertem Lernen für präzise Erdrutsch-Erkennung und -Überwachung

Warum das Beobachten von Hängen aus dem All Leben retten kann

Erdrutsche können Straßen, Dörfer und wichtige Infrastruktur innerhalb von Sekunden auslöschen – oft mit wenig Vorwarnung. Viele Berggemeinden sind weiterhin auf Menschen vor Ort angewiesen, um frühe Anzeichen von Hangrutschungen zu erkennen, eine Aufgabe, die langsam, gefährlich und fehleranfällig ist. Diese Studie zeigt, wie eine moderne Form künstlicher Intelligenz, trainiert an Satellitenaufnahmen aus aller Welt, großflächig automatisch instabile Hänge identifizieren kann und dabei eine Genauigkeit erreicht, die traditionelle Methoden erreicht – und oft übertrifft.

Von Feldbüchern zu kreisenden Kameras

Konventionelle Erdrutschüberwachung stützt sich auf Bodenerhebungen, Sichtprüfungen und seismische Instrumente. Diese Werkzeuge sind leistungsfähig, aber begrenzt: Sie decken nur kleine Gebiete ab, übersehen frühe, subtile Veränderungen und sind in entlegenen, rauen Regionen teuer zu warten. In den letzten Jahren haben Satellitenmissionen eine andere Perspektive eröffnet. Umlaufende Sensoren fotografieren wiederholt dieselben Hänge in hoher Auflösung und erfassen winzige Veränderungen in Textur, Helligkeit und Vegetation, die lange vor einem Zusammenbruch auf Instabilität hinweisen können. Die Herausforderung ist das Volumen: Es gibt schlicht zu viele Bilder, als dass Menschen sie manuell durchsuchen könnten.

Die Maschine das Landschaftsbild lesen lehren

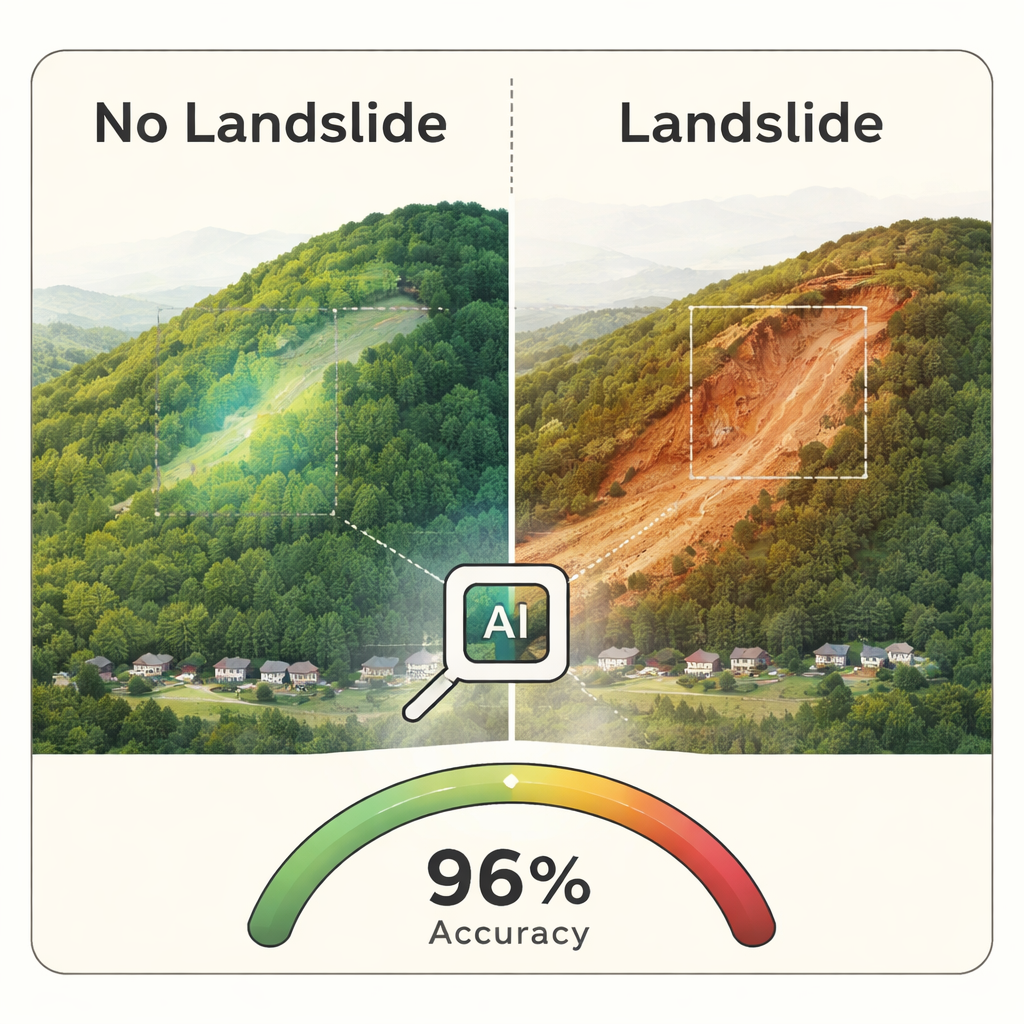

Die Autoren begegnen dieser Herausforderung mit einem Deep-Learning-System, das auf VGG16 basiert, einem bekannten Bilderkennungsmodell, das ursprünglich zum Erkennen alltäglicher Objekte trainiert wurde. Sie trainieren es mit Tausenden gelabelter Satellitenbilder aus zwei öffentlichen Quellen neu und passen es an: einer Kaggle-Erdrutschsammlung und dem globalen Erdrutschinventar der NASA. Jedes Bild ist als „Erdrutsch“ oder „kein Erdrutsch“ markiert, sodass das Modell klare Beispiele erhält, wonach es suchen soll. Das Netzwerk lernt Muster in Farbe, Schattierung und Form, die eine vernarbte, mit Schutt bedeckte Flanke von einem stabilen, bewachsenen Hang unterscheiden, und bleibt dabei schnell genug für eine praktisch einsetzbare, annähernd echtzeitfähige Überwachung.

Die KI auf Gefahrenzonen fokussieren lassen

Statt nur rohe Bilder zu verwenden, erstellt das Team eine reichere Beschreibung jeder Szene. Sie berechnen einfache Statistiken zur Pixelhelligkeit, die Gesamtveränderungen der Bodenoberfläche erfassen, sowie Texturmaße, die raues, gestörtes Gelände betonen – typisch für Rutschflächen. Zudem fügen sie einen Index zur Vegetationsgesundheit hinzu, damit das System bemerkt, wenn üppige Hänge plötzlich nackten Boden zeigen. Ein „räumlicher Aufmerksamkeits“-Mechanismus bringt dem Netzwerk bei, sich auf die informationsreichsten Bildbereiche zu konzentrieren – etwa eine schmale Narbe an einem steilen Hang – statt jeden Pixel gleich zu behandeln. Diese Aufmerksamkeitskarte macht das Modell sowohl genauer als auch besser interpretierbar, weil klar wird, welche Regionen seine Entscheidung beeinflusst haben.

Genauigkeit, Geschwindigkeit und Zuverlässigkeit ausbalancieren

Um das System in vielen Einsatzszenarien verlässlich zu halten, stimmen die Forscher sorgfältig ab, wie das Modell lernt. Sie experimentieren mit unterschiedlichen Lernraten, Batchgrößen und Schichten und verwenden einen Optimierer, der das Training stabilisiert und zugleich bessere Lösungen erkundet. Sie testen außerdem alternative Deep-Netzwerke wie ResNet und DenseNet und vergleichen, wie oft jedes System Erdrutschbilder korrekt erkennt gegenüber den Fehlalarmen. Über beide Datensätze von Kaggle und der NASA hinweg schneidet das erweiterte VGG16-Modell konsistent am besten ab, erreicht etwa 95–96 % Genauigkeit und vermeidet das Überanpassen, das komplexe neuronale Netze oft plagt. Es läuft sogar auf einem kleinen Einplatinencomputer, was auf künftige Feldanwendungen in ressourcenarmen Regionen hinweist.

Was die Ergebnisse für Menschen vor Ort bedeuten

Einfach gesagt zeigt diese Arbeit, dass eine sorgfältig entwickelte KI in der Lage ist, riskante von sicheren Hängen in Satellitenbildern zuverlässig zu unterscheiden, die über verschiedene Kontinente und Klimazonen gesammelt wurden. Durch die Kombination mehrerer Hinweise – Helligkeit, Textur, Vegetation und die Orte im Bild, auf die zu achten ist – erkennt das System Erdrutsche und erdrutschgefährdete Bereiche deutlich effektiver als manuelle Inspektionen allein. Zwar bleibt es auf qualitativ gute Bilder und ausreichende Rechenleistung angewiesen, doch deutet der Ansatz in Richtung automatisierter Frühwarnsysteme für große Gebiete. Bei skalierter Bereitstellung könnten solche Werkzeuge Behörden wertvolle zusätzliche Zeit verschaffen, um Straßen zu sperren, Häuser zu evakuieren und sicherere Planungen in einigen der instabilsten Landschaften der Welt vorzunehmen.

Zitation: S.K.B, S., N, K., M R, P. et al. Attention driven deep convolutional network with optimized learning for accurate landslide detection and monitoring. Sci Rep 16, 6759 (2026). https://doi.org/10.1038/s41598-026-36737-2

Schlüsselwörter: Erdrutsche, Satellitenbilder, Deep Learning, Katastrophenüberwachung, Fernerkundung