Clear Sky Science · de

Latenz‑ und energiebewusste adaptive Service‑Migration im Mobile Edge Computing

Warum es wichtig ist, Apps näher an den Nutzer zu bringen

Jedes Mal, wenn Sie im Auto ein Online‑Spiel spielen, auf dem Smartphone AR‑Navigation streamen oder ein Sensor in einer Smart City Daten sendet, müssen diese digitalen Aufgaben irgendwo berechnet werden. Mobile Edge Computing (MEC) verlagert diese Arbeit von weit entfernten Rechenzentren zu kleinen Servern nahe Funkbasisstationen, reduziert Verzögerungen und lässt Anwendungen reaktiver wirken. Damit diese Dienste nahe bei mobilen Nutzern bleiben, müssen laufende Anwendungen häufig zwischen benachbarten Edge‑Servern „verschoben“ (migriert) werden. Zu häufiges Verschieben verschwendet Energie und Geld; zu seltenes führt zu Latenz und Frustration. Diese Studie untersucht, wie man mit fortgeschrittener maschineller Lerntechnik ein sinnvolles Gleichgewicht findet.

Ausbalancieren von Geschwindigkeit und Stromverbrauch

Die meisten früheren Arbeiten zur MEC‑Service‑Migration konzentrierten sich vorwiegend auf ein Ziel: die vom Nutzer wahrgenommene Verzögerung so gering wie möglich zu halten. Das bedeutet typischerweise, einem Nutzer beim Bewegen hinterherzujagen und seine Anwendung wiederholt auf den jeweils nächsten Server zu verschieben. Jede Migration verbraucht jedoch zusätzliche Kommunikationsenergie und verursacht eigene Verzögerungen. Viele frühere Ansätze gingen außerdem von reichlich Serverkapazität und stabilen Bedingungen aus und übersahen die Realität, dass Edge‑Server ressourcenbeschränkt sind, mit vielen Nutzern konkurrieren und stark schwankende Lasten sowie Funkqualität erleben. Die Autoren argumentieren, dass Migrationsenergie als gleichwertiges Ziel neben Latenz behandelt werden sollte und Migrationspolitiken online an Nutzerbewegung, Serverauslastung und Netzschwankungen angepasst werden müssen.

Vom mathematischen Problem zum lernenden Agenten

Die Forschenden bauen zunächst ein detailliertes mathematisches Modell eines MEC‑Systems mit mehreren Basisstationen, co‑lokierten Edge‑Servern und mobilen Nutzern auf. Jeder Nutzer off‑loadet Rechenaufgaben an benachbarte Server über drahtlose Verbindungen. Die gesamte Servicelatenz wird in drei Teile zerlegt: Zeit zum Senden der Aufgabe zur Basisstation, Zeit zur Berechnung auf dem Server und Zeit, die anfällt, wenn der Dienst über das kabelgebundene Backhaul zwischen Servern verschoben wird. Die Migrationsenergie wird hauptsächlich anhand der Datenmenge modelliert, die beim Verschieben eines Dienstes übertragen werden muss. Das Gesamtziel ist, sowohl Latenz als auch Migrationsenergie zu minimieren und dabei die Beschränkungen der Rechenkapazität jedes Servers und die Fristen jedes Dienstes einzuhalten. Dieses gemischt‑ganzzahlige, nichtlineare Problem exakt in Echtzeit zu lösen, ist rechnerisch unpraktikabel, daher setzt das Team auf Deep Reinforcement Learning, bei dem ein Agent gute Entscheidungen durch Interaktion mit einer simulierten Umgebung erlernt.

Wie das adaptive Migrations‑Gehirn funktioniert

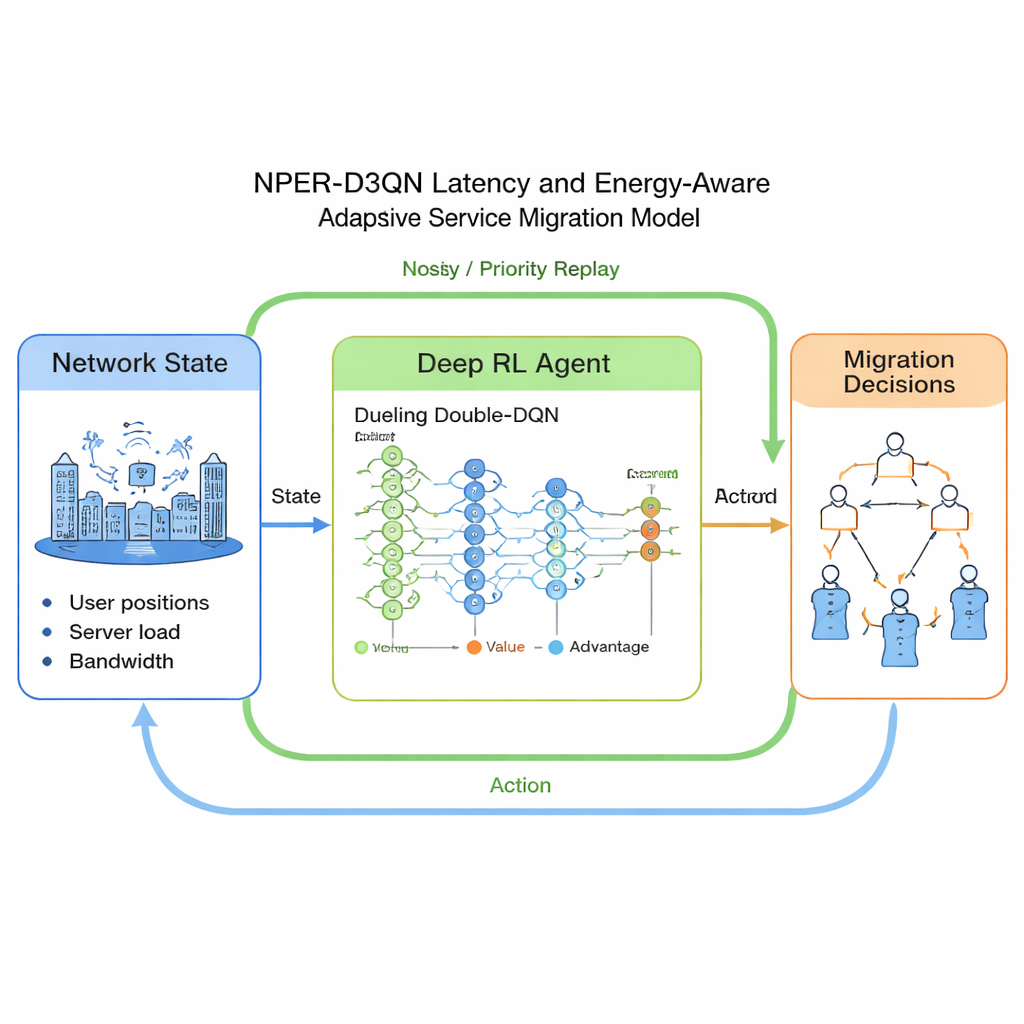

Die vorgeschlagene Methode mit der Bezeichnung NPER‑D3QN ist eine ausgefeilte Variante von Deep Q‑Networks (DQN). Der Eingabe‑„Zustand“ des Agenten fasst zusammen, wo sich Nutzer befinden, wie weit sie von ihrer aktuell dienenden Basisstation entfernt sind, wie ausgelastet die einzelnen Edge‑Server sind, verfügbare Rechenkapazität, drahtlose Datenraten sowie die Größe und Rechenintensität jedes Dienstes. Die „Aktionen“ bestehen darin, für jeden Nutzer zu wählen, welcher Edge‑Server den Dienst im nächsten Zeitschritt hosten soll. Die Belohnungsfunktion fördert geringe Verzögerung relativ zur Frist jedes Dienstes und bestraft gleichzeitig Migrationsenergie, wodurch der Agent lernt, Geschwindigkeit gegen Stromverbrauch abzuwägen. Technisch kombiniert das Modell drei Ideen: ein duellierendes Netzwerk, das getrennt den Wert eines Zustands und den Vorteil jeder Aktion schätzt, eine „double“ Q‑Learning‑Struktur zur Reduktion überoptimistischer Schätzungen, und zwei Exploration‑Hilfen — noisy networks und priorisierte Erfahrungsspeicherung — die schnelleres und verlässlicheres Lernen in komplexen, sich ändernden Bedingungen ermöglichen.

Die Methode im Test

Um die Leistungsfähigkeit von NPER‑D3QN zu prüfen, simulieren die Autoren ein stadtähnliches Raster mit Dutzenden Basisstationen und bis zu Hunderten zufällig bewegter mobiler Nutzer, die Aufgaben unterschiedlicher Größe senden. Edge‑Server haben begrenzte Rechenleistung und können nur eine feste Anzahl virtueller Maschinen hosten, wodurch realistische Warteschlangen und Konkurrenz entstehen. Sie vergleichen ihre Methode mit sechs State‑of‑the‑Art‑Baselines, darunter klassisches DQN, verbesserte double‑dueling‑Varianten und Strategien, die entweder stets dem nächsten Server folgen oder ausschließlich Latenz minimieren. In verschiedenen Szenarien konvergiert NPER‑D3QN schneller zu guten Strategien und erzielt durchgehend niedrigere mittlere Servicelatenzen, geringeren migrationsbezogenen Energieverbrauch und weniger abgewiesene Migrationen, wenn Server ausgelastet sind. In einem großen Test mit 720 Nutzern und 96 Servern reduziert es die Latenz um bis zu etwa zwei Drittel und die Migrationsenergie um über 90 % gegenüber einigen Alternativen, während die Rechenzeit pro Entscheidung in praktischen Grenzen bleibt.

Was das für zukünftige vernetzte Dienste bedeutet

Für Nicht‑Spezialisten ist die wichtigste Erkenntnis: Es reicht nicht, Apps einfach näher an die Nutzer zu bringen — wir brauchen auch intelligente Steuerung dafür, wann und wohin laufende Dienste verschoben werden. Diese Arbeit zeigt, dass ein lernbasierter Controller die konkurrierenden Ziele von Reaktionsfähigkeit, Energieeinsparung und begrenzter Edge‑Kapazität ohne handgefertigte Regeln „jonglieren“ kann. Wenn ähnliche Systeme in realen Netzen eingesetzt werden, könnten sie Betreibern helfen, flüssigere Erlebnisse für Anwendungen wie autonomes Fahren, immersive AR und industrielle IoT‑Anwendungen zu bieten und gleichzeitig Stromkosten und Infrastrukturbelastung zu senken. Die Autoren weisen darauf hin, dass ihre Studie simulationsbasiert ist und einige reale Details wie voller Serverstromverbrauch und unvollständige Überwachung auslässt, doch sie stellt einen vielversprechenden Schritt hin zu umweltfreundlicherem, anpassungsfähigerem Edge Computing dar.

Zitation: Li, L., Lv, J., Wang, S. et al. Latency and energy-aware adaptive service migration in mobile edge computing. Sci Rep 16, 6178 (2026). https://doi.org/10.1038/s41598-026-36711-y

Schlüsselwörter: mobile edge computing, service migration, deep reinforcement learning, latenzoptimierung, energieeffizienz