Clear Sky Science · de

Sekanten-Optimierungsalgorithmus für effiziente globale Optimierung

Intelligenteres Suchen bei schweren Problemen

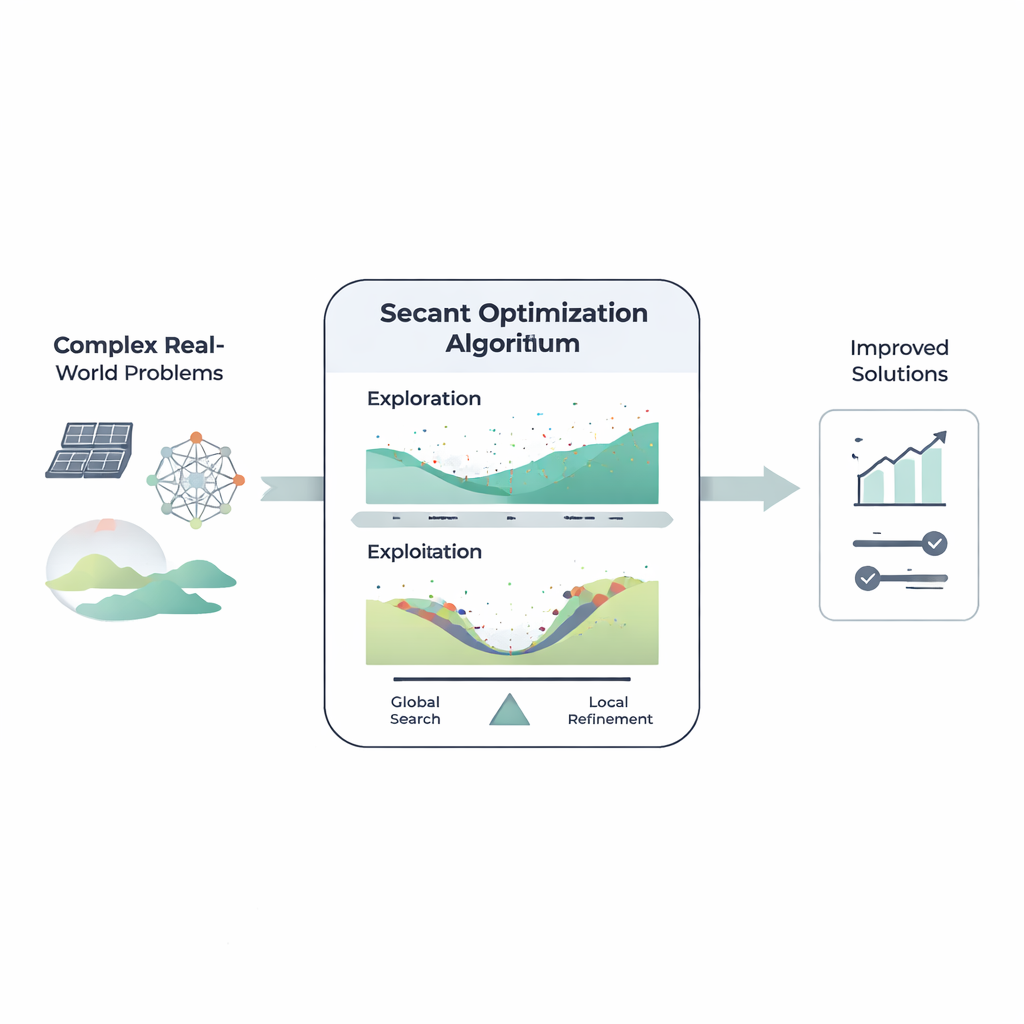

Ob es darum geht, sauberere Solarmodule zu entwerfen oder genaue Bilderkennungssysteme zu trainieren: Viele der heutigen Herausforderungen lassen sich auf dieselbe Aufgabe zurückführen – das Durchsuchen eines enormen Möglichkeitsraums, um eine gute Lösung zu finden. Dieses Paper stellt den Sekanten-Optimierungsalgorithmus (SOA) vor, eine neue Herangehensweise, um diese Suche effizienter durchzuführen. Inspiriert von einer klassischen Idee der Analysis, aber für unordentliche, reale Daten ausgelegt, zielt SOA darauf ab, sowohl schnell als auch verlässlich zu sein, wenn traditionelle Methoden an ihre Grenzen stoßen.

Warum die Optimierung neue Ideen braucht

Moderne Ingenieur- und Data-Science-Probleme beinhalten oft Dutzende bis Hunderte einstellbarer Parameter, mehrere Zielgrößen und verzahnte Zusammenhänge, die sich nur schwer in einfachen Formeln ausdrücken lassen. Klassische Verfahren, die exakten Gradienten folgen, wie der steilste Abstieg, können versagen, wenn die Landschaft rau ist, viele lokale Fallen enthält oder Ableitungen schwer bis gar nicht zu berechnen sind. Als Reaktion darauf haben Forschende metaheuristische Algorithmen entwickelt, die Natur, Physik oder Mathematik nachahmen, um diese schwierigen Landschaften zu erkunden. Solche Methoden, etwa genetische Algorithmen oder Schwarmoptimierer, haben sich als bemerkenswert vielseitig erwiesen, müssen jedoch weiterhin Kompromisse zwischen weiträumiger Erkundung und präzisem Hineinzoomen eingehen.

Ein Lehrbuchtrick wird zur Suchmaschine

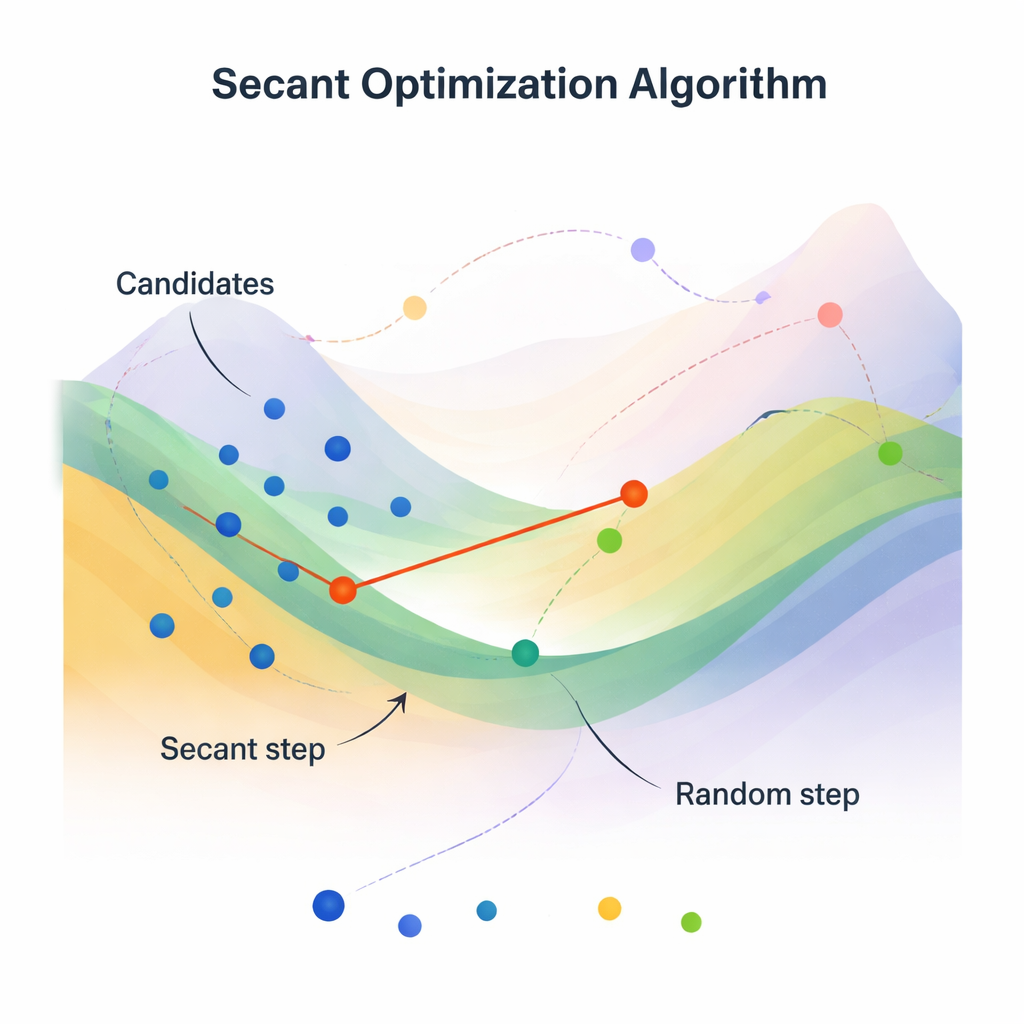

Der Kern von SOA ist die Sekantenmethode, ein altes numerisches Verfahren, um die Nullstelle einer Kurve zu finden, ohne exakte Ableitungen zu benötigen. Anstatt eine aus der Analysis berechnete Steigung zu verwenden, zieht die Sekantenmethode eine Gerade zwischen zwei benachbarten Punkten der Kurve und nutzt diese als Näherung der Steigung. SOA verallgemeinert diese Idee auf viele Dimensionen und viele Kandidatenlösungen gleichzeitig. Es hält eine Population von Vektoren (mögliche Antworten) und aktualisiert diese wiederholt mit sekantenähnlichen Schritten, die approximieren, wie sich die Zielfunktion entwickelt — und das nur anhand von Funktionswerten. Dadurch eignet sich die Methode besonders dort, wo Gradienten verrauscht, teuer oder nicht definiert sind, etwa beim Abstimmen von Hyperparametern neuronaler Netze anhand der Validierungsfehler.

Ausgewogene Mischung aus breiter Erkundung und scharfem Fokus

Das Design von SOA trennt explizit, wie es erkundet und wie es verfeinert. In der Erkundungsphase wird jeder Kandidat mit einer sekantenbasierten Regel angepasst, die Informationen vom aktuell besten Lösungsvorschlag, dem aktuellen Vektor und einem zufällig gewählten Peer kombiniert. Das hilft, die Suche in vielversprechende Richtungen zu lenken, ohne rein zufällig zu agieren. In der Exploitationsphase führt SOA einen „Expansionsfaktor“ und kontrollierte Zufälligkeit ein. Es schiebt Lösungen in Richtung der besten, der durchschnittlichen, der nächsten und sogar der entferntesten Punkte in der Population und mischt zufällige Schritte bei. Eine einfache Mutationsregel behält gelegentlich eine alte Position bei statt der neuen, was die Diversität erhält. Zusammengenommen helfen diese Mechaniken SOA, lokalen Fallen zu entkommen und gleichzeitig auf hochwertige Lösungen zuzusteuern.

Tests an Benchmarks und realen Geräten

Um zu prüfen, ob SOA mehr als eine schlaue Idee auf dem Papier ist, testen die Autorinnen und Autoren den Algorithmus an den weit verbreiteten Benchmark-Familien CEC2021 und CEC2020. Diese Funktionen sind bewusst anspruchsvoll: Manche sind niedrigdimensional, aber voller falscher Minima; andere reichen bis zu 50 oder 100 Dimensionen. In diesen Tests wird SOA mit zwei Gruppen konkurrierender Algorithmen verglichen, darunter 11 mathematisch inspirierte Verfahren und 9 aktuelle oder variante Optimierer. Anhand von Statistiken wie mittlerem Fehler, Variabilität, Konvergenzkurven und rangbasierten Tests erreicht SOA durchweg ähnliche oder bessere Ergebnisse als die meisten Konkurrenten, insbesondere beim schnellen und verlässlichen Finden guter Lösungen. Anschließend gehen die Autorinnen und Autoren über synthetische Tests hinaus zu zwei anspruchsvollen realen Aufgaben: der Schätzung wichtiger Parameter in Photovoltaik(PV)-Modellen und der automatischen Abstimmung der Hyperparameter von Faltungsnetzwerken für mehrere Bilddatensätze.

Von Solarmodulen zu neuronalen Netzen

In der Solarenergie sind genaue Modelle von PV-Zellen und -Modulen entscheidend, um die Leistung vorherzusagen und den Betrieb zu optimieren. Das Team wendet SOA auf mehrere Standard-PV-Modelle an, darunter Ein- und Zwei-Dioden-Modelle sowie vollständige Modulbeschreibungen. Mit gemessenen Strom-Spannungs-Daten passt SOA Modellparameter an, um den Fehler zu minimieren, und erzielt geringere oder vergleichbare Root-Mean-Square-Fehler im Vergleich zu einer Reihe etablierter Optimierer. In den Machine-Learning-Experimenten wird SOA eingesetzt, um Architektur- und Trainingsparameter eines Faltungsnetzwerks auf MNIST und verwandten Bilddatensätzen abzustimmen. Auch hier findet der Algorithmus Hyperparameter-Kombinationen, die konkurrenzfähige oder bessere Klassifikationsgenauigkeiten liefern als andere automatisierte Suchstrategien.

Was das in der Praxis bedeutet

Für Nicht-Spezialisten lautet die Kernbotschaft: SOA bietet eine praktische neue „Suchmaschine“ für harte Optimierungsprobleme, bei denen die Landschaft rau ist und keine Gradienten vorliegen. Indem es die Geometrie der Sekantenmethode aufgreift und in eine populationsbasierte Suche mit ausgewogener Zufälligkeit einbettet, konvergiert der Algorithmus oft schneller und genauer als viele aktuelle Alternativen. Da er relativ einfach, ableitungsfrei und wenig anfällig für Parameterabstimmung ist, lässt sich SOA in eine Vielzahl von Anwendungen integrieren — vom Entwurf effizienterer Solarenergiesysteme bis zur Konfiguration tiefer Lernmodelle — und stellt damit eine vielversprechende Ergänzung des Werkzeugkastens für Ingenieurinnen, Ingenieure und Data Scientists dar.

Zitation: Ibrahim, M.Q., Qaraad, M., Hussein, N.K. et al. Secant Optimization Algorithm for efficient global optimization. Sci Rep 16, 6659 (2026). https://doi.org/10.1038/s41598-026-36691-z

Schlüsselwörter: globale Optimierung, metaheuristische Algorithmen, Sekanten-Optimierungsalgorithmus, Photovoltaik-Modellierung, Hyperparameter-Abstimmung