Clear Sky Science · de

Ein selbstaufmerksamkeitsbasiertes Deep‑Learning‑Framework zur genauen und effizienten Erkennung dentaler Erkrankungen in OPG‑Röntgenaufnahmen

Warum bessere Zahnaufnahmen wichtig sind

Die meisten von uns denken an Zahn‑Röntgenbilder nur, wenn sie auf dem Stuhl beim Zahnarzt sitzen, doch diese Aufnahmen enthalten oft lebensverändernde Informationen. Karies, Zahnfleischerkrankungen und fehlende Zähne betreffen Milliarden von Menschen, und frühe Warnzeichen sind selbst für geschulte Fachleute, die über volle Panoramaschichtaufnahmen schauen, leicht zu übersehen. Diese Studie untersucht, wie eine neue Generation künstlicher Intelligenz diese weiten „Lächel‑förmigen“ Bilder schnell und präzise auswerten kann, sodass Zahnärzte Probleme früher erkennen und die Wahrscheinlichkeit schmerzhafter und kostspieliger Behandlungen später reduzieren können.

Die wachsende Belastung in unserem Mund

Oral- und Zahnkrankheiten zählen heute zu den häufigsten Gesundheitsproblemen weltweit und betreffen schätzungsweise 3,5 Milliarden Menschen. Karies, Zahnfleischentzündungen, verhärtete Plaque (sogenannter Zahnstein) und fehlende Zähne sind nicht nur kosmetische Probleme; sie können chronische Schmerzen, Infektionen und Schwierigkeiten beim Essen verursachen und stehen in Verbindung mit weiterreichenden Gesundheitsrisiken. Jüngere Menschen sind zunehmend betroffen, und Zahnverlust bei älteren Erwachsenen kann die Lebensqualität deutlich mindern. Traditionelle Untersuchungen – inspizieren, tasten und Röntgenbilder visuell auswerten – bleiben die wichtigste Verteidigungslinie, hängen jedoch stark von der Erfahrung der Behandler ab und können kleine oder frühe Schäden übersehen, die in komplexen Bildern verborgen sind.

Panoramaröntgenbilder in Daten verwandeln

Die Forschenden konzentrieren sich auf einen verbreiteten Typ dentaler Aufnahme, das Orthopantomogramm (OPG) – ein einzelnes breites Röntgenbild, das alle Zähne und beide Kiefer zugleich zeigt. Da OPGs in vielen Praxen routinemäßig erstellt werden und nur eine geringe Strahlenbelastung erfordern, eignen sie sich ideal für Automatisierung. Das Team sammelte mehr als 5.000 Bilder, die vier häufige Befunde repräsentieren: Karies, Zahnstein, Gingivitis und Hypodontie (fehlende Zähne). Bevor sie einem Computer das Erkennen dieser Probleme beibrachten, bereiteten sie die Bilder sorgfältig vor – standardisierten Größe und Helligkeit, reduzierten Rauschen und nutzten ein separates Modell, um alles außer dem Zahnbogen auszuschneiden, damit die KI sich auf Zähne und Zahnfleisch statt auf ablenkende Hintergrundanatomie konzentriert.

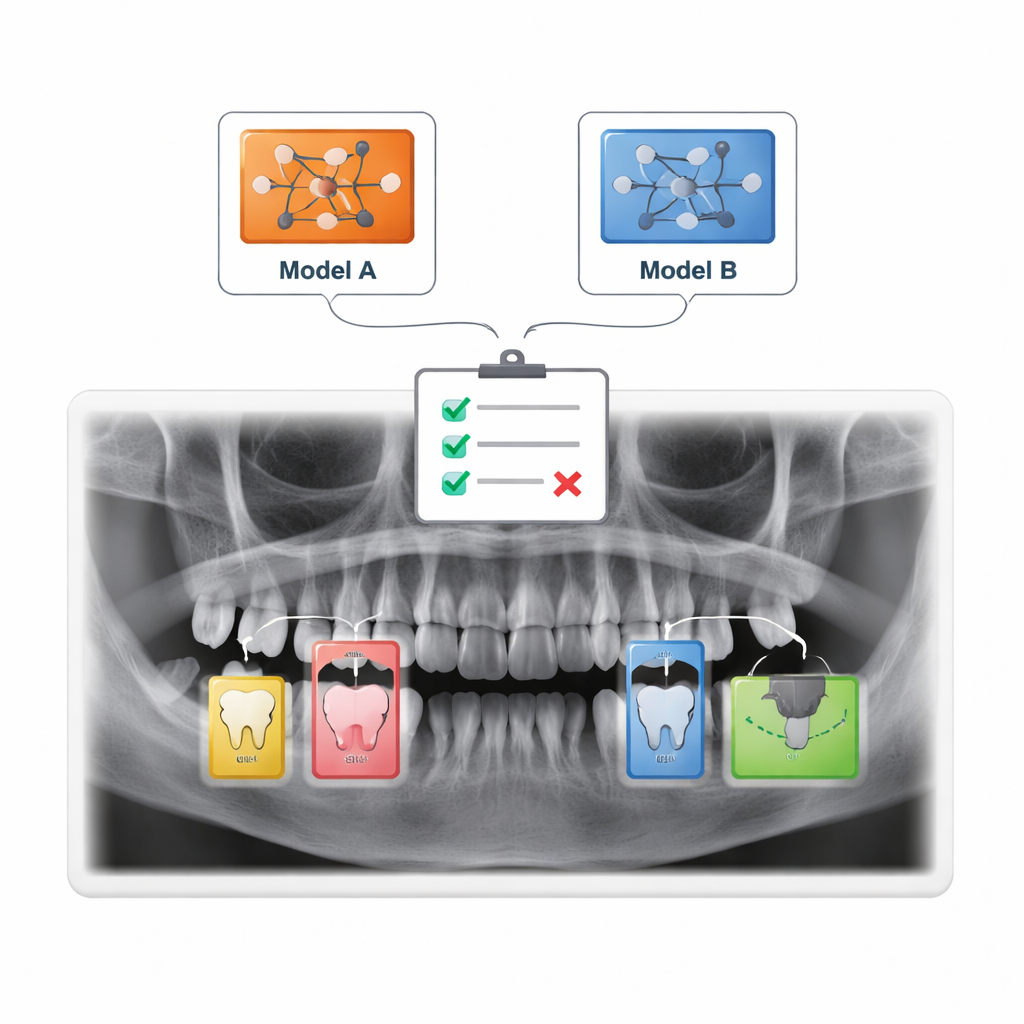

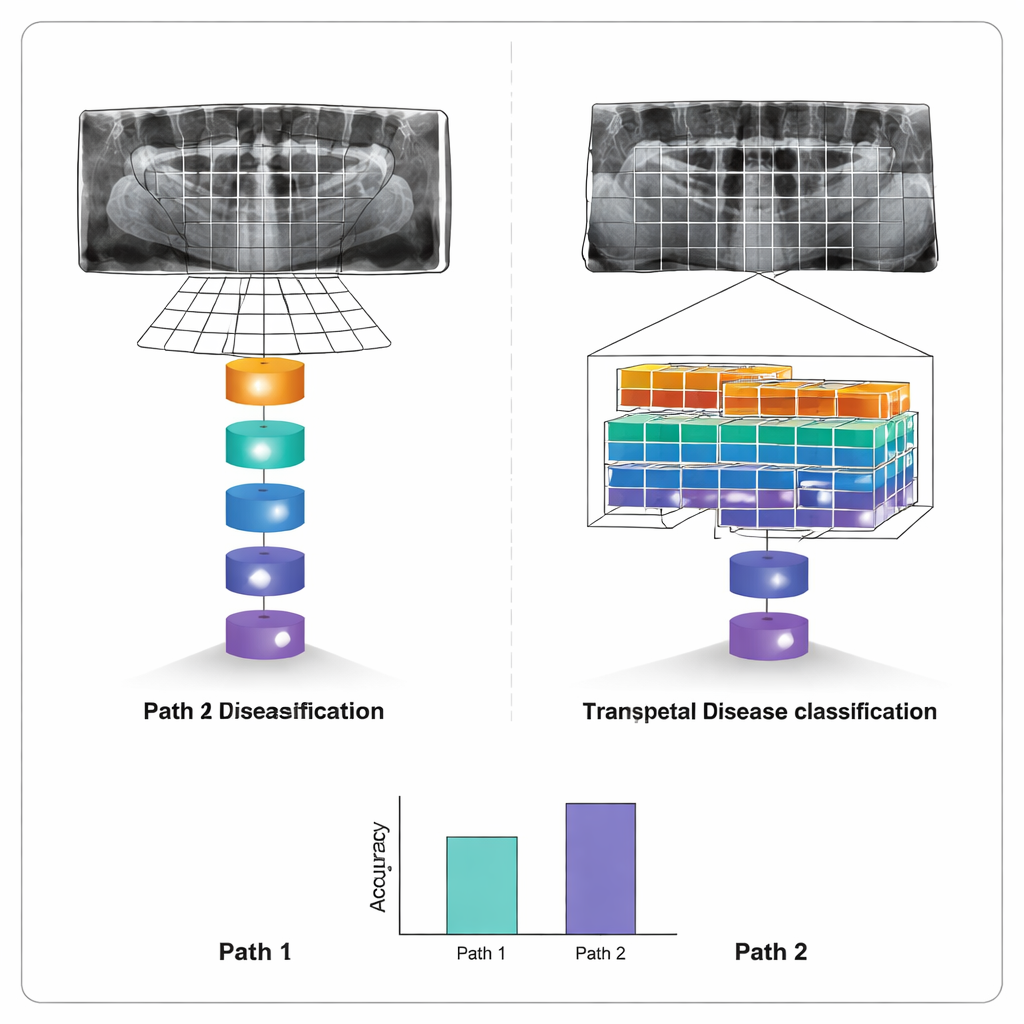

Zwei konkurrierende KIs: Globaler Blick vs. Fensteransatz

Zum Lesen der Röntgenbilder vergleicht die Studie zwei „Transformer“-Modelle, eine Klasse von KI, die kürzlich Sprach‑ und Bildanalysen revolutioniert hat. Das erste, Vision Transformer genannt, zerteilt jedes Röntgenbild in viele kleine Patches und analysiert dann alle gemeinsam, um zu lernen, wie weit auseinanderliegende Bereiche des Mundes miteinander in Beziehung stehen. Das zweite, als Swin Transformer bekannt, unterteilt das Bild ebenfalls, konzentriert sich aber auf lokale Fenster, die über das Bild gleiten, und baut so eine Hierarchie von feinen Details zu größeren Mustern auf. Beide Modelle wurden mit demselben Datensatz trainiert und anhand gängiger Maße der diagnostischen Leistung bewertet, einschließlich wie häufig sie erkrankte und gesunde Bilder korrekt kennzeichnen.

Wie gut die Maschinen Zähne diagnostizieren

Nach dem Training erwiesen sich beide Systeme als bemerkenswert leistungsfähig. Der Vision Transformer klassifizierte etwa 96 % der Testbilder korrekt, mit ähnlich hoher Präzision und Sensitivität – er löste also selten Fehlalarme aus und übersah kaum Erkrankungen. Der Swin Transformer erreichte nur leicht geringere Werte, etwa 95 % Genauigkeit, nutzte jedoch die Rechenressourcen dank seines Fensteransatzes effizienter. Den größten Vorteil des Vision Transformers zeigte sich bei der Erkennung kleiner Kariesläsionen, wo seine Fähigkeit, den gesamten Mund gleichzeitig zu betrachten, half, winzige, gering kontrastierende Defekte zu erfassen. Das Zuschneiden der Bilder auf den Zahnbogen verbesserte die Ergebnisse zusätzlich und bestätigte, dass das Entfernen irrelevanter Bereiche die Modelle zuverlässiger macht.

Was das für künftige Zahnarztbesuche bedeutet

Für Patientinnen und Patienten ist die Botschaft nicht, dass Computer Zahnärzte ersetzen werden, sondern dass sie als zusätzliche scharfe Augen fungieren können. Diese Arbeit zeigt, dass moderne KI ein panoramisches Zahn‑Röntgen in Sekunden scannen und zuverlässig in gängige Krankheitskategorien einordnen kann, wobei sie Bereiche hervorhebt, die eine genauere Betrachtung verdienen. Obwohl die Studie auf einem einzigen kombinierten Datensatz basiert und noch größere, realweltliche Studien benötigt, legt sie nahe, dass transformerbasierte Systeme eines Tages dazu beitragen könnten, Diagnosen zu standardisieren, übersehene Probleme zu reduzieren und fortschrittliche Zahnversorgung zugänglicher zu machen – besonders in überlasteten oder ressourcenarmen Kliniken.

Zitation: Bhoopalan, R., Mirdula, S., Kannusamy, P. et al. A self attention based deep learning framework for accurate and efficient dental disease detection in OPG radiographs. Sci Rep 16, 5914 (2026). https://doi.org/10.1038/s41598-026-36672-2

Schlüsselwörter: dentales KI, Panoramaröntgen, Karieserkennung, Deep Learning, Mundgesundheit