Clear Sky Science · de

Ein leichtgewichtiges YOLO-basiertes Modell zur präzisen Erkennung von roten Pfefferfruchtständen für robotische Ernte

Schlauere Roboter für scharfe Ernten

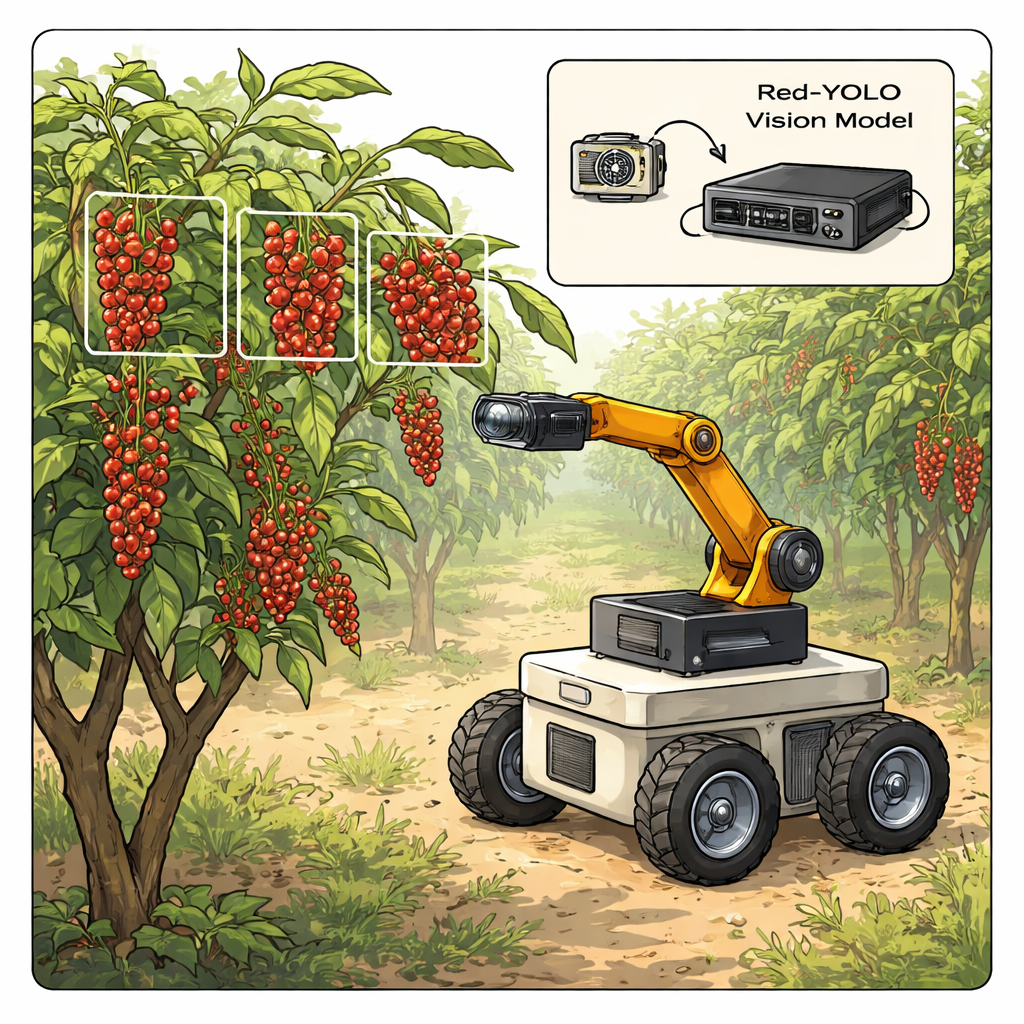

Sichuan-Pfefferkörner, die winzigen roten Hüllen, die der Sichuan-Küche ihr charakteristisches kribbelndes Schärfegefühl verleihen, sind überraschend schwer zu pflücken. Die Früchte wachsen in dichten, dornigen Bündeln, die leicht beschädigt werden können, und die Ernte per Hand ist langsam und saisonal. Diese Studie stellt ein neues Computer-Vision-System namens Red-YOLO vor, das kleinen, mobilen Robotern helfen soll, diese empfindlichen Pfefferbüschel in echten Obstgärten schnell und präzise zu erkennen — selbst wenn Früchte übereinander liegen oder hinter Blättern versteckt sind.

Warum das Pfefferpflücken so knifflig ist

Im Gegensatz zu großen, glatten Früchten wie Äpfeln wachsen rote Pfefferkörner als viele winzige Beeren, dicht gepackt an dornigen Zweigen. Die Büschel können von Baum zu Baum sehr unterschiedlich aussehen: manche sind eng und kompakt, andere locker und diffus, und alle sind von verwirrenden Hintergründen aus Zweigen, Blättern und wechselndem Licht umgeben. Für einen Roboter ist es entscheidend zu erkennen, wo ein Büschel endet und ein anderes beginnt — und wie fest es zusammenliegt. Die Greifkraft und sogar die Größe des Greifwerkzeugs müssen je nach Dichtheit der Fruchtansammlungen angepasst werden, sonst können die empfindlichen Ölsäckchen der Pfefferkörner platzen und Qualität sowie Wert mindern.

Aufbau einer Bildbibliothek aus der Praxis

Da es keine öffentlichen Bildsammlungen für diese Kultur gab, mussten die Forscher zunächst einen eigenen Datensatz erstellen. Über zwei Vegetationsperioden in Hanyuan County, Sichuan, fotografierten sie Pfefferbäume in echten Plantagen mit einem handelsüblichen Smartphone und erfassten 960 hochauflösende, quadratische Bilder unter unterschiedlichen Sonnenständen und Tageszeiten. Jedes Bild wurde sorgfältig per Hand beschriftet, wobei zwischen kompakten und diffusen Büscheln unterschieden wurde. Um dem Computer Vielfalt beizubringen, veränderten sie viele Bilder digital — sie passten Helligkeit und Kontrast an, spiegelten sie horizontal, verzerrten einige Raster und drehten Perspektiven. Dadurch wuchs das Trainingsset auf mehr als 4.300 Bilder, während eine kleine Menge unbearbeiteter Fotos beiseitegelegt wurde, um die endgültige Leistungsfähigkeit des Systems ehrlich zu prüfen.

Ein schlankeres, schärferes Computer-Vision-Modell

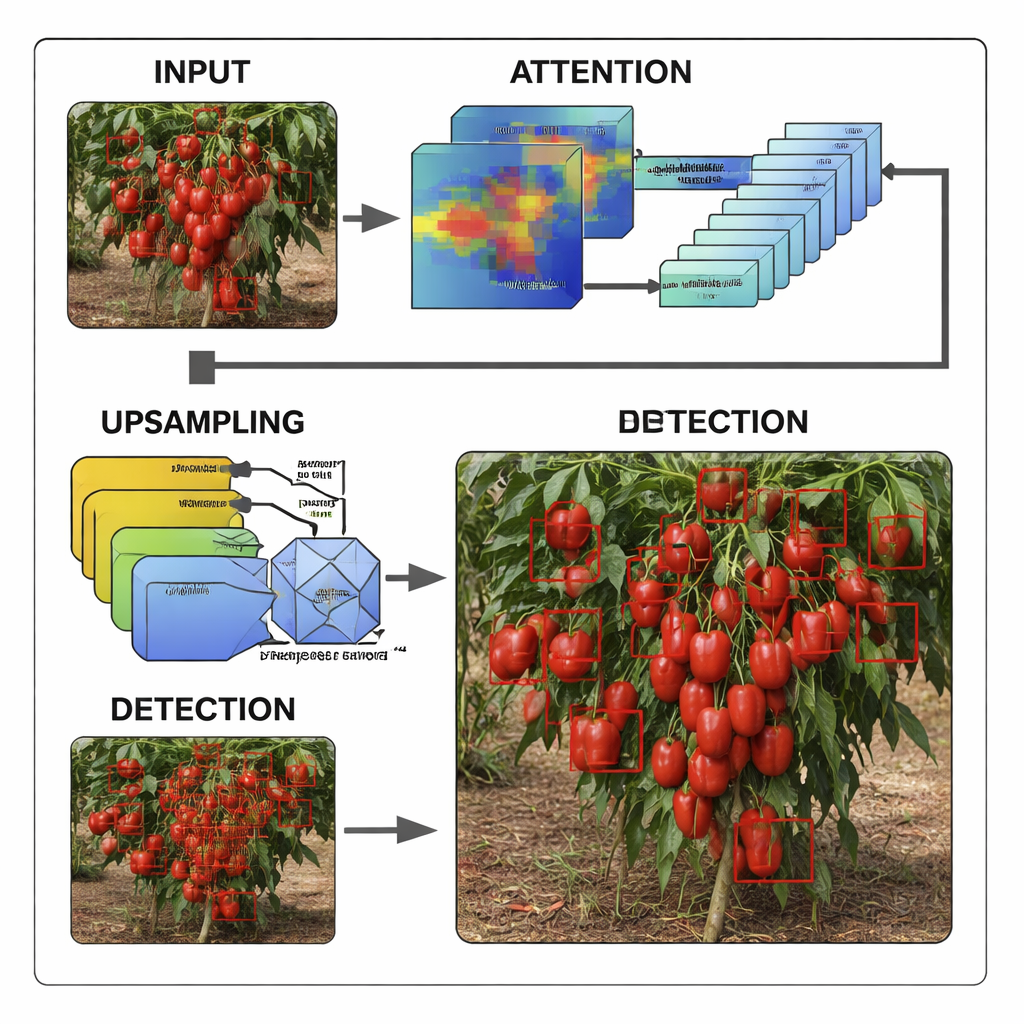

Kern des Systems ist YOLOv8, ein weit verbreitetes "you only look once"-Objekterkennungsmodell, das Objekte in einem einzigen, schnellen Durchlauf statt in mehreren langsameren Stufen erkennt. Das Team passte eine sehr kleine Version dieses Modells an und formte es speziell für rote Pfefferbüschel um. Sie fügten ein Aufmerksamkeitsmodul hinzu, das dem Netzwerk beibringt, sich auf die Kanäle und Bereiche zu konzentrieren, die am wahrscheinlichsten Früchte enthalten, während Ablenkungen wie Himmel, Zweige und entfernte Bäume ausgeblendet werden. Teile des Netzwerks wurden neu gestaltet, sodass Informationen effizienter wiederverwendet und unnötige Berechnungen reduziert werden. Außerdem ersetzten sie einen einfachen Größenänderungsschritt durch einen intelligenteren Upsampling-Block, der feine Details und Konturen um überlappende Pfefferfrüchte rekonstruiert und dem Modell hilft, abzugrenzen, wo dichte Büschel beginnen und enden.

Schnelle, präzise Sicht für kleine Roboter

Um zu prüfen, ob diese Änderungen lohnend sind, verglichen die Forscher Red-YOLO sowohl mit älteren, schwereren Erkennungssystemen als auch mit einer Reihe moderner, leichtgewichtiger YOLO-Varianten. Traditionelle Mehrstufenmodelle waren zwar leistungsfähig, aber für kompakte Obstgartenroboter einfach zu langsam und ressourcenintensiv. Mehrere neuere YOLO-Versionen schnitten besser ab, hatten aber Schwierigkeiten mit kleinen, teilweise verdeckten Büscheln oder unruhigen Hintergründen und verfehlten oft Früchte oder verwechselten Blätter mit Pfeffer. Red-YOLO fand ein besseres Gleichgewicht: Es erkannte Pfefferbüschel mit insgesamt höherer Genauigkeit und Recall als alle Vergleichsmodelle, während die Modellgröße unter drei Millionen Parametern blieb und die Rechenlast niedrig genug für eingebettete Prozessoren war. Tests in unterschiedlichen Plantagenszenen zeigten, dass Red-YOLO Büschel zuverlässig fand, selbst wenn die Früchte klein, schattig oder stark überlappt waren.

Vom Labor-Modell zum Helfer im Obstgarten

Für Nicht-Spezialisten ist das wichtigste Ergebnis praktisch: Diese Arbeit zeigt, dass ein kompaktes, sorgfältig abgestimmtes Sichtsystem kleinen Ernte-Robotern im Feld ein verlässliches "Auge" geben kann. Mit Red-YOLO kann ein Roboter automatisch entscheiden, ob er es mit einem kompakten oder diffusen Büschel zu tun hat, und vor dem Pflücken Greifergröße und -kraft anpassen, wodurch Schäden reduziert und Arbeitsaufwand gespart werden. Während die aktuelle Studie sich auf eine Pfeffersorte in einer einzigen Region konzentriert, ließe sich derselbe Ansatz — fokussierte Datensätze aufzubauen und schlanke Erkennungsmodelle zu verfeinern — auf andere Spezialkulturen ausdehnen. Mit zunehmender Robustheit und breiterer Verbreitung dieser Sichtsysteme könnten sie die Ernte schneller, sicherer und konstanter machen und so eine verlässliche Versorgung mit den Pfeffern sichern, die viele der weltweit beliebten Aromen antreiben.

Zitation: Zhao, H., He, J., Li, Y. et al. A lightweight YOLO-based model for accurate detection of red pepper clusters in robotic harvesting. Sci Rep 16, 5879 (2026). https://doi.org/10.1038/s41598-026-36671-3

Schlüsselwörter: robotische Ernte, Pfeffererkennung, Computer Vision, leichtgewichtiges YOLO, intelligente Landwirtschaft