Clear Sky Science · de

Feinmaschige Bewertung großer Sprachmodelle in der Medizin mithilfe nichtparametrischer kognitiver Diagnostikmodelle

Warum das für künftige Arztbesuche wichtig ist

Künstliche Intelligenzsysteme, die sprechen und schreiben können und als große Sprachmodelle bezeichnet werden, dringen schnell aus Forschungslabors in Kliniken vor. Sie können bereits Ärztinnen und Ärzten helfen, komplexe Befunde zu lesen, Behandlungsvorschläge zu machen und medizinische Fragen zu beantworten. Die meisten Tests dieser Systeme liefern jedoch nur eine einzige Gesamtnote, ähnlich einer Abschlussprüfung, die gefährliche blinde Flecken verbergen kann. Diese Studie zeigt eine neue Methode, um diese Noten aufzuschlüsseln und genau offenzulegen, in welchen Bereichen der Medizin diese Modelle tatsächlich kompetent sind — und wo sie Patientinnen und Patienten noch gefährden könnten.

Weiterblicken als nur auf eine einzige Testergebnisnote

Heute wird medizinische KI meist danach bewertet, wie viele Fragen sie in Tests beantwortet, die an Ärztezulassungsprüfungen angelehnt sind. Dieser Ansatz ist zwar einfach, aber grob. Ein Modell kann eine hohe Gesamtnote erzielen und dennoch in einem kritischen Bereich wie Rhythmusstörungen oder Lebererkrankungen schwach sein. In echten Kliniken können solche Lücken lebensbedrohliche Folgen haben. Die Autorinnen und Autoren vertreten die Auffassung, dass ein sicherer Einsatz von KI in der Medizin eine tiefere, feinere Bewertung erfordert — eine, die ein detailliertes Fähigkeitsprofil abbildet, statt nur eine einzelne, möglicherweise irreführende Note zu vergeben.

Eine klügere Methode zur Prüfung medizinischen Wissens

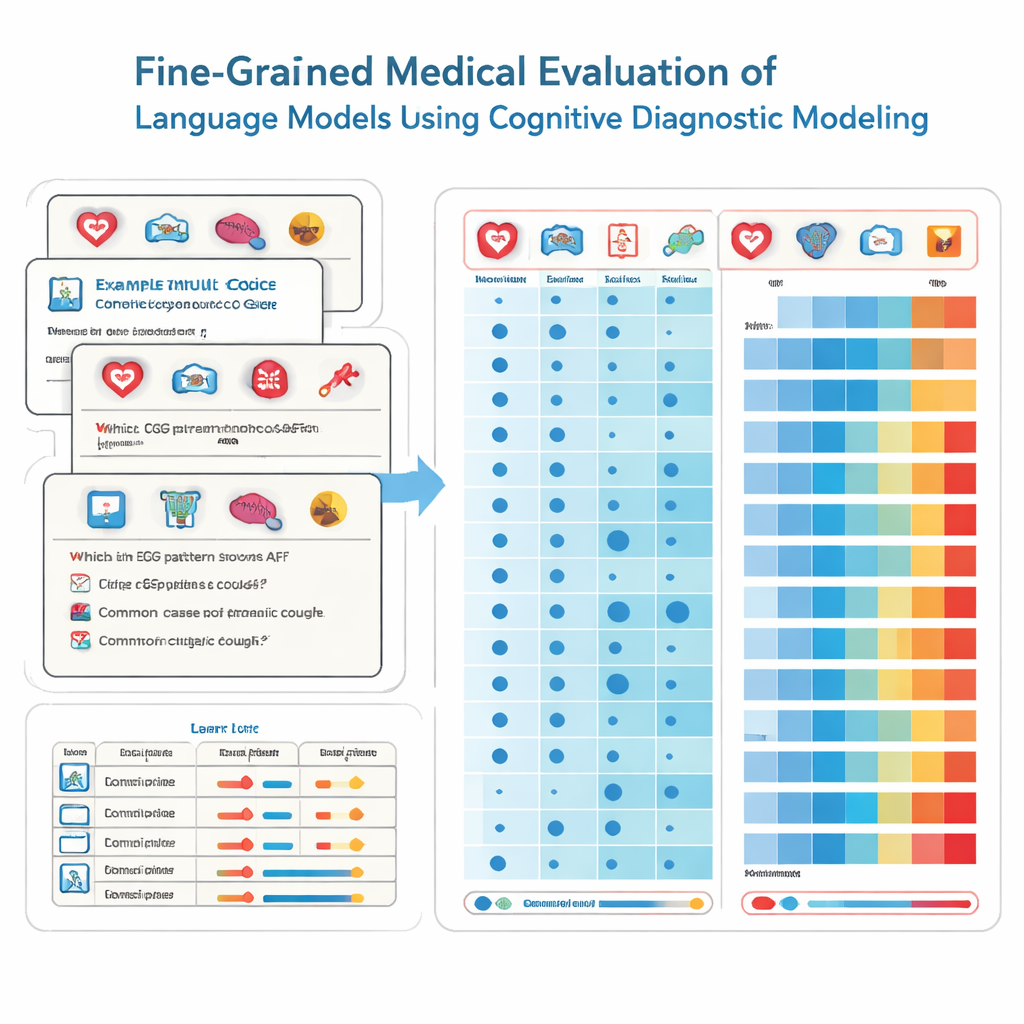

Um das zu erreichen, entleihen die Forschenden Werkzeuge aus der pädagogischen Psychologie, sogenannte kognitive diagnostische Assessments. Anstatt jede Prüfungsfrage so zu behandeln, als messe sie dieselbe unscharfe Fähigkeit, zerlegt diese Methode medizinisches Wissen in spezifische Bausteine wie Kardiologie, Radiologie oder Notfallmedizin. Jede Multiple-Choice-Frage wird mit der genauen Mischung an Fertigkeiten versehen, die sie erfordert. Mithilfe einer nichtparametrischen statistischen Technik vergleicht das Team, wie ein Modell tausende solcher Fragen beantwortet, mit idealen Antwortmustern. Daraus wird abgeleitet, ob das Modell jede zugrundeliegende Fähigkeit „beherrscht“, ähnlich einem detaillierten Zeugnis, das Stärken und Schwächen in verschiedenen Fächern zeigt.

41 KI-Modelle werden einer medizinischen Prüfung unterzogen

Das Team prüfte 41 weit verbreitete Sprachmodelle, darunter kommerzielle Systeme und Open-Source-Modelle, mit 2.809 sorgfältig geprüften Fragen aus einer chinesischen nationalen Prüfungsdatenbank für Medizin. Diese Fragen decken 22 medizinische Teilbereiche ab und sind für Studierende gedacht, die kurz vor der Ärztelizenzprüfung stehen. Jede Frage hat eine richtige Antwort und wurde von Expertinnen und Experten mit den berührten Fachgebieten gekennzeichnet. Mit ihrer diagnostischen Methode schätzten die Forschenden für jedes Modell, welche der 22 medizinischen Attribute es effektiv beherrscht — nicht nur, wie viele Fragen es zufällig korrekt beantwortet hat.

Gutes Allgemeinwissen, aber ausgeprägte blinde Flecken

Die Ergebnisse sind sowohl beeindruckend als auch beunruhigend. Die leistungsstärksten Modelle, darunter mehrere führende kommerzielle Systeme, beantworteten die meisten Fragen korrekt und zeigten Beherrschung in 20 von 22 medizinischen Domänen. Über alle Modelle hinweg war die Leistung in vielen gängigen Fachgebieten ausgezeichnet; in 15 Bereichen wie Kardiologie, Dermatologie und Endokrinologie wurde vollständige Beherrschung erreicht. Die feinmaschige Analyse legte jedoch deutliche Lücken in anderen Bereichen offen. Die Radiologie hinkte mit deutlich niedrigeren Beherrschungsraten hinterher, und zwei Subdomänen — EKG & Hypertonie & Lipide sowie Lebererkrankungen — wurden von keinem Modell beherrscht. Wichtig ist, dass einige kleinere Modelle dieselben beherrschten Fähigkeiten wie deutlich größere aufwiesen, was zeigt, dass bloße Modellgröße keine breite, verlässliche medizinische Expertise garantiert.

Das richtige Werkzeug für die richtige Aufgabe wählen

Diese detaillierten Profile sind wichtig, weil Modelle mit sehr ähnlichen Gesamtnoten sehr unterschiedliche Muster von Stärken und Schwächen haben können. Ein System kann in der Neurologie stark, in der Pharmakologie dagegen schwach sein, während ein anderes das gegenteilige Profil zeigt. Für Klinikleitungen bedeutet das, dass sie keine KI-Assistentin oder keinen KI-Assistenten allein nach der Schlagzeilennote oder der Parameterzahl auswählen können. Stattdessen benötigen sie diagnostische Ergebnisse wie in dieser Studie, um jedes Modell bestimmten klinischen Aufgaben zuzuordnen und Arbeitsabläufe zu gestalten, in denen Fachpersonen die KI-Ausgaben in Bereichen mit hohem Risiko nachprüfen, in denen das Modell bekanntlich schwach ist.

Was das für Patientinnen, Patienten und Klinikpersonal bedeutet

Kurz gesagt kommt die Studie zu dem Schluss, dass eine hohe „Note“ in medizinischen Tests nicht garantiert, dass ein KI-System in allen Bereichen der Medizin sicher einsetzbar ist. Der neue Ansatz funktioniert eher wie ein gründlicher Gesundheitscheck für die KI selbst und zeigt, welche "Organe" — hier medizinische Fachgebiete — gesund sind und welche Aufmerksamkeit benötigen. Indem versteckte Lücken in kritischen Bereichen wie EKG-Interpretation und Lebererkrankungen aufgedeckt werden, bietet die Methode Krankenhäusern, Regulierungsbehörden und Entwickelnden eine praktische Roadmap: Modelle nur dort einsetzen, wo sie als stark nachgewiesen sind, Menschen in Bereichen mit bekannten Schwächen fest im Entscheidungsprozess behalten und zukünftiges Training auf die riskantesten blinden Flecken konzentrieren. Solch eine feinmaschige Evaluation, argumentieren die Autorinnen und Autoren, ist nicht nur hilfreich — sie ist unerlässlich, bevor man der KI die Patientenversorgung anvertraut.

Zitation: Zheng, T., Liu, J., Feng, S. et al. Fine-grained evaluation of large language models in medicine using non-parametric cognitive diagnostic modeling. Sci Rep 16, 6460 (2026). https://doi.org/10.1038/s41598-026-36627-7

Schlüsselwörter: medizinische KI, große Sprachmodelle, klinische Sicherheit, Modellevaluation, Diagnosetests