Clear Sky Science · de

Verarbeitung von Serial‑Femtosekunden‑Kristallographie‑Daten im Global Science Data Hub Center bei KISTI

Warum winzige Kristalle große Rechner brauchen

Moderne Röntgenlaser können „molekulare Filme“ von Proteinen und anderen Molekülen aufnehmen, indem sie ultrakurze, ultrastarke Pulse auf unzählige winzige Kristalle abfeuern. Dieser Ansatz, seriale Femtosekunden‑Kristallographie genannt, erzeugt eine Flut von Bildern, die zeigen, wie Moleküle bei Raumtemperatur aussehen und sich bewegen. Es gibt jedoch einen Haken: Ein einzelnes Experiment kann Terabytes an Daten erzeugen — weit mehr, als ein typischer Laborrechner schnell verarbeiten kann. Dieser Beitrag beschreibt, wie Koreas nationale Datenstelle GSDC bei KISTI aufgebaut und getestet wurde, um diese riesigen Datensätze effizient zu verarbeiten, und welche praktischen Lehren Wissenschaftler daraus ziehen können, um ohne lange Verzögerungen von Rohbildern zu 3‑D‑Strukturen zu gelangen.

Von Laserblitzen zu Struktur‑Schnappschüssen

Bei der serialen Femtosekunden‑Kristallographie schießt ein Röntgen‑Freie‑Elektronen‑Laser (XFEL) schnelle Pulse auf Ströme oder Anordnungen mikroskopischer Kristalle. Jeder Kristall wird nur einmal getroffen und liefert ein einzelnes Beugungsmuster‑„Schnappschuss“, bevor er zerstört wird. Um die vollständige dreidimensionale Struktur des Moleküls zu rekonstruieren, müssen hunderte Tausende bis Millionen dieser Schnappschüsse kombiniert werden. Viele Bilder sind wertlos — einige enthalten kein Signal, andere zeigen überlappende Kristalle. Nützliche Bilder („Hits“) müssen erkannt, sortiert und in Intensitätsdaten umgewandelt werden, die zu einer hochqualitativen Struktur verschmolzen werden können. Dies in annähernd Echtzeit zu leisten, erfordert Hochleistungsrechnen, besonders wenn der Laser mit Dutzenden Pulsen pro Sekunde arbeitet.

Ein nationales Datenzentrum für Röntgenexperimente

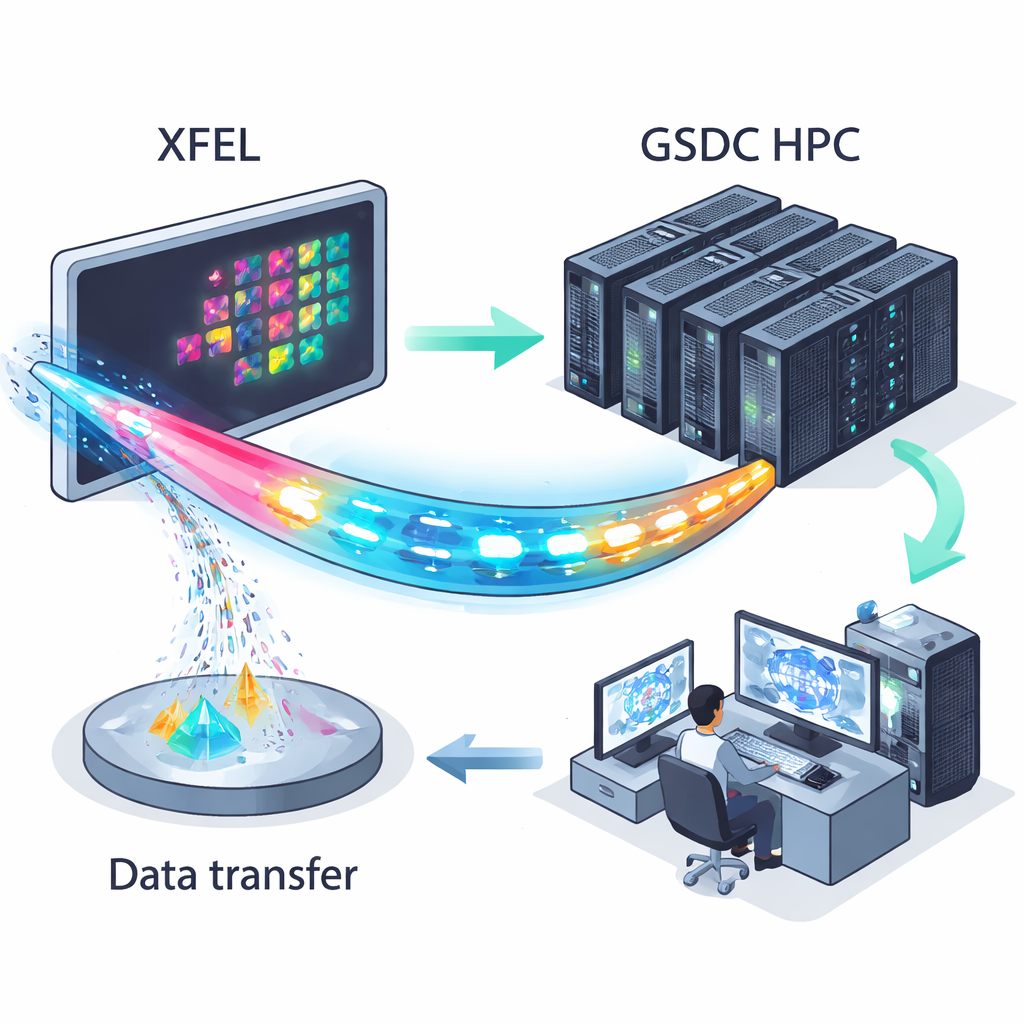

Das Global Science Data Hub Center (GSDC) bei KISTI wurde als nationale Einrichtung für datenintensive Wissenschaften aufgebaut, von Teilchenphysik bis Genomik. Für serielle Kristallographie am Pohang Accelerator Laboratory XFEL (PAL‑XFEL) betreibt GSDC drei dedizierte Server mit Dutzenden CPU‑Kernen, Hunderten Gigabyte Arbeitsspeicher und einem schnellen parallelen Speichersystem. Während Experimenten an der Nanokristallographie‑Station von PAL‑XFEL werden Beugungsbilder auf einem schnellen Röntgendetektor aufgenommen und über eine 10‑Gigabit‑pro‑Sekunde‑Verbindung an GSDC gestreamt. Ein einzelnes 12–24‑stündiges Experiment kann mehrere bis beinahe zehn Terabyte an Daten erzeugen. Bei GSDC melden sich Nutzer remote an, filtern nicht‑nützliche Frames heraus und führen spezialisierte Software aus — etwa CrystFEL und die zugehörigen Indexierprogramme —, um Rohbilder in verfeinerte Strukturdaten zu überführen.

Wie viele Prozessoren nützen — und wann

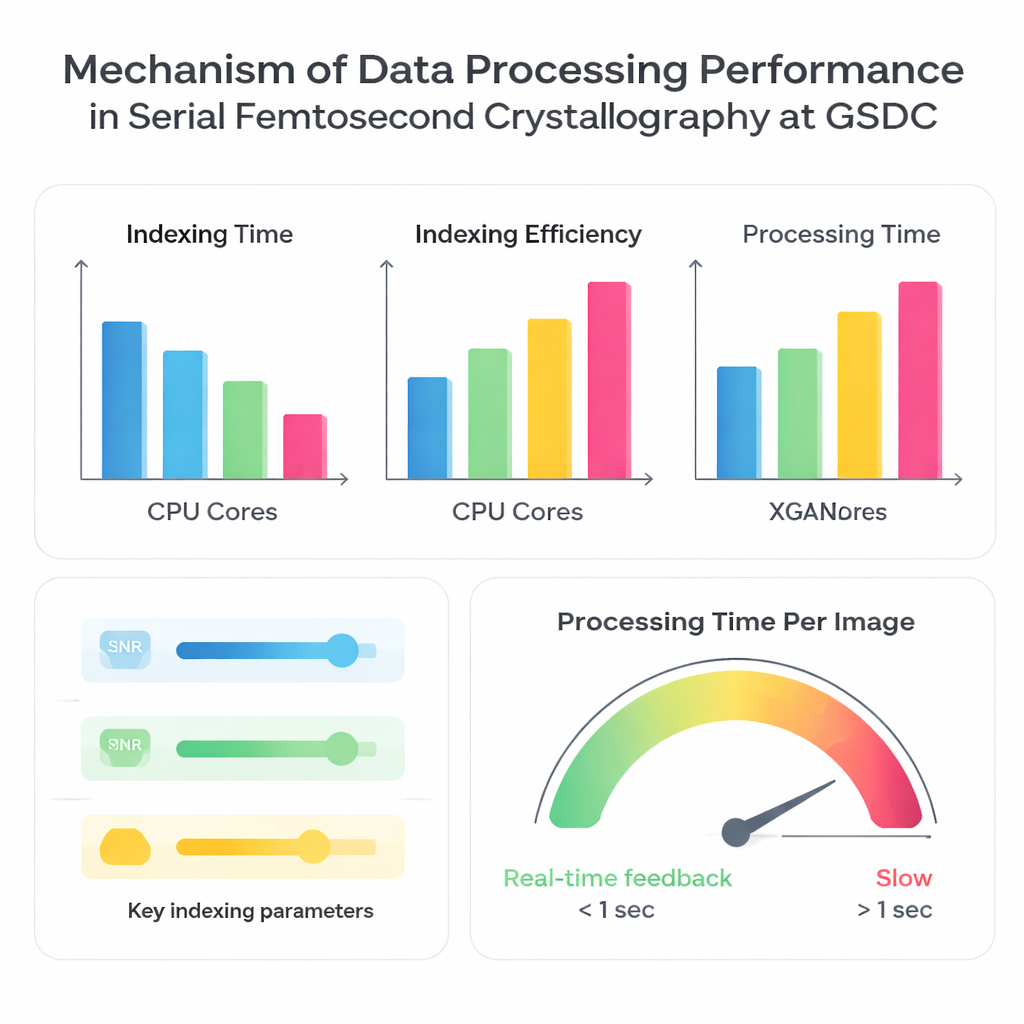

Die Autoren haben das GSDC‑System mit drei zuvor gesammelten Datensätzen unterschiedlicher Proteine getestet. Zunächst untersuchten sie, wie stark die Verarbeitungsgeschwindigkeit steigt, wenn mehr CPU‑Kerne parallel genutzt werden. Wie erwartet verringerte eine höhere Kernzahl die Gesamtzeit fürs Indexieren, aber nicht proportional. Der Sprung von etwa 10 auf 30–40 CPU‑Kerne brachte deutliche Verbesserungen; darüber hinaus flachte der Nutzen ab. Ab einem bestimmten Punkt führten zusätzliche Kerne zu Overhead und wurden durch Grenzen wie Speicherbandbreite, Ein-/Ausgabe‑Geschwindigkeit beim Lesen vieler kleiner Dateien und Koordination zahlreicher paralleler Aufgaben gebremst. Das macht deutlich, dass „mehr Kerne“ nicht immer besser sind; es gibt einen Sweet Spot, in dem die Hardware effizient genutzt wird, ohne Engpässe zu erzeugen.

Der Kompromiss zwischen Geschwindigkeit und Vollständigkeit

Als Nächstes verglich das Team vier weit verbreitete Indexieralgorithmen — XDS, DirAx, MOSFLM und XGANDALF — auf derselben Rechenplattform. Einige Methoden, wie XDS und DirAx, waren insgesamt schneller, identifizierten aber einen geringeren Anteil von Bildern, die erfolgreich in nutzbare Beugungsmuster umgewandelt werden konnten. Andere, etwa MOSFLM und XGANDALF, waren langsamer, verwerteten dafür mehr Bilder und erzielten in der Regel bessere statistische Qualität im finalen zusammengeführten Datensatz. Die Autoren untersuchten auch, wie einfache Eingabeentscheidungen sowohl Geschwindigkeit als auch Erfolgsrate beeinflussen: Eine höhere Signal‑Rausch‑Schwelle oder das Abschalten der Multi‑Kristall‑Indexierung beschleunigte die Verarbeitung, reduzierte aber die nutzbare Bildanzahl; eine niedrigere Schwelle oder das Aktivieren von Multi‑Kristall‑Verarbeitung bewirkte das Gegenteil. Entscheidend war, dass selbst kleine Fehler in der Detektorgeometrie — etwa der Abstand zwischen Detektor und Probe — häufiger zum Scheitern des Indexierens führten und die Verarbeitung dramatisch verlangsamten, weil die Software weiterhin falsche Lösungen ausprobierte und verworf.

Folgerungen für künftige Experimente

Indem Hardware‑Entscheidungen, Software‑Algorithmen und benutzergesteuerte Einstellungen systematisch vermessen wurden, wandelt diese Studie die komplexe Datenverarbeitung in eine Reihe praktischer Leitlinien um. Für Wissenschaftler, die Experimente am PAL‑XFEL planen, zeigt sie, wann parallele Verarbeitung am effektivsten ist, welche Indexierprogramme sich für schnelles Feedback gegenüber maximaler Datenqualität eignen und warum eine sorgfältige Kalibrierung der Detektorgeometrie so wichtig ist. Die Autoren schließen, dass GSDC bereits eine effiziente Verarbeitung ermöglicht und in manchen Fällen Echtzeit‑Feedback während der Datenerfassung liefert, dass aber weitere Ausbaumaßnahmen der Rechenressourcen nötig sein werden, wenn Wiederholraten und Datensatzgrößen weiter zunehmen. Für Nicht‑Expertinnen und Nicht‑Experten lautet die Kernbotschaft: Das Erstellen von „Filmen“ von Molekülen ist nicht nur ein Triumph fortschrittlicher Laser und Detektoren — es hängt ebenso entscheidend von gut konzipierten Rechenzentren ab, die mit der Datenflut Schritt halten können.

Zitation: Nam, K.H., Na, SH. Serial femtosecond crystallography data processing at the global science data hub center at KISTI. Sci Rep 16, 6786 (2026). https://doi.org/10.1038/s41598-026-36540-z

Schlüsselwörter: serial femtosecond crystallography, Röntgen‑Freie‑Elektronen‑Laser, Hochleistungsrechnen, Datenverarbeitung, Proteinstruktur