Clear Sky Science · de

Wissenschaftlicher Bericht: Multi-Relational Dual Attention Graph Transformer für fein granulare Sentiment-Analyse

Warum winzige Hinweise in Bewertungen wichtig sind

Online-Bewertungen enthalten oft gemischte Gefühle: Ein Restaurant kann „tollstes Essen, aber langsamer Service“ haben, oder ein Telefon ein „wunderschönes Display, aber schreckliche Akkulaufzeit“. Unternehmen und Forschende wollen, dass Computer diese detaillierten Meinungen erfassen — nicht nur, ob die gesamte Bewertung positiv oder negativ ist. Diese Arbeit stellt ein neues KI-Modell vor, das gezielt in bestimmte Teile eines Satzes hineinzoomt — etwa „Service“ oder „Akkulaufzeit“ — und genau ermittelt, wie die Stimmung zu jedem dieser Aspekte ist, selbst wenn die Hinweise verstreut und subtil sind.

Weiterdenken als Einheits-Bewertungen

Traditionelle Sentiment-Analyse behandelt einen Satz oder eine Bewertung als einen einheitlichen Textblock und entscheidet, ob er insgesamt positiv oder negativ ist. Das funktioniert bei einfachen Kommentaren, versagt jedoch, wenn jemand zugleich einen Aspekt lobt und einen anderen kritisiert. Die Disziplin der Aspect-Based Sentiment Analysis fragt deshalb: Wie ist die Stimmung gegenüber jedem einzelnen Ziel, etwa „Service“, „Ambiente“ oder „Personal“ in einer Restaurantbewertung. Frühere Methoden beruhten auf handgemachten Regeln oder einfachen Lernverfahren, die Wörter zählten, und entwickelten sich dann zu neuronalen Netzen, die Text sequenziell lesen, also etwa von links nach rechts. Diese sequentiellen Modelle verbesserten die Genauigkeit, verpassten aber weiterhin Fernbeziehungen und subtile Signale — besonders wenn relevante Wörter weit auseinanderliegen oder durch Kontrastwörter wie „aber“ und „obwohl“ verbunden sind.

Sätze in vernetzte Landkarten verwandeln

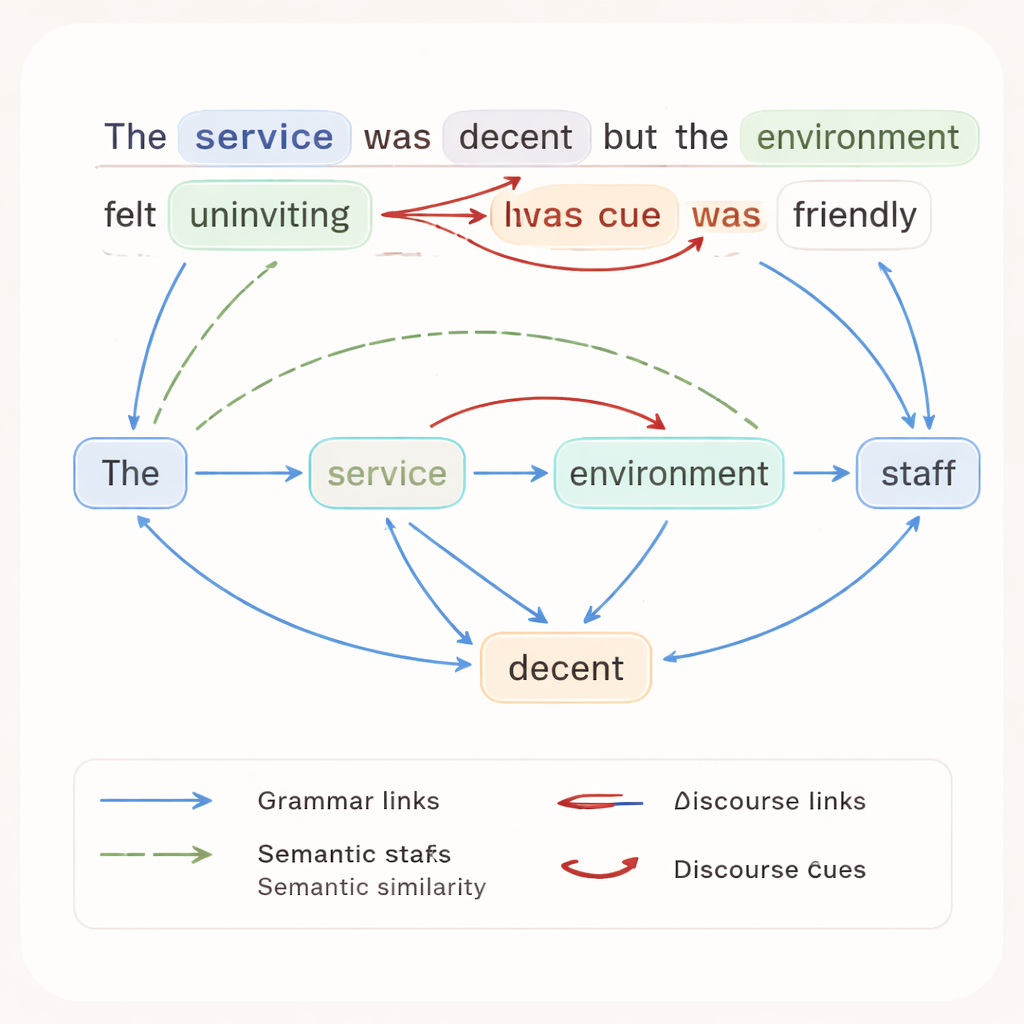

Die Autorinnen und Autoren argumentieren, dass ein Computer zur wirklich fein granulären Meinungsanalyse einen Satz eher als Netzwerk denn als gerade Linie sehen sollte. In ihrem Ansatz wird jedes Wort zu einem Knoten in einem Graphen, und verschiedene Beziehungsarten werden zu Kanten. Eine Kantenart erfasst Grammatik, etwa welches Wort Subjekt oder Objekt ist. Eine andere verbindet Wörter mit ähnlicher Bedeutung, auch wenn sie nicht nebeneinanderstehen. Eine dritte markiert Diskurs-Hinweise — Wörter wie „aber“, „jedoch“ oder „obwohl“, die oft einen Stimmungswechsel signalisieren. In einem Satz wie „Der Service war in Ordnung, aber das Ambiente wirkte ungemütlich, obwohl das Personal freundlich war“ zeigt dieser Graph, wie Lob und Kritik um verschiedene Aspekte herum verwoben sind.

Ein doppelter Scheinwerfer auf Kontext und Ziele

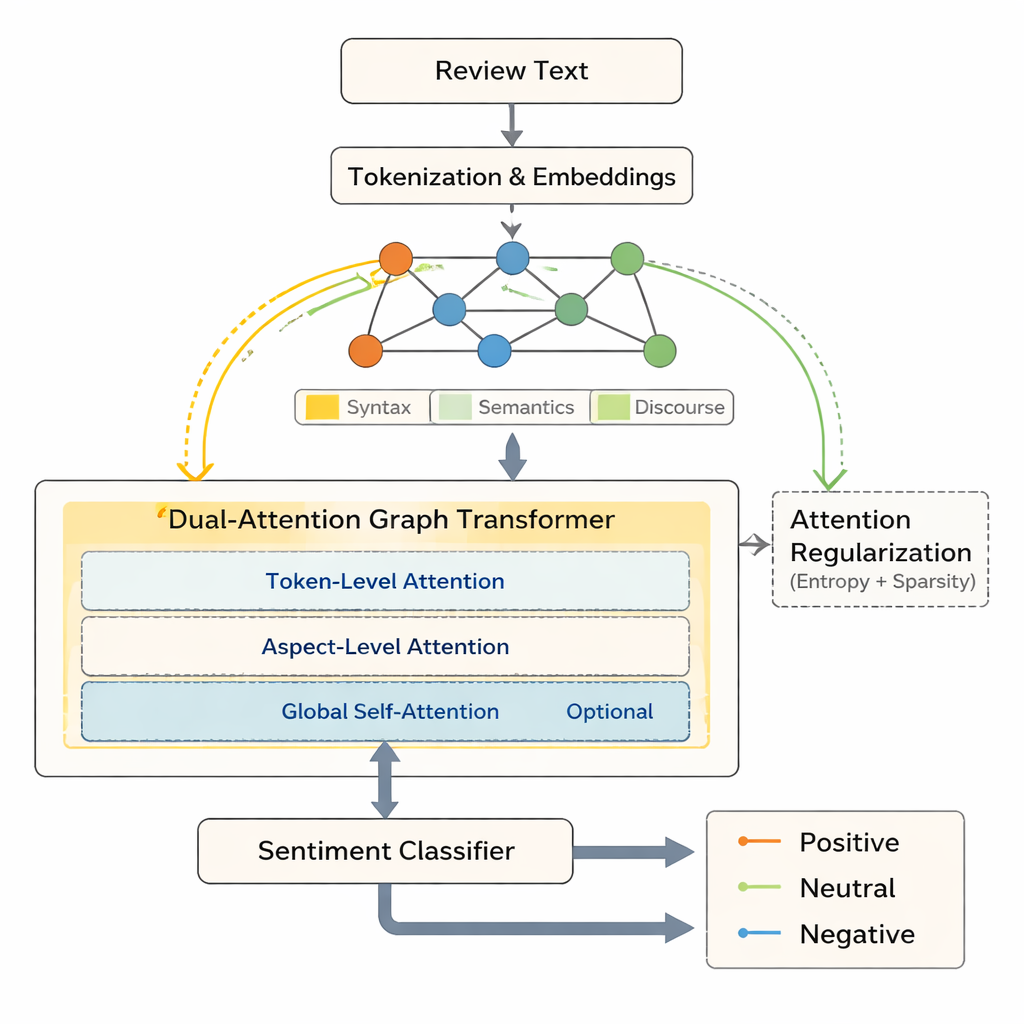

Aufbauend auf dieser Graph-Ansicht stellt das Papier den Multi-Relational Dual-Attention Graph Transformer (MRDAGT) vor. Dieses Modell nutzt einen Transformer-ähnlichen Attention-Mechanismus, angepasst an Graphen. Ein Attention-Head betrachtet breit, wie alle Wörter im Satz zueinander stehen, und sammelt nützlichen lokalen Kontext. Ein zweiter Head fokussiert explizit auf das betrachtete Aspektziel — etwa „Service“ oder „Ambiente“ — und verstärkt den Einfluss von Wörtern, die Meinungen zu diesem Ziel prägen, wie „in Ordnung“ oder „ungemütlich“. Wenn mehrere Aspekte in einem Satz vorkommen, hilft eine optionale globale Attention-Schicht dem Modell, ihre Wechselwirkungen abzuwägen. Effektiv strahlt das System zwei koordinierte Scheinwerfer aus: einen auf die allgemeine Satzstruktur und einen direkt auf den Aspekt, dessen Stimmung bewertet werden soll.

Maschinelle Attention selektiver und erklärbarer machen

Ein zentrales Problem moderner KI ist, dass Attention-Gewichte — die Zahlen, die anzeigen, auf welche Wörter das Modell fokussiert hat — zu dünn verteilt sein können, wodurch Entscheidungen schwer zu interpretieren sind. MRDAGT begegnet dem mit zwei Regularisierungszwängen. Eine Entropie-Strafe verhindert zu flache Attention und drängt das Modell, sich stärker auf wenige wichtige Wörter zu konzentrieren. Gleichzeitig sorgt ein L1-Sparsity-Term dafür, dass viele Attention-Verbindungen gegen null gedrückt werden, wodurch schwache, rauschhafte Verbindungen beseitigt werden. Zusammen erzeugen diese Kräfte eine „fokussierte Sparsität“: Das Modell neigt dazu, klare, hohe Gewichte auf wirklich relevante Wort–Aspekt-Paare zu legen und Ablenkungen zu ignorieren. Experimente auf drei Benchmark-Datensätzen — formelle Laptop-Rezensionen, komplexe mehrsatzige Reviews und informelle Twitter-Beiträge — zeigen, dass MRDAGT starke bestehende Systeme konsistent um etwa ein bis zwei Prozentpunkte in der Genauigkeit übertrifft und zugleich sauberere, interpretierbarere Attention-Karten produziert.

Was das für praktische Meinungsanalyse bedeutet

Für Nicht-Spezialisten lautet das Fazit: Dieses Modell bietet eine präzisere, verlässlichere Möglichkeit, Meinungen aus unordentlichem, realem Text zu extrahieren. Anstatt nur zu sagen, eine Bewertung sei „größtenteils positiv“, kann MRDAGT getrennt ausweisen, dass Kunden die Geschwindigkeit eines Geräts mögen, aber die Akkulaufzeit nicht, oder dass Gäste das Personal eines Cafés schätzen, sich aber über Lärm beschweren. Da seine Attention-Muster der menschlichen Intuition entsprechen — Fokus auf Kontrastwörter, sentimentgeladene Adjektive und Aspektbegriffe — ist es für Analysten leichter nachzuvollziehen, warum das Modell eine bestimmte Entscheidung traf. Die Autorinnen und Autoren schlagen vor, dass dieser Ansatz bessere Produktdesign-Entscheidungen, präzisere Social-Media-Überwachung und künftige Erweiterungen auf viele Sprachen und sogar multimodale Daten wie Audio und Bilder unterstützen kann, und das bei relativ transparenter Argumentation.

Zitation: Anilkumar, A.P., Kim, SK. & Yoon, YC. Scientific reports multi relational dual attention graph transformer for fine grained sentiment analysis. Sci Rep 16, 7236 (2026). https://doi.org/10.1038/s41598-026-36490-6

Schlüsselwörter: aspect-basierte Sentiment-Analyse, Graph-Neuronale Netze, Transformer-Attention, Opinion Mining, Natürliche Sprachverarbeitung