Clear Sky Science · de

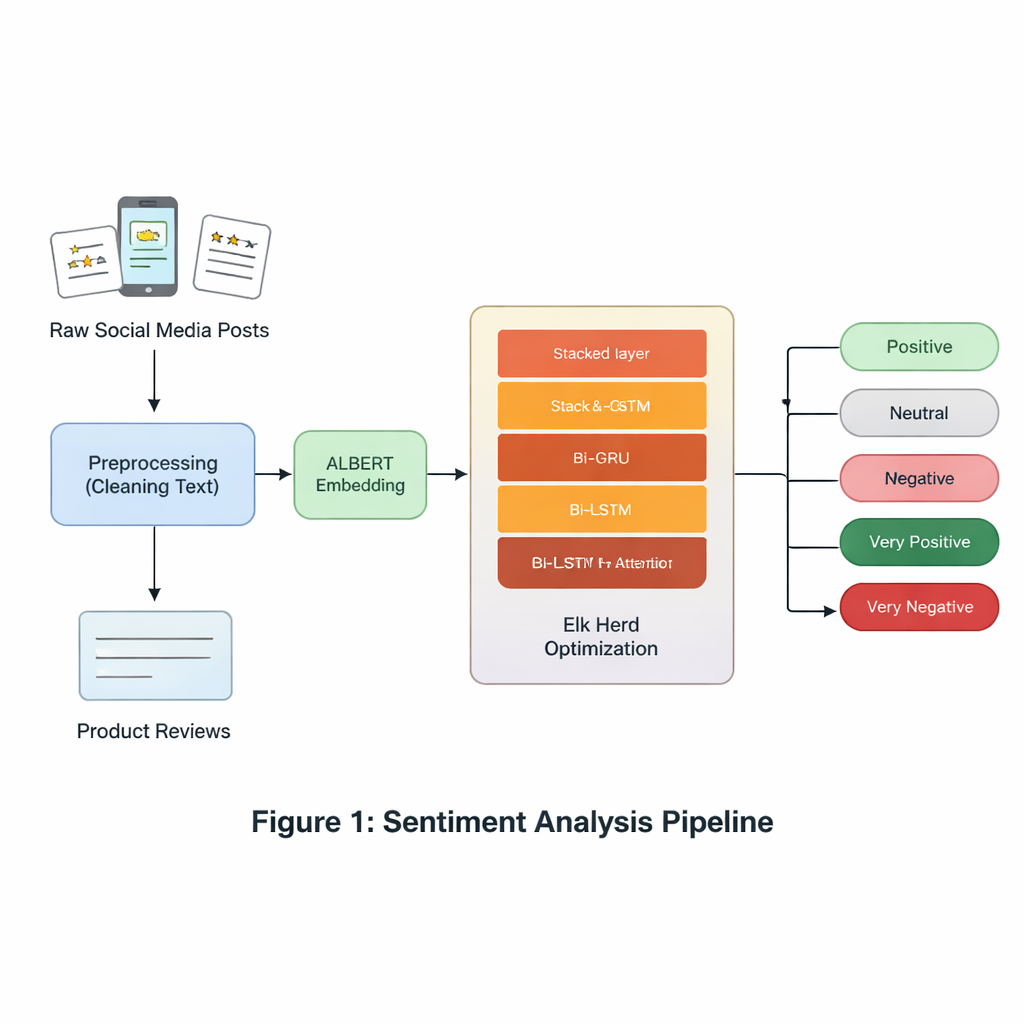

Ein tiefes Sentiment-Modell, das ALBERT-basierte Kontextverarbeitung und EHO-optimierte Architektur kombiniert

Warum intelligenteres Sentiment-Lesen wichtig ist

Jeden Tag teilen Millionen Menschen im Internet Meinungen zu Produkten, Dienstleistungen, Politik und Ereignissen. Aus dieser Flut von Text verlässliche Erkenntnisse zu gewinnen, ist für Unternehmen, Behörden und Forschende entscheidend. Doch unsere Online-Sprache ist unordentlich: sarkastische Witze, Slang, Tippfehler und seltene Gefühlsäußerungen können Computer leicht verwirren. Dieses Papier stellt ein neues Sentiment‑Analyse‑System vor, das darauf abzielt, Emotionen genauer zu erkennen und dabei weniger Rechenleistung zu benötigen als viele aktuelle KI‑Modelle.

Von einfachen Wortzählungen zu kontextbewusstem Lesen

Frühe Sentiment‑Analyse‑Werkzeuge behandelten Text wie eine Tasche mit losen Wörtern und zählten, wie oft Begriffe wie „gut“ oder „schrecklich“ vorkamen. Dieser Ansatz ignorierte Wortreihenfolge und feinen Kontext, etwa dass „nicht schlecht“ eher „ziemlich gut“ bedeutet. Deep‑Learning‑Methoden verbesserten dies, indem sie Text als Sequenzen verarbeiteten, benötigten aber häufig riesige annotierte Datensätze und viel Rechenaufwand. Transformer‑Modelle wie BERT steigerten die Genauigkeit weiter, doch ihre große Größe macht sie in realen Umgebungen wie Kundendienstplattformen oder Social‑Media‑Monitoring teuer im Betrieb. Die Autorinnen und Autoren dieses Papiers reagieren auf diese Herausforderung, indem sie mehrere leichtere, aber leistungsfähige Komponenten zu einem schlanken System kombinieren.

Ein schlankeres Gehirn zum Textverständnis

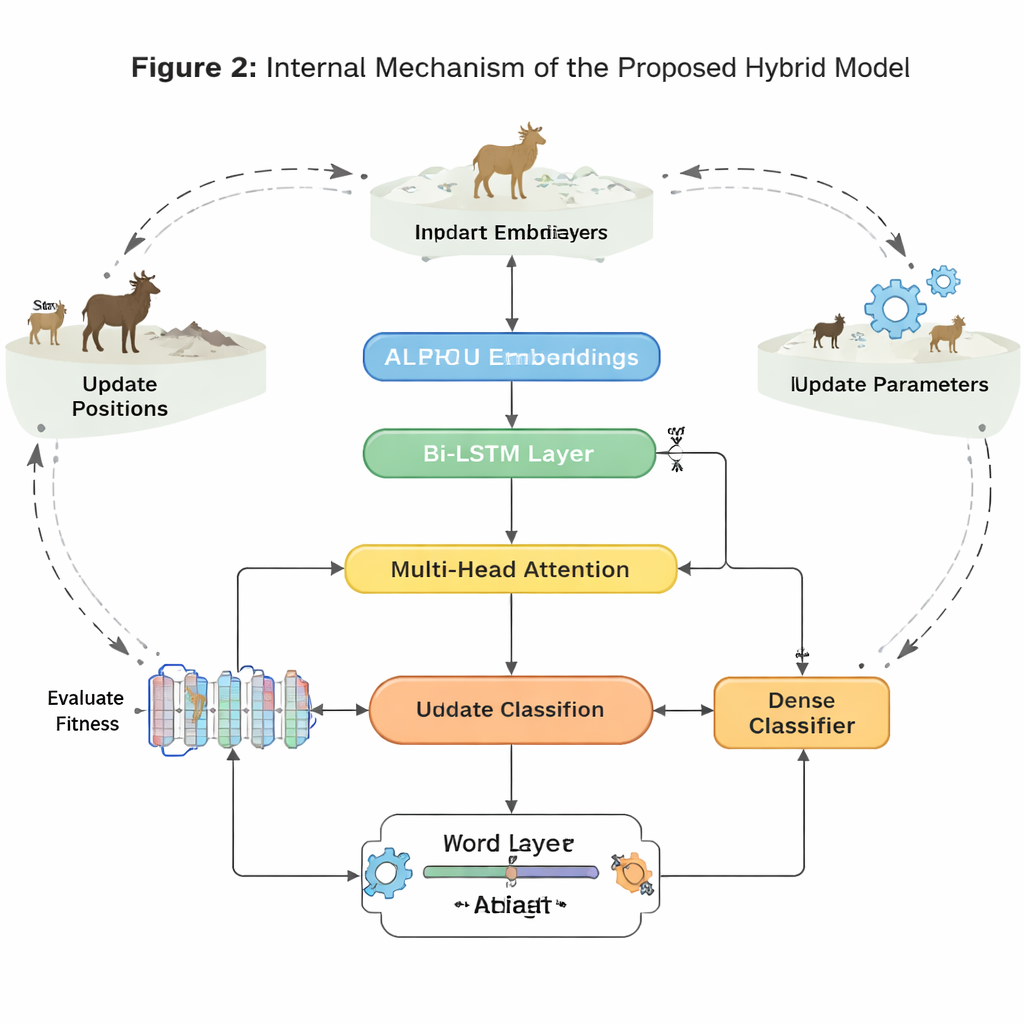

Kern des Modells ist ALBERT, ein kompakter Verwandter des BERT‑Sprachmodells. ALBERT wandelt jedes Wort in einem Satz in eine kontextabhängige numerische Repräsentation um und erfasst, wie sich Bedeutungen abhängig von benachbarten Wörtern verschieben. Anders als größere Modelle reduziert ALBERT den Speicherbedarf, indem es Parameter zwischen Schichten teilt und seinen Wortschatz komprimiert. Dadurch lässt es sich leichter auf Standardhardware betreiben, ohne viel Verständniseinbußen. Diese auf ALBERT basierenden Wortrepräsentationen werden zur Eingabe für eine Abfolge spezialisierter Schichten, die darauf ausgerichtet sind, wie sich Sentiments über einen Satz hinweg entfalten.

Zwei Gedächtnissysteme arbeiten zusammen

Um nachzuvollziehen, wie sich Bedeutung von Wort zu Wort ändert, verwendet das System zwei Arten rekurrenter Netzwerke: GRUs (Gated Recurrent Units) und LSTMs (Long Short‑Term Memory), jeweils in vorwärts und rückwärts gerichteter Ausführung. GRUs sind effizient beim Verfolgen kurzer Phrasen mit weniger Parametern, während LSTMs Informationen über längere Textabschnitte besser behalten. Indem eine bidirektionale GRU‑Schicht auf eine bidirektionale LSTM‑Schicht gestapelt und ein Aufmerksamkeitsmechanismus hinzugefügt wird, kann das Modell die sentimentstärksten Teile eines Satzes hervorheben — etwa die Wendung „außer der Akku‑Laufzeit“ in einer ansonsten positiven Bewertung. Dieses hybride Design zielt darauf ab, sowohl schnelle Tonänderungen als auch längerreichenden Kontext zu erfassen, der das Gesamtsentiment umkehren kann.

Von der Natur inspiriertes Tuning für schwierige Fälle

Über die Architektur hinaus adressieren die Autorinnen und Autoren ein zentrales reales Problem: Sentiment‑Datensätze sind oft unausgewogen und verrauscht. Emotionen wie Ekel oder Überraschung und neutrale Aussagen kommen seltener vor als eindeutig positive oder negative, sodass viele Modelle diese vernachlässigen. Um dem entgegenzuwirken, verwendet das Papier Elk Herd Optimization, eine von der Natur inspirierte Suchstrategie, die das Verhalten von Elchen beim Bewegen, Konkurrenzen und Bilden von Gruppen nachbildet. Nachdem das neuronale Netz interne Sentimentvektoren erzeugt hat, verfeinert dieser Optimierungsschritt iterativ, wie diese Vektoren jede Klasse repräsentieren — besonders die seltenen — durch Verbesserung einer „Fitness“-Bewertung. Dieser Prozess hilft dem Modell, oberflächliche Lösungen zu vermeiden und die Fähigkeit zu verbessern, subtile oder unterrepräsentierte Emotionen zu unterscheiden.

Das Modell auf dem Prüfstand

Die Autorinnen und Autoren bewerten ihr System anhand von sechs weit verbreiteten Datensätzen, darunter Twitter‑Beiträge, Restaurant‑ und Laptop‑Rezensionen sowie ein fünfstufiger Filmrezensions‑Benchmark, der sehr positive und sehr negative Meinungen von moderateren unterscheidet. Über diese verschiedenen Quellen hinweg übertrifft der neue Ansatz konstant mehrere fortgeschrittene graph‑ und transformerbasierte Konkurrenten sowohl in Genauigkeit als auch im F1‑Score, einem Maß, das richtige Treffer und verpasste Fälle ausbalanciert. Die Gewinne sind besonders stark bei der fünfklassigen Filmrezensionsaufgabe und bei unterrepräsentierten Sentimentklassen, was zeigt, dass die Methode sowohl fein abgestimmte Emotionen als auch schiefe Daten bewältigen kann. Eine Ablationsstudie, bei der Komponenten einzeln entfernt werden, bestätigt, dass ALBERT, das kombinierte GRU–LSTM‑Design, Attention und die elch‑inspirierte Optimierung jeweils zur Gesamtleistung beitragen.

Was das für Alltagsszenarien bedeutet

Für Nicht‑Spezialistinnen und -Spezialisten ist die wichtigste Erkenntnis, dass diese Forschung einen effizienteren und verlässlicheren Weg bietet, große Mengen an Online‑Meinungen zu interpretieren. Durch die Mischung eines kompakten Sprachmodells mit komplementären Gedächtnisschichten und einem biologisch inspirierten Feinabstimmungsschritt liest das System genauer zwischen den Zeilen, insbesondere wenn Sentiments subtil sind oder die Daten verzerrt. Das macht es vielversprechend für reale Anwendungen wie das Tracking von Kundenzufriedenheit, die Überwachung von Einstellungen zur öffentlichen Gesundheit oder die Einschätzung von Reaktionen auf Politiken und Ereignisse, bei denen sowohl Präzision als auch Rechenkosten eine Rolle spielen.

Zitation: Oqaibi, H., Sharma, S. A deep sentiment model combining ALBERT-driven context and EHO-optimized architecture. Sci Rep 16, 5784 (2026). https://doi.org/10.1038/s41598-026-36389-2

Schlüsselwörter: Sentiment-Analyse, ALBERT, Deep Learning, Textklassifikation, metaheuristische Optimierung