Clear Sky Science · de

Ausnutzung von Themenanalyse-Modellen zur Erforschung psychologischer Dimensionen in Social-Media-Daten

Warum unsere Online-Worte wichtig sind

Millionen von Menschen sprechen täglich in sozialen Medien über ihre Gefühle, oft offener als im persönlichen Gespräch. Eingebettet in dieses Meer alltäglicher Kommentare liegen wertvolle Hinweise auf psychische Gesundheit, einschließlich Anzeichen von Depression oder Selbstverletzung. Diese Studie stellt eine einfache, aber folgenreiche Frage: Kann moderne künstliche Intelligenz das laute Online-Geraune durchforsten, sinnvolle Themen finden und Fachkräften helfen, psychologische Risiken besser zu verstehen — ohne jeden Beitrag einzeln zu lesen?

Chaos in Themen verwandeln

Die Forschenden konzentrierten sich auf eine große Sammlung von Reddit-Beiträgen aus der eRisk-Initiative, die Personen umfasst, die angaben, mit Depression diagnostiziert worden zu sein, sowie eine Kontrollgruppe ohne bekannte Diagnosen. Ihr Ziel war nicht, Einzelpersonen zu diagnostizieren, sondern zu prüfen, ob Themenanalyse — Techniken, die Texte nach gemeinsamen Themen gruppieren — Muster offenbaren kann, die für die psychische Gesundheit relevant sind. Da die Sprache in sozialen Medien unordentlich ist, voller Slang, Tippfehler und abrupten Themenwechseln, stellt sie einen realistischen, aber sehr anspruchsvollen Test für diese Methoden dar.

Drei Wege, herauszufinden, worüber Menschen sprechen

Die Studie verglich drei verschiedene Familien von Themenmodellen. Das erste, Latent Dirichlet Allocation (LDA), ist eine klassische Methode, die betrachtet, wie häufig Wörter gemeinsam in Dokumenten vorkommen. Das zweite, BERTopic, nutzt leistungsfähige moderne Sprachmodelle, um jeden Beitrag in eine dichte numerische Repräsentation zu überführen, gruppiert dann ähnliche Beiträge und extrahiert Schlüsselwörter für jede Gruppe. Das dritte, TopClus, stützt sich ebenfalls auf neuronale Netze und kombiniert Aufmerksamkeitsmechanismen mit Clustering in einem gemeinsamen mathematischen Raum. Alle drei wurden mit Standard-Einstellungen ausgeführt, um jeweils 50 Themen zu erzeugen — was dem entspricht, wie viele Forschende sie direkt „out-of-the-box“ verwenden würden.

Menschen fragen, nicht nur Formeln

Um zu beurteilen, welche Themen wirklich bedeutsam waren, verließ sich das Team nicht allein auf automatische Kennzahlen. Sechs geschulte Annotatoren prüften 150 Themen, jeweils dargestellt durch ihre Top-Wörter und einige zentrale Beiträge. Für jedes Thema bewerteten sie, wie kohärent die Wortliste war, wie kohärent die Beispielbeiträge waren und ob Wörter und Beiträge zueinander passten. Sie versuchten außerdem, jedem Thema wenn möglich einen kurzen, intuitiven Namen zu geben. Dieser menschenzentrierte Ansatz förderte eine wichtige Erkenntnis zutage: Numerische „Kohärenz“-Metriken, die in der Forschung beliebt sind, stimmten bei unordentlicher Social-Media-Sprache oft nicht mit menschlichem Urteil überein.

Der eindeutige Sieger und was er offenbarte

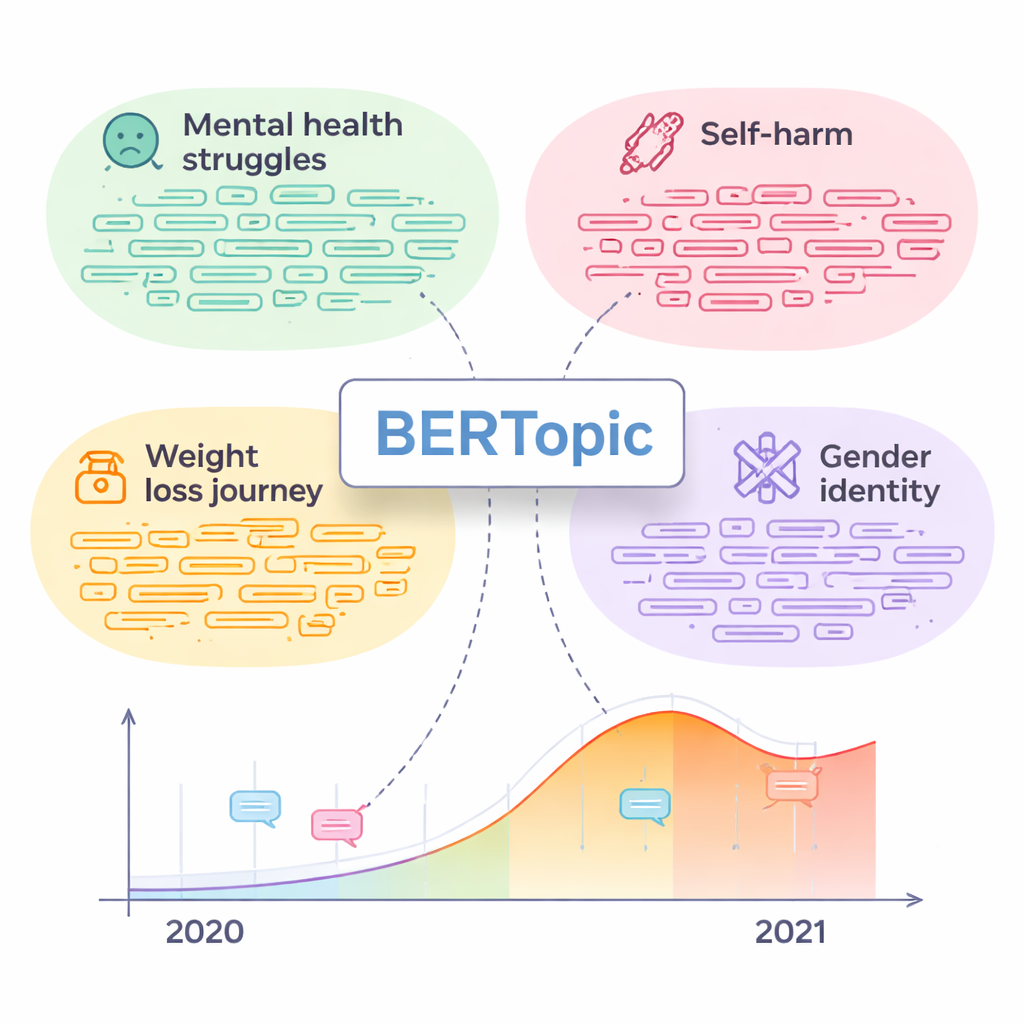

Bei allen menschlichen Bewertungen erwies sich BERTopic deutlich als Erzeuger der verständlichsten und spezifischsten Themen. Annotatoren konnten seine Themen deutlich häufiger benennen als die der anderen Modelle, und ihre Übereinstimmung untereinander war auf einem soliden, moderaten Niveau. LDA hingegen gruppierte oft unzusammenhängende Wörter und Beiträge, die für die Prüfer fast zufällig wirkten. Nachdem die besten Themen ausgewählt waren, gingen die Forschenden der Frage nach, worüber die Menschen tatsächlich sprachen. Einige Themen, wie „Psychische Gesundheitsprobleme“ und „Selbstverletzung“, standen in starkem Zusammenhang mit Nutzerinnen und Nutzern mit Depression und enthielten viele Beiträge, die Leid ausdrückten. Andere waren weniger offensichtlich klinisch — etwa „Gewichtsverlustreise“, „Geschlechtsidentität“, „Sexuelle Träume“ und „soziales Trinkverhalten“ — zeigten sich jedoch als Heimat eines hohen Anteils von Beiträgen von depressiven Nutzern und vieler Anzeichen emotionaler Schmerzen. Eine einfache zeitliche Analyse zeigte, dass die Aktivität in einigen dieser sensiblen Themen während der COVID-19-Pandemie stark anstieg, was breitere Berichte über sich verschlechternde psychische Gesundheit widerspiegelt.

Von Online-Mustern zu Hilfe in der realen Welt

Um besser einzuschätzen, wie ernst manche dieser Beiträge sein könnten, verwendeten die Autorinnen und Autoren ein separates Sprachmodell, um die Inhalte grob auf Items eines bekannten Depressionsfragebogens (dem Beck-Depressions-Inventar) abzubilden. Dieser explorative Schritt deutete darauf hin, dass bestimmte Themen, besonders solche rund um psychische Probleme, Selbstverletzung, Körperbild und Geschlechtsidentität, häufig Sprache enthalten, die mit mäßigen bis schweren depressiven Symptomen assoziiert ist. Die Autorinnen und Autoren betonen, dass solche automatisierten Einschätzungen keine klinischen Diagnosen sind, aber sie können helfen, Bereiche hervorzuheben, in denen fachliche Aufmerksamkeit am dringendsten benötigt wird.

Was das für psychische Gesundheit und Technik bedeutet

Einfach gesagt zeigt die Studie, dass heutige fortschrittliche Themenmodelle, insbesondere BERTopic, chaotische Gespräche in sozialen Medien in klare Themen verwandeln können, die mit realen psychologischen Anliegen übereinstimmen. Sie zeigt auch, dass blindes Vertrauen in automatische Qualitätswerte riskant ist; menschliche Überprüfung bleibt unerlässlich, wenn das Ziel darin besteht, Entscheidungen im Bereich der psychischen Gesundheit zu unterstützen. Zukünftig könnten ähnliche Werkzeuge Klinikerinnen und Klinikern, öffentlichen Stellen und Forschenden helfen, breite Trends zu überwachen, aufkommende Risiken zu erkennen und bessere Präventionsmaßnahmen zu entwickeln — wobei die endgültige Bewertung und Versorgung weiterhin bei menschlichen Fachkräften liegen sollte.

Zitation: Couto, M., Parapar, J. & Losada, D.E. Exploiting topic analysis models to explore psychological dimensions in social media data. Sci Rep 16, 6047 (2026). https://doi.org/10.1038/s41598-026-36339-y

Schlüsselwörter: soziale Medien und Depression, Themenmodellierung, Muster psychischer Gesundheit, Online-Selbstverletzungssignale, Sprachmodelle in der Psychologie