Clear Sky Science · de

Hinweiserkennung in chinesischen und russischen diplomatischen Reden mithilfe großer Sprachmodelle

Zwischen den Zeilen lesen

Wenn Diplomaten öffentlich sprechen, kann das, was sie nicht aussprechen, genauso wichtig sein wie die gewählten Worte. Diese Studie untersucht, ob moderne künstliche Intelligenz subtile Hinweise und verschleierte Botschaften in den Pressekonferenzen der Außenministerien Chinas und Russlands erkennen kann — Signale, die menschlichen Zuhörern oft entgehen, die aber die internationalen Beziehungen beeinflussen können.

Warum Hinweise in der Weltpolitik wichtig sind

Diplomatische Sprache ist darauf angelegt, vorsichtig und höflich zu sein. Staaten müssen ihre Interessen verteidigen, ohne Gegner offen zu provozieren oder die Öffentlichkeit zu beunruhigen. Deshalb greifen Amtsträger häufig auf Hinweise zurück — Formulierungen, die auf den ersten Blick neutral klingen, aber still Kritik üben, warnen oder eine politische Haltung signalisieren. Fehldeutungen solcher Andeutungen haben in der Vergangenheit zu Krisen und Misstrauen zwischen Staaten beigetragen. Solche indirekten Botschaften zu verstehen ist besonders schwierig über Sprach- und Kulturgrenzen hinweg, wo gemeinsames Hintergrundwissen nicht vorausgesetzt werden kann.

Von klassischer Theorie zu intelligenten Maschinen

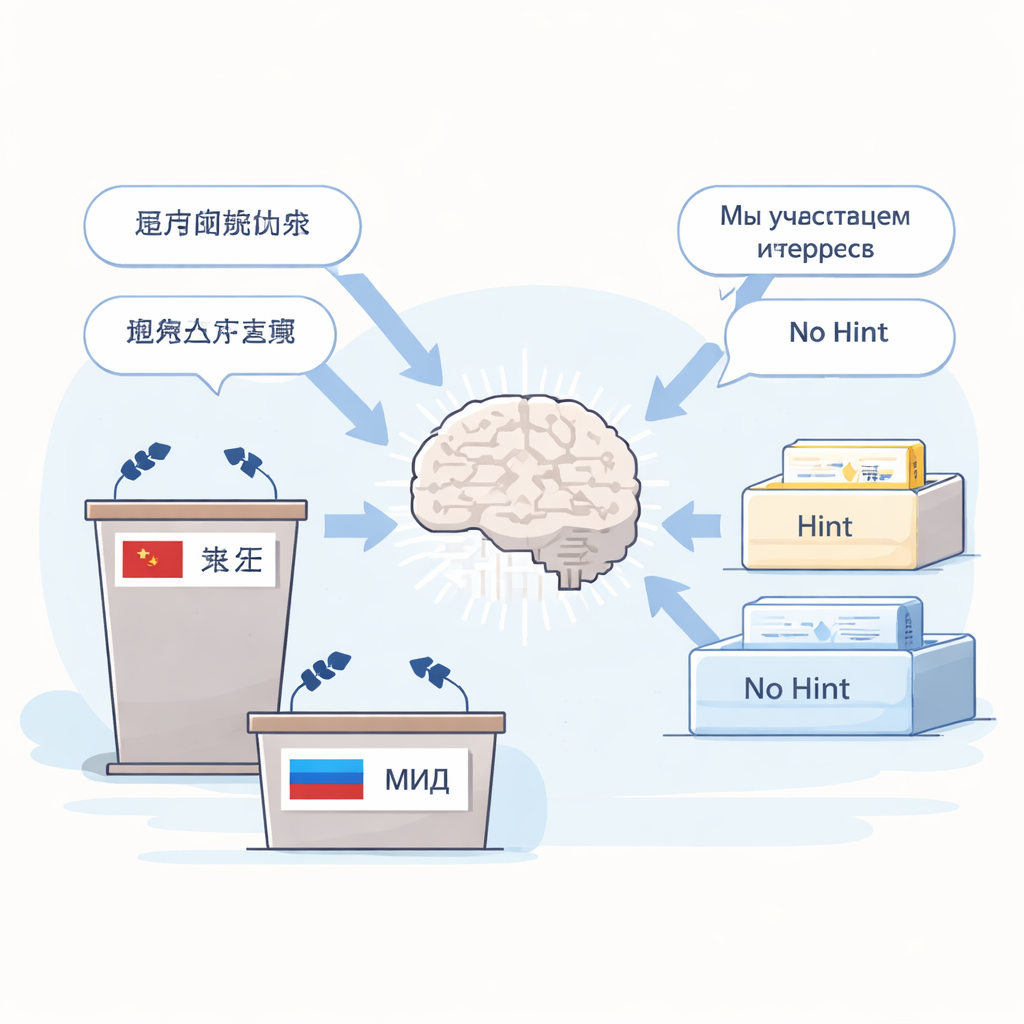

Jahrzehntelang haben Linguisten und Philosophen untersucht, wie Sprecher mehr andeuten, als sie buchstäblich sagen. Frühe Theorien fokussierten vor allem auf die Absichten des Sprechers und gingen davon aus, dass ein rationaler Hörer die versteckte Bedeutung rekonstruieren könne. Spätere Arbeiten in der „kognitiven Pragmatik“ betonten, dass das Verstehen von Hinweisen auch von den mentalen Prozessen des Hörers, seinem kulturellen Hintergrund und dem umgebenden Kontext abhängt. Aufbauend auf diesen Ideen beschreiben die Autorinnen und Autoren Hinweise als geschichtet: die sichtbare Wortwahl (verbal-semantische Ebene), die kulturell geprägten Denkweisen dahinter (linguistisch-kognitive Ebene) und die Motive und Strategien des Sprechers, etwa Kritik, Warnung oder Gesichtsrettung (motivational-pragmatische Ebene).

Wie das KI-System aufgebaut wurde

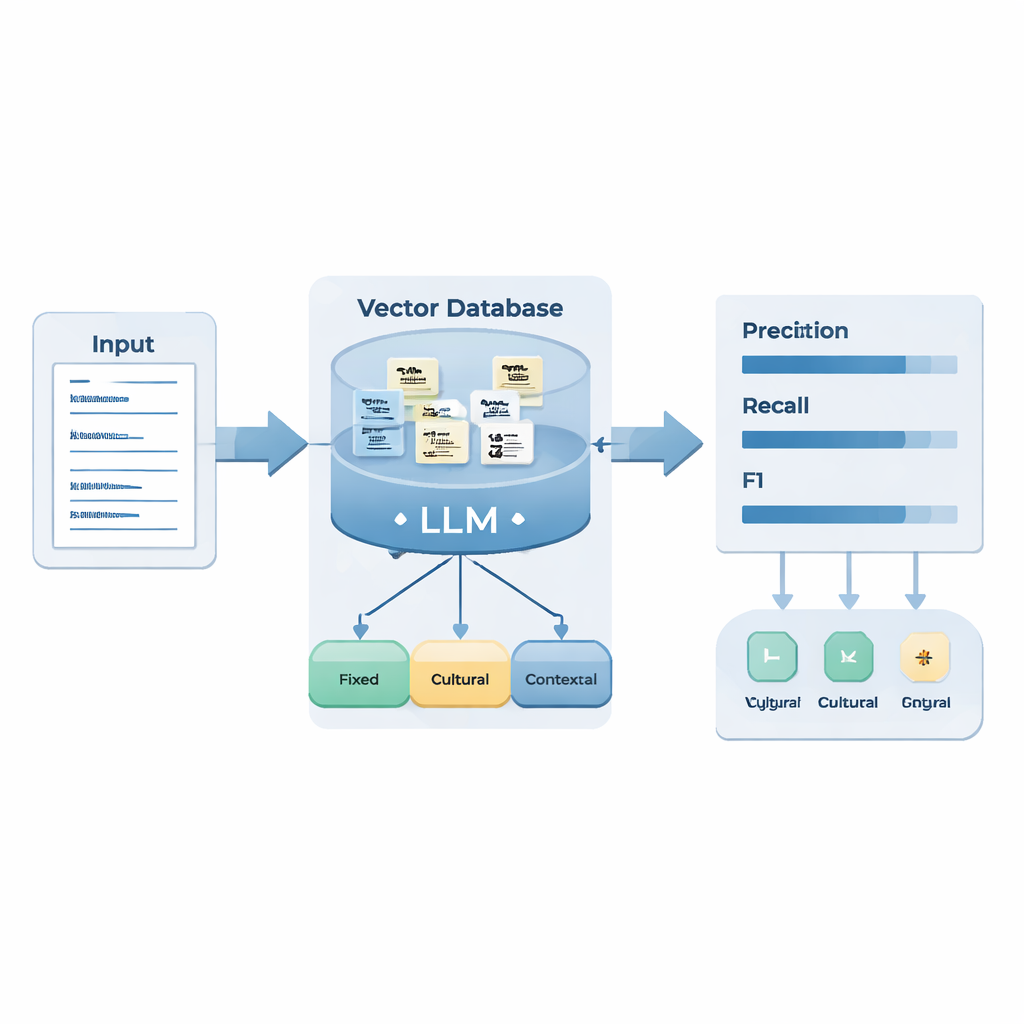

Die Forschenden sammelten fast 1.400 Frage–Antwort-Segmente aus offiziellen Pressekonferenzen der Außenministerien Chinas und Russlands im Jahr 2024. Expert:innen annotierten manuell 498 Fälle, in denen Sprecher andeuteten, statt klar zu sprechen. Sie ordneten diese in drei Typen: „stabile Hinweise“ mit festen, wiederkehrenden Formulierungen (etwa standardisierte diplomatische Floskeln), „kulturelle Hinweise“, deren Bedeutung auf gemeinsamem kulturellem Wissen und Metaphern beruht, und „kontextuelle Hinweise“, die nur durch genaue Betrachtung der unmittelbaren Situation und der Motive erkennbar sind. Diese Beispiele bildeten die Grundlage für eine externe Wissensdatenbank und die Gestaltung eines Satzes von Schlussfolgerungsregeln für ein großes Sprachmodell.

Dem Modell beibringen, in Schritten zu denken

Das Team kombinierte zwei KI-Techniken. Retrieval-Augmented Generation (RAG) erlaubt es dem Modell, beim Verarbeiten einer neuen Antwort relevante Beispiele aus der maßgeschneiderten Hinweisdatenbank abzurufen. Chain-of-Thought-(CoT-)Prompts zwingen das Modell anschließend, schrittweise zu argumentieren: Sprache identifizieren, die Antwort in Sätze gliedern, bekannte Hinweis‑Muster prüfen, entscheiden, ob ein Satz ein bestimmtes Motiv (etwa Kritik oder Warnung) durch eine erkannte Strategie (wie sachliche Aussage, Kontrast oder Ironie) ausdrückt, und ihn schließlich als stabilen, kulturellen, kontextuellen Hinweis oder „kein Hinweis“ kennzeichnen. Das System führt zudem eine Selbstprüfung durch, um sicherzustellen, dass die implizierte Bedeutung sich tatsächlich von der wörtlichen Aussage unterscheidet.

Wie gut hat es funktioniert?

Zum Testen nutzten die Autor:innen neue Pressekonferenzdaten aus 2025 in beiden Sprachen. Insgesamt lieferte das erweiterte Modell eine überzeugende Leistung bei der Erkennung versteckter Botschaften: Es erfasste die meisten echten Hinweise (hohe Rückrufrate) und erreichte ein ausgewogenes Verhältnis zwischen Erfassen und Überinterpretation (F1‑Wert 0,83 für Russisch und 0,76 für Chinesisch). Besonders stark war es bei stabilen Hinweisen in beiden Sprachen, was die Annahme stützt, dass feste Muster Maschinen am leichtesten zu lernen sind. Schwieriger tat es sich hingegen mit chinesischen kulturellen und kontextuellen Hinweisen als mit russischen. Die Autor:innen führen diese Lücke auf Stilunterschiede zurück: Russische diplomatische Rede nutze oft lebhafte Metaphern und scharfe Kontraste, die Kritik oder Warnung deutlich signalisieren, während die chinesische Sprache stärker auf neutrale Formeln, Idiome und kontextabhängige Höflichkeit setze, die schwerer von wörtlichen Aussagen zu unterscheiden sind.

Was die Fehler offenbaren — und wie man sie verbessern kann

Bei genauer Betrachtung der Fehler fanden die Forschenden drei wiederkehrende Probleme. Manchmal «überlas» das Modell den Text und erfand versteckte Bedeutungen, wo keine waren. Manchmal erkannte es einen Hinweis, ordnete ihn aber falsch zu und verwischte so die Grenze zwischen stabilen und kontextuellen Fällen. Und manchmal behandelte es unmissverständliche Formulierungen als Hinweis, weil bestimmte sensible Wörter oder vertraute Muster vorhanden waren. Um diese Schwächen zu beheben, schlägt die Arbeit vor, viele eindeutige „kein‑Hinweis“-diplomatische Phrasen als negative Beispiele hinzuzufügen, das System dazu zu zwingen, seine Schlussfolgerungen stärker an die tatsächliche Frage und den umgebenden Kontext zu binden, Sätze mehrfach mit Umschreibungen gegen die Wissensbasis abzugleichen und einen Vorfilter sowie eine Selbstevaluationsstufe einzufügen, die fragt: Ist das bereits explizit oder wirklich implizit?

Warum das für uns alle wichtig ist

Für Nichtfachleute lautet die Kernbotschaft: Große Sprachmodelle können Analystinnen und Analysten bereits dabei helfen, große Mengen offizieller Erklärungen zu sichten und Stellen zu markieren, an denen Regierungen zwischen den Zeilen sprechen könnten. Zugleich macht die Studie deutlich, wie stark Diplomatie von Kultur, Geschichte und Stil abhängt — Faktoren, die selbst für fortgeschrittene KI eine Herausforderung bleiben. Durch die Verbindung linguistischer Theorie mit modernen KI‑Werkzeugen weist diese Arbeit den Weg zu zuverlässigeren Systemen zur Verfolgung subtiler Signale in der internationalen Politik, betont aber zugleich, dass menschliches Urteilsvermögen und kulturspezifische Expertise weiterhin unerlässlich sind, um das Ungesagte zu interpretieren.

Zitation: Guo, Y., Wang, X. Hint recognition in Chinese and Russian diplomatic discourse using large language models. Sci Rep 16, 5751 (2026). https://doi.org/10.1038/s41598-026-36338-z

Schlüsselwörter: diplomatische Sprache, implizite Bedeutung, große Sprachmodelle, linguistische Quersprachanalyse, retrieval-augmented generation