Clear Sky Science · de

Ein hybrider Lernrahmen, der chaotische Niche-Alpha-Evolution zur Vorhersage studentischer Leistungen integriert

Warum es wichtig ist, Noten frühzeitig vorherzusagen

Schulen sitzen zunehmend auf einem Datenschatz über ihre Schüler — von Anwesenheitslisten und Hausaufgabenpunkten bis hin zu Umfrageantworten über häusliche Verhältnisse und Lerngewohnheiten. Dieser Artikel untersucht, wie sich diese Rohdaten in Frühwarnungen umwandeln lassen, die anzeigen, wer in einem Kurs Schwierigkeiten haben oder herausragen könnte. Die Autoren stellen einen neuen Rechenrahmen vor, der die Endnoten von Sekundarschülern genauer vorhersagt und so früher und gezielter Unterstützung ermöglicht statt verzweifelter Nachhilfemaßnahmen in letzter Minute.

Von Zeugnissen zu reichen Datenpfaden

Moderne Klassenzimmer erzeugen weit mehr als nur ein paar Prüfungsnoten. Der in dieser Studie verwendete Datensatz umfasst 480 Schüler und 32 verschiedene Informationen pro Schüler: Alter, familiärer Hintergrund, Pendelzeit, Internetzugang, Lernzeit, Fehltage und drei getrennte Leistungsnoten im Verlauf des Schuljahres. Zusammen zeichnen diese Details eine Lernbiografie nach — wie Einsatz, Umstände und vorhergehende Ergebnisse sich zu einer Endnote summieren. Gleichzeitig macht dieser Reichtum die Vorhersage schwieriger: Die Daten sind laut, uneinheitlich und von Schüler zu Schüler sehr verschieden.

Eine klügere Art, Lernen über die Zeit zu lesen

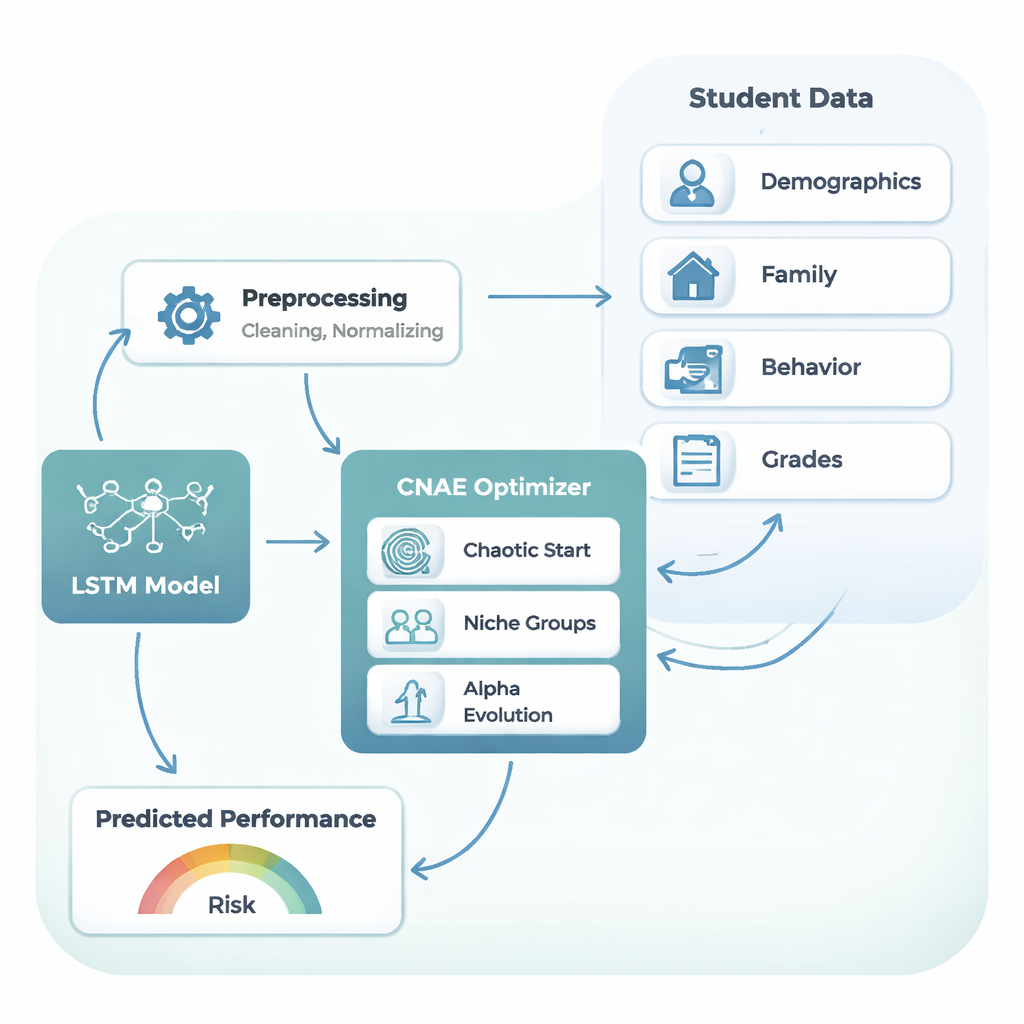

Um diese Lernverläufe abzubilden, nutzen die Autoren eine Art neuronales Netz namens Long Short-Term Memory, kurz LSTM. Statt jede Information als isolierte Tatsache zu behandeln, ist ein LSTM darauf ausgelegt, nützliche Signale aus früheren Zeitpunkten einer Sequenz zu behalten — ähnlich einem Lehrer, der sich an stetige Verbesserungen oder schleichende Entkopplung erinnert, statt nur das letzte Quiz zu betrachten. In dieser Studie erhält das LSTM die Mischung aus Hintergrundfaktoren, Verhalten und früheren Noten und liefert eine Prognose der Abschlussprüfung auf einer Skala von 0–20. LSTMs sind jedoch empfindlich: Ihre Leistung hängt stark von Designentscheidungen ab, etwa wie viele Schichten und Einheiten pro Schicht sie haben, wie schnell sie lernen, wie viel Regularisierung eingesetzt wird und wie viele Schülerdatensätze jeweils beim Training verwendet werden.

Evolution den besten Modellentwurf suchen lassen

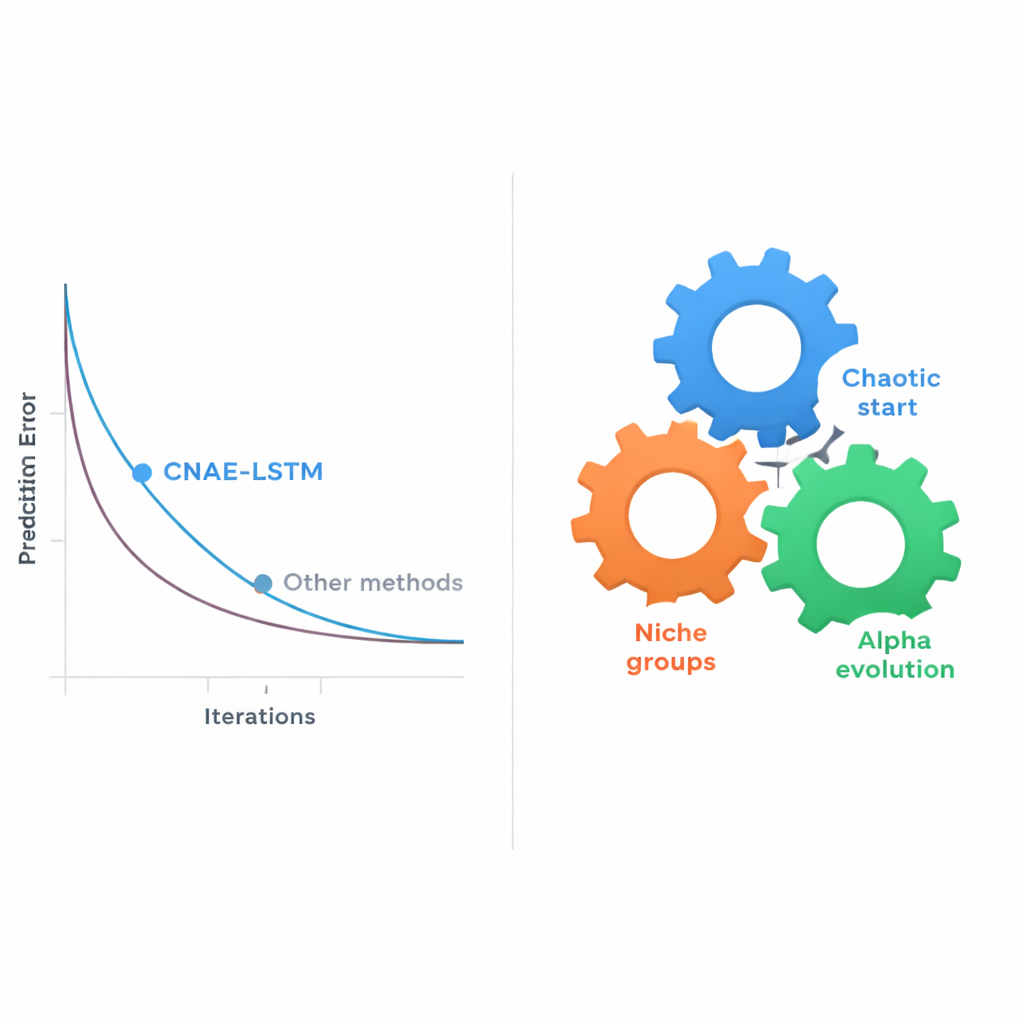

Diese Designparameter händisch zu wählen — oder mit einfachen Gitter- oder Trial‑and‑Error‑Suchen — wird schnell unpraktisch, weil die Kombinationen explodieren. Der Kern dieses Papiers ist eine neue automatische Suchstrategie namens Chaotic Niche Alpha Evolution (CNAE), die die Autoren mit dem LSTM koppeln und so das CNAE‑LSTM-Framework bilden. CNAE beginnt damit, eine große Vielfalt an Kandidaten‑LSTM‑Entwürfen mittels eines mathematischen, von Chaos inspirierten Prozesses zu erzeugen, wodurch die Anfangsoptionen weit über den Suchraum verteilt sind. Anschließend gruppiert es ähnliche Kandidaten in „Nischen“, behält aus jedem Cluster nur das stärkste Exemplar und mutiert diese leicht, um angrenzende Möglichkeiten zu erkunden. Abschließend schiebt ein „Alpha‑Evolution“-Schritt die Suche in die vielversprechendsten Regionen und verlagert das Vorgehen allmählich von breiter Exploration zu Feineinstellung. Jeder Kandidat wird daran gemessen, wie gut er Noten auf einem zurückbehaltenen Validierungsset vorhersagt; die besten Entwürfe überleben und prägen die nächste Generation.

Was die Experimente zeigen

Die Forscher testeten ihren Ansatz am realen Sekundarschuldatenbestand und verglichen CNAE‑LSTM mit einer Reihe von Alternativen: einer Support‑Vector‑Machine (ein klassisches Machine‑Learning‑Verfahren), zwei Deep‑Learning‑Modellen (einem Faltungsnetz und einem Transformer), einem standardmäßig manuell getunten LSTM sowie mehreren LSTMs, deren Einstellungen von bekannten evolutionären Suchverfahren oder durch Grid‑ und Random‑Search bestimmt wurden. Gemessen wurde, wie nah die prognostizierten Noten an den tatsächlichen lagen und wie viel der Varianz der Noten das Modell erklären konnte. CNAE‑LSTM lag in allen Maßen vorn: Es erreichte den geringsten durchschnittlichen Vorhersagefehler und die höchste Fähigkeit, Unterschiede zwischen Schülern zu erklären, und verbesserte den Fehler um mehr als 10 Prozent gegenüber der stärksten vorhandenen evolutionären Basislinie. Die Wiederholung der Experimente 30 Mal zeigte, dass CNAE‑LSTM nicht nur genauer, sondern auch stabiler war — die Ergebnisse schwankten weniger von Lauf zu Lauf.

Warum das für Schüler und Schulen wichtig ist

Für eine allgemeine Leserschaft ist die Quintessenz einfach: Indem ein evolutionäres Suchverfahren das prädiktive Modell entwirft, können Schulen zuverlässigere Vorhersagen darüber erhalten, wie Schüler einen Kurs abschließen, lange bevor die Abschlussprüfung stattfindet. Das CNAE‑LSTM‑Framework verwandelt unordentliche, realweltliche Bildungsdaten in ein klareres Bild davon, wer auf gutem Kurs ist und wer zusätzliche Unterstützung benötigen könnte, und nutzt dabei Rechenressourcen effizient genug, um praktikabel zu sein. Obwohl die aktuelle Studie sich auf einen einzelnen Sekundarschuldatenbestand konzentriert, ließe sich derselbe Ansatz auf andere Fächer und Schulstufen übertragen. In Verbindung mit durchdachten, menschlich orientierten Interventionen könnten solche Vorhersagewerkzeuge Lehrkräfte von reaktiven Maßnahmen hin zu präventiven Strategien führen.

Zitation: Chen, H., Zhou, Y. & Cao, Q. A hybrid learning framework integrating chaotic Niche alpha evolution for student academic performance prediction. Sci Rep 16, 5302 (2026). https://doi.org/10.1038/s41598-026-36263-1

Schlüsselwörter: Vorhersage von Schülerleistungen, Educational Data Mining, LSTM, evolutionäre Optimierung, Frühwarnsysteme