Clear Sky Science · de

Hierarchische NBV-Entscheidung auf Basis gegenseitiger Information für aktives semantisches visuelles SLAM in dynamischen Umgebungen

Roboter, die vorausdenken können

Wenn Roboter Fabriken verlassen und in Wohnungen, Krankenhäuser und Büros vordringen, müssen sie sich in Räumen bewegen, die von Menschen und anderen sich bewegenden Objekten geprägt sind. Dieses Papier stellt eine neue Methode vor, mit der ein Roboter „vorausdenken“ kann, wo er hinschauen und wie er sich bewegen sollte, um eine zuverlässige Karte seiner Umgebung zu erstellen — selbst wenn diese Umgebung nicht stillhält. Die Arbeit ist relevant für alle, die an sichereren Servicerobotern, intelligenteren Lieferrobotern oder künftigen Haushaltsassistenten interessiert sind, die sich den Raum mit Menschen teilen müssen statt leere Korridore zu befahren.

Warum bewegte Menschen Roboter verwirren

Viele Roboter nutzen zur autonomen Fortbewegung visuelles SLAM, bei dem eine Kamera gleichzeitig eine Karte erstellt und die eigene Position schätzt. Das funktioniert gut in statischen Umgebungen, bricht jedoch schnell zusammen, wenn Menschen vorbeigehen, die Sicht blockieren oder Gegenstände tragen. Eine gängige Lösung ist semantische Wahrnehmung, sodass der Roboter Personen, Autos und Stühle erkennen und beim Kartieren ignorieren kann. Das schafft jedoch ein neues Problem für aktive Roboter, die ihre eigenen Wege wählen: Wenn sie zu viele visuelle Hinweise verwerfen, verlieren sie möglicherweise ganz die Orientierung. Das begrenzte Sichtfeld der Kamera verschärft das Problem noch, denn eine einzelne Person in unmittelbarer Nähe kann den Großteil der nützlichen Szenerie vor den Augen des Roboters verbergen.

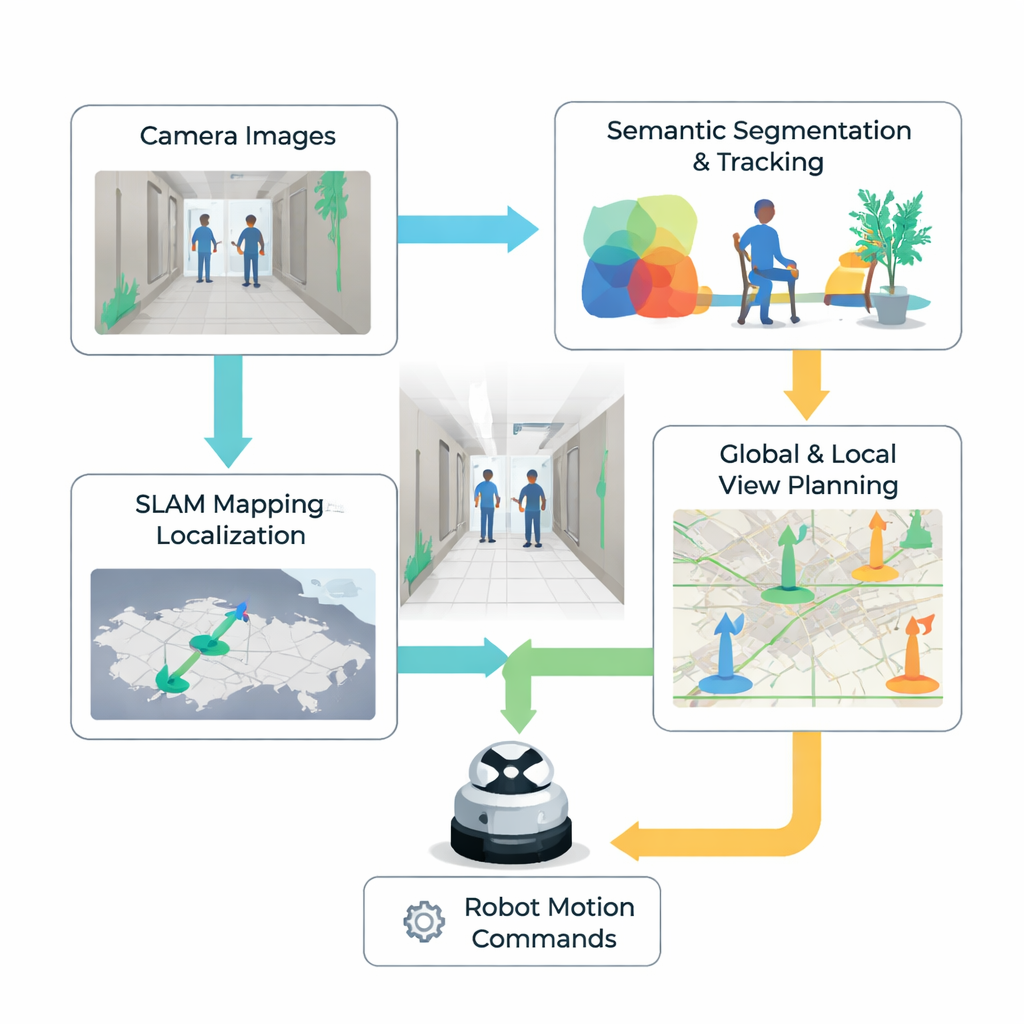

Eine zweistufige Strategie, um die nächste Blickrichtung zu wählen

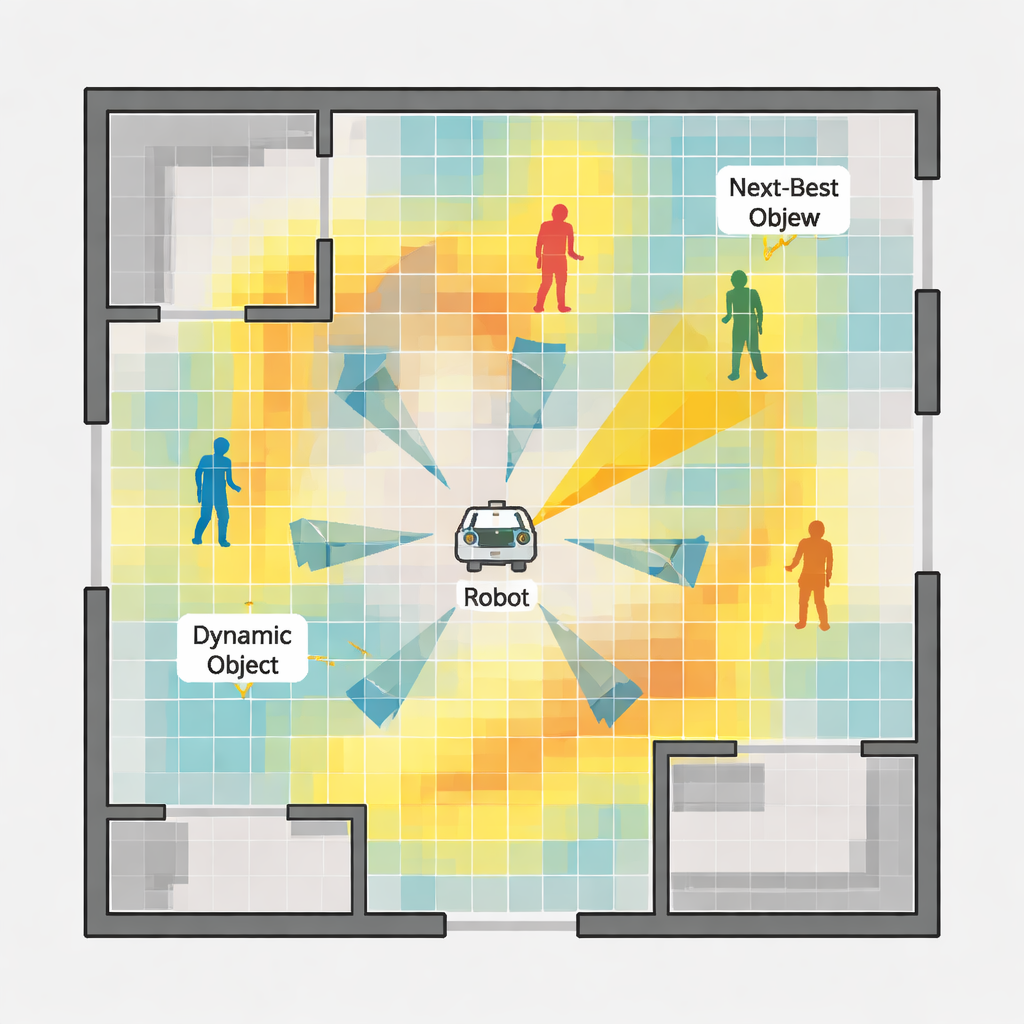

Die Autoren schlagen ein hierarchisches Entscheidungssystem vor, das dem Roboter hilft, seine nächsten Blickpunkte besser informiert auszuwählen. Auf der höheren Ebene führt der Roboter eine Draufsicht-Gitterkarte über freie, belegte und unbekannte Bereiche. Er bewertet mögliche entfernte Blickpositionen, indem er abschätzt, wie stark jede einzelne die Unsicherheit in dieser Karte reduzieren würde — ein Konzept aus der Informationstheorie. Bevorzugt werden Orte, die große unerforschte Regionen sichtbar machen, wobei auch die zurückzulegende Strecke und die erforderliche Kameradrehung berücksichtigt werden. Hat der Roboter ein vielversprechendes Gebiet bestimmt, übernimmt ein Prozess auf niedrigerer Ebene die Feinsteuerung: Er entscheidet genau, wie sich der Roboter in dieser Nachbarschaft bewegen und ausrichten sollte, damit er mit seinem schmalen Kamerablick ausreichend nützliche Details sehen kann.

Stabiles sehen und Beweglichem ausweichen

Kern des lokalen Entscheidungsprozesses ist eine „Merkmalswahrscheinlichkeitskarte“, die aus jedem Kamerabild aufgebaut wird. Zunächst detektiert das System visuelle Landmarken — Ecken und Muster in der Szene —, die voraussichtlich stabil bleiben und für die Bewegungsverfolgung hilfreich sind. Anschließend nutzt es einen modernen Objektdetektor, um potenziell bewegliche Objekte wie Personen zu finden und über mehrere Bilder hinweg zu verfolgen. Durch die Analyse der Objektbewegungen schätzt das System nicht nur ihren aktuellen Ort, sondern auch, wo sie in naher Zukunft wahrscheinlich sein werden. Diese beiden Informationsquellen werden zu einer Wärmebildkarte über das Bild verschmolzen: Helle Regionen zeigen eine hohe Wahrscheinlichkeit für zuverlässige Landmarken an, dunklere Bereiche kennzeichnen stellenweise merkmalsarmut oder Stellen, die wahrscheinlich von beweglichen Objekten verdeckt werden. Der Roboter nutzt diese Karte, um abzuwägen, welche kleine Bewegung — nach links drehen, nach rechts drehen oder vorwärts fahren — ihm als Nächstes die klarste und stabilste Sicht verschafft.

Tests in virtuellen Welten und der realen Umgebung

Die Forschenden erprobten ihren Ansatz in zwei simulierten Innenräumen unterschiedlicher Größe und Komplexität, die jeweils mit umherwandernden virtuellen Fußgängern bevölkert waren, und anschließend an einem realen Roboter, der durch eine echte Innenumgebung fuhr. Sie verglichen ihre Methode mit mehreren etablierten Erkundungsstrategien, die hauptsächlich darauf abzielen, Fläche abzudecken oder die Reisestrecke zu minimieren. In den Simulationen erzeugte das neue System Karten mit weniger Verzerrungen und erreichte bessere Positionsgenauigkeit, während es in etwa gleicher oder geringerer Zeit erkundete. Außerdem verlor es seltener die eigene Position und geriet seltener unangenehm nah an bewegte Personen. Im Realweltversuch lief die Methode in Echtzeit auf einem handelsüblichen Robotercomputer, was bestätigt, dass sie sich praktisch außerhalb des Labors einsetzen lässt.

Was das für Alltagsroboter bedeutet

Einfach gesagt lehrt diese Arbeit einen Roboter, gezielt auszuwählen, wohin er schaut und wohin er geht, wenn Menschen in der Nähe sind. Durch die Kombination aus Szenenverständnis, Bewegungsprognose und einer Messgröße für Informationsgewinn kann sich der Roboter zu Ansichten steuern, die sowohl informativ als auch sicher sind, anstatt einfach zum nächsten unerforschten Winkel zu marschieren. Das macht seine interne Karte verlässlicher und seine Bewegungen vorhersehbarer — wesentliche Eigenschaften für Roboter, die sich mit Menschen in überfüllten Räumen bewegen müssen. Es bleiben Herausforderungen, etwa plötzliche große Menschenmengen, die die Kamera blockieren, doch der Ansatz ist ein Schritt in Richtung Haushalts- und Servicerobotern, die mit der unordentlichen, dynamischen Natur des wirklichen Lebens gut zurechtkommen.

Zitation: Yang, Z., Sang, A.W.Y., Muthugala, M.A.V.J. et al. Mutual information-based hierarchical NBV decision for active semantic visual SLAM under dynamic environments. Sci Rep 16, 5847 (2026). https://doi.org/10.1038/s41598-026-36259-x

Schlüsselwörter: aktives SLAM, Roboter-Navigation, dynamische Umgebungen, semantische Kartierung, nächste beste Ansicht