Clear Sky Science · de

Kreuz‑Stufen-Kanten‑Informations‑Fusionsnetzwerk für die Erkennung kleiner Objekte in Luftbildern

Warum das Erkennen winziger Details aus der Luft wichtig ist

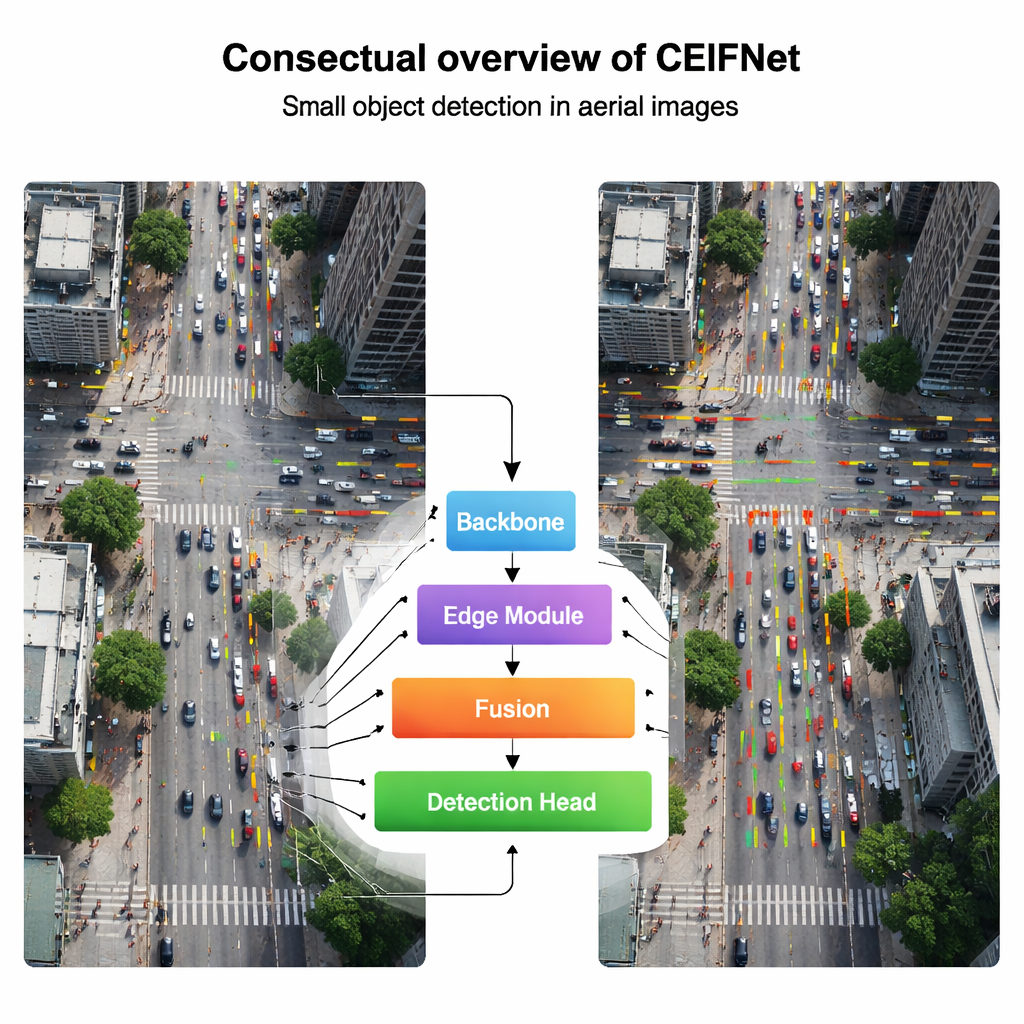

Von Verkehrsüberwachung und Katastrophenhilfe bis hin zur Pflanzenpflege – immer mehr Bereiche unserer Welt werden von oben durch Drohnen beobachtet. Viele der für uns wichtigsten Objekte in diesen Luftbildern – Personen, Autos oder Tiere – erscheinen jedoch nur als wenige Pixel breit. Diese Arbeit stellt ein neues Computer‑Vision‑System vor, CEIFNet, das speziell dafür entwickelt wurde, diese winzigen Objekte genauer und schneller zu finden, selbst wenn sie in unübersichtlichen Straßenszenen, auf Feldern oder in nächtlichem Bildrauschen eingebettet sind.

Kleine Dinge in einem großen Bild sehen

Gängige Objekterkennungssysteme wurden hauptsächlich für bodennahe Fotos entwickelt, bei denen ein Auto oder eine Person normalerweise einen merklichen Teil des Bildes ausfüllt. In Drohnenbildern hingegen kann die Kamera Hunderte Meter hoch sein, sodass jedes Ziel winzig ist und beim Schrumpfen innerhalb eines neuronalen Netzes leicht unscharf wird oder verloren geht. Die Autoren erklären, dass populäre Ein-Schuss‑Detektoren wie die YOLO‑Familie zwar in Alltagszenen gut funktionieren, aber Probleme haben, wenn Objekte sowohl sehr klein als auch stark unterschiedlich in der Größe sind. Wiederholte Downsampling‑Operationen, die das gesamte Szenenverständnis fördern sollen, neigen dazu, die schwachen Signale dieser kleinen Ziele zu löschen.

Kombination aus Nahsicht und großem Kontext

Um dem zu begegnen, verbindet CEIFNet zwei sich ergänzende Sichtweisen. Ein Pfad nutzt klassische Faltungsfilter, die gut darin sind, scharfe lokale Muster wie Ecken und Texturen zu erfassen. Der andere Pfad setzt auf einen Transformer‑ähnlichen Aufmerksamkeitsmechanismus, der darin brilliert, weit entfernte Bildteile zueinander in Beziehung zu setzen und die Szene insgesamt zu verstehen. Innerhalb des Kernbausteins, genannt cross‑stage transformer block, werden die eingehenden Merkmale aufgeteilt: die meisten Kanäle durchlaufen einen leichten Faltungsweg, während ein kleinerer Anteil einen Aufmerksamkeitsweg passiert, der über langfristige Beziehungen nachdenkt. Anschließend werden diese wieder zusammengeführt, sodass das Netzwerk sowohl feine Details als auch globales Bewusstsein erhält, ohne die Rechenkosten explodieren zu lassen.

Kanten als Karte für winzige Ziele nutzen

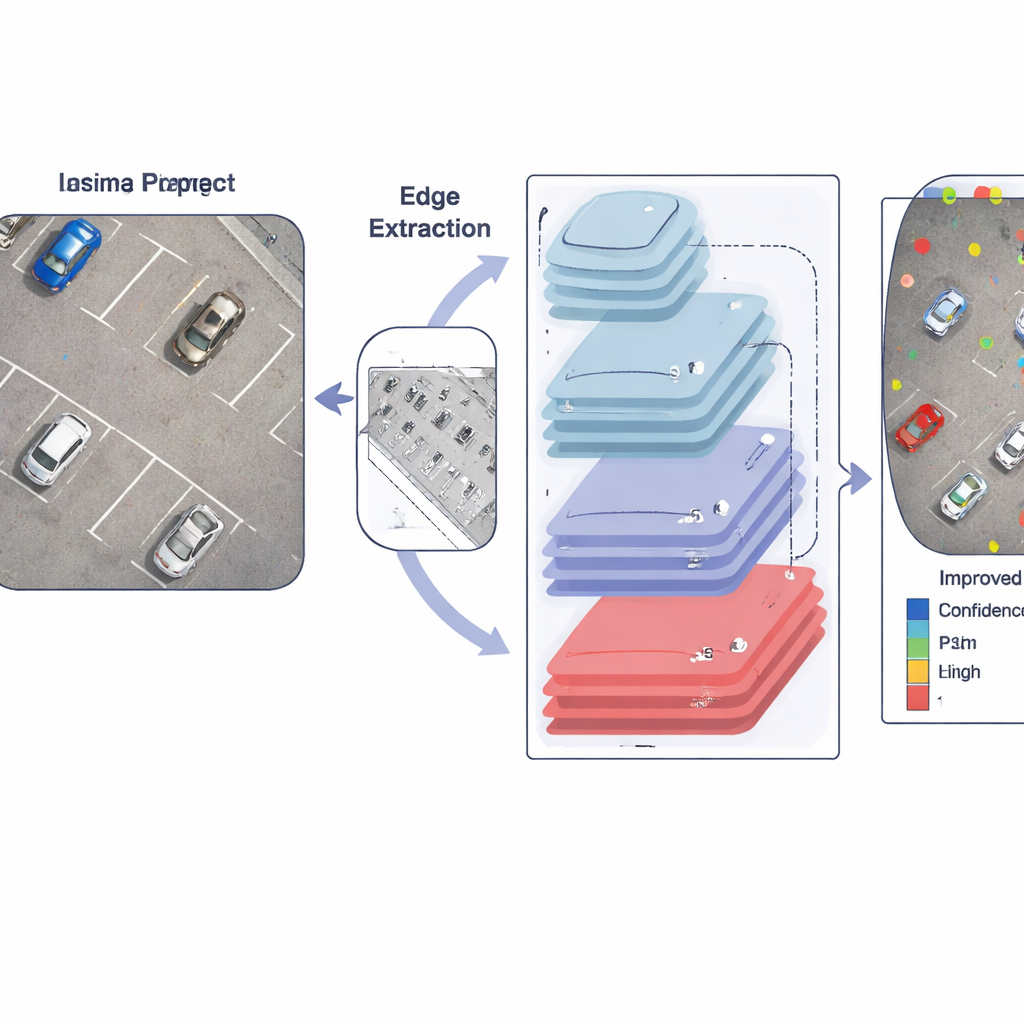

Eine zentrale Erkenntnis der Arbeit ist, dass Objektgrenzen – Kanten – besonders wertvoll sind, wenn Ziele nur wenige Pixel groß sind. Anstatt sich ausschließlich auf erlernte Filter zu verlassen, injizieren die Autoren bewusst Kantendaten in das Netzwerk. Ein dediziertes Modul wendet zunächst einen Sobel‑Operator an, einen einfachen, aber robusten Kantendetektor, um Bereiche hervorzuheben, in denen sich die Helligkeit scharf ändert, etwa an den Umrissen von Autos oder Personen. Diese Kantenkarten werden dann in mehrere Größen gepoolt, um zu verschiedenen Merkmals‑Skalen zu passen, und über ein Cross‑Channel‑Modul zusammengeführt. Während das Bild tiefer ins Netzwerk fließt, werden diese geschärften Kantensignale wiederholt in spätere Schichten eingespeist, wodurch das Modell trotz üblicher Unschärfe und Verkleinerung besser nachverfolgen kann, wo kleine Objekte beginnen und enden.

Anpassung an Größe, Position und Szenenkomplexität

Am Ausgang nutzt CEIFNet einen dynamischen Erkennungs‑Head, der sein Verhalten an das jeweils Gesehene anpassen kann. Anstatt feste Filter einzusetzen, wendet diese abschließende Stufe drei Formen von Aufmerksamkeit gleichzeitig an: sie kann bestimmte Objektgrößen bevorzugen, sich auf vielversprechende Orte im Bild konzentrieren und die informativsten Merkmalskanäle hervorheben. Zusammen mit einer Feature‑Pyramiden‑Struktur, die eine zusätzliche feinkörnige Ebene bewahrt, macht dies das System reaktionsfähiger gegenüber winzigen, dicht gepackten Zielen in realistischen Drohnenaufnahmen – von überfüllten Kreuzungen über belebte Parkplätze bis hin zu thermischen Infrarotaufnahmen bei Nacht.

Die Leistungssteigerung in echten Drohnenszenarien belegen

Die Forschenden testeten CEIFNet auf zwei anspruchsvollen Drohnen‑Datensätzen: VisDrone2019, bestehend aus städtischen und vorstädtischen Tagesszenen, und HIT‑UAV, einer thermischen Infrarotsammlung, in der viele Ziele schwach und klein sind. In beiden Datensätzen erkannte das neue System Objekte genauer als eine starke YOLO‑basierte Basislinie und eine Reihe anderer moderner Detektoren, während es gleichzeitig schnell genug für den Echtzeitbetrieb auf einer leistungsfähigen Grafikkarte lief. Sorgfältige Ablations‑Experimente zeigten, dass jedes Element – der Hybridblock, das Kantemodul, die zusätzliche feine Ebene und der dynamische Head – zum Gesamtzuwachs beitrug.

Was das für die Alltags‑Technologie bedeutet

Für Nicht‑Spezialisten lautet die Schlussfolgerung, dass CEIFNet eine schlauere Methode bietet, damit Drohnen „die kleinen Dinge“ in großen, komplexen Szenen wahrnehmen. Durch das Bewahren von Kantendaten, das Mischen lokaler Details mit globalem Kontext und die dynamische Anpassung der Aufmerksamkeit kann das Netzwerk kleine Objekte erkennen, die andere Systeme übersehen oder falsch lokalisieren. Das macht die Luftüberwachung zuverlässiger für Aufgaben wie Verkehrssicherheit, Suche und Rettung sowie präzise Landwirtschaft und weist den Weg zu künftigen Systemen, die vertrauenswürdige Informationen aus immer höheren und weiteren Blickwinkeln unserer Welt extrahieren können.

Zitation: Xiao, J., Li, C., Chen, H. et al. Cross-stage edge information fusion network for small object detection in aerial images. Sci Rep 16, 7639 (2026). https://doi.org/10.1038/s41598-026-36251-5

Schlüsselwörter: Erkennung von Objekten in Luftbildern, kleine Objekte, Drohnenaufnahmen, Kantenbasierte Vision, Tiefes Lernen