Clear Sky Science · de

Überwachung landwirtschaftlicher Umgebungen und Objekterkennung basierend auf optimierten You Only Look Once- und Single Shot Multibox Detector-Konfigurationen unter Verwendung kombinierter Sicht- und Thermobilder

Klügere Sicht für sicherere Landmaschinen

Moderne Traktoren und Mähdrescher werden größer, schneller und stärker automatisiert, was eine einfache, aber ernste Frage aufwirft: Wie stellt man sicher, dass sie keine Menschen, Tiere oder andere Maschinen treffen, die in Staub, Nebel oder Dunkelheit verborgen sind? Dieses Papier beschreibt ein praxisorientiertes Sicherheitssystem, das Landmaschinen eine Art „Supersehen“ verleiht, indem normale Video- und Wärmebildkameras kombiniert werden, und vergleicht verschiedene KI-Setups, um zu ermitteln, welche Gefahren am genauesten und schnellsten erkannt werden können.

Warum die Landwirtschaft bessere Sicht braucht

Die Landwirtschaft setzt heute stark auf große, leistungsfähige Maschinen, die lange arbeiten, oft nachts oder bei schlechtem Wetter. Eine einfache Videokamera kann dem Bediener helfen, um einen Traktor herum zu sehen, aber normale Bilder versagen bei Nebel, Regen, starker Blendung oder Dunkelheit. Thermalkameras, die Wärme statt Licht erfassen, funktionieren unter diesen schwierigen Bedingungen gut und heben warme Körper – Menschen und Tiere – deutlich vom Hintergrund ab. Die Autoren argumentieren, dass die Kombination beider Bildtypen der beste Weg ist, ein bezahlbares Warnsystem zu bauen, das an bestehende Maschinen nachgerüstet und in Standard-Traktorbedientafeln integriert werden kann.

Wie die dualen und einheitlichen Systeme funktionieren

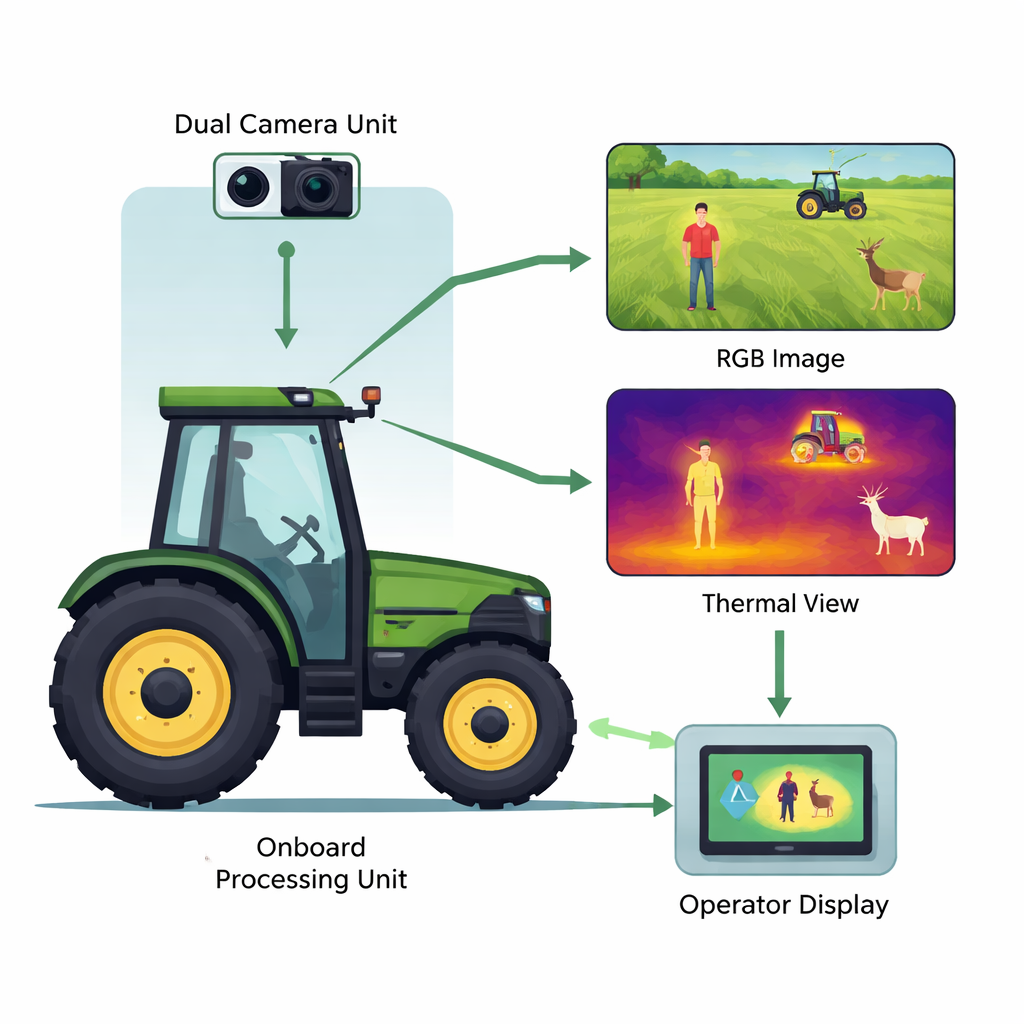

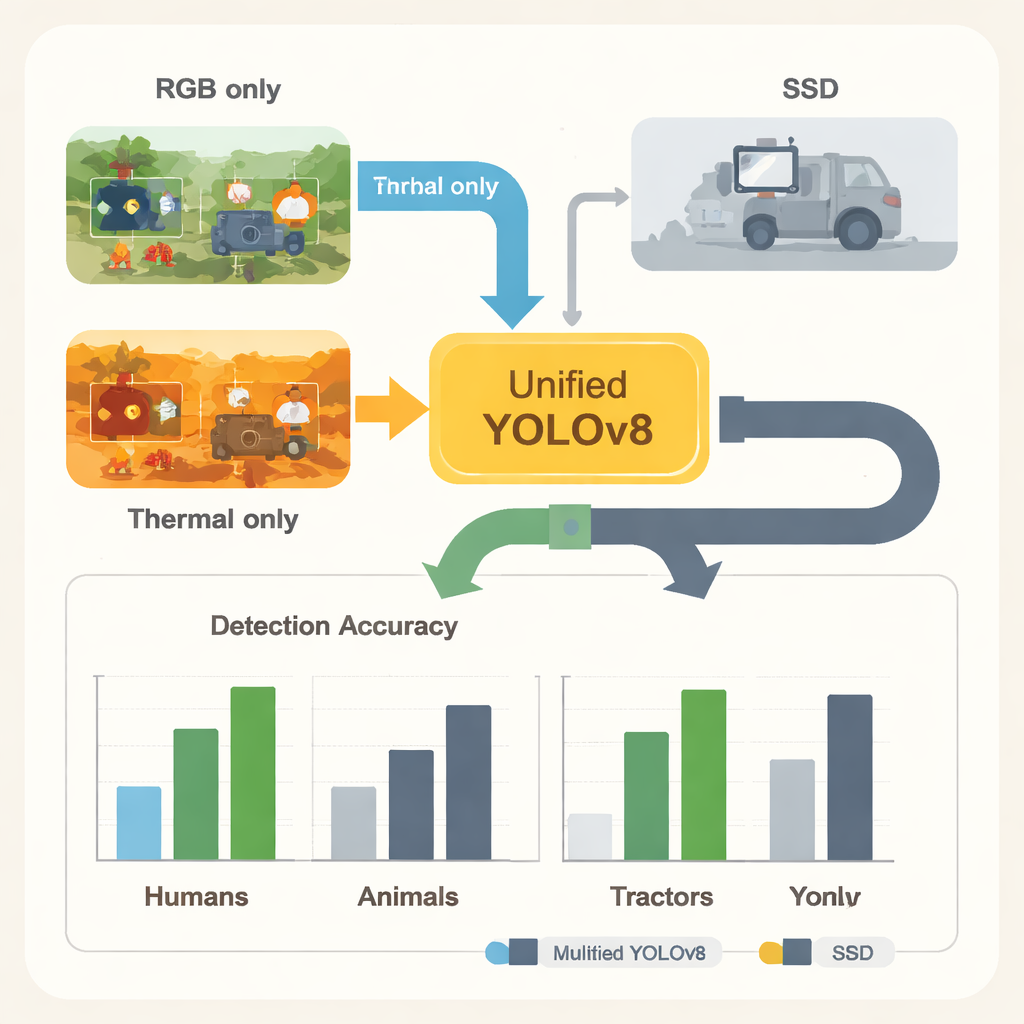

Das Team montierte eine kombinierte RGB-(normale Farb-) und Thermalkameraeinheit auf dem Traktor-Dach und speiste beide Bildströme in eine kostengünstige Verarbeitungseinheit in der Kabine. Sie untersuchten zwei Hauptansätze, um KI zur Objekterkennung in diesen Bildern zu nutzen. Beim ersten, dem „Dual-Netzwerk“-Ansatz, wurde ein neuronales Netzwerk nur mit normalen Bildern und ein zweites nur mit Thermalbildern trainiert; ihre Ergebnisse wurden anschließend zusammengeführt. Beim zweiten, dem „einheitlichen“-Ansatz, wurden die beiden Bilder sorgfältig ausgerichtet, übereinandergelegt und in ein einzelnes Netzwerk eingespeist, das gleichzeitig aus beiden lernt. Beide Designs wurden mit einer Familie schneller Objekterkennungsmodelle namens YOLOv8 und mit einer alternativen Auslegung namens SSD implementiert, die für kleine, eingebettete Rechner angepasst ist.

Aufbau und Training der Maschinenansicht des Feldes

Um diese Netzwerke zu lehren, worauf sie achten sollen, stellten die Forscher einen großen Datensatz aus öffentlichen Bildbibliotheken und eigenen Kameraufnahmen zusammen. Die Bilder deckten Personen, wildlebende und domestizierte Tiere, Traktoren, Mähdrescher, Lkw, Busse und andere Landmaschinen ab – jeweils in sichtbaren und thermalen Ansichten. Jedes Objekt wurde von einer handgezeichneten Box umgeben und mit einem Label versehen; die Bilder wurden dann augmentiert – gespiegelt, rotiert oder leicht unscharf gemacht –, um die Vielfalt realer Feldbedingungen nachzuahmen. Die Daten wurden in Trainings-, Validierungs- und Testmengen aufgeteilt, so dass die Netzwerke auf einem Teil lernen und fair an zuvor ungesehenen Bildern bewertet werden konnten. Besonderes Augenmerk galt nicht nur der reinen Genauigkeit, sondern auch der Anzahl der Rechenoperationen und der Bilder pro Sekunde, die jedes Modell benötigte, da jedes reale Traktorsystem schnell und zuverlässig im Feld laufen muss.

Welche digitalen Augen schnitten am besten ab?

Über Tausende von Testbildern erkannten alle YOLOv8-Konfigurationen die meisten Zielobjekte sehr gut, insbesondere große Landmaschinen und warmblütige Tiere. Das einheitliche Modell, das sowohl RGB- als auch Thermaldaten in einem einzigen Strom verarbeitete, erreichte eine Gesamtbewertung (mean average precision) von etwa 0,90, geringfügig vor dem Dual-Netzwerk-Ansatz mit 0,88. Anders ausgedrückt: Die Fusion beider Sichtarten innerhalb eines Netzwerks brachte einen kleinen, aber echten Leistungszuwachs, ohne das System im Betrieb komplizierter zu machen. Die größten Vorteile der Wärmebildgebung zeigten sich bei Menschen und Tieren bei schlechter Beleuchtung, während normale Bilder besser bei detailreichen Formen wie Traktoren blieben. Beim Austausch von YOLOv8 gegen das schlankere SSD-Modell sank die Leistung für die meisten Klassen deutlich, obwohl SSD viel schneller trainierte. YOLOv8, insbesondere seine kleinste „Nano“-Variante, lieferte höhere Genauigkeit und erreichte dennoch Echtzeitgeschwindigkeiten von rund 27 Bildern pro Sekunde auf moderater Hardware.

KI-Erkennungen in einfache Warnungen verwandeln

Anstatt den Fahrer mit Videofeeds zu überfluten, wandelt das System Erkennungen in eine einfache Dashboard-Ansicht um, die einem gängigen Traktor-Kommunikationsstandard (ISOBUS) folgt. Auf einem einfachen grünen Panel zeigen Symbole an, ob sich ein Mensch, ein Tier oder ein Fahrzeug vor der Maschine befindet, zusammen mit Abstand, Richtung und der Vertrauenswürdigkeit der Erkennung. Diese reduzierte Schnittstelle kann auf vorhandenen Bedien-Terminals laufen und ist für raue Landwirtschaftsbedingungen ausgelegt, mit geschützten Kameras, stabilisierten Halterungen sowie geplantem Staub- und Temperaturmanagement für künftige Versionen.

Was das für die tägliche Landwirtschaft bedeutet

Für Nichtfachleute lautet die Schlussfolgerung, dass Traktoren „zwei Arten von Augen“ und ein gut ausgewähltes KI-Gehirn erheblich zur Sicherheit beitragen können, ohne exotische Hardware zu erfordern. Ein einzelnes, sorgfältig abgestimmtes YOLOv8-Netzwerk, das normale und thermale Ansichten mischt, bietet die beste Kombination aus Genauigkeit, Geschwindigkeit und Einfachheit unter den getesteten Optionen und übertrifft deutlich das SSD-Design. Obwohl das System noch Schwierigkeiten hat, Menschen in allen Situationen sicher zu erkennen – zum Teil, weil sie im Trainingsdatensatz seltener vertreten waren – zeigt die Studie, dass praxisnahe, kamerabasierte Warnsysteme für Landmaschinen sowohl machbar als auch nahe an der Einsatzreife sind. Mit ausgewogeneren Daten und verfeinerten Fusionsmethoden könnten künftige Versionen helfen, Unfälle zu verhindern, die Tierwelt zu schützen und die großflächige Landwirtschaft für alle im und am Feld sicherer zu machen.

Zitation: Tarasiuk, K., Mystkowski, A., Ostaszewski, M. et al. Agriculture surrounding monitoring and object identification based on optimized you only look once and single shot multibox detector setups using combined vision and thermal images. Sci Rep 16, 5129 (2026). https://doi.org/10.1038/s41598-026-36181-2

Schlüsselwörter: landwirtschaftliche Sicherheit, Wärmebildtechnik, Computer Vision, Objekterkennung, YOLOv8