Clear Sky Science · de

Sicherheit und Wirksamkeit datenschutzfreundlicher Modelle zur Erstellung Laienverständlicher Zusammenfassungen von Hirn‑MRT‑Berichten

Warum Ihr Befund so verwirrend wirken kann

Immer mehr Patientinnen und Patienten können ihre Untersuchungsergebnisse online einsehen, einschließlich ausführlicher radiologischer Berichte von Hirnscans. Diese Dokumente sind jedoch für Ärztinnen und Ärzte verfasst, nicht für Patientinnen und Patienten, und enthalten viele ungewohnte Fachbegriffe, die eher Ängste schüren als beruhigen. Diese Studie untersucht, ob moderne Programme der künstlichen Intelligenz (KI) echte Notfall‑Hirn‑MRT‑Berichte – auf Französisch verfasst und bei Menschen mit Kopfschmerzen durchgeführt – sicher in verständliche Zusammenfassungen für Laien umwandeln können, ohne dabei sensible medizinische Daten an entfernte kommerzielle Server zu senden.

Ärztliche Sprache in Alltagssprache übersetzen

Die Forschenden konzentrierten sich auf sogenannte „Laienzusammenfassungen“: kurze Erklärungen, die die medizinischen Fakten erhalten, sie aber in Alltagssprache übertragen und die Befunde direkt mit den Symptomen der Patientin bzw. des Patienten verknüpfen. Sie setzten drei grosse Sprachmodelle (LLMs) ein — Llama 3.3, Athene V2 und Mistral Small — die vollständig auf Rechnern innerhalb eines französischen Universitätskrankenhauses betrieben wurden, sodass kein Bericht jemals das sichere Krankenhausnetzwerk verließ. Jedes KI‑System erhielt dieselbe Anweisung: Schreibe eine 4–6 Sätze lange Zusammenfassung auf Französisch für eine Patientin oder einen Patienten, die alle Schlüsselbefunde abdeckt, schwierige Begriffe erklärt und die Scan‑Ergebnisse mit den Kopfschmerzen der Person in Verbindung bringt.

Wie Ärztinnen und Ärzte Genauigkeit und Sicherheit beurteilten

Aus nahezu 600 Hirn‑MRT‑Berichten, die 2022 für Notfallpatienten mit Kopfschmerzen verfasst wurden, wählte das Team zufällig 105 aus. Drei erfahrene Neuroradiologinnen bzw. Neuroradiologen lasen jeden Originalbericht zusammen mit drei anonymisierten KI‑Zusammenfassungen (je eine pro Modell). Sie bewerteten diese hinsichtlich medizinischer Korrektheit, Vollständigkeit, Nützlichkeit zur Aufklärung von Patientinnen und Patienten und der Frage, ob der Text direkt im Patientenportal gezeigt werden könnte. Im Durchschnitt waren die Bewertungen hoch: Die Ärztinnen und Ärzte hielten die Zusammenfassungen überwiegend für korrekt und umfassend und oft für für die klinische Nutzung geeignet. Dennoch wies etwa eine von fünf Zusammenfassungen mindestens ein Problem auf, etwa eine falsche Erklärung einer Abkürzung, eine leicht ungenaue anatomische Beschreibung, sperrige Formulierungen oder eine erfundene Angabe, die im Originalbericht nicht vorhanden war.

Was Nicht‑Ärztinnen und Nicht‑Ärzte tatsächlich verstanden

Um zu prüfen, ob diese Zusammenfassungen Laien wirklich weiterhalfen, rekrutierten die Forschenden 11 Nicht‑Medizinerinnen und Nicht‑Mediziner aus dem Bereich Medizinische Informatik, die regelmäßig mit Gesundheitsdaten arbeiten, aber keine ärztliche Ausbildung haben. Diese Gruppe bewertete 30 MRT‑Berichte, teils in der Originalform, teils mit einer ergänzenden KI‑Zusammenfassung. Sie schätzten ein, wie gut sie den jeweiligen Bericht verstanden, wie zuversichtlich sie wären, die Ergebnisse Freunden oder Familienmitgliedern zu erklären, und wie ängstlich sie sich fühlen würden, wenn der Bericht ihr eigener wäre. Zudem beantworteten sie einfache Ja‑/Nein‑Fragen: Ist in diesem Bericht etwas Auffälliges enthalten, und gibt es einen Befund, der vernünftigerweise die Kopfschmerzen des Patienten erklären könnte?

Klarere Berichte, moderate aber reale Verständnisgewinne

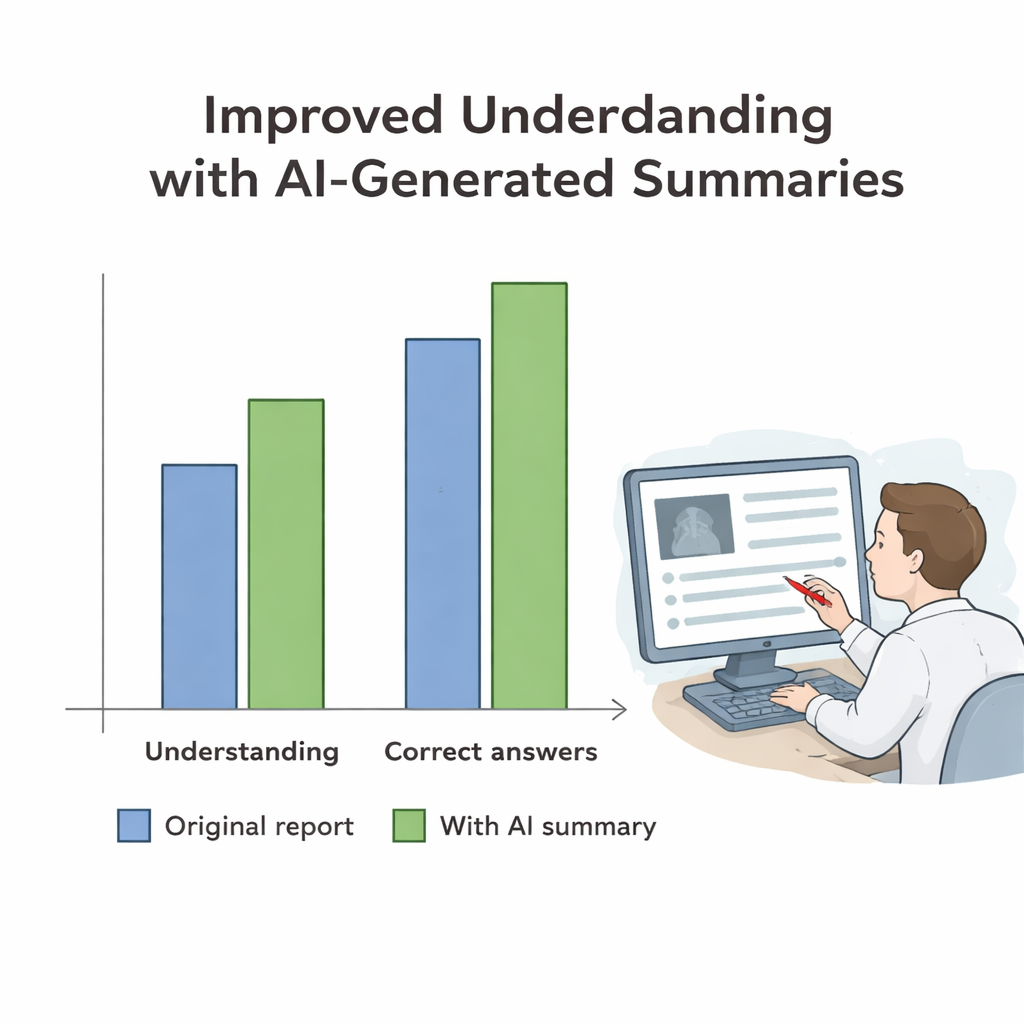

Das Hinzufügen KI‑generierter Zusammenfassungen steigerte dramatisch das subjektive Verständnis der Teilnehmenden: Die durchschnittliche Selbsteinschätzung der Verständlichkeit stieg von „mäßig“ zu „hoch“. Auch das Vertrauen, die Ergebnisse mit anderen besprechen zu können, nahm zu, während die berichtete Angst leicht abnahm. Bei objektiven Verständnismaßen war der Effekt moderater, aber dennoch bedeutsam. Die Teilnehmenden wurden besser darin, Auffälligkeiten in einem Scan zu identifizieren und Befunde zu erkennen, die tatsächlich Kopfschmerzen erklären könnten; die Verbesserungen konzentrierten sich auf Berichte mit echten Auffälligkeiten. Bei normalen Scans waren die Personen bereits nahezu perfekt darin, zu erkennen, dass nichts Ernstes gefunden wurde, sodass die Zusammenfassungen hier wenig zusätzlichen Nutzen brachten.

Warum menschliche Aufsicht weiterhin wichtig ist

Obwohl diese datenschutzwahrenden KI‑Werkzeuge die wahrgenommene Klarheit deutlich verbesserten und kleine, aber wichtige Zuwächse im sachlichen Verständnis ermöglichten, waren sie nicht fehlerfrei. Ungefähr 20 % der Zusammenfassungen enthielten medizinische oder sprachliche Fehler, häufig im Zusammenhang mit kniffligen medizinischen Abkürzungen oder dem Einsinken englischer und chinesischer Wörter in französische Sätze. Da schon kleine Fehler Patientinnen und Patienten in die Irre führen können, plädieren die Autorinnen und Autoren dafür, KI in einem „Human‑in‑the‑loop“‑Ansatz einzusetzen: Das Modell erstellt einen patientengerechten Entwurf, und eine Radiologin bzw. ein Radiologe überprüft und korrigiert ihn schnell, bevor er die Patientin bzw. den Patienten erreicht. Auf diese Weise könnte die Studie nahelegen, dass vor Ort betriebene KI Krankenhäusern helfen kann, klarere und beruhigendere Erklärungen zu Hirn‑MRT‑Befunden zu liefern und gleichzeitig sensible Gesundheitsdaten sicher innerhalb der Einrichtung zu halten.

Zitation: Le Guellec, B., Bentegeac, R., Shorten, L. et al. Safety and efficacy of privacy-preserving models to create Lay summaries of brain MRI reports. Sci Rep 16, 6316 (2026). https://doi.org/10.1038/s41598-026-36081-5

Schlüsselwörter: radiologische Befunde, Patientenkommunikation, Hirn‑MRT, grosse Sprachmodelle, medizinischer Datenschutz