Clear Sky Science · de

M6: multi-generator, multi-domain, multi-lingual and cultural, multi-genres, multi-instrument machine-generated music detection databases

Warum der Anstieg KI-erstellter Musik von Bedeutung ist

Musik-Streaming-Plattformen füllen sich zunehmend stillschweigend mit Stücken, die nicht von Menschen, sondern von Algorithmen geschrieben wurden. Diese maschinell erzeugten Tracks können nützliche Werkzeuge für Therapie, Filmmusik oder Alltags-Playlisten sein, verwischen jedoch zugleich die Grenze zwischen menschlicher Kreativität und automatisierter Produktion. Dieses Paper stellt M6 vor, eine große neue Musiksammlung, die Forschenden helfen soll, menschlich erzeugte von KI-erzeugter Musik zu unterscheiden und zu verstehen, wodurch sie sich unterscheiden. Ziel ist es, faire Anerkennung für Künstler zu unterstützen und zugleich KI eine konstruktive Rolle bei der Musikschaffung zu ermöglichen.

Aufbau eines großen Musiktestfelds

Die Autorinnen und Autoren argumentieren, dass der Fortschritt bei der Erkennung KI-generierter Musik durch einen Mangel an geeigneten Daten behindert wurde. Bestehende Sammlungen konzentrieren sich entweder auf andere Aufgaben, etwa die Zuordnung von Musik zu Textbeschreibungen, oder decken nur einen engen Ausschnitt musikalischer Stile ab. M6 soll diese Lücke schließen. Es kombiniert tausende von Stücken von Menschen mit tausenden, die von mehreren verschiedenen KI-Systemen erzeugt wurden, verpackt in einem standardisierten Audioformat. Das Dataset ist bewusst breit gefächert: Es umfasst viele Instrumente, Sprachen, Kulturen, Genres, Liedlängen sowie sowohl vokale Lieder als auch instrumentale Hintergrundstücke. Diese große Vielfalt ermöglicht es Forschenden, zu prüfen, ob Erkennungsmethoden in realistischen, sich ständig wandelnden musikalischen Umgebungen funktionieren.

Sammeln von Songs von Menschen und Maschinen

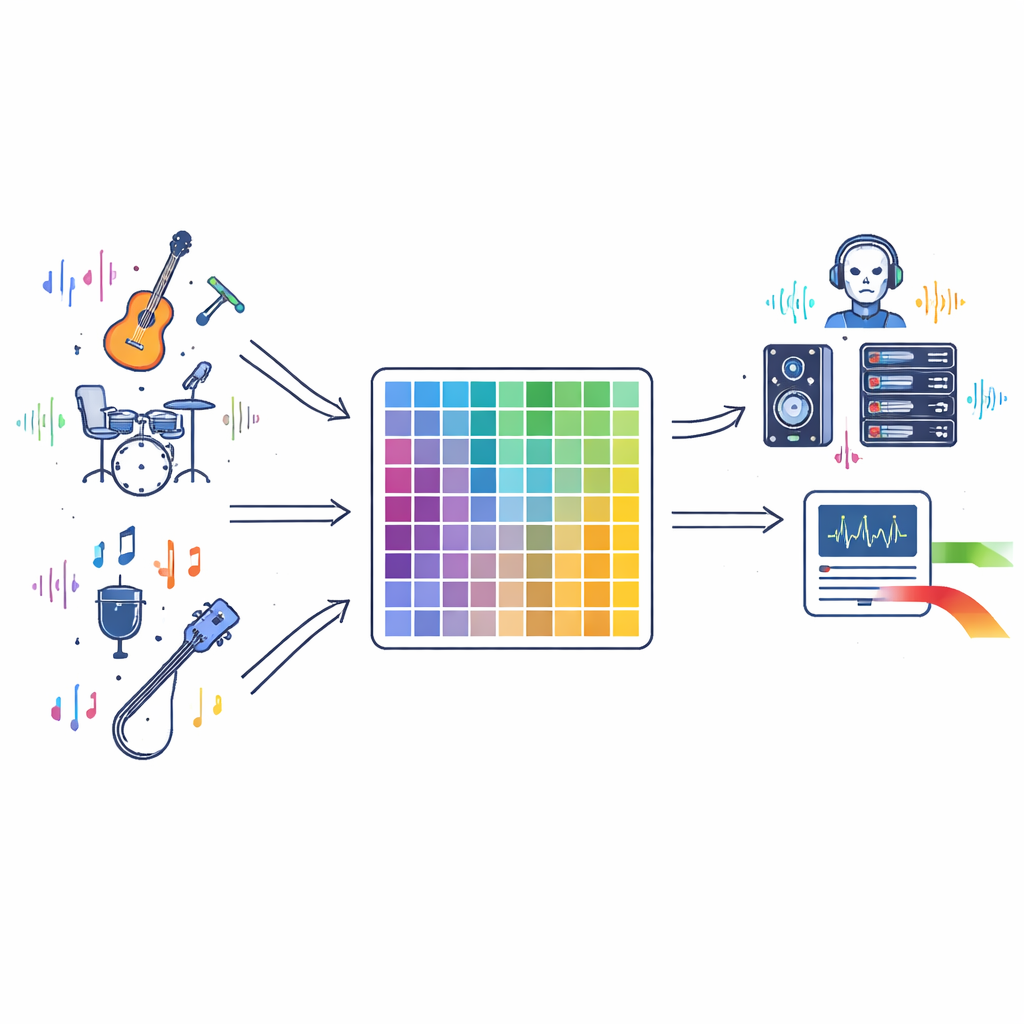

Um die menschliche Seite von M6 zusammenzustellen, griff das Team auf bekannte offene Sammlungen wie GTZAN (für Musikgenres), das Free Music Archive, COSIAN (japanische Vokalmusik) und ein Dataset einzelner Instrumentensounds zurück. Darüber hinaus entnahmen sie zusätzliche Songs von Streaming-Plattformen, sofern die Lizenzen dies erlaubten, und wählten Ausschnitte aus, die die zentrale musikalische Idee klar zeigen, statt nur kurze Zwischenspiele. Auf der maschinellen Seite erzeugten sie neue Musik mit mehreren hochmodernen Systemen, darunter offene Forschungsmodelle und kommerzielle Werkzeuge. Sorgfältig gestaltete Prompts, teilweise von einem Sprachmodell erstellt, forderten diese Systeme auf, Musik in bestimmten Stilen, Tempi oder mit bestimmten Instrumenten zu produzieren, damit die KI-Tracks die Vielfalt menschlicher Musik widerspiegeln.

Qualitätsprüfung und Erkennen subtiler Unterschiede

Da Urteile über musikalische Qualität subjektiv sind, kombinierten die Autorinnen und Autoren Zuhörermeinungen mit objektiven Messgrößen. Sie berechneten einfache numerische Deskriptoren für jeden Track, die Aspekte wie die Komplexität der Rhythmen, die Breite des melodischen Umfangs, die Helligkeit des Spektrums und die Energiemenge des Signals erfassen. Im Durchschnitt unterschieden sich KI-erzeugte Stücke von menschlichen in diesen Messwerten — etwa durch etwas engere Tonhöhenbereiche oder niedrigere Gesamtenergie —, doch die Unterschiede waren so klein, dass die meisten Hörenden sie ohne genauen Vergleich nicht bemerken würden. In Hörtests mit 50 Freiwilligen identifizierten die Teilnehmenden korrekt, ob ein Clip menschlich oder von KI erzeugt wurde, nur in etwa der Hälfte der Fälle, also faktisch nicht besser als ein Münzwurf. Das deutet darauf hin, dass KI-Musik bereits ein Niveau erreicht hat, das ungeübte Hörer leicht täuschen kann.

Prüfung von Erkennungsmethoden

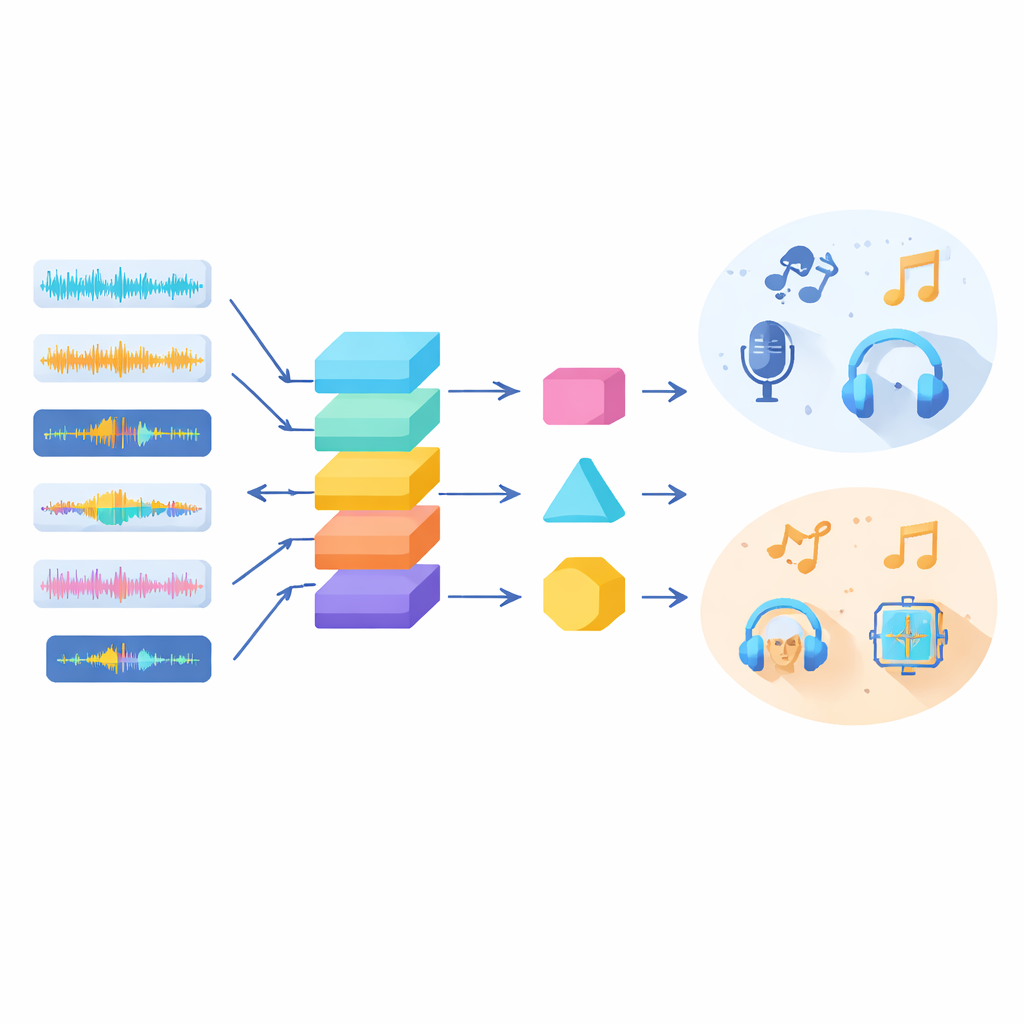

Mit M6 evaluierten die Forschenden verschiedene Computermodelle, um zu sehen, wie gut sie KI-generierte Musik erkennen können. Sie testeten klassische Methoden des maschinellen Lernens, bildähnliche neuronale Netze, die Spektrogramme verarbeiten, Transformermodelle sowie moderne Audiosysteme, die ursprünglich zur Erkennung gefälschter Sprache entwickelt wurden. Wenn Modelle auf ähnlichen Musikt ypen trainiert und getestet wurden, erreichten mehrere hohe Genauigkeiten, insbesondere Faltungsnetzwerke, die Muster im Zeit–Frequenz-Bild des Klangs fokussieren. Die Leistung sank jedoch deutlich, wenn Modelle auf „out-of-domain“-Musik trafen — Stile, Sprachen oder Generatoren, die sie zuvor nicht gesehen hatten. Die Studie zeigte außerdem, dass verschiedene KI-Musiksysteme unterschiedliche akustische „Fingerabdrücke“ hinterlassen, wodurch einige Generatoren leichter zu erkennen sind als andere und die Befürchtung entsteht, dass Detektoren sich eher an bestimmte Werkzeuge anpassen als an tiefere Merkmale maschinell erzeugter Musik.

Was das für Musik und KI bedeutet

Das M6-Projekt zeigt, dass Computer KI-generierte Musik in vertrauten Umgebungen oft zuverlässig markieren können, aber eine robuste Erkennung in freier Wildbahn weiterhin eine große Herausforderung bleibt. Menschliche Hörer haben bereits Schwierigkeiten, den Unterschied zu erkennen, und aktuelle Algorithmen versagen, wenn sich Musik im Genre, in der Sprache, in der Länge oder in der Erzeugungsmethode verändert. Durch die Veröffentlichung eines großen, vielfältigen und offen verfügbaren Datensatzes hoffen die Autorinnen und Autoren, die Entwicklung zuverlässigerer und transparenterer Erkennungstools voranzutreiben. Solche Werkzeuge könnten das Vertrauen in digitale Musikplattformen stärken, eine faire Anerkennung menschlicher Künstler unterstützen und künftige KI-Systeme dazu lenken, mit Musikerinnen und Musikern zusammenzuarbeiten, statt sie still zu ersetzen.

Zitation: Li, Y., Li, H., Specia, L. et al. M6: multi-generator, multi-domain, multi-lingual and cultural, multi-genres, multi-instrument machine-generated music detection databases. Sci Rep 16, 9237 (2026). https://doi.org/10.1038/s41598-026-36044-w

Schlüsselwörter: KI-generierte Musik, Deepfake-Audio, Musikerkennung, maschinelles Lernen, digitale Kreativität