Clear Sky Science · de

Einsatz künstlicher Intelligenz zur Identifizierung chirurgischer Anatomie während der laparoskopischen Nierenspende – eine Validierungs‑ und Machbarkeitsstudie

Intelligentere Technik für ein hochbrisantes Geschenk

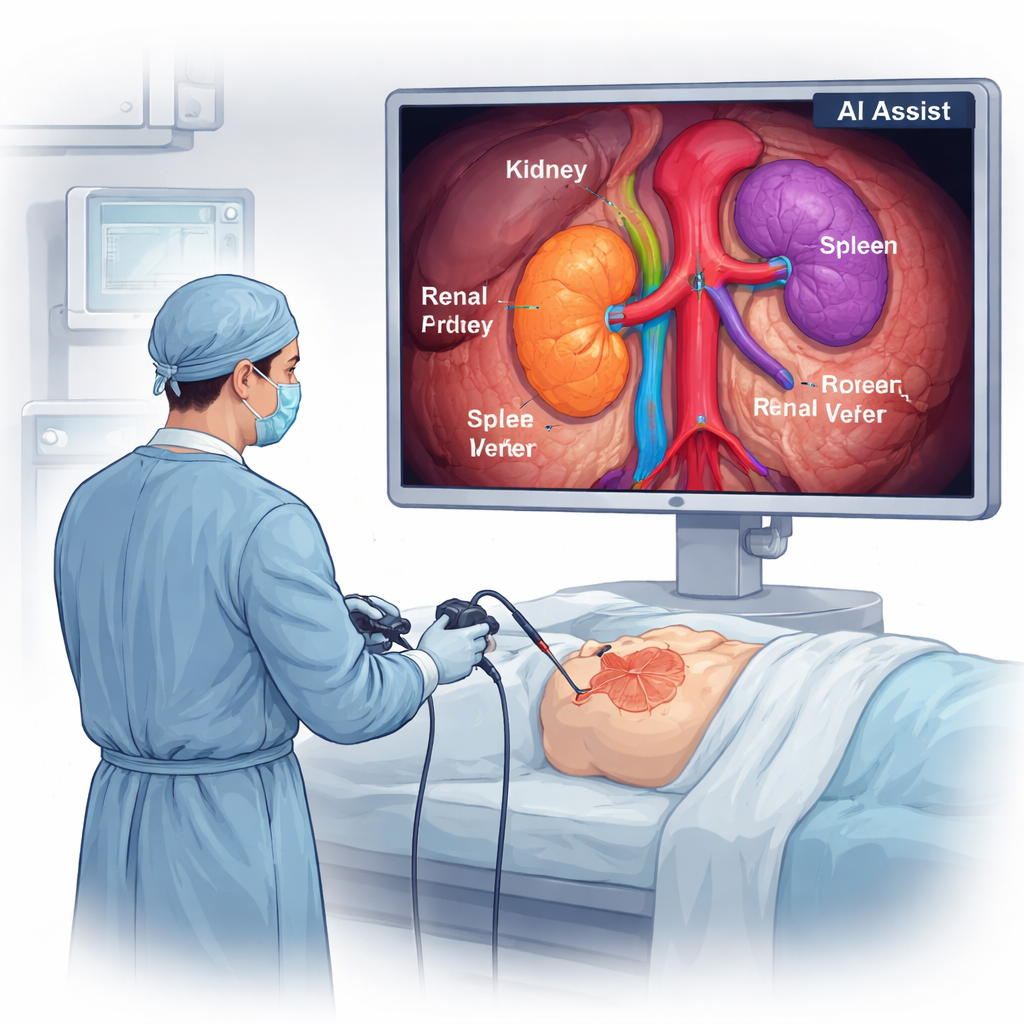

Die laparoskopische Donornephrektomie ist der minimalinvasive Eingriff, der bei einer lebenden Person zur Nierenspende verwendet wird – ein selbstloser Akt, bei dem jeder chirurgische Fehler besonders schwer zu akzeptieren ist. Diese Studie untersucht, wie künstliche Intelligenz (KI) Chirurgen dabei helfen kann, während dieses heiklen Verfahrens lebenswichtige Strukturen klarer zu erkennen, mit dem Ziel, das Risiko für Spender zu verringern und die Ausbildung künftiger Operateure zu verbessern.

Warum Nierenspendeoperationen besondere Vorsicht erfordern

Lebende Nierenspender sind oft völlig gesunde Personen, die sich allein aus dem Wunsch heraus operieren lassen, jemand anderem zu helfen. Obwohl laparoskopische Techniken die Spende bereits sicherer gemacht und die Erholungszeit verkürzt haben, findet die Operation immer noch in einem beengten Raum in der Nähe von Arterien, Venen und dem Ureter statt, die nicht verletzt werden dürfen. Chirurgen müssen derzeit allein mit ihren Augen und ihrer Erfahrung diese Strukturen auf einem Videobildschirm erkennen. Ein KI‑„Co‑Pilot“, der zuverlässig in Echtzeit zentrale anatomische Strukturen markieren kann, könnte vor Fehlern schützen – besonders bei weniger erfahrenen Operateuren oder in schwierigen Situationen.

Einem Computer das Sehen im Körper beibringen

Das Forschungsteam arbeitete mit einem Medizintechnikunternehmen zusammen, um ein Computer‑Vision‑System zu entwickeln, das wichtige Strukturen während einer linksseitigen Nierenspende erkennen kann. Sie sammelten Videoaufzeichnungen aus 30 Operationen und konzentrierten sich auf Zeitpunkte, an denen das umgebende Fett bereits entfernt war und Niere, Milz, die Hauptgefäße und der Ureter sichtbar wurden. Aus diesen Aufnahmen extrahierten sie Tausende von Standbildern. Jedes Bild wurde pixelgenau von einem Anatom kennzeichnet und anschließend von einem erfahrenen Transplantationschirurgen überprüft. Diese annotierten Bilder dienten als „Antwortschlüssel“ für das Training der KI. Das System basierte auf einem modernen Deep‑Learning‑Modell, das ursprünglich zum schnellen Erkennen von Objekten in Bildern entwickelt wurde und dann so angepasst wurde, dass es einzelne Organe und Gefäße in jedem Operationsbild umreißt.

Wie das System trainiert und getestet wurde

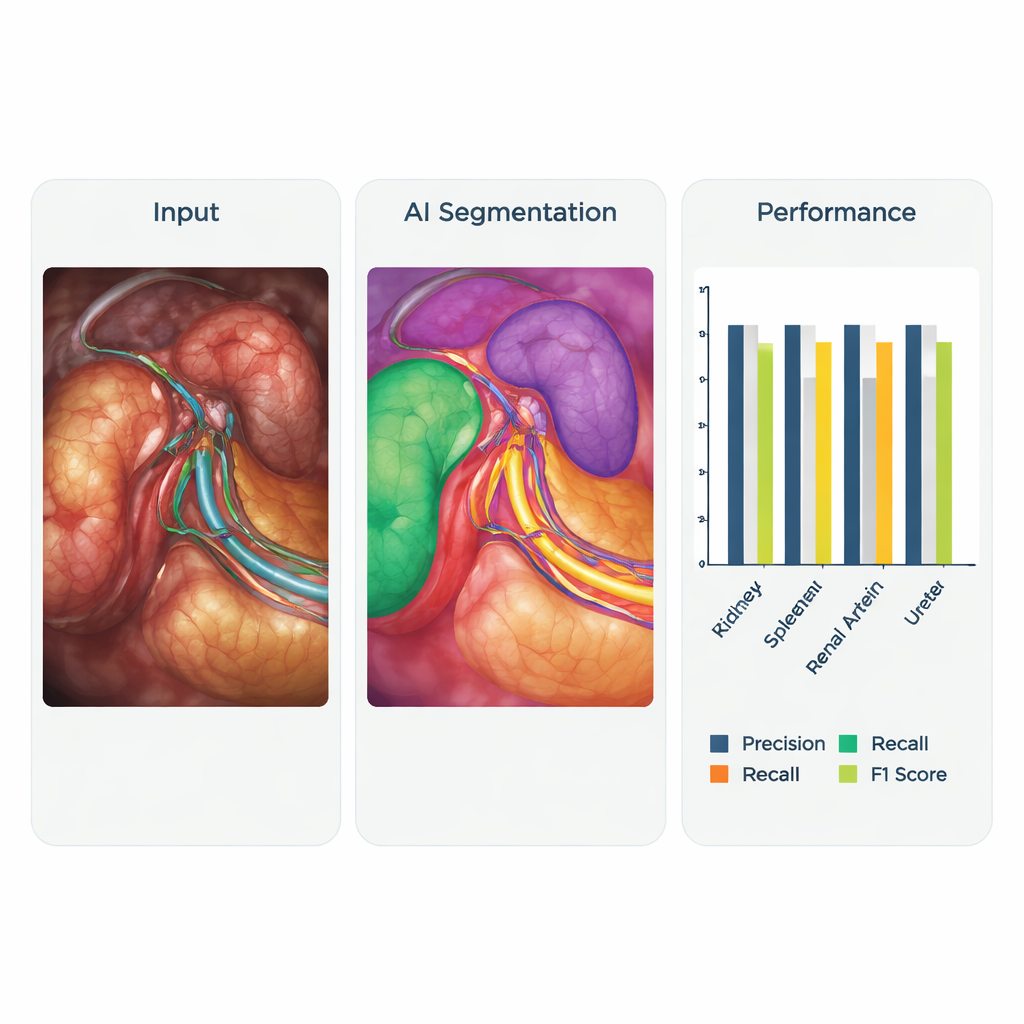

Die Forscher verwendeten 6.828 gelabelte Bilder aus 16 Operationen, um die KI zu trainieren, und hielten weitere 1.757 Bilder aus vier anderen Operationen zurück, um zu prüfen, wie gut sie gelernt hatte. Sie gewannen den kritischsten Strukturen – Nierenarterie, Nierenvene und Ureter – bewusst ein größeres Gewicht, damit das Modell diesen besondere Aufmerksamkeit schenkt. Während des Trainings verglich das Programm wiederholt seine Vorhersagen mit den Expertenannotationen und passte sich an, um Fehler zu reduzieren. Die Kernfrage war, ob die KI bei einem neuen Bild Milz, Niere, Hauptgefäße und Ureter korrekt hervorheben kann, ohne sie zu übersehen oder Strukturen zu verwechseln.

Wie gut der KI‑Co‑Pilot abgeschnitten hat

Bei Tests zeigte das KI‑System ermutigende Genauigkeit. Besonders stark war es beim Erkennen der Milz und der Hauptgefäße, die die Niere versorgen. Für die linke Niere, Nierenarterie und Nierenvene erreichte das System ein gutes Gleichgewicht zwischen dem Vermeiden falscher Markierungen von Hintergrundgewebe und dem Nichtübersehen der Zielstrukturen. Diese Ergebnisse entsprechen allgemein akzeptierten Schwellenwerten für die Echtzeiterkennung in der Chirurgie. Der Ureter – ein dünner Kanal, der den Harn aus der Niere ableitet – erwies sich als schwieriger zu erkennen, wahrscheinlich weil er schmal, beweglich, farblich den umliegenden Geweben ähnlich und in den Trainingsbildern seltener vertreten war. Über statische Tests hinaus probierte das Team das System auch live im Operationssaal und an Videos aus einem Krankenhaus in einem anderen Land aus. Die KI identifizierte weiterhin zentrale Anatomie und erkannte sogar ein ungewöhnliches Muster mit doppelten Arterien, was darauf hindeutet, dass sie über das ursprüngliche Trainingszentrum hinaus generalisieren könnte.

Was das für Chirurgen und Patienten bedeuten könnte

Obwohl das System noch nicht bereit ist, als vollwertiges Echtzeit‑Navigationswerkzeug zu dienen, stellt diese Arbeit einen wichtigen ersten Schritt dar. Die zuverlässige Umrandung wichtiger Anatomie eröffnet mehrere Anwendungsmöglichkeiten: Anzeigeunterstützung auf dem Bildschirm während schwieriger Operationsphasen, automatische Beschriftung von Lehrvideos für Auszubildende und objektivere Wege zur Bewertung chirurgischer Leistung. Zukünftige Verbesserungen erfordern vielfältigere Daten aus mehreren Krankenhäusern, bessere Erfassung schwerer Strukturen wie des Ureters und formale Messungen, wie schnell und konsistent die KI Bild für Bild arbeitet. Die zentrale Botschaft ist dennoch klar für Nicht‑Fachleute: KI kann bereits vieles „sehen“, was ein ausgebildeter Chirurg erkennt, und mit weiterer Verfeinerung könnten Systeme wie dieses die Sicherheit der Nierenspende weiter erhöhen.

Zitation: Ong, C.S.H., Wong, H.P.N., Leung, M. et al. Utilising artificial intelligence to identify surgical anatomy during laparoscopic donor nephrectomy – a validation and feasibility study. Sci Rep 16, 7416 (2026). https://doi.org/10.1038/s41598-026-35999-0

Schlüsselwörter: Nierenspende, laparoskopische Chirurgie, chirurgische künstliche Intelligenz, Computer Vision in der Medizin, Sicherheit bei Organtransplantationen