Clear Sky Science · de

Quantenverbesserter multimodaler prognostischer Transformer zur Vorhersage und Visualisierung des Fortschreitens von Hauterkrankungen

Warum die Vorhersage von Hautausschlägen wichtig ist

Hautausschläge durch Infektionen wie Affenpocken, Windpocken und Masern können einander verblüffend ähnlich sehen, erfordern aber sehr unterschiedliche medizinische Maßnahmen. Ärztinnen und Ärzte müssen außerdem nicht nur wissen, um welchen Ausschlag es sich heute handelt, sondern auch, wie er sich in den kommenden Tagen voraussichtlich verändern wird. Diese Studie stellt ein experimentelles Computersystem vor, das beides zugleich versucht: die Erkrankung zu identifizieren und vorherzusagen, wie sich die Hautläsionen entwickeln könnten, und dabei gleichzeitig den Ärzten zu zeigen, was das System „denkt“. Zwar ist es noch weit davon entfernt, in der Klinik eingesetzt zu werden, doch es skizziert eine mögliche Zukunft für intelligentere, transparentere Werkzeuge in der Dermatologie.

Bilder und Patientenkontext zusammenbringen

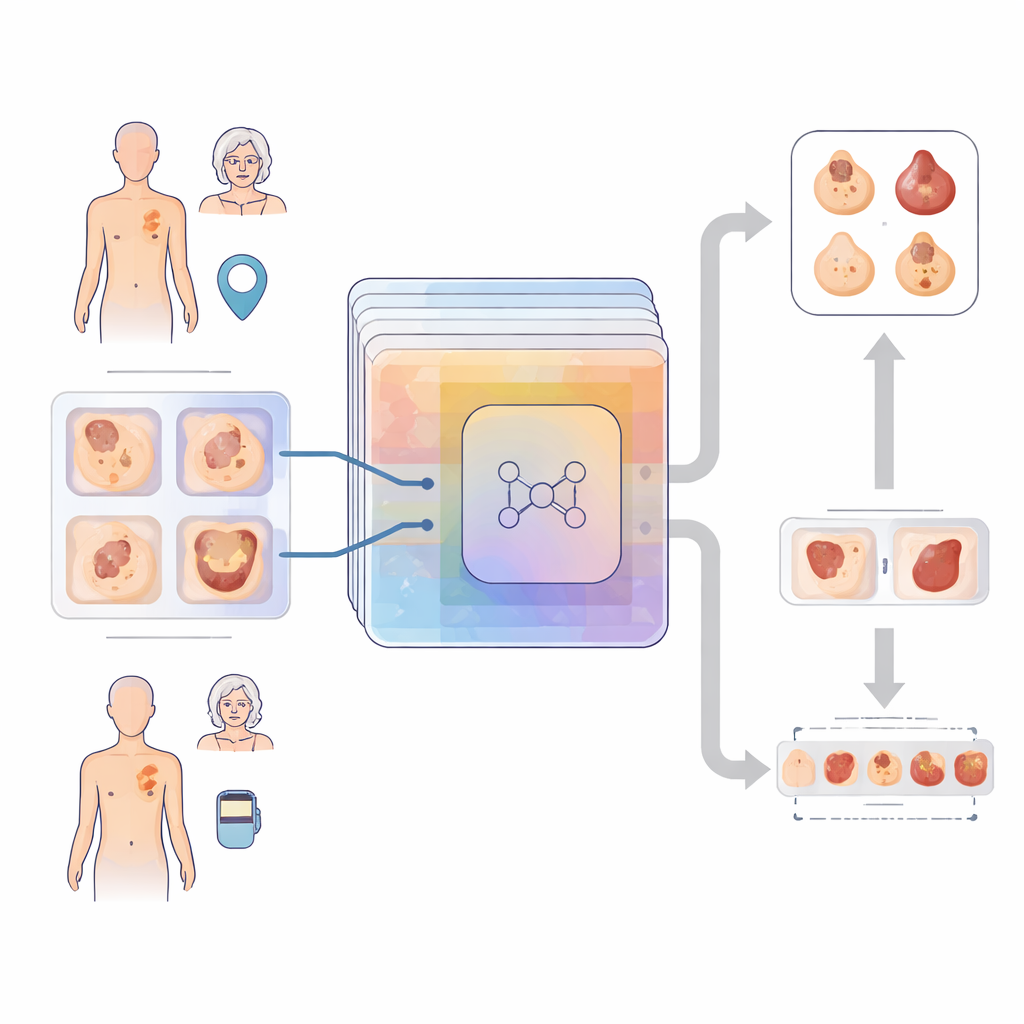

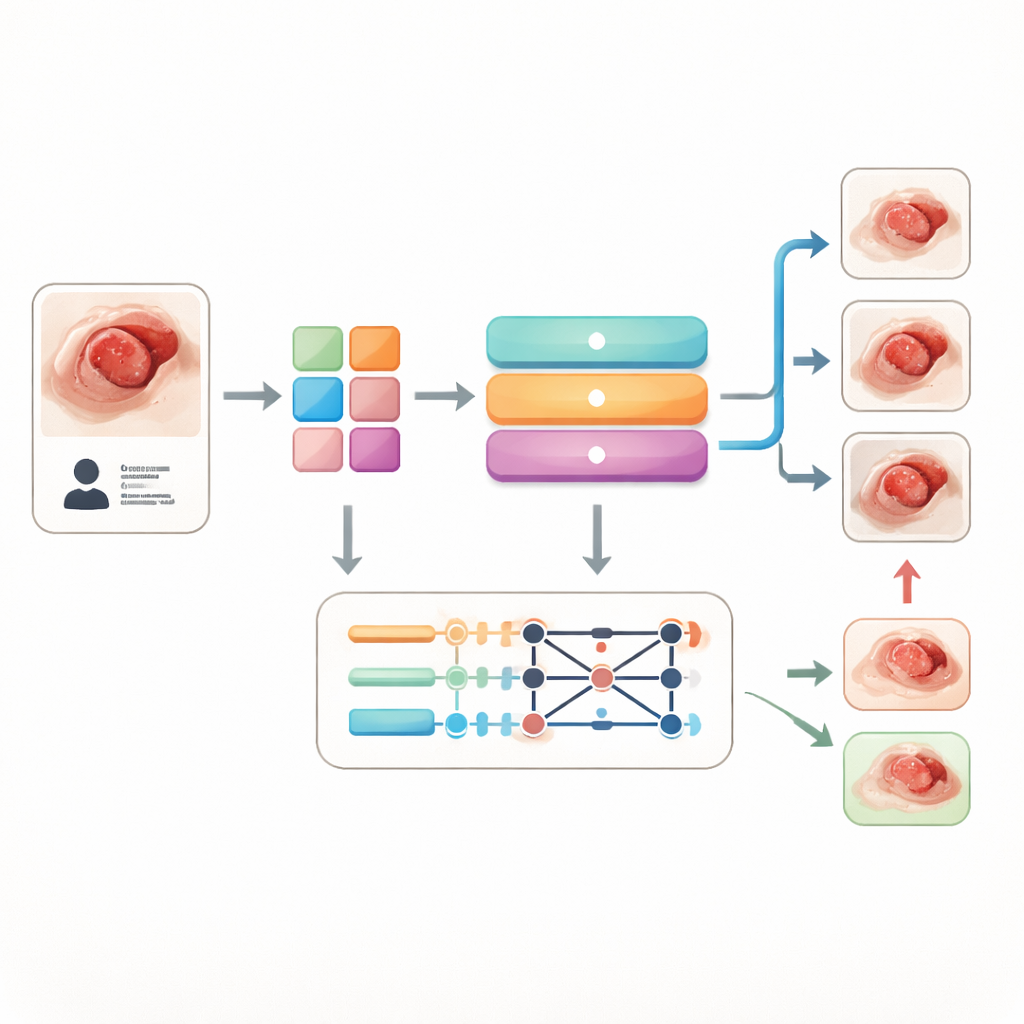

Der Kern der Arbeit ist ein Modell, das die Autorinnen und Autoren Quantum-Enhanced Multimodal Prognostic Transformer nennen. Einfach ausgedrückt handelt es sich um ein geschichtetes Netzwerk, das zwei Eingabetypen verarbeitet: detaillierte Fotografien von Hautläsionen und grundlegende Patientendaten wie Alter und Körperstelle, an der der Ausschlag auftritt. Eine Komponente aus der aktuellen Bildforschung, bekannt als Vision Transformer, scannt die Läsionsbilder, um Muster von Farbe, Textur und Form über das gesamte Bild zu erfassen. Parallel dazu wandelt ein einfacher Pfad Alter- und Lokalisationdaten in eine kompakte numerische Darstellung um. Diese beiden Ströme werden kombiniert, sodass das System den Ausschlag im Kontext der betroffenen Person und des betroffenen Körperbereichs beurteilen kann.

Vorausschau ohne Zeitreihen

Echte medizinische Aufzeichnungen, die dieselbe Hautläsion über viele Besuche hinweg verfolgen, sind selten, weshalb die Autorinnen und Autoren vor einer Herausforderung standen: Wie lässt sich ein Modell trainieren, das zukünftige Krankheitsstadien vorhersagt, ohne echte Zeitrafferdaten? Ihre Lösung besteht darin, in einem abstrakten Merkmalsraum „Pseudo-Trajektorien“ zu konstruieren. Ein rekurrentes Modul, inspiriert von Werkzeugen zur Analyse von Sequenzen wie Sprache, lernt, wie sich Merkmale milderer Läsionen von denen fortgeschrittenerer unterscheiden. Darauf aufbauend wird ein generatives Modul trainiert, sich vorzustellen, wie die Läsion aussehen könnte, wenn sie sich verschlechtert oder verbessert, und synthetische Bilder möglicher Zukunftsszenarien zu erzeugen. Diese Fähigkeit, hypothetische Ergebnisse zu visualisieren, könnte eines Tages Klinikern helfen, verschiedene Behandlungswege zu vergleichen — vorausgesetzt, sie wird anhand realer Nachbeobachtungsdaten validiert.

Ein Hauch Quantenflair

Ein auffälliger Aspekt des Rahmens ist eine kleine „quanteninspirierte“ Schicht. Anstatt auf einem vollwertigen Quantencomputer zu laufen, verwendet sie einen simulierten Quantenschaltkreis, der zwischen das temporale Modul und die finalen Entscheidungsschichten eingefügt wird. Dieser Schaltkreis transformiert die internen Merkmale des Modells auf eine Weise, die komplexe Wechselwirkungen unter ihnen fördert, ein wenig so, als würde man Zutaten gründlicher miteinander verrühren. In Tests führte das Hinzufügen dieses quantenähnlichen Blocks zu einem modesten, aber konsistenten Genauigkeitszuwachs sowohl bei der Vorhersage des Krankheitsnamens als auch des Stadiums, während die Gesamtmodellgröße relativ kompakt blieb. Die Autorinnen und Autoren betonen, dass es hier um das Erkunden neuer Möglichkeiten zur Darstellung von Daten geht und nicht darum, einen Vorteil gegenüber klassischer Hardware zu behaupten.

Sehen, was das Modell sieht

Da medizinische KI das Vertrauen der Klinikerinnen und Kliniker gewinnen muss, widmete das Team der Erklärbarkeit beträchtliche Anstrengungen. Sie nutzen Aufmerksamkeitskarten des Vision Transformers, um jene Bereiche eines Läsionsbildes hervorzuheben, die eine Vorhersage am stärksten beeinflusst haben, sowie mathematische Techniken, um abzuschätzen, wie stark einzelne Metadaten wie Alter oder Lokalisation das Ergebnis beeinflussten. Außerdem projizieren sie die internen Repräsentationen des Modells in zwei Dimensionen, wobei Punktcluster verschiedenen Krankheiten oder Stadien entsprechen und so ein visuelles Gefühl dafür geben, wie gut das System ähnliche Zustände trennt. Zusätzliche Werkzeuge erzeugen „kontrafaktische“ Versionen von Läsionen, die zeigen, wie kleine Änderungen im Erscheinungsbild das Modell in Richtung einer anderen Diagnose bewegen könnten, und helfen Nutzern so, die Entscheidungsgrenzen zu verstehen.

Versprechend, aber noch nicht klinikreif

An einem Datensatz von etwa 4.200 öffentlichen Hautbildern, angereichert mit simulierten Alters- und Körperpositionsdaten, identifizierte das Modell die Erkrankung in nahezu neun von zehn Fällen korrekt und sagte das zugewiesene Stadium mit nur geringfügig niedrigerer Genauigkeit voraus. Es übertraf mehrere starke konventionelle Netzwerke unter demselben Testsetup. Dennoch beschreiben die Autorinnen und Autoren ihre Arbeit zu Recht als Proof of Concept. Die Stadienlabels und Patientendaten wurden mithilfe einfacher Regeln erzeugt und nicht aus echten klinischen Aufzeichnungen entnommen, und kein Dermatologengremium bestätigte die Grundwahrheit. Folglich zeigt der derzeitige Erfolg des Systems hauptsächlich, dass diese Kombination aus Bildanalyse, Patientenkontext, quanteninspirierten Schichten und Erklärbarkeitswerkzeugen technisch machbar ist. Um daraus eine verlässliche Unterstützung für Ärztinnen und Ärzte zu machen, sind streng gelabelte, longitudinale Patientendaten und gründliche klinische Validierung erforderlich.

Zitation: Aravinda, C.V., Raja, J.E. & Alasmari, S. Quantum-enhanced multimodal prognostic transformer for skin disease progression prediction and visualization. Sci Rep 16, 8351 (2026). https://doi.org/10.1038/s41598-026-35951-2

Schlüsselwörter: Hautkrankheiten KI, Dermatologische Bildgebung, Krankheitsfortschritt, quanten-inspirierte Lernverfahren, medizinische erklärbare KI