Clear Sky Science · de

Verständnis der Diskussionen über psychische Gesundheit auf Reddit mit Transformern und Erklärbarkeit

Warum Online-Gespräche über Gefühle wichtig sind

Viele Menschen, die mit Angststörungen, Depressionen, bipolarer Störung oder Borderline-Persönlichkeitsstörung zu kämpfen haben, wenden sich ins Internet, bevor sie überhaupt mit einer Fachperson sprechen. Reddit ist mit seinen anonymen Communities zu einem großen Treffpunkt geworden, an dem Ängste geteilt, um Hilfe gebeten und andere unterstützt werden. Diese Studie untersucht, wie Tausende dieser Gespräche aussehen und wie künstliche Intelligenz sie sortieren und die Wörter hervorheben kann, die Menschen beim Sprechen über verschiedene psychische Herausforderungen am häufigsten verwenden.

Blick in Unterstützungsgemeinschaften

Die Forschenden konzentrierten sich auf vier große Reddit-Communities, die sich mit Angst, Depression, bipolarer Störung und Borderline-Persönlichkeitsstörung (oft BPD abgekürzt) befassen. Jeder Beitrag in ihrem Datensatz war lediglich durch die Community gekennzeichnet, aus der er stammte, nicht durch eine medizinische Diagnose. Das Team betrachtete diese Communities als „Räume der Sorge“, in denen sich Menschen mit ähnlichen Problemen versammeln, um Frust abzulassen, Rat zu suchen und Trost zu spenden. Indem sie untersuchten, wie sich die Sprache in diesen Räumen unterscheidet, hofften sie zu verstehen, wie Menschen ihre Erfahrungen mit eigenen Worten beschreiben, außerhalb einer Klinik.

Computern beibringen, Gespräche zu sortieren

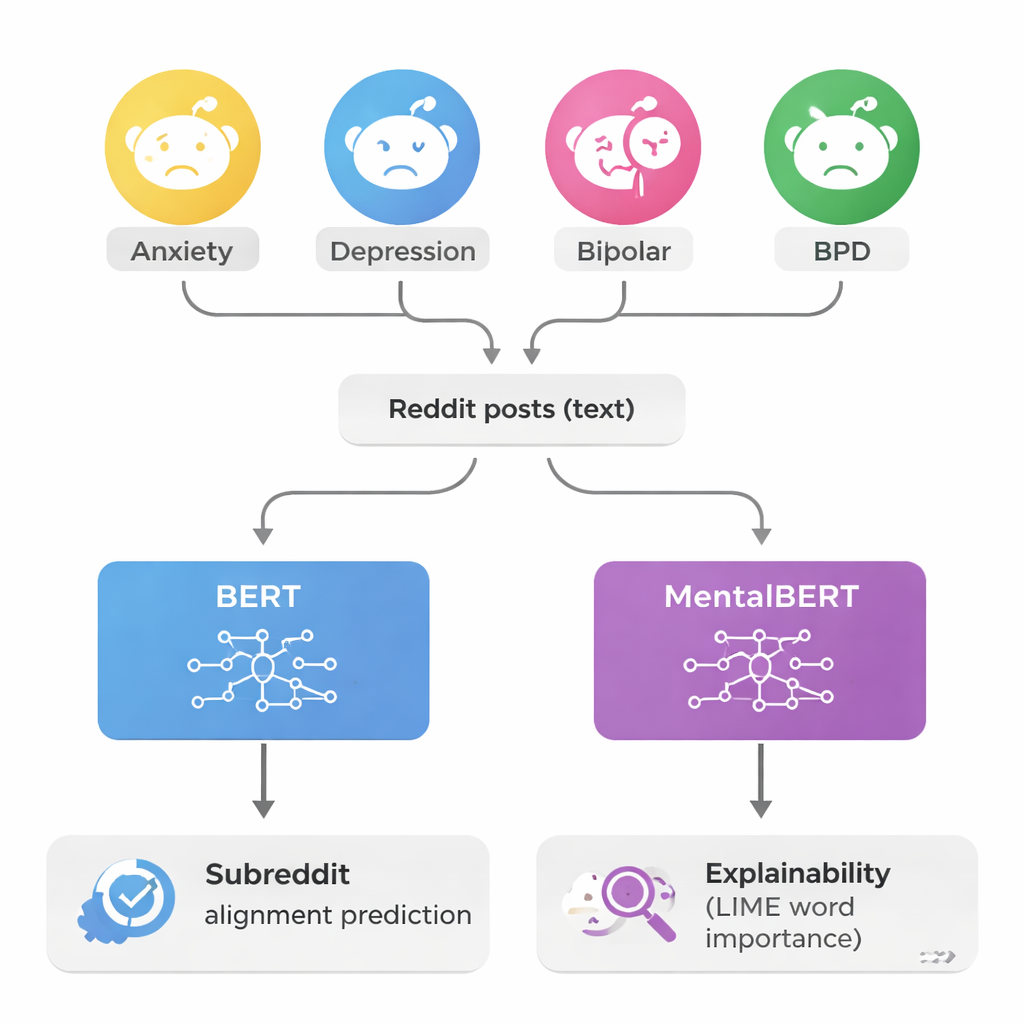

Um mehr als 150.000 Beiträge zu analysieren, nutzten die Autorinnen und Autoren leistungsfähige Sprachmodelle, sogenannte Transformer, konkret BERT und eine auf psychische Gesundheit spezialisierte Version namens MentalBERT. Diese Modelle lasen jeden Beitrag und versuchten zu erraten, zu welcher der vier Communities er gehörte. Weil einige Communities deutlich mehr Beiträge hatten als andere, balancierte das Team den Datensatz sorgfältig, sodass jede Gruppe gleich stark vertreten war. Das machte die Aufgabe schwieriger, aber fairer und zwang die Modelle dazu, echte Unterschiede in der Wortwahl zu lernen, anstatt einfach die häufigsten Communities zu bevorzugen. In Tests etikettierten die Modelle Beiträge korrekt in etwa 82 Prozent der Fälle — ein großer Sprung gegenüber reinem Zufall, das nur in einem Viertel der Fälle richtig wäre.

Die Black Box der KI öffnen

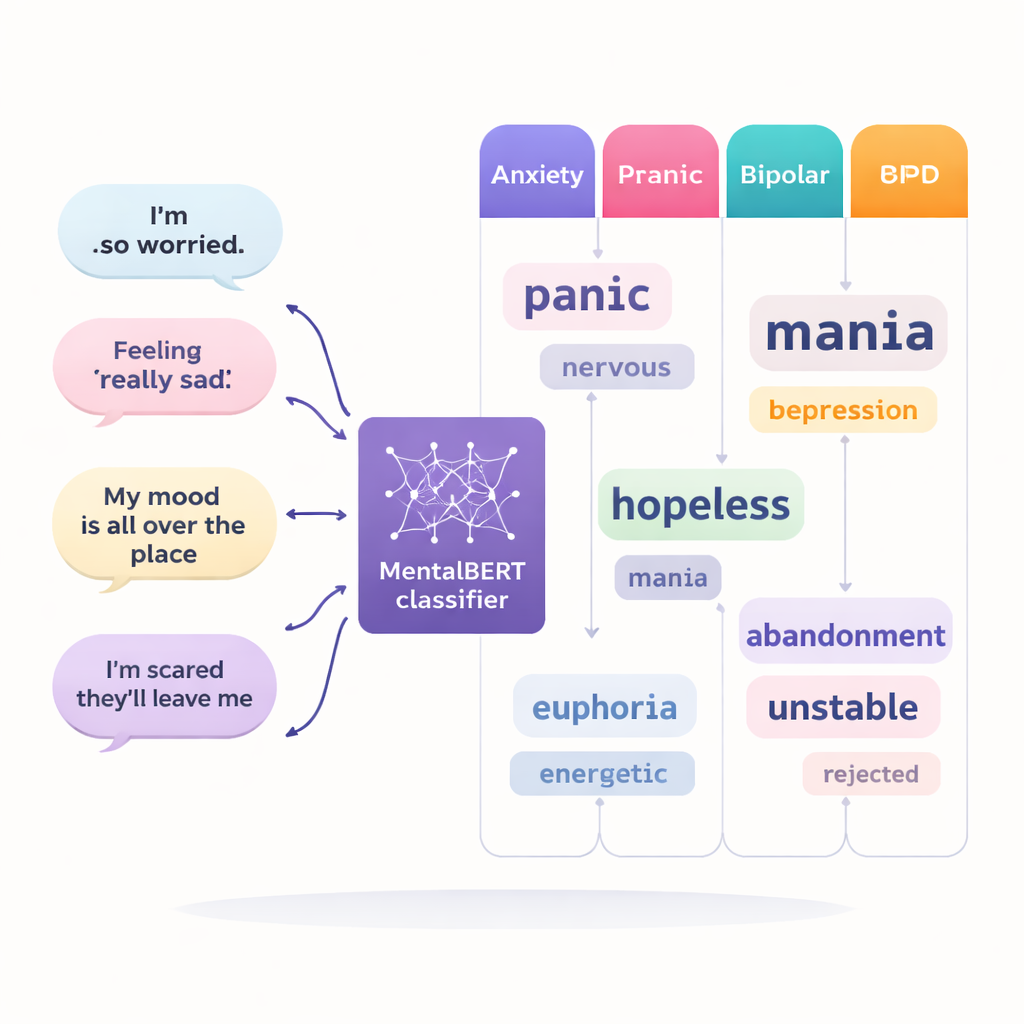

Ein zentrales Problem in der Technologie für psychische Gesundheit ist, dass Computersysteme wie rätselhafte „Black Boxes“ erscheinen können, die Vorhersagen ohne klare Begründung liefern. Um dem zu begegnen, verwendeten die Forschenden einen Ansatz namens LIME, der offenlegt, welche Wörter das Modell zu einer bestimmten Entscheidung veranlasst haben. Einfach gesagt blendet LIME Teile eines Beitrags aus oder verändert sie leicht und beobachtet, wie sich die Antwort des Modells ändert. Wenn das Entfernen eines Wortes wie „Panik“ plötzlich die vorhergesagte Community verändert, gilt dieses Wort als wichtig. Indem dieser Prozess tausendfach für viele Beiträge wiederholt wurde, erstellte das Team Listen der einflussreichsten Wörter für jede Community und überprüfte, ob diese Wörter mit dem übereinstimmen, was Klinikfachleute über die jeweiligen Zustände wissen.

Unterschiedliche Stimmen für verschiedene Belastungen

Die Erklärungen deckten klare Sprachmuster auf. In Angst-Communities hoben sich Wörter wie „Panik“, „Attacke“ und „Sorge“ hervor, oft verbunden mit körperlichen Symptomen und plötzlichen Angstschüben. Beiträge über Depressionen enthielten häufig Begriffe wie „hoffnungslos“, „wertlos“, „Leben“ und „mehr“, die tiefe Traurigkeit und das Gefühl widerspiegeln, dass sich nichts bessern wird. In Diskussionen über BPD verschoben sich die Schlüsselwörter in Richtung Beziehungen und Emotionen, darunter „Verlassenwerden“, „Beziehung“, „Bindung“ und „fp“ (Abkürzung für „favorite person“, ein in diesen Gruppen gebräuchlicher Begriff). Bipolare Beiträge betonten Stimmungsschwankungen und Behandlungssprache mit Wörtern wie „Manie“, „manisch“, „Hypomanie“, „Stimmung“ und Medikamentennamen wie „Lithium“ und „Lamictal“. Die Modelle zeigten auch Bereiche, in denen sich Zustände überschneiden: Angst- und Depressionsbeiträge können sich beispielsweise beide um Leid und negative Gefühle drehen, was sie leichter verwechselbar macht — ähnlich wie in der realen Diagnostik.

Von Online-Beiträgen zu realen Auswirkungen

Für Nicht-Fachleute ist die Kernbotschaft, dass Computer Gespräche über psychische Gesundheit thematisch zuverlässig sortieren und erklären können, welche Wörter ihre Entscheidungen beeinflussen, aber sie können und sollten weiterhin niemanden diagnostizieren. Die Modelle in dieser Studie fungieren eher wie Bibliothekarinnen und Bibliothekare für Online-Supporträume: Sie helfen zu prüfen, ob Diskussionen in einer Community tatsächlich ihrem erklärten Fokus entsprechen. Das könnte Moderierenden helfen, Gespräche relevant zu halten, und Forschenden oder Klinikern ein besseres Verständnis dafür geben, wie Menschen ihre Probleme außerhalb formeller Termine beschreiben. Mit sorgfältiger menschlicher Aufsicht sowie Beachtung von Privatsphäre und Stigmatisierung könnten solche Werkzeuge eines Tages freundlichere und besser organisierte Online-Räume für das Gespräch über psychische Gesundheit unterstützen.

Zitation: Sánchez Rodríguez, I., Bianchi, J., Pinelli, F. et al. Understanding mental health discourse on Reddit with transformers and explainability. Sci Rep 16, 6796 (2026). https://doi.org/10.1038/s41598-026-35918-3

Schlüsselwörter: psychische Gesundheit, soziale Medien, Reddit, erklärbare KI, Textklassifikation