Clear Sky Science · de

Verhaltensinformiertes Deep Reinforcement Learning zur Portfolioptimierung mit Verlustaversion und Selbstüberschätzung

Warum unsere Emotionen beim automatisierten Investieren zählen

Die meisten Menschen wissen, dass Angst und Selbstüberschätzung ihre Anlageentscheidungen beeinflussen können, aber wir neigen dazu anzunehmen, dass computerbasierter Handel völlig rational ist. Diese Studie stellt diese Vorstellung in Frage, indem sie zeigt, dass selbst automatisierte Systeme von „menschlichen“ Eigenschaften profitieren können. Indem Verlustaversion (Abneigung gegen Verluste) und Selbstüberschätzung gezielt in ein modernes KI-Handelssystem eingebaut werden, stellen die Autor*innen fest, dass Portfolios in Crashs widerstandsfähiger und in Aufschwüngen effektiver werden können — sowohl bei Kryptowährungen als auch bei Blue‑Chip‑Aktien.

Handelsroboter Angst und Mut beibringen

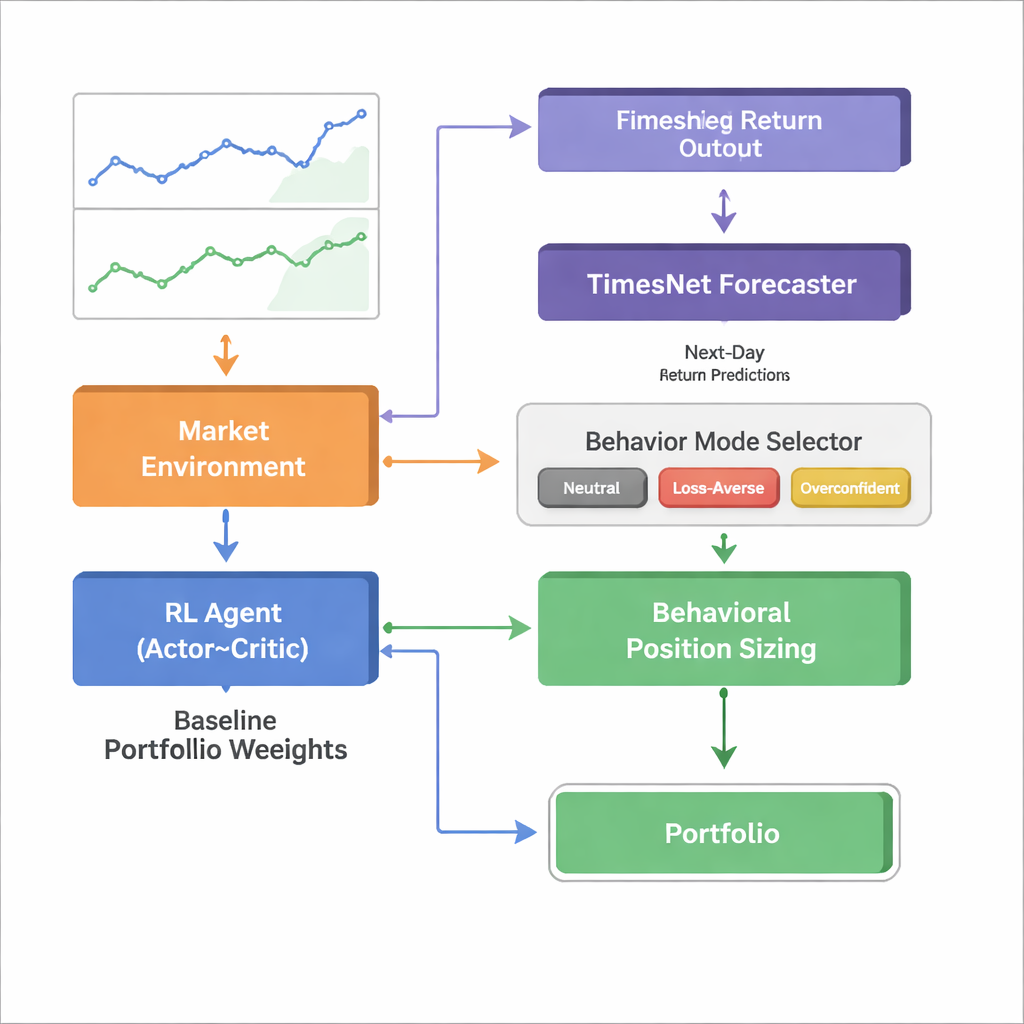

Die Forschenden starten mit einem leistungsfähigen Zweig der KI namens Deep Reinforcement Learning, bei dem ein Softwareagent durch Versuch und Irrtum lernt, ein Portfolio über die Zeit neu zu gewichten. In Standardversionen verhält sich der Agent wie ein lehrbuchmäßiger rationaler Investor: Er betrachtet Preise und Indikatoren und wählt Portfoliogewichte, die sich langfristig auszahlen sollen. Dieser neutrale Agent bleibt hier bestehen, wird aber durch eine verhaltensbasierte Schicht umhüllt, die zwei gut dokumentierte Anlageverhaltensweisen nachbildet: Verlustaversion (stärkere Reaktion auf Verluste als auf gleichgroße Gewinne) und Selbstüberschätzung (zu großes Vertrauen in die eigenen Prognosen). Anstatt zu verändern, was gekauft oder verkauft wird, beeinflussen diese Verhaltensregeln, wie groß die einzelnen Positionen sein sollten, nachdem der neutrale Agent eine Richtung gewählt hat.

Wie der verhaltensbasierte Sicherheitsgurt und der Turbolader wirken

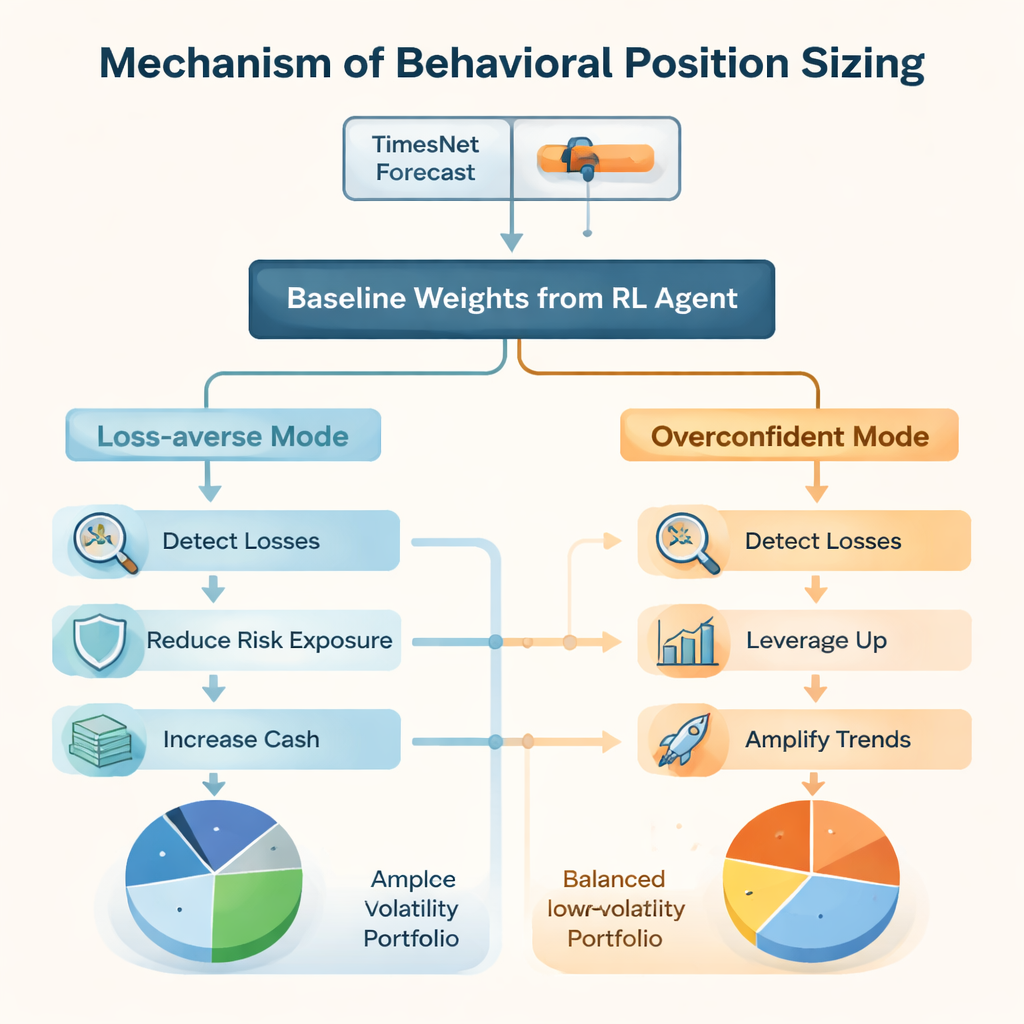

Im verlustaversen Modus richtet das System besonderes Augenmerk auf nicht realisierte Verluste einzelner Assets. Fällt eine Position über eine voreingestellte Schwelle hinaus, reduziert das Framework automatisch das Gesamtrisiko und verschiebt einen Teil des Portfolios in Bargeld, während es gleichzeitig leicht abgekämpfte Werte zugunsten eines typischen menschlichen Verhaltens modest favorisiert. Im Gegensatz dazu führen im selbstüberschätzten Modus starke Gewinne zu größeren Positionsgrößen und sogar zu Hebelwirkung, wodurch Trends aggressiver mitgenommen und nach starken Einbrüchen gelegentlich „nachgelegt“ wird, wenn ein Rebound erwartet wird. Wichtig ist, dass in allen Fällen der Reinforcement‑Learning‑Kern entscheidet, welche Assets gehalten werden; das Verhaltensmodul justiert lediglich die Exposition um diese Basis herum nach oben oder unten.

Dem Marktstimmungsbild die Wahl der Verhaltensweise überlassen

Um zu entscheiden, wann vorsichtig oder mutig vorgegangen werden soll, binden die Autor*innen eine separate Prognosemaschine namens TimesNet ein, ein Deep‑Learning‑Modell, das darauf ausgelegt ist, wiederkehrende Muster in Zeitreihen zu erkennen. TimesNet betrachtet die jüngsten Marktdaten und sagt die Rendite des nächsten Tages voraus. Erwartet es einen starken Aufschwung, wird der selbstüberschätzte Agent aktiviert; bei einer erwarteten Abwärtsbewegung übernimmt der verlustaverse Agent; und bei moderater Prognose bleibt der neutrale Agent in Kontrolle. Dieser Regime‑Schalter wird strikt auf Basis vergangener Daten in einer Walk‑Forward‑Prozedur trainiert, um einen Blick in die Zukunft zu vermeiden, und kann ohne Änderung der verhaltensbasierten Kernlogik gegen andere Prognosemodelle ausgetauscht werden.

Das verhaltensbewusste System auf die Probe stellen

Das Team bewertet sein Behavioral Bias–Aware Portfolio Trading (BBAPT) Framework in zwei sehr unterschiedlichen Umgebungen: einem Korb von 20 Kryptowährungs‑Assets von 2018 bis 2024 und der wechselnden Zusammensetzung der Dow‑Jones‑Industrial‑Average‑Aktien von 2008 bis 2024. Im Kryptobereich, wo starke Schwankungen üblich sind, erweist sich Verlustaversion in choppigen, seitwärts gerichteten Märkten als vorteilhaft, indem sie die Exposition verringert und tiefe Drawdowns begrenzt, während Selbstüberschätzung in starken Haussephasen durch Verstärkung von Gewinnern punktet. Über den gesamten Zeitraum liefert das kombinierte BBAPT‑System — unter Verwendung von TimesNet zur Auswahl zwischen neutralem, verlustaversen und selbstüberschätztem Modus — eine höher risikoadjustierte Performance als klassische Markowitz‑Portfolios, einfache gleichgewichtete Strategien und Reinforcement‑Learning‑Agenten ohne verhaltensbezogene Anpassungen.

Ergebnisse, die auch an etablierten Aktienmärkten Bestand haben

In den Langzeittests mit dem Dow Jones, die die Finanzkrise 2008, den COVID‑19‑Crash und die Inflationsschocks 2022 einschließen, wiederholen sich dieselben Muster. Alle auf Reinforcement Learning basierenden Strategien schlagen statische Portfolios sowohl bei Rendite als auch bei der Sharpe‑Ratio, einem gängigen Maß für Rendite pro Risikoeinheit. Innerhalb dieser Gruppe bietet die verlustaverse Konfiguration die ruhigste Fahrt mit den geringsten maximalen Verlusten, die selbstüberschätzte Konfiguration erzielt die höchsten reinen Gewinne auf Kosten größerer Schwankungen, und das vollständige BBAPT‑Framework liegt auf der effizienten Grenze, indem es starke Renditen mit moderatem Risiko verbindet. Die Autor*innen berücksichtigen außerdem Änderungen in der Indexzusammensetzung, um Überlebensbias zu vermeiden, und stellen fest, dass die Hauptschlussfolgerungen erhalten bleiben.

Was das für den Alltagsanleger bedeutet

Für Nicht‑Fachleute ist die Kernbotschaft, dass erfolgreicher algorithmischer Handel nicht auf psychologische Faktoren verzichten muss; er kann diese nutzen. Durch das gezielte Einbauen kontrollierter Versionen von Angst und Mut in einen KI‑Trader — und durch das Überlassen der Entscheidung, welche Eigenschaft jeweils dominieren soll, an ein Prognosemodell — schafft das BBAPT‑Framework Portfolios, die sich an Booms und Busts auf eine intuitivere Weise anpassen. Die Arbeit deutet auf eine Zukunft hin, in der „intelligente“ Handelssysteme nicht nur datengetrieben, sondern auch verhaltensbewusst sind und Anleger*innen Werkzeuge bieten, die robuster und leichter nachvollziehbar sind als Black‑Box‑Modelle, die perfekte Rationalität voraussetzen.

Zitation: Charkhestani, A., Esfahanipour, A. Behaviorally informed deep reinforcement learning for portfolio optimization with loss aversion and overconfidence. Sci Rep 16, 6443 (2026). https://doi.org/10.1038/s41598-026-35902-x

Schlüsselwörter: algorithmischer Handel, Behavioral Finance, Reinforcement Learning, Portfolioptimierung, Kryptowährungsmärkte