Clear Sky Science · de

Ein Q-Learning-Ansatz zur Reduzierung von Abraum in der Gestaltung von Tagebauen auf Basis von Prinzipien der saubereren Produktion

Warum intelligentere Bergwerke wichtig sind

Die moderne Gesellschaft läuft mit Metallen — vom Kupfer in unseren Telefonen bis zur Verkabelung in Stromnetzen. Diese Metalle zu gewinnen bedeutet jedoch oft, riesige Tagebaue in die Erde zu schneiden und ungeheure Mengen an Gestein zu bewegen. Der Großteil dieses Gesteins ist Abfall, der über Jahrzehnte transportiert, deponiert und überwacht werden muss. Diese Studie untersucht einen neuen Weg, Tagebaue zu planen, der künstliche Intelligenz, genauer eine Methode namens Q-Learning, einsetzt, um Abraum und seine Umweltschäden zu reduzieren und gleichzeitig die Rentabilität der Mine zu erhalten.

Die versteckten Kosten, Berge zu bewegen

In einem typischen Tagebau-Kupferbergwerk definieren Ingenieure zunächst die ultimative Tagebaugrenze — die äußere Hülle des Gesteins, das sich über die Lebensdauer des Bergwerks lohnt zu entfernen. Innerhalb dieser Hülle liegt Erz mit wertvollen Metallen; außerhalb liegt Gestein, dessen Abbau zu teuer wäre. Traditionelle Planungsmethoden konzentrieren sich fast ausschließlich auf den finanziellen Ertrag aus dem Metallverkauf abzüglich der direkten Kosten für Bohren, Sprengen, Fördern und Aufbereiten. Sie ignorieren weitgehend die langfristigen ökologischen Rechnungen für den Umgang mit Abraummassen, wie Landdegradation, Verschmutzung und das Risiko saurer Grubenwässer. In der Folge kann ein Tagebau auf dem Papier attraktiv erscheinen, während er in Wirklichkeit große zukünftige Verpflichtungen für Sanierung und Wasserbehandlung festschreibt.

Einem digitalen Agenten beibringen, zu graben

Die Forschenden verwandeln die Tagebauplanung in ein Lernproblem statt in eine einmalige Berechnung. Sie teilen den Erzling in tausende dreidimensionale Blöcke auf, jeder mit eigenem Ertrag, Abbaukosten, Aufbereitungskosten und einer sorgfältig geschätzten Umweltkosten pro Tonne Erz und Abraum. Ein Computer-„Agent“ übt dann, diese Blöcke schrittweise innerhalb einer simulierten Mine abzubauen. Wenn er Blöcke wählt, die den Gesamtwert erhöhen und gleichzeitig sichere Hangneigungen einhalten, erhält er eine positive Belohnung; wenn er Hangregeln verletzt oder Blöcke verfolgt, die nach Einrechnung der Umweltkosten unprofitabel werden, wird er bestraft. Über viele Trainingszyklen hinweg nutzt der Agent Q-Learning, um ein Abbaumuster — eine Policy — zu entdecken, das Gewinn mit reduziertem Abraum und geringerer Umweltbelastung ausbalanciert.

Von Spielmodellen zu einem riesigen Kupfertagebau

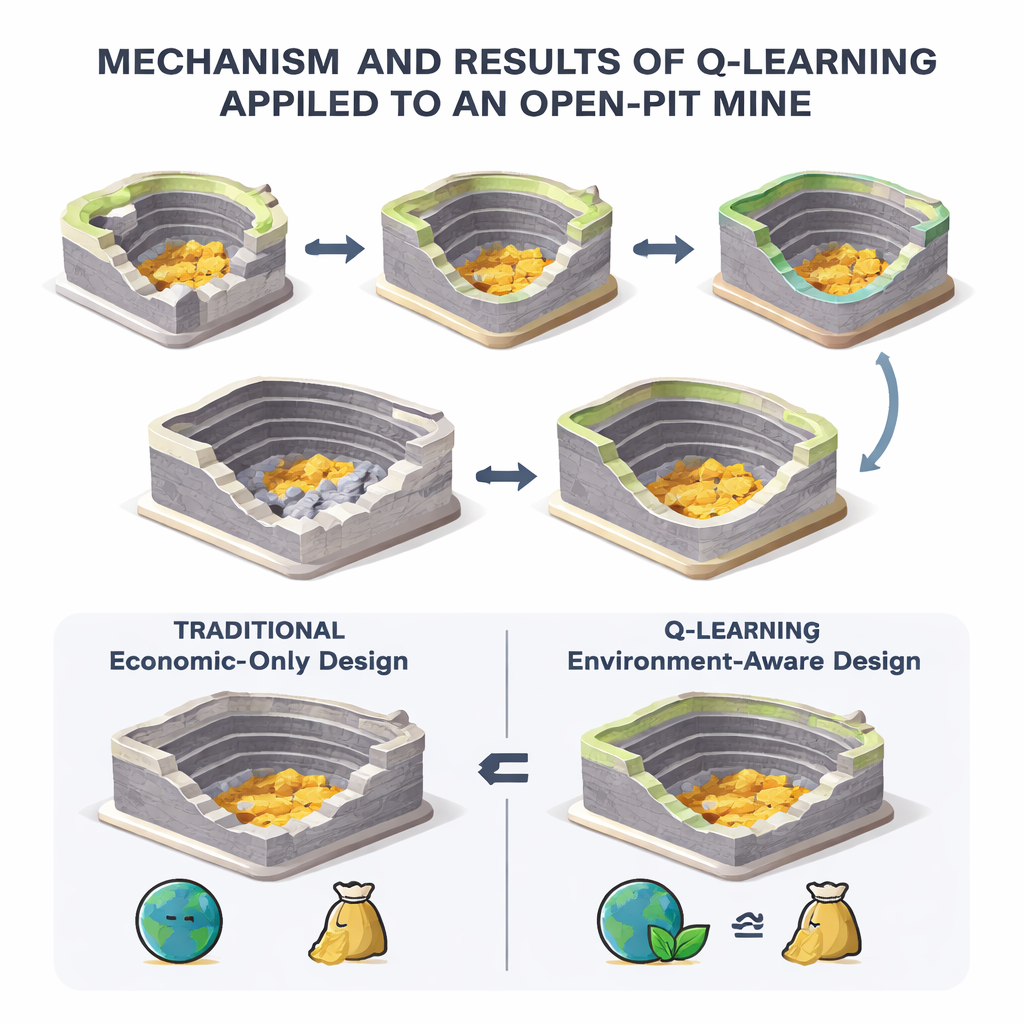

Um die Idee zu testen, wandte das Team das Q-Learning-Framework zunächst auf kleine zwei- und dreidimensionale Testlagerstätten an. In diesen Experimenten verbesserte der digitale Agent seine Strategie schrittweise: Anfangs waren die Tagebauformen zackig und ineffizient, doch nach tausenden Lernschritten wurden die Gruben glatt, realistisch und wirtschaftlich sinnvoll. Die entscheidende Änderung war, dass nachdem Umweltkosten in den Wert jedes Blocks eingerechnet waren, viele marginal profitable Blöcke, die zuvor attraktiv erschienen, zu Nettoverlusten wurden, sodass der Agent lernte, sie im Boden zu belassen. Wichtig ist, dass die resultierenden Gruben nahezu dieselbe Erzmenge förderten, aber weniger Abraummassen entfernten.

Echter Bergbau, echte Kompromisse

Der wirkliche Beweis kam durch die Anwendung der Methode auf die Sarcheshmeh-Kupfermine im Iran, eine der größten Kupferbetriebe des Landes. Das neue, Q-Learning-basierte Design wurde mit dem branchenüblichen Lerchs–Grossmann-Algorithmus verglichen, der rein auf finanziellen Ertrag optimiert. Das traditionelle Design erzielte auf dem Papier geringfügig höhere Gewinne, tat dies jedoch, indem es Umweltkosten außer Acht ließ. Das Q-Learning-Design hingegen reduzierte den Abraum um Millionen Tonnen, während es nahezu exakt dieselbe Erzmenge zurückgewann. Es lief außerdem schneller auf demselben Computer und verkürzte die Optimierungszeit um etwa 20 Prozent. Das Endergebnis war eine etwas kleinere, kompaktere Grube, die weniger Land beeinträchtigen und weniger Material freilegen würde, das saure Laugen erzeugen kann, ohne nennenswerte Einnahmen zu opfern.

Überdenken, was „Profit“ wirklich bedeutet

Für Nichtfachleute lautet die Kernbotschaft: Wie wir Bergwerke planen, kann ihren langfristigen Fußabdruck dramatisch verändern, selbst wenn die kurzfristigen Gewinne ähnlich aussehen. Indem ein Algorithmus von der ersten Planungsstufe an Umweltschäden als reale Kosten behandelt, zeigt die Studie, dass es möglich ist, nahezu dieselbe Metallmenge zu fördern und dabei weniger Gestein zu bewegen, eine kleinere Narbe zu hinterlassen und wahrscheinlich später weniger für die Sanierung zu zahlen. Anders ausgedrückt: Das intelligenteste Bergwerk ist nicht jenes, das heute jeden letzten Dollar herauspresst, sondern jenes, das erkennt, dass die Rechnung der Natur früher oder später fällig wird — und entsprechend plant.

Zitation: Badakhshan, N., Bakhtavar, E., Shahriar, K. et al. A Q-learning approach to waste rock reduction in open-pit mine design based on cleaner production principles. Sci Rep 16, 6447 (2026). https://doi.org/10.1038/s41598-026-35892-w

Schlüsselwörter: Tagebau, Abraum, Reinforcement Learning, nachhaltiger Bergbau, Bergwerksplanung