Clear Sky Science · de

Hochpräzise Gehirntumor-Erkennungsmethode basierend auf Deep Learning

Warum es wichtig ist, Gehirntumore früher zu erkennen

Gehirntumore gehören zu den tödlichsten Erkrankungen des Nervensystems, und eine frühe Erkennung kann über Leben und Tod entscheiden. Heute suchen Ärztinnen und Ärzte in der Regel durch sorgfältige visuelle Begutachtung von Magnetresonanztomographie-(MRT-)Aufnahmen nach Tumoren — eine anspruchsvolle Aufgabe, die zeitaufwendig, subjektiv und leicht fehlbar ist, insbesondere wenn der Tumor sehr klein ist oder unscharfe Ränder hat. Diese Studie beschreibt ein neues System der künstlichen Intelligenz (KI), das Radiologinnen und Radiologen dabei helfen soll, drei häufige Arten von Gehirntumoren schneller und genauer zu finden, was die Behandlungsplanung und die Patientenergebnisse verbessern könnte.

Ein schlauerer digitaler Assistent für MRT-Aufnahmen

Die Forschenden bauen auf einer beliebten Familie von Echtzeit-Objekterkennungsalgorithmen namens YOLO auf, die häufig eingesetzt wird, um Objekte in Alltagsfotos und -videos zu lokalisieren. Statt Autos oder Fußgänger erkennt die weiterentwickelte Version jedoch Meningeome, Hypophysen-Tumoren und Gliome in MRT-Bildern des Gehirns. Mithilfe eines öffentlichen Datensatzes von der Plattform Kaggle und zusätzlichen CT-Aufnahmen von Radiopaedia trainierte das Team sein System darauf, um Tumoren Begrenzungsrahmen zu zeichnen und ihren Typ zu kennzeichnen. Anschließend verglichen sie die Leistung mit mehreren hochmodernen KI-Modellen, um zu prüfen, ob das neue Design Ärztinnen und Ärzten tatsächlich hilft, mehr Relevantes zu sehen und weniger Irrelevantes.

Die kleinen und subtilen Anzeichen erkennen

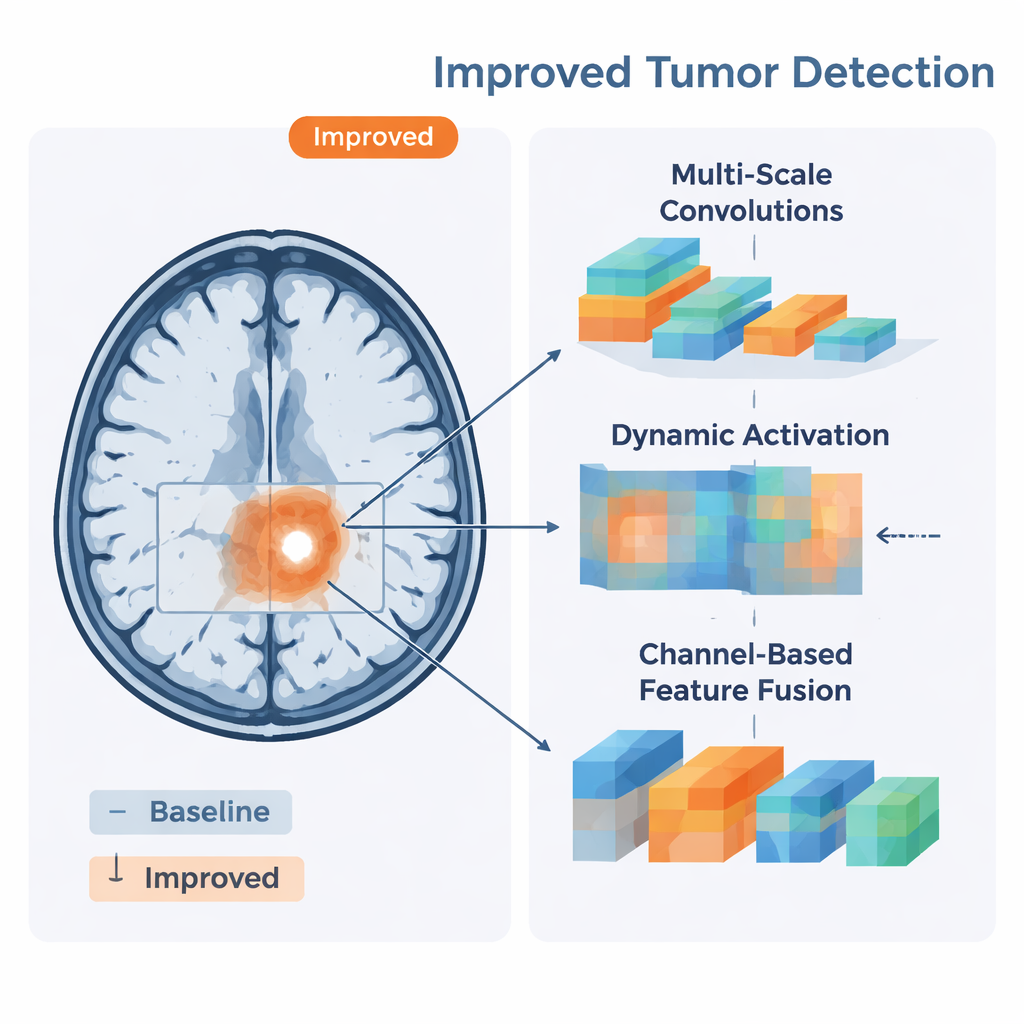

Eine zentrale Herausforderung in der Hirnbildgebung ist, dass Tumore in Größe und Form stark variieren und sich manche fast nahtlos ins umliegende Gewebe einfügen. Um dem zu begegnen, führten die Autorinnen und Autoren ein neues Element ein, das sie A2C2f-Mona-Modul nennen. Vereinfacht gesagt betrachtet es jede Aufnahme gleichzeitig durch mehrere „Linsen“ unterschiedlicher Größe und erfasst so sowohl feine Details als auch größere Muster. Diese mehrskalige Sichtweise hilft dem System, subtile Veränderungen in Textur und Intensität zu erfassen, die die Grenze eines Tumors markieren können. In Tests verbesserte dieses Design besonders die Erkennung kleiner oder schwach ausgeprägter Läsionen, bei denen Standardmodelle häufig zögern oder das Ziel ganz übersehen.

Das Lernen stabil und fokussiert halten

Das Training tiefer neuronaler Netze stützt sich oft auf mathematische Tricks, sogenannte Normalisierungsschichten, um interne Signale vor dem Über- oder Unterlaufen zu bewahren. In der medizinischen Bildgebung, wo Bildbatches klein und heterogen sein können, können diese Verfahren jedoch instabil und rechenintensiv werden. Die Studie ersetzt sie durch eine leichtere „dynamische“ Transformation, genannt C2PSA-DyT, die eine glatte mathematische Kurve nutzt, um Aktivierungen in einem vernünftigen Bereich zu halten, ohne den üblichen Overhead. Diese Änderung macht das Modell stabiler im Training und schafft Kapazität für andere Verbesserungen, sodass es über viele verschiedene Aufnahmen hinweg eine konsistente Leistung erbringt.

Hinweise aus verschiedenen Ebenen zusammenführen

Eine weitere Hürde besteht darin, grobe, hochlevelige Informationen (zum Beispiel, wo sich eine verdächtige Region befindet) mit scharfen, niedrig-leveligen Details (wie genaue Kanten und Texturen) zu verknüpfen. Die Autorinnen und Autoren gehen dies mit einem CGAFusion-Modul an, das ein wenig wie ein Spotlicht funktioniert: Es hebt die informativsten Kanäle des Bildes hervor und dimmt weniger nützliche. Durch das Verschmelzen flacher und tiefer Merkmale mit erlernten Aufmerksamkeitsgewichten wird das System besser darin, Tumore mit in die Umgebung auslaufenden Rändern zu umreißen und Tumore von ähnlich aussehenden Strukturen wie Blutgefäßen oder Hirnhaut zu unterscheiden. Visuelle Erklärungen mithilfe von Grad-CAM-Heatmaps zeigen, dass die Aufmerksamkeit des Modells tendenziell genau auf die tatsächlichen Tumorregionen fällt und gut mit Expertenurteil übereinstimmt.

Was die Ergebnisse für Patientinnen, Patienten und Ärztinnen und Ärzte bedeuten

Im Testdatensatz für Gehirntumore erreichte das neue System eine Präzision von etwa 94 % und eine Sensitivität (Recall) von 88 %, beides Werte über denen der stärksten YOLO-Basisvariante und mehrerer anderer führender Detektoren. Besonders gut gelang die Erkennung von Hypophysen-Tumoren, eine Kategorie, bei der verpasste Fälle schwerwiegende hormonelle und Sehstörungen haben können, und die Erkennung schwer zu entdeckender Gliome verbesserte sich moderat, aber signifikant. Wichtig ist, dass die Methode immer noch schnell genug für den Echtzeiteinsatz läuft, was darauf hindeutet, dass sie als zweite Augenpaar für Radiologinnen und Radiologen in Krankenhaus-Workflows integriert werden könnte. Die Autorinnen und Autoren merken zwar an, dass vor einer klinischen Einführung größere, multizentrische Studien und echte 3D-Bildgebung nötig sind, aber ihre Arbeit zeigt, dass sorgsam entworfene KI die Gehirntumorerkennung sowohl genauer als auch verlässlicher machen kann — und so Ärztinnen und Ärzte entlastet, während der Algorithmus unermüdlich jedes Pixel durchsucht.

Zitation: Ye, W., Chen, Z., Sun, X. et al. High-accuracy brain tumor detection method based on deep learning. Sci Rep 16, 5122 (2026). https://doi.org/10.1038/s41598-026-35783-0

Schlüsselwörter: Gehirntumorerkennung, MRT-Bildgebung, Deep Learning, Objekterkennung, medizinische KI