Clear Sky Science · de

DermNet: integrative CNN-ViT-Architektur zur Bias-Minderung in der dermatologischen Diagnostik mithilfe fortschrittlicher unüberwachter Läsionssegmentierung

Warum eine gerechte Diagnostik bei heller und dunkler Haut wichtig ist

Hautkrankheiten betreffen fast jeden irgendwann im Leben, von Akne und Ekzemen bis hin zu schwereren Erkrankungen. Für viele Menschen mit brauner oder dunkler Haut sind diese Probleme jedoch schwerer zu erkennen und werden häufiger falsch diagnostiziert — sowohl in der Klinik als auch durch Werkzeuge der künstlichen Intelligenz (KI). Dieses Paper stellt DermNet vor, ein neues KI-System, das Hautkrankheiten über verschiedene Hauttöne hinweg gerechter erkennen soll, indem es dem Computer beibringt, sich auf die tatsächlich erkrankte Stelle zu konzentrieren statt auf die Farbe der umliegenden Haut.

Das Problem von Einheitslösungen in der KI für Haut

Die meisten existierenden KI-Systeme zur Hautdiagnose werden mit Fotos trainiert, die stark zu hellen Hauttönen tendieren. Bei der Anwendung auf Menschen mit dunklerer Haut sinkt die Genauigkeit dieser Systeme um 8–12 %. Im Alltag kann dieser Unterschied bedeuten, dass frühe Warnzeichen übersehen und Behandlungen verzögert werden. Ausgewogene medizinische Fotodatensätze zu sammeln ist außerdem schwierig: Bilder sind über Krankenhäuser verstreut, in manchen Ländern gibt es wenig digitale Dokumentation, und die Expertenbeschriftung durch Dermatologen ist zeitaufwendig und teuer. Dadurch lernt die KI oft Abkürzungen, etwa bestimmte Krankheiten vor allem mit heller Haut zu assoziieren, anstatt wirklich zu verstehen, wie eine Läsion aussieht.

Dem Computer beibringen, nur die wunde Stelle zu sehen

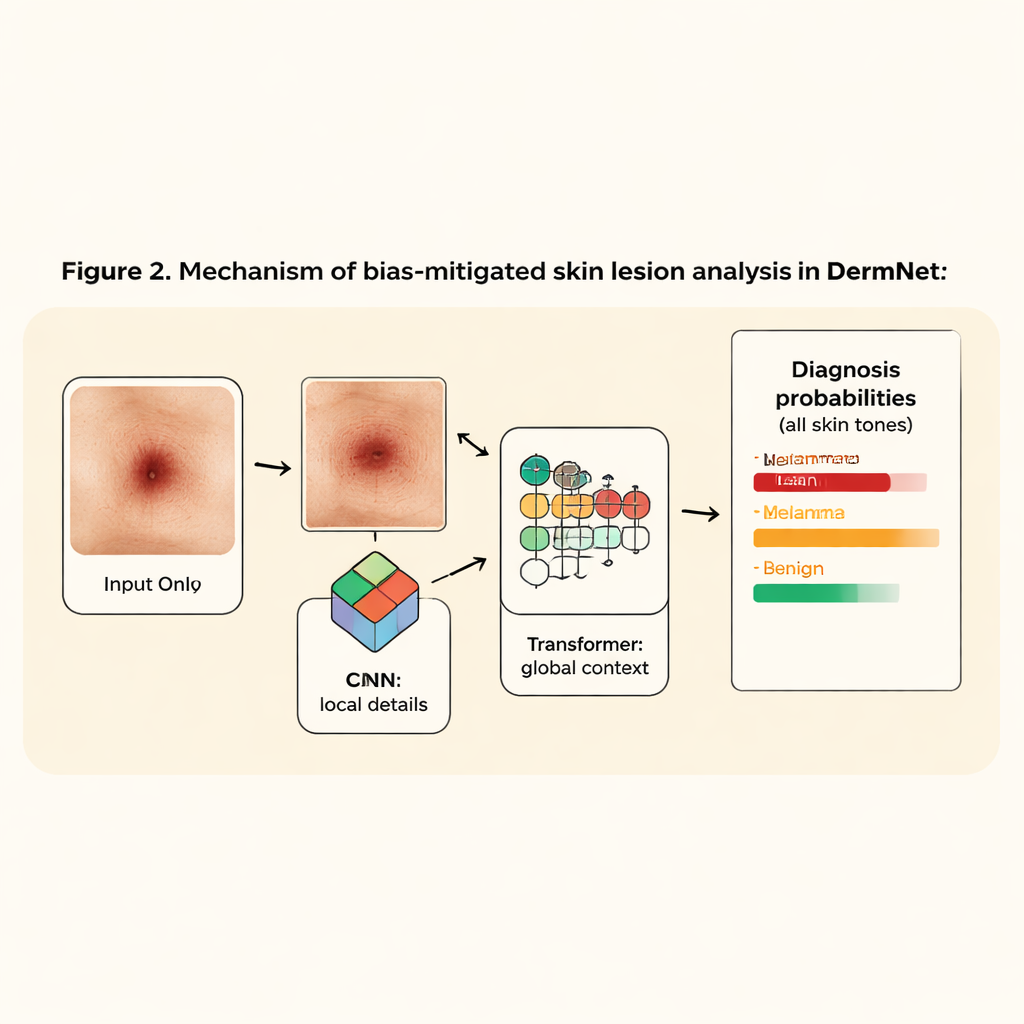

Die Autoren gehen das Bias-Problem an der Quelle an: beim Bild selbst. Statt komplette Fotos von Armen, Gesichtern oder Beinen in die KI zu füttern, schneiden sie zunächst automatisch nur den erkrankten Bereich — die Läsion — aus, unabhängig von der Farbe der umgebenden Haut. Dafür kombinieren sie ein leistungsfähiges Open-Source-Tool namens Segment Anything (das Objekte ohne spezielles Training umreißen kann) mit klassischen Bildverarbeitungs-Tricks, die Unterschiede in Farbe und Helligkeit hervorheben. Durch geschicktes Wechseln des Farbraums und automatische Schwellwertverfahren erzeugen sie schwarz-weiße „Masken“, die Läsion und gesunde Haut trennen. Erstaunlicherweise erreicht diese unüberwachte Pipeline etwa 90 % Überlappung mit fachgerechten Läsionsumrissen bei sowohl hellen als auch dunklen Hauttönen, ohne auf handgezeichnete Trainingsmasken angewiesen zu sein.

Ein schlankeres, klügeres Netzwerk für Hautkrankheiten

Sobald die Läsion isoliert ist, übernimmt DermNet. Dieser Klassifikator verbindet zwei verbreitete KI-Ideen: Convolutional Neural Networks (CNNs), die gut darin sind, Kanten und Texturen zu erkennen, und Vision Transformer, die darin brillieren, langfristige Muster über ein Bild hinweg zu erfassen. DermNet nutzt zunächst nur zwei leichte CNN-Schichten, um feine Details aus der zugeschnittenen Läsion zu extrahieren, und übergibt diese Muster dann an einen Transformer, der lernt, wie verschiedene Teile der Läsion zueinander in Beziehung stehen. Da das System keine Ganzkörperfotos mehr analysieren muss, bleibt es klein — etwa 2,5 Millionen Parameter, unter 10 Megabyte — und übertrifft dennoch deutlich größere, weit verbreitete Bildmodelle.

Hinter den Kulissen: ein gerechterer Datensatz

Um DermNet zu trainieren und zu testen, fasste das Team zwei von Dermatologen annotierte Sammlungen zu dem zusammen, was sie SkinCon nennen. Nach der Vorgabe von mindestens 20 Bildern pro Erkrankung erhielten sie 3.643 Bilder zu 122 Erkrankungen, mit etwa einem Drittel jeweils aus hellem, braunem und dunklem Hauttyp. Sie erweiterten diesen Satz zusätzlich durch einfache Transformationen wie Rotation und Helligkeitsänderungen, um Overfitting zu reduzieren und die Robustheit zu verbessern. Mit diesem vielfältigen und kuratierten Datensatz stellte sich heraus, dass das Training mit vollständigen, nicht segmentierten Bildern zu instabilem Lernen und Validierungsgenauigkeiten von rund 50–56 % führte. Bei Umstellung auf nur die Läsion stieg die Leistung stark an: DermNet erreichte etwa 81 % Validierungsgenauigkeit und tat dies konsistenter über alle drei Hauttongruppen hinweg.

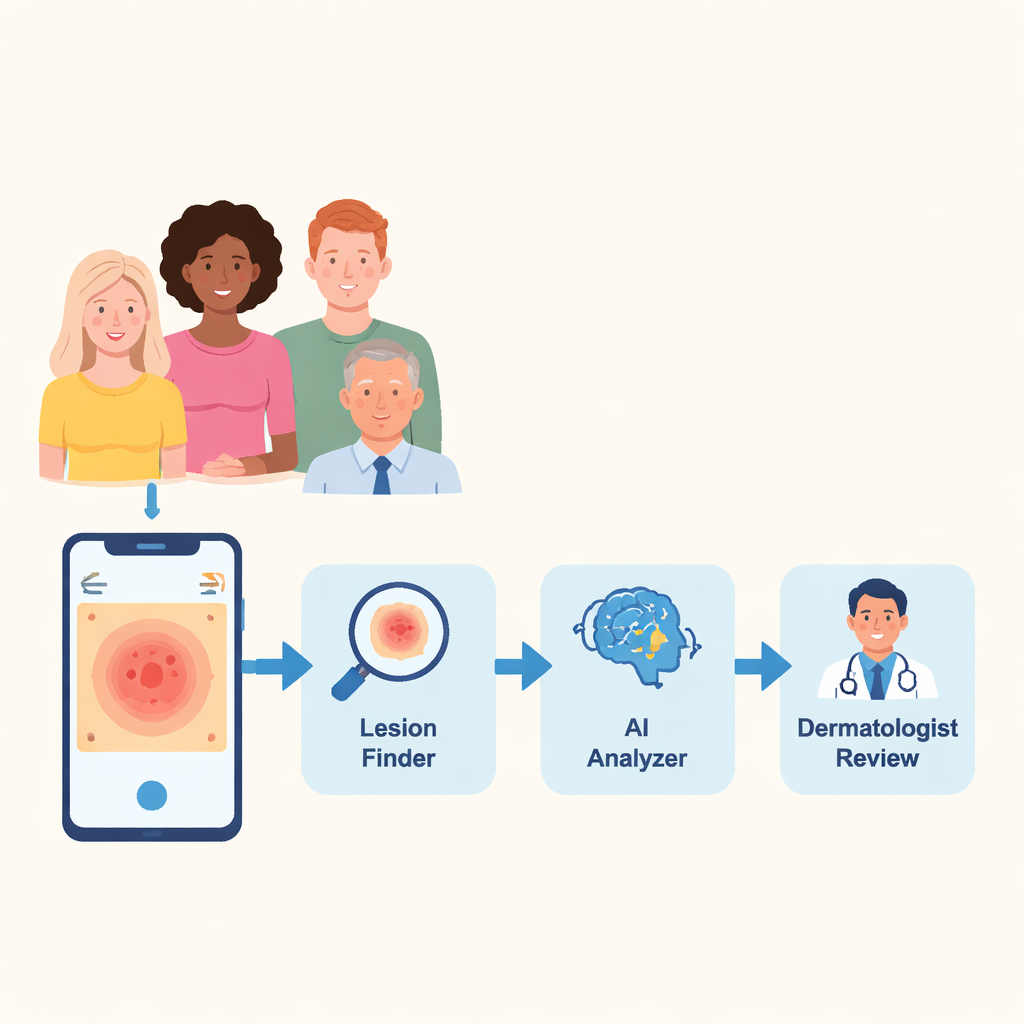

Vom Labor-Pipeline zur Taschenhilfe

Um zu zeigen, wie das in der Praxis funktionieren könnte, entwickelten die Forscher eine prototypische mobile App. Ein Nutzer macht ein Foto oder lädt ein Bild einer verdächtigen Hautstelle hoch; das System segmentiert die Läsion automatisch, führt sie durch DermNet und gibt die drei wahrscheinlichsten Diagnosen mit ihren Wahrscheinlichkeiten zurück — in unter 20 Sekunden — und überlässt das endgültige Urteil einem Dermatologen. Solche Werkzeuge sind zwar kein Ersatz für einen Arzt, könnten aber frühe Krankheitsstadien aufzeigen, insbesondere in Regionen mit wenigen Dermatologen, und helfen, die knappe Spezialistenzeit auf die dringendsten Fälle zu lenken.

Was das für Patientinnen und Patienten bedeutet

Die wichtigste Schlussfolgerung für nicht Fachleute ist: KI muss nicht auf naive Weise „farbenblind“ sein; statt dessen kann sie dazu gebracht werden, auf das Richtige zu schauen: die Läsion selbst. Indem der Einfluss des Hauthintergrunds entfernt und der Fokus auf den erkrankten Bereich gelegt wird, zeigt diese Studie, dass es möglich ist, ein schlankes, genaues Modell zu bauen, das Bilder von heller, brauner und dunkler Haut gleicher behandelt. DermNet ist ein früher Schritt hin zu Hautkrankheits-Apps und Diagnosesystemen, die zuverlässig für alle funktionieren — nicht nur für diejenigen, deren Haut dem Großteil bestehender medizinischer Fotos entspricht.

Zitation: Imran, M.H., Shahid, M., Aazam, M. et al. DermNet: integrative CNN-ViT architecture for bias mitigation in dermatological diagnostics using advanced unsupervised lesion segmentation. Sci Rep 16, 5291 (2026). https://doi.org/10.1038/s41598-026-35697-x

Schlüsselwörter: Diagnose von Hautkrankheiten, Bias in medizinischer KI, Läsionssegmentierung, Dermatologische Bildgebung, Vision Transformer