Clear Sky Science · de

Neo-Hebbian-Synapsen zur Beschleunigung des Online-Trainings neuromorpher Hardware

Chips beibringen, aus Erfahrung zu lernen

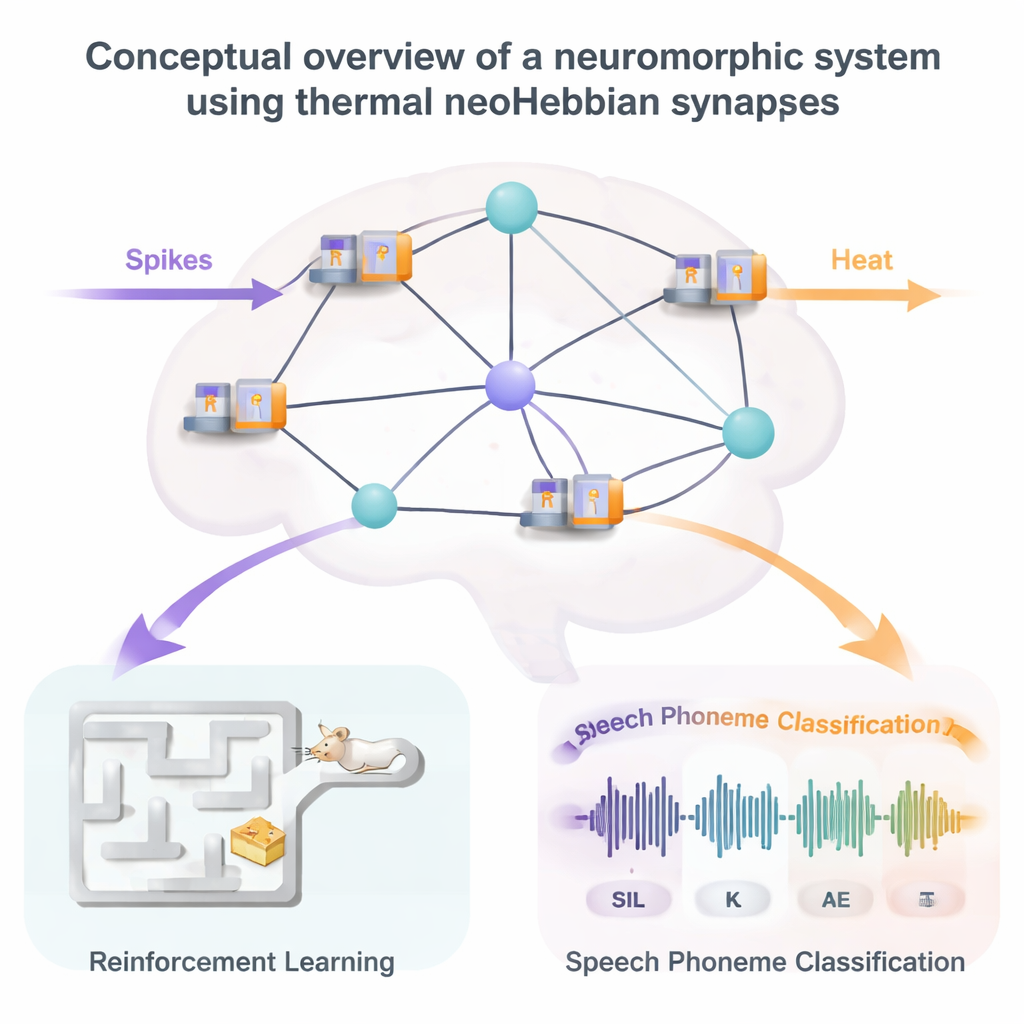

Moderne künstliche Intelligenz ist bemerkenswert leistungsfähig, kommt aber noch nicht an die Fähigkeit des Gehirns heran, aus spärlichem, verzögertem Feedback zu lernen – etwa daran zu erinnern, welche Abkürzung durch die Stadt tatsächlich Zeit spart. Diese Arbeit stellt eine neue Art künstlicher „Synapse“ vor, also Verbindungen zwischen künstlichen Neuronen, die neuromorphe Chips ein stärker gehirnähnliches, onlinees Lernen ermöglicht und dabei kompakt sowie energieeffizient bleibt. Für Leser, die sich für die Zukunft der KI‑Hardware interessieren, zeigt sie, wie Wärme selbst als nützliches Lernsignal in winzigen Speicherelementen genutzt werden kann.

Warum neuromorphe Systeme bessere Synapsen brauchen

Neuromorphe Datenverarbeitung zielt darauf ab, die Informationsverarbeitung des Gehirns nachzuahmen: mit spikenden neuronalen Netzen, in denen kurze elektrische Impulse durch weit verzweigte Synapsennetze laufen. Die heutige Hardware kann Synapsen bereits mit memristiven Bauelementen wie ReRAM abbilden, deren elektrische Leitfähigkeit sich zur Speicherung eines Gewichts einstellen lässt. Einfache „hebbianische“ Lernregeln – bei denen Synapsen allein aus lokaler Spike‑Timing‑Information gestärkt oder geschwächt werden – stoßen jedoch bei realistischen Aufgaben an Grenzen, die das Verknüpfen zeitlich getrennter Ereignisse erfordern, etwa bei Sprachverstehen oder Navigationsproblemen. Standard‑Deep‑Learning‑Techniken lösen das mithilfe von Backpropagation through time, doch diese Methode ist für gehirnähnliche Hardware zu speicher‑ und energieintensiv. Daher hat die Community zu „Drei‑Faktor“‑Lernregeln und Algorithmen wie Eligibility Propagation (e‑prop) gegriffen, die an jeder Synapse eine zusätzliche lokale Gedächtnisspur vorsehen, sodass ein verzögertes globales Belohnungssignal trotzdem die richtigen Verbindungen anpassen kann.

Eine vergängliche Erinnerung in Wärme speichern

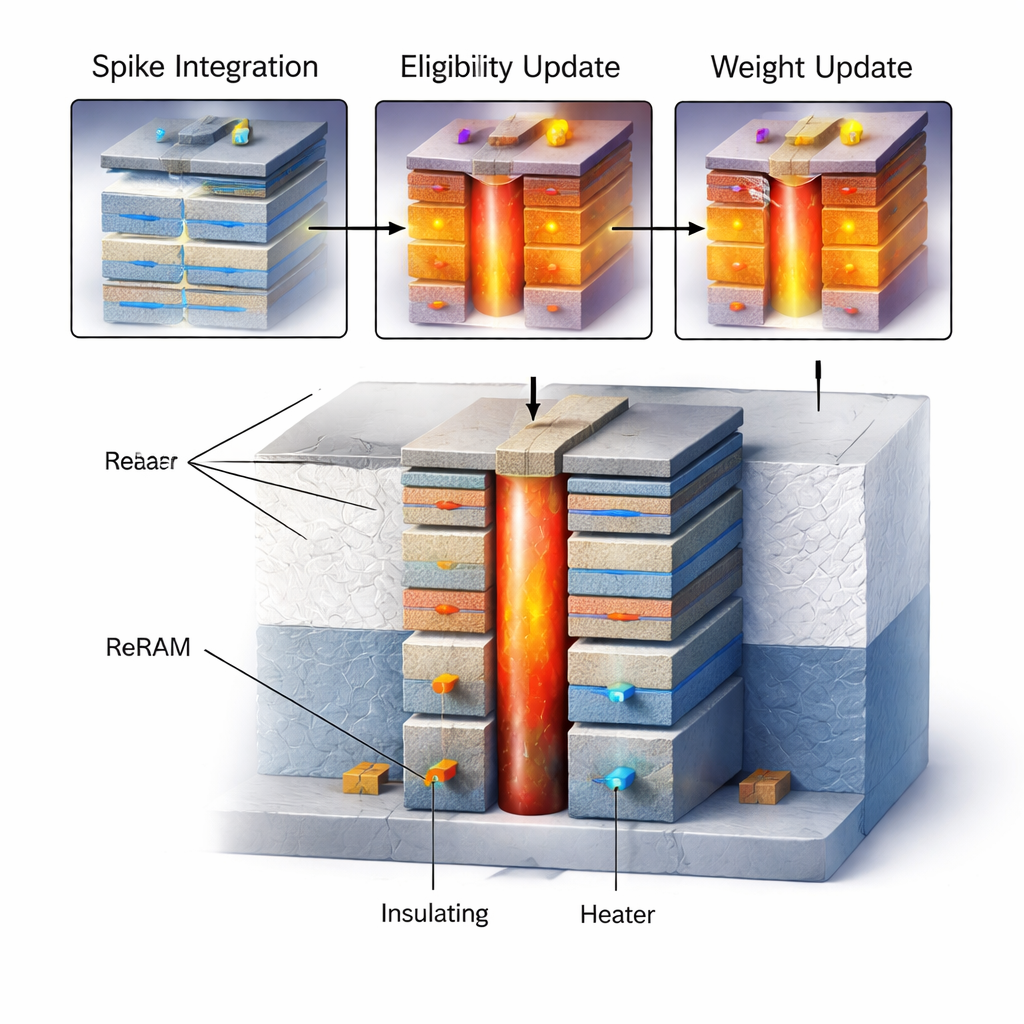

Der Kern dieser Arbeit ist eine „neoHebbian“ Synapse mit zwei internen Zustandsvariablen: einem langfristigen Kopplungsgewicht und einer kurzfristigen Eligibility‑Spur, die jüngste Aktivität speichert. Das Gewicht ist, wie üblich, in der Leitfähigkeit eines ReRAM‑Bauelements kodiert. Die Eligibility‑Spur hingegen wird in der lokalen Temperatur dieses Bauelements gespeichert, gesteuert durch einen nanoskaligen resistiven Heizer, der direkt darüber oder daneben integriert ist. Während der normalen Spike‑Verarbeitung multipliziert das ReRAM eingehende Spikes einfach mit seinem gespeicherten Gewicht. Während des Lernens treiben neurongenerierte Signale, die „wer zuvor gefeuert hat“ und „wie sensitiv das postsynaptische Neuron aktuell ist“ repräsentieren, Strom durch den winzigen Heizer. Da Heizer und ReRAM thermisch gekoppelt sind, erhöht diese Leistung die Temperatur des Bauelements proportional zum Produkt dieser beiden Signale – also genau zur mathematischen Eligibility‑Spur, die der e‑prop‑Algorithmus verlangt.

Wie Wärme das Gedächtnis verändert

Nachdem eine kurze Eingabesequenz – ein sogenanntes Dataframe – verarbeitet wurde, kodiert der angesammelte Temperaturanstieg, wie „berechtigt“ diese Synapse ist, sich zu verändern. Anschließend wird ein fixer Programmierimpuls über das ReRAM gelegt. Entscheidenderweise zeigen detaillierte Experimente, dass die resultierende Leitfähigkeitsänderung stark von der Temperatur abhängt: heißere Bauelemente ändern stärker, und Richtung sowie Größe dieser Änderung hängen vom initialen Leitfähigkeitszustand und davon ab, ob das Bauelement zu höherer oder niedrigerer Leitfähigkeit getrieben wird. Durch sorgfältige Wahl der Impulsamplituden und Ausnutzung dieser Temperatursensitivität arrangieren die Autoren, dass die Gewichtsänderung annähernd proportional zur gespeicherten Eligibility ist. Numerische Modelle des Wärmeflusses in einem 3D‑integrierten Heizer‑plus‑ReRAM‑Stack bestätigen, dass die Temperatur auf einstellbaren Zeitskalen erhöht und wieder abklingen kann und dass die Struktur so gestaltet werden kann, dass gewünschtes Selbstheizen verstärkt und thermischer „Crosstalk“ zu benachbarten Synapsen begrenzt wird.

Thermische Synapsen im Praxistest

Um zu prüfen, ob diese exotische Synapse tatsächlich nützlich ist, simulieren die Autoren vollständige neuromorphe Systeme, die realistische Geräteverhalten wie Temperaturabfall, Gerät‑zu‑Gerät‑Variabilität und begrenzte Präzision einbeziehen. In einer Demonstration steuert ein spikendes Netzwerk eine virtuelle Maus, die lernen muss, ein gitterartiges Labyrinth zu durchqueren, um Käse zu finden und Fallen zu vermeiden. Hier wirkt das natürliche thermische Abkühlen – das die gespeicherte Eligibility langsam abbaut – wie der aus der Verstärkungslern‑Theorie vertraute „Discount‑Factor“: jüngere Zustands‑Aktions‑Paare sind wichtiger als ältere. Die Simulationen zeigen, dass das Lernen am schnellsten ist, wenn dieses Abklingen weder zu schnell noch zu langsam erfolgt, und dass Variabilität im ReRAM‑Verhalten die Leistung nur allmählich verschlechtert. In einem zweiten, anspruchsvolleren Test wird ein rekurrentes spikendes Netzwerk mit thermischen neoHebbian‑Synapsen online auf dem TIMIT‑Phonemklassifikationsbenchmark trainiert, einer Standardaufgabe der Spracherkennung. Bei ausreichender Leitfähigkeitsauflösung (etwa äquivalent zu 8 Bit) erreicht das hardware‑bewusste Modell eine Genauigkeit, die nur wenige Prozentpunkte unter einer idealen Gleitkomma‑Implementierung liegt.

Was das für zukünftige KI‑Hardware bedeutet

Insgesamt zeigt die Studie, dass lokale Temperatur als praktikabler, kontrollierbarer interner Speicher für fortgeschrittene Lernregeln dienen kann und schnelles, auf dem Chip stattfindendes Training ohne massiven digitalen Overhead ermöglicht. Die vorgeschlagene Synapse belegt etwa denselben Flächenbedarf wie eine konventionelle ReRAM‑Zelle, implementiert jedoch sowohl ein stabiles Gewicht als auch eine verblassende Spur, und ihre Energiekosten pro Lernschritt liegen im Pikojoule‑Bereich. Zwar bringt die Nutzung von Wärme reale Herausforderungen mit sich – Temperatur ist schwer direkt zu messen und kann die Alterung von Bauelementen beschleunigen – doch die Arbeit legt nahe, dass das Annehmen statt Bekämpfen elektro‑thermischer Effekte neue Klassen kompakter Lernhardware erschließen könnte. Für Nicht‑Expertinnen und Nicht‑Experten lautet die Kernaussage: Zukünftige KI‑Chips werden nicht nur Elektronen verschieben; sie könnten auch mit gezielt gestalteten Wärme‑Mustern rechnen und maschinelles Lernen einen Schritt näher an die Effizienz und Anpassungsfähigkeit des menschlichen Gehirns bringen.

Zitation: Pande, S., Bezugam, S.S., Bhattacharya, T. et al. NeoHebbian synapses to accelerate online training of neuromorphic hardware. Sci Rep 16, 6836 (2026). https://doi.org/10.1038/s41598-026-35641-z

Schlüsselwörter: neuromorphe Datenverarbeitung, spikende neuronale Netze, ReRAM-Synapse, Online-Lernen, hardware-effiziente KI