Clear Sky Science · de

Erkundung ozeanischer Tiefen: Verborgene Schätze lüften mit IoT und einem ensembleartigen tiefen Hybrid‑Lernmodell

Warum die Erforschung des Meeresbodens ein Hightech‑Update bekommt

Der tiefe Ozean und der Boden darunter verbergen Kabel, Pipelines, antike Ruinen und empfindliche Ökosysteme. Trübes Wasser, wirbelnder Sand und schwache Signale machen es jedoch überraschend schwer, dort unten klare Bilder zu gewinnen. Dieser Artikel beschreibt einen neuen Weg, verschiedene Sensortypen mit künstlicher Intelligenz zu kombinieren, damit Unterwasserroboter und Überwachungssysteme wichtige Objekte genauer, schneller und mit weniger Energieaufwand erkennen können. Die Arbeit könnte helfen, das Meeresleben zu schützen, Infrastruktur zu sichern und neue Erkundungsfelder zu öffnen.

Viele Sensoren, ein gemeinsames Bild der Tiefe

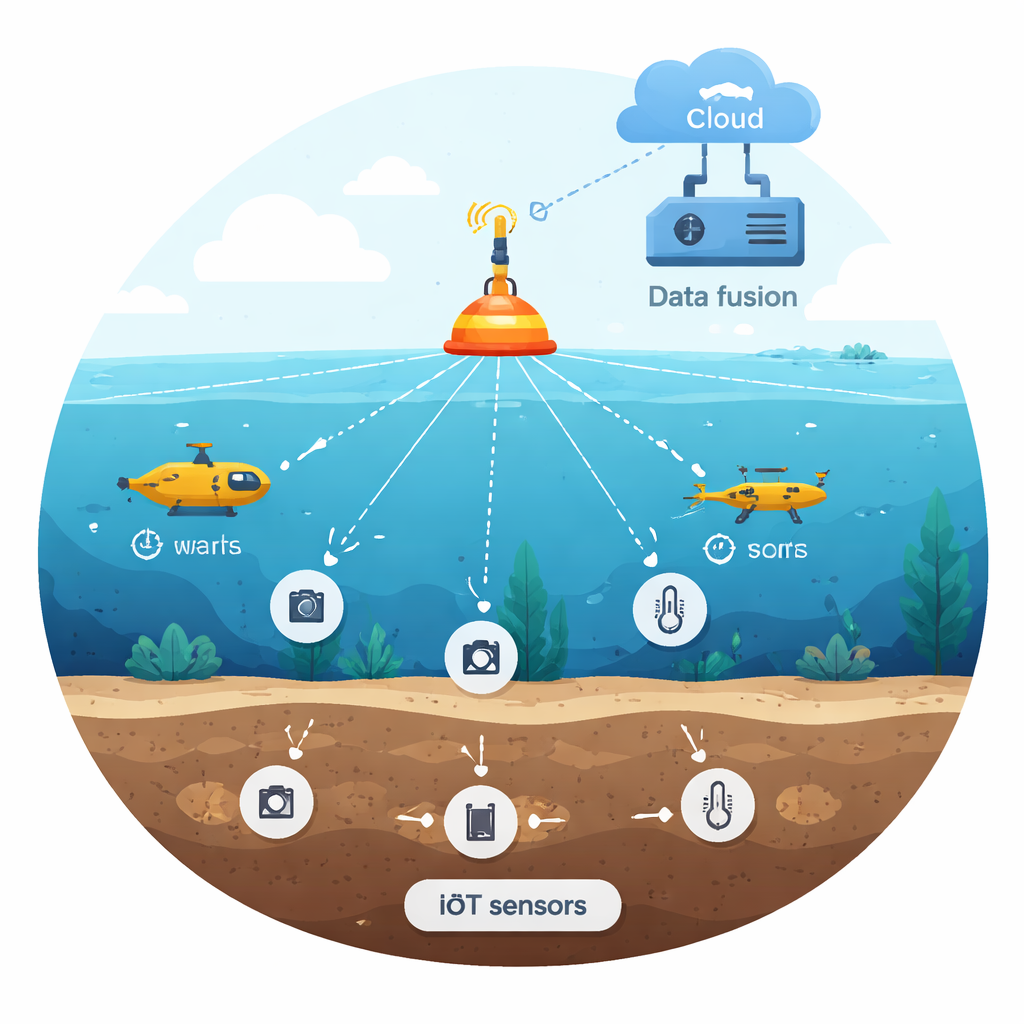

Die heutige Unterwasser‑Detektion verlässt sich meist auf einen einzigen Sinn: einen Sonarpuls, eine Videokamera oder einen Bodensensor. Jeder funktioniert unter idealen Bedingungen gut, versagt aber, wenn das Wasser trüb wird, das Licht schwindet oder Störungen auftreten. Die Forschenden denken stattdessen an den Ozean als einen von einem Internet der Dinge überwachten Raum: kleine, vernetzte Geräte, die unterschiedlich hören, sehen und fühlen. Ihr System verschmilzt Daten von Kameras, bodendurchdringendem Radar, seismischen Vibrationssensoren, Temperatursonden und elektromagnetischen Detektoren zu einem gemeinsamen Strom zur Analyse. Durch das Zusammenführen dieser Perspektiven kann das System ein Objekt weiterhin erkennen, selbst wenn ein Sensor durch Schlamm, Blasen oder Reflexionen irritiert ist.

Unordentliche Signale reinigen, bevor sie ins Gehirn gelangen

Rohdaten, die unter Wasser gesammelt werden, sind weit davon entfernt, perfekt zu sein. Sie sind durchsetzt mit zufälligen Spitzen, Lücken und seltsamen Messwerten, verursacht durch Strömungen, bewegte Tiere und elektronische Störungen. Bevor ein intelligenter Algorithmus Entscheidungen trifft, führen die Autorinnen und Autoren diese Daten durch eine sorgfältige Reinigungs‑Pipeline. Sie verwenden Medianfilter, um plötzliche Störungen zu glätten, ohne echte Strukturen zu verwischen, statistische Prüfungen zur Erkennung und Entfernung von Ausreißern sowie Synchronisation, damit Messungen unterschiedlicher Geräte zeitlich übereinstimmen. Sie skalieren Werte um, damit ein starker Sensor nicht schwächere übertönt, wandeln eindimensionale Radarspuren in Bilder um und nutzen moderne Techniken, um hunderte Messwerte auf eine kleinere, informationsreichere Auswahl zu komprimieren. All das ist darauf ausgelegt, dass das Lernsystem ein klares Bild sieht statt eines chaotischen Schleiers.

Ein hybrider Lernmotor, der Muster erkennt und entscheidet

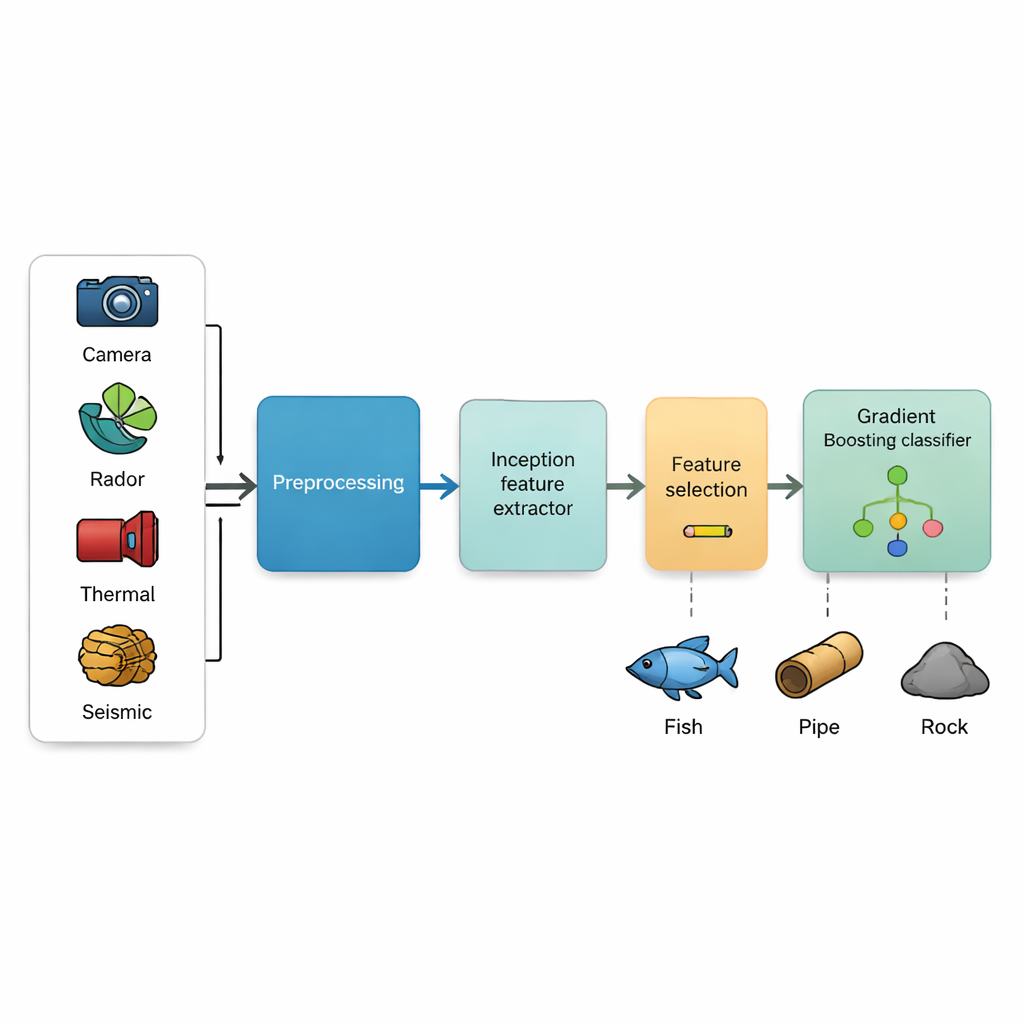

Im Kern des Ansatzes steht das, was die Autorinnen und Autoren ein Ensembled Deep Hybrid Learning (EDHL)‑Modell nennen. Es hat zwei Hauptteile, die komplementär zusammenwirken. Zuerst fungiert ein Inception‑ähnliches tiefes neuronales Netzwerk als „Augen“ und scannt Sensorbilder auf mehreren Skalen gleichzeitig, um sowohl feine Details wie ein Kabel als auch größere Strukturen wie einen Felsen auszumachen. Daraus entstehen reichhaltige numerische Beschreibungen jeder Szene. Zweitens agiert ein Gradient‑Boosting‑Klassifikator als „Entscheidungskomitee“. Er baut viele kleine Entscheidungsbäume auf, die sich gegenseitig korrigieren und so schrittweise die richtige Antwort darüber finden, welches Objekt vorliegt. Ein Schritt zur Merkmalsauswahl wählt nur die aussagekräftigsten Signale aus, was Speicherbedarf reduziert und das System beschleunigt, ohne das Wesentliche wegzuwerfen.

Das System auf die Probe stellen

Um zu prüfen, ob ihr Design in der Praxis funktioniert, trainierte und bewertete das Team es mit einer großen öffentlichen Sammlung von Unterwasserbildern, die Fische, Korallen, Schwämme, Seegras, Muscheln, Krebstiere und andere Meeresboden‑Szenen enthält. Sie verglichen viele Varianten der Datenreinigung und Merkmalsauswahl und stellten ihr Modell gegen bekannte Deep‑Learning‑Systeme wie klassische Faltungsnetzwerke, ResNet, DenseNet, EfficientNet, Kapselnetzwerke und sogar transformerbasierte Modelle. Das EDHL‑Setup, besonders in Kombination mit sorgfältiger Rauschunterdrückung und korrelationsbasierter Merkmalsauswahl, erreichte eine Genauigkeit von über 98 % und deutlich weniger Fehlalarme und verpasste Objekte als die Konkurrenz. Wichtig ist, dass es diese hohe Leistung beibehielt, während es auf moderater Hardware lief, die für Edge‑Geräte geeignet ist, und nicht nur auf leistungsstarken Laborservern.

Was das für die zukünftige Meereserkundung bedeutet

Für Nicht‑Spezialisten ist die Quintessenz, dass die Autorinnen und Autoren ein intelligenteres „Sense‑and‑Think“‑System für die Unterwasserwelt gebaut haben. Durch das Zusammenführen verschiedener IoT‑Sensoren mit einem hybriden Lernmotor zeigen sie, dass sich Meeresbodenobjekte sehr zuverlässig erkennen und klassifizieren lassen, ohne sperrige Rechner oder perfekte Sichtbedingungen zu benötigen. Zukünftig könnte diese Technologie Flotten von Unterwasserrobotern dabei helfen, den Meeresboden zu kartieren, empfindliche Lebensräume zu überwachen, Verschmutzung nachzuverfolgen und vergrabene Infrastruktur mit weniger Fehlern und geringerem Energieverbrauch zu inspizieren. Sie verwandelt die unordentliche, feindliche Umgebung der Tiefsee in einen Raum, in dem digitale Sinne schließlich klar genug sehen, um ihre verborgenen Schätze freizulegen.

Zitation: Tada, S., Jeevanantham, V. Exploring oceanic depths: unveiling hidden treasures with IoT and ensembled deep hybrid learning model. Sci Rep 16, 5333 (2026). https://doi.org/10.1038/s41598-026-35634-y

Schlüsselwörter: Erkennung von Unterwasserobjekten, IoT‑Sensoren, Deep Learning, Meereserkundung, multimodale Sensorik