Clear Sky Science · de

CRFusion: ein neuartiges LiDAR-Kamera-Fusionsnetzwerk zur Erstellung von BEV-Karten

Intelligentere digitale Karten für selbstfahrende Autos

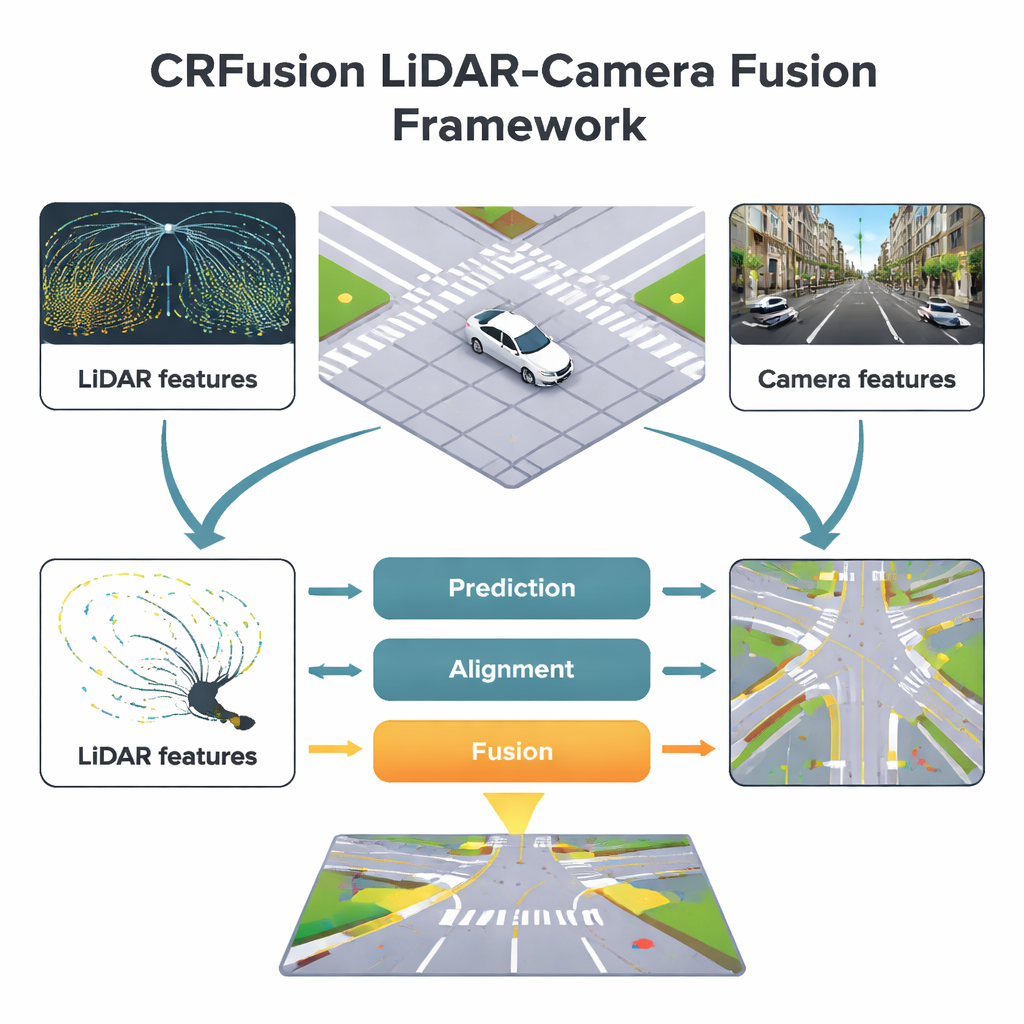

Für ein selbstfahrendes Auto ist das Erfassen der Straße vor ihm wie das Lesen einer sich ständig verändernden Karte. Das Fahrzeug muss genau wissen, wo Fahrspuren, Zebrastreifen und Straßenränder liegen, auch bei Dunkelheit, Regen oder wenn die Sicht blockiert ist. Dieses Papier stellt CRFusion vor, ein neues System, das Laserscanner und Kameras kombiniert, um sauberere, zuverlässigere Draufsichtkarten von Stadtstraßen zu erstellen und so autonomes Fahren mit größerer Sicherheit in der Spur zu halten und Fußgänger zu vermeiden.

Warum zwei „elektronische Augen“ besser sind als eines

Moderne selbstfahrende Autos verlassen sich stark auf zwei Hauptsensoren. Kameras erfassen reiche Farbbilder, womit sich Fahrbahnmarkierungen, Verkehrsschilder und Zebrastreifen aus großer Entfernung leicht erkennen lassen. LiDAR-Sensoren senden Lichtimpulse aus und messen deren Rücklauf, wodurch ein genaues 3D-Bild von Entfernungen und Formen um das Fahrzeug entsteht. Jeder Sensor hat Schwächen: Kamerabilder können durch schlechte Beleuchtung oder schlechtes Wetter getäuscht werden, während LiDAR-Messungen mit zunehmender Entfernung lückenhaft und dünn werden. CRFusion wurde entwickelt, um diese Stärken und Schwächen in einer einzigen Vogelperspektive zu vereinen — einer Top-down-Karte, bei der jedes Pixel ein kleines Bodenstück als Fahrspur, Trennlinie oder Fußgängerüberweg kennzeichnet.

Die Lücken in der Langstreckenwahrnehmung füllen

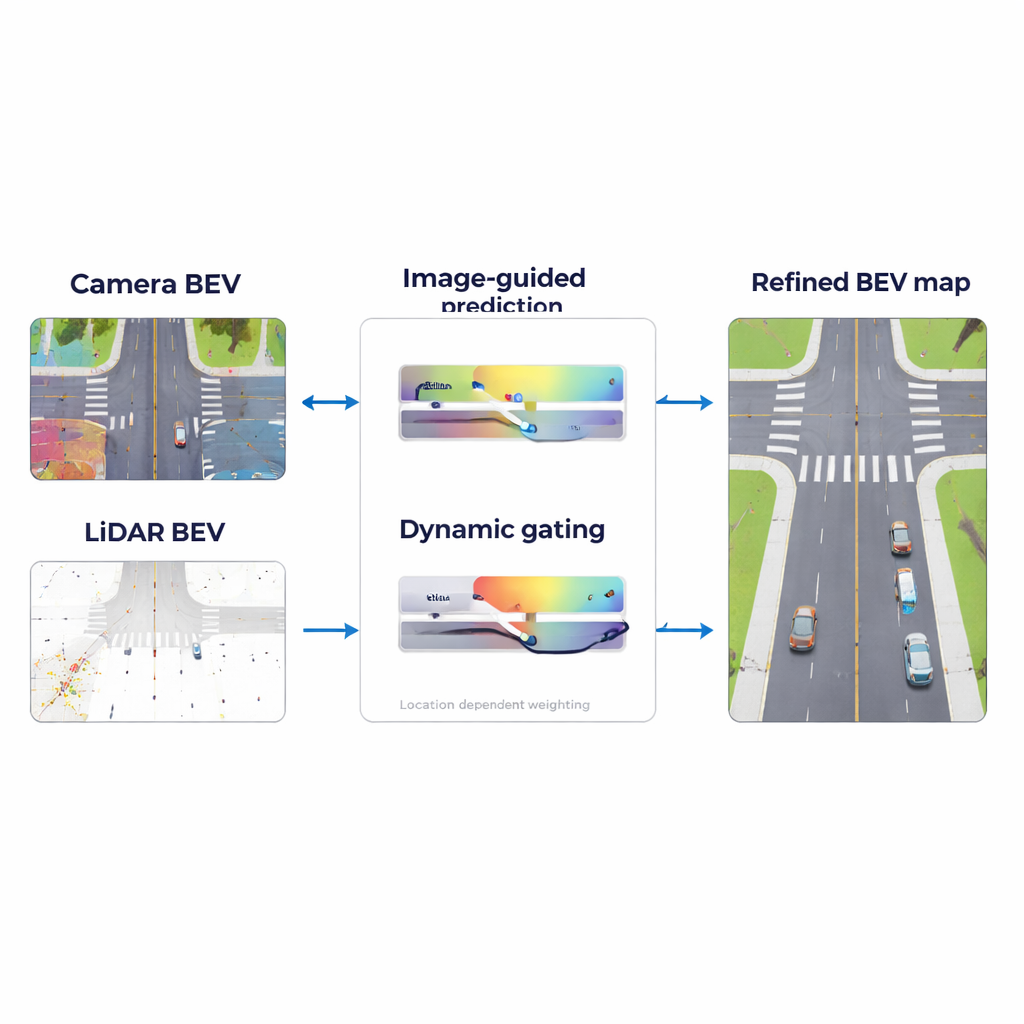

Eine zentrale Herausforderung bei der Straßenkartierung ist, dass LiDAR in großer Entfernung oft Details verpasst, genau dort, wo vorausschauende Planung am wichtigsten ist. CRFusion begegnet dem mit einem „LiDAR-Reichweiten-Prädiktor“. Einfach ausgedrückt betrachtet das System, was die Kamera weit voraus sieht, und nutzt diese Informationen, um zu schätzen, was LiDAR gemessen hätte, wenn es dicht und vollständig gewesen wäre. Ein Mechanismus namens Attention hilft dem Modell zu entscheiden, welche Teile der Kameraansicht am besten die leeren oder unsicheren Bereiche in der LiDAR-basierten Karte erklären. Anschließend verfeinert es diese Vorhersage durch Vergleich benachbarter Regionen in der Karte, stärkt konsistente Muster wie durchgehende Fahrstreifen und reduziert zufälliges Rauschen.

Sensoren dazu bringen, dasselbe Bild zu sehen

Sogar wenn sowohl Kamera als auch LiDAR funktionieren, stimmen ihre Aufnahmen nicht perfekt überein. Kleine Fehler bei Entfernungsabschätzungen oder der Sensorposition können dazu führen, dass Fahrbahnmarkierungen in Kamerabildern gegenüber LiDAR-Messungen leicht verschoben erscheinen. CRFusion führt einen Ausrichtungsschritt ein, der die Top-down-Features der Kamera behutsam „verzerrt“, sodass sie besser mit der LiDAR-Ansicht übereinstimmen. Dies geschieht mithilfe eines leichten Korrekturnetzwerks, das vorhersagt, wie jeder Punkt in der Kamerakarte verschoben werden sollte. Dadurch beschreiben die beiden Sensorsichten dieselben physischen Straßenpositionen, was die anschließende Fusion deutlich vertrauenswürdiger macht.

Anpassung an Tag, Nacht und schlechtes Wetter

Sind die beiden Sensorsichten erst einmal ausgerichtet, muss das System dennoch an jedem Ort entscheiden, wie sehr es jeder einzelnen vertrauen soll. Eine sonnige Autobahn mit klarer Fahrbahnmarkierung unterscheidet sich stark von einer regnerischen Nacht in einer überfüllten Stadt. CRFusion löst das durch ein Modul zur „dynamischen gewichteten Fusion“, das flexible Gewichte für Kamera- und LiDAR-Features über die Karte verteilt. Wo LiDAR-Rückläufe stark sind, etwa bei nahegelegenen Straßenkanten oder festen Objekten, verlässt sich das System mehr auf LiDAR. Wo visuelle Hinweise klarer sind, wie helle Zebrastreifen in der Ferne, stützt es sich mehr auf die Kamera. Diese Gewichte werden automatisch aus den Daten gelernt, sodass sich die Fusionsstrategie bei wechselnden Bedingungen sanft anpasst.

Die Vorteile an realen Daten nachweisen

Die Forschenden testeten CRFusion auf einem weit verbreiteten Datensatz für autonomes Fahren namens NuScenes, der viele Fahrszenen in verschiedenen Städten, Wetterlagen und Tageszeiten enthält. Im Vergleich zu führenden früheren Methoden erzeugte CRFusion genauere Fahrbahnbegrenzungen, Trennlinien und Zebrastreifen, besonders in mittleren und großen Entfernungen bis zu 90 Metern. Es verbesserte Standardkennwerte sowohl für die Überlappung mit Ground-Truth-Karten als auch für die Fähigkeit, einzelne Fahrstreckenabschnitte zu erkennen, und eine Ablationsstudie zeigte, dass jede Hauptkomponente — die Langstreckenprognose, das Ausrichtungsnetzwerk und die dynamische Fusion — sinnvolle Verbesserungen beisteuerte. Visuelle Beispiele zeigten eine gleichmäßigere Fahrspuren-Kontinuität und klarere Zebrastreifen, was bestätigt, dass die Karten des Systems eher wie sorgfältig gezeichnete Straßenpläne aussehen.

Was das für den Alltag im Straßenverkehr bedeutet

Für Nicht-Fachleute lautet die Hauptaussage: CRFusion hilft selbstfahrenden Autos, sauberere und verlässlichere Straßenkarten zu erstellen, indem Kameras und LiDAR auf intelligentere Weise „miteinander sprechen“. Indem fehlende LiDAR-Informationen aus Kamerasicht vorhergesagt, die beiden Sensorperspektiven ausgerichtet und das Vertrauen in jeden Sensor situationsabhängig angepasst wird, reduziert das System tote Winkel und Unsicherheiten. Das bringt autonome Fahrzeuge einen Schritt näher daran, komplexe, überfüllte Stadtstraßen mit derselben Zuversicht zu bewältigen wie ein vorsichtiger menschlicher Fahrer, der gut markierten Fahrspuren und Übergängen folgt.

Zitation: Guan, Y., Wang, T., Cheng, Q. et al. CRFusion: a novel LiDAR-camera fusion network for BEV map construction. Sci Rep 16, 5169 (2026). https://doi.org/10.1038/s41598-026-35551-0

Schlüsselwörter: autonomes Fahren, LiDAR-Kamera-Fusion, HD-semantische Karten, Vogelperspektive-Wahrnehmung, städtische Straßenkartierung