Clear Sky Science · de

Quanten‑Denoising‑Autoencoder verbessert die Qualität von Netzhautaufnahmen für das frühe Screening diabetischer Retinopathie

Scharfere Augenaufnahmen zum Schutz des Sehvermögens

Für Millionen von Menschen mit Diabetes kann ein einfacher Schnappschuss der Augenrückseite die frühesten Warnzeichen für Erblindung zeigen. Diese Netzhautbilder sind jedoch oft körnig oder durch Kamerarauschen unscharf, wodurch winzige, lebenswichtige Details schwer zu erkennen sind. Diese Arbeit untersucht einen ungewöhnlichen Verbündeten im Kampf gegen Erblindung: eine neue Bildreinigungsmethode, die heutiges Deep Learning mit den Quantencomputern von morgen kombiniert, um klarere Augenaufnahmen für das frühe Screening der diabetischen Retinopathie zu liefern.

Warum kleine Details in Augenfotos wichtig sind

Die diabetische Retinopathie ist eine Krankheit, bei der hoher Blutzucker die feinen Blutgefäße in der Netzhaut langsam schädigt. Ärztinnen und Ärzte suchen nach kleinen Ausbeulungen in Gefäßen (Mikroaneurysmen), dünnen verzweigten Kapillaren und subtilen Texturveränderungen, um die Krankheit zu erkennen, bevor das Sehvermögen verloren geht. Diese Zeichen sind in einem Standard‑Fundusfoto oft nur wenige Pixel breit. Leider sind Bilder aus Screening‑Zentren durch viele Rauscharten beeinträchtigt: Sensorfehler, schwache Beleuchtung und Bewegungsunschärfe. Traditionelle Bereinigungstools wie Gauß‑Glättung oder Medianfilter können einen Teil dieses Rauschens entfernen – sie verwischen jedoch häufig genau die zarten Strukturen, auf die Ärztinnen und Ärzte am meisten achten.

Grenzen heutiger intelligenter Filter

In den letzten Jahren sind Deep‑Learning‑Methoden zu den Arbeitspferden der medizinischen Bildentrauschung geworden. Konvolutionale Autoencoder, Residualnetzwerke (ResNets) und spezialisierte Denoising‑CNNs können lernen, wie ein „sauberes“ Bild aussehen sollte, und dann das Rauschen aus neuen Aufnahmen entfernen. Diese Modelle funktionieren gut, haben aber Nachteile. Um komplexe Bildmuster zu erfassen, benötigen sie viele Schichten und Millionen von Parametern, was hohe Rechenleistung und große Trainingsdatensätze erfordert. In der medizinischen Bildgebung, wo beschriftete Datensätze vergleichsweise klein sind, können solche großen Modelle überfitten – sie merken sich Trainingsbilder statt zu generalisieren – und sie können dennoch dünne Gefäße oder winzige Läsionen verwischen.

Quantenideen ins Bild bringen

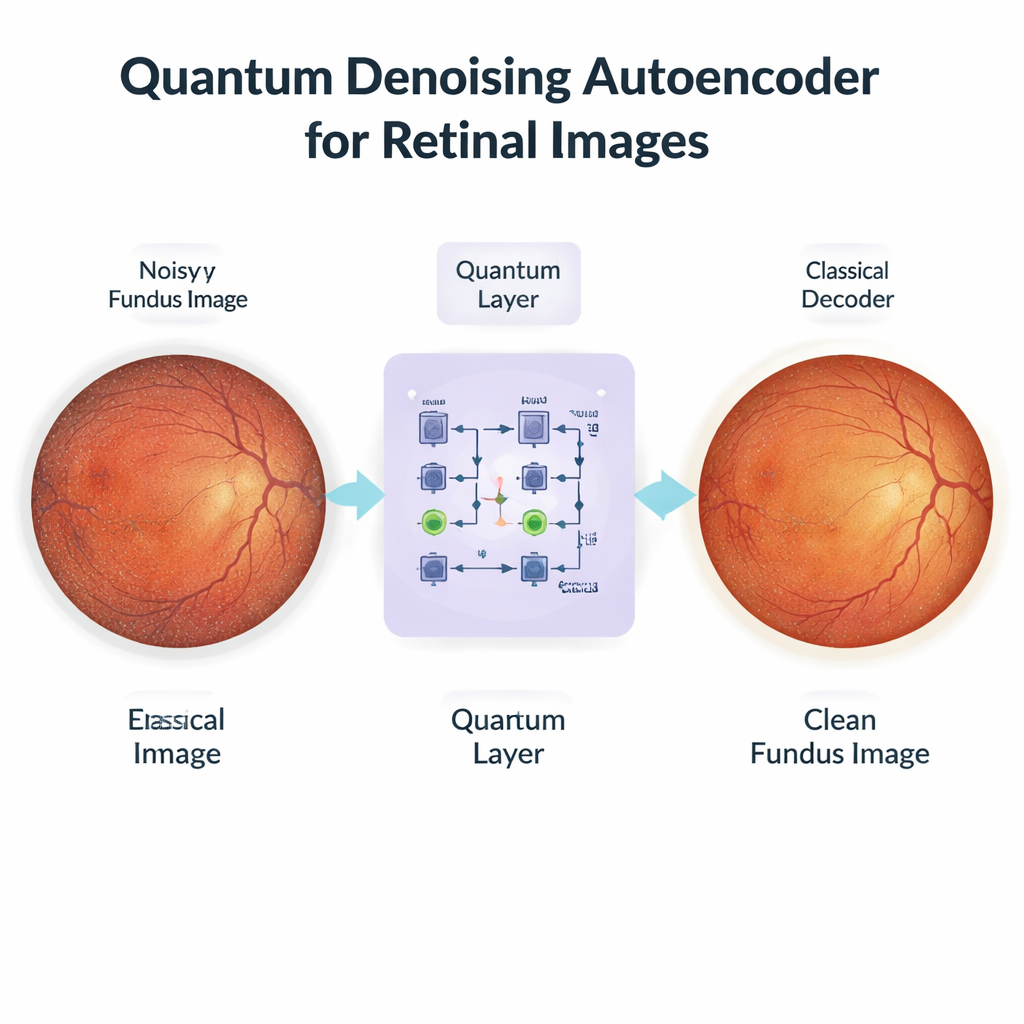

Die Autorinnen und Autoren schlagen einen hybriden Ansatz vor, den Quantum Denoising Autoencoder (QDAE). Auf den ersten Blick ähnelt er einer standardmäßigen Deep‑Learning‑Pipeline: Ein klassischer Encoder komprimiert jedes verrauschte Augenfoto in einen kompakten Merkmalsvektor, und ein klassischer Decoder rekonstruiert später ein bereinigtes Bild. Die entscheidende Wendung passiert in der Mitte. Statt die Merkmale direkt durch einen einfachen mathematischen Flaschenhals zu leiten, wandelt der QDAE sie in quantenähnliche Zustände um und verarbeitet sie mit einer kleinen, parametrierten Quanten‑Schaltung, bevor er sie zurückkonvertiert. In physischen Quantenmaschinen würde Superposition erlauben, viele Merkmalskombinationen gleichzeitig zu berücksichtigen, und Verschränkung entfernte Bildbereiche miteinander verknüpfen. Obwohl diese Arbeit simulierte Schaltungen auf einer normalen GPU verwendet, ermöglicht dieselbe Struktur dem Modell, reichhaltige, nichtlineare Beziehungen zwischen Pixeln mit einer relativ geringen Anzahl trainierbarer Parameter darzustellen.

Klarere Bilder, feine Gefäße erhalten

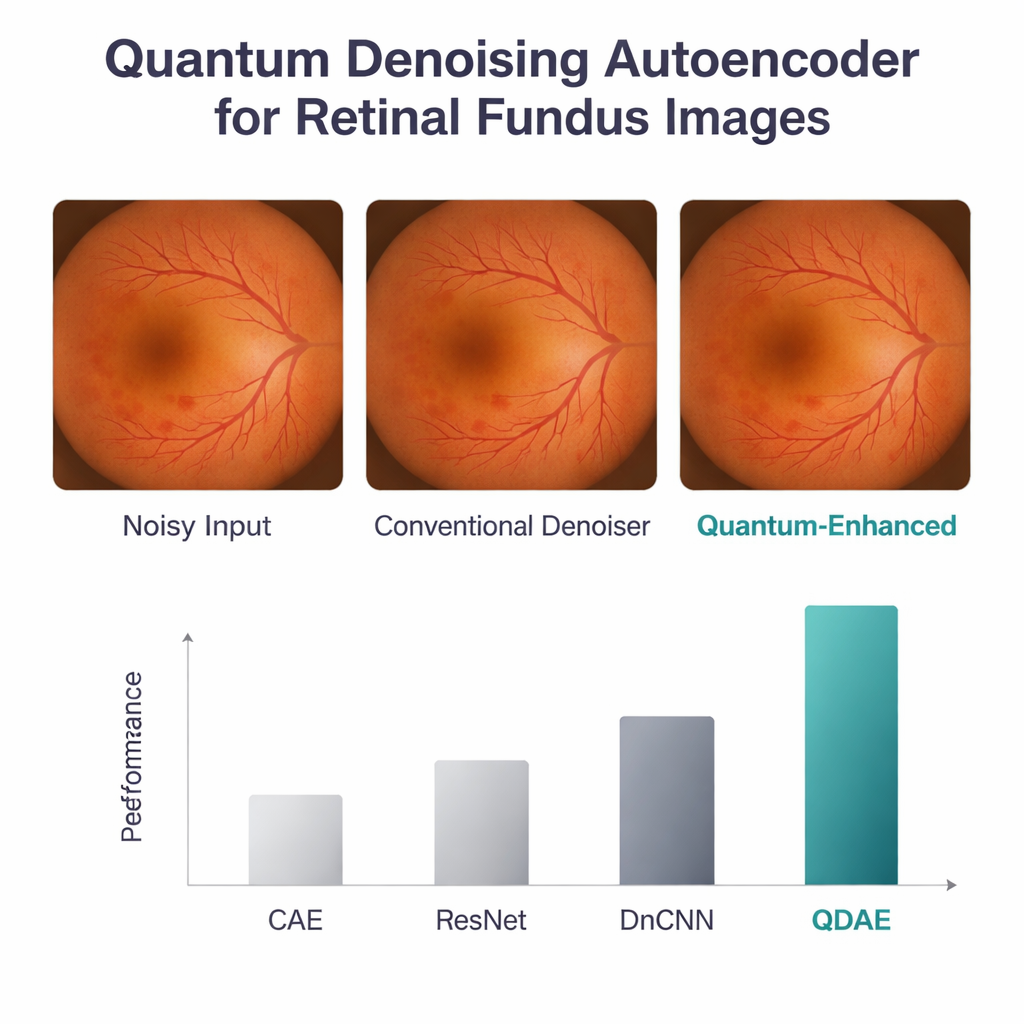

Um den QDAE zu testen, verwendeten die Forschenden einen öffentlichen Datensatz von Netzhautbildern, skalierten auf 224×224 Pixel und künstlich mit realistischem Gauß‑ und Specklerauschen beschädigt. Sie verglichen ihre Methode mit drei starken Baselines: einem konvolutionalen Autoencoder, einem ResNet‑basierten Modell und einem verbreiteten Denoising‑CNN. Alle Modelle wurden auf denselben Daten trainiert und mit üblichen Bildqualitätsmaßen bewertet. Das quantenverstärkte Modell lag in jeder wichtigen Kennzahl vorn: Es erreichte ein Peak‑Signal‑to‑Noise‑Ratio von 38,8 dB und einen strukturellen Ähnlichkeitsindex von 0,96, deutlich über den klassischen Netzen. Außerdem bewahrte es Intensitäts‑ und Texturmuster in den Bildern besser, einschließlich Helligkeit und Kontrast der Papille, der Makula und des feinen Gefäßnetzes. Obwohl der Quantenschritt eine kleine Verzögerung hinzufügte – etwa eine halbe Sekunde pro Bild – blieb der Gesamtrechenaufwand dank flacher Schaltungen mit nur vier Qubits und drei Lagen ähnlich dem von tiefen CNNs.

Was das für Patienten und Kliniken bedeuten könnte

Für eine Person mit Diabetes reduziert sich die technische Beschreibung auf einen einfachen Nutzen: schärfere Augenfotos, die es Software und Spezialistinnen bzw. Spezialisten erleichtern, Erkrankungen früh zu erkennen, wenn eine Behandlung noch Sehverlust verhindern kann. Der QDAE fungiert als intelligente Vorbereinigungsstufe, die in bestehende Screening‑Systeme eingebunden werden kann und nachgeschaltete Werkzeuge unterstützt, die Läsionen segmentieren oder die Schwere der Erkrankung einstufen. Da der Quantenanteil derzeit simuliert wird, bräuchten Krankenhäuser keine spezielle Quantenhardware, um ihn auszuprobieren; das Design ist jedoch bereit für zukünftige Quanten‑Geräte, sobald diese reifen. Die Studie braucht noch breitere klinische Tests an Bildern aus vielen Kliniken und Kameras, bietet jedoch einen vielversprechenden Einblick, wie quanteninspirierte Berechnung routinemäßige Augenuntersuchungen dezent verbessern und letztlich helfen könnte, das Sehvermögen zu bewahren.

Zitation: Chilukuri, R., P, P., Gatla, R.K. et al. Quantum denoising autoencoder improves retinal fundus image quality for early diabetic retinopathy screening. Sci Rep 16, 5970 (2026). https://doi.org/10.1038/s41598-026-35540-3

Schlüsselwörter: diabetische Retinopathie, Netzhautbildgebung, Bildentrauschung, quantenbasierte maschinelle Lernverfahren, medizinische KI