Clear Sky Science · de

Entwurf und Implementierung einer 6-DoF-Roboterarmsteuerung mit objekterkennung basierend auf maschinellem Lernen unter Verwendung eines Mini-Mikrocontrollers

Intelligentere Roboterarme bei geringeren Kosten

Stellen Sie sich einen Fabrikroboterarm vor, der ein Objekt erkennt, entscheidet, wie er es greifen soll, und sich reibungslos in Position bewegt — und das alles ohne einen sperrigen Computer oder eine Cloud-Verbindung. Dieses Papier beschreibt genau das: einen sechsgliedrigen (6-DoF) Roboterarm, der mit einem winzigen, kostengünstigen Mikrocontroller sieht und «denkt». Für Leser, die verfolgen möchten, wie künstliche Intelligenz das Rechenzentrum verlässt und in Alltagsmaschinen einzieht, zeigt diese Arbeit, wie fortschrittliche Bildverarbeitung und Steuerung auf Hardware laufen können, die kaum größer als ein USB-Stick ist.

Warum kleinere Roboter‑Gehirne wichtig sind

Traditionelle Industrieroboter sind häufig auf leistungsfähige externe Rechner angewiesen, um Objekte zu erkennen und Bewegungen zu planen. Das erhöht Kosten, Verkabelungsaufwand und technische Komplexität und kann für kleine und mittlere Unternehmen ein Hindernis darstellen. Die Autor:innen wollten zeigen, dass ein einziger günstiger Mikrocontroller fast alles übernehmen kann: Objekte sehen, ihre Position im 3D‑Raum bestimmen, die Armbewegung planen und die Motoren ansteuern, die die Aufgabe ausführen. Wenn die Verarbeitung an Bord bleibt, wird das System portabler, energieeffizienter und einfacher in beengten oder sich ändernden Umgebungen einzusetzen — von kleinen Fabriken bis zu Lehrlaboren.

Ein flexibler Arm, der sich selbst baut

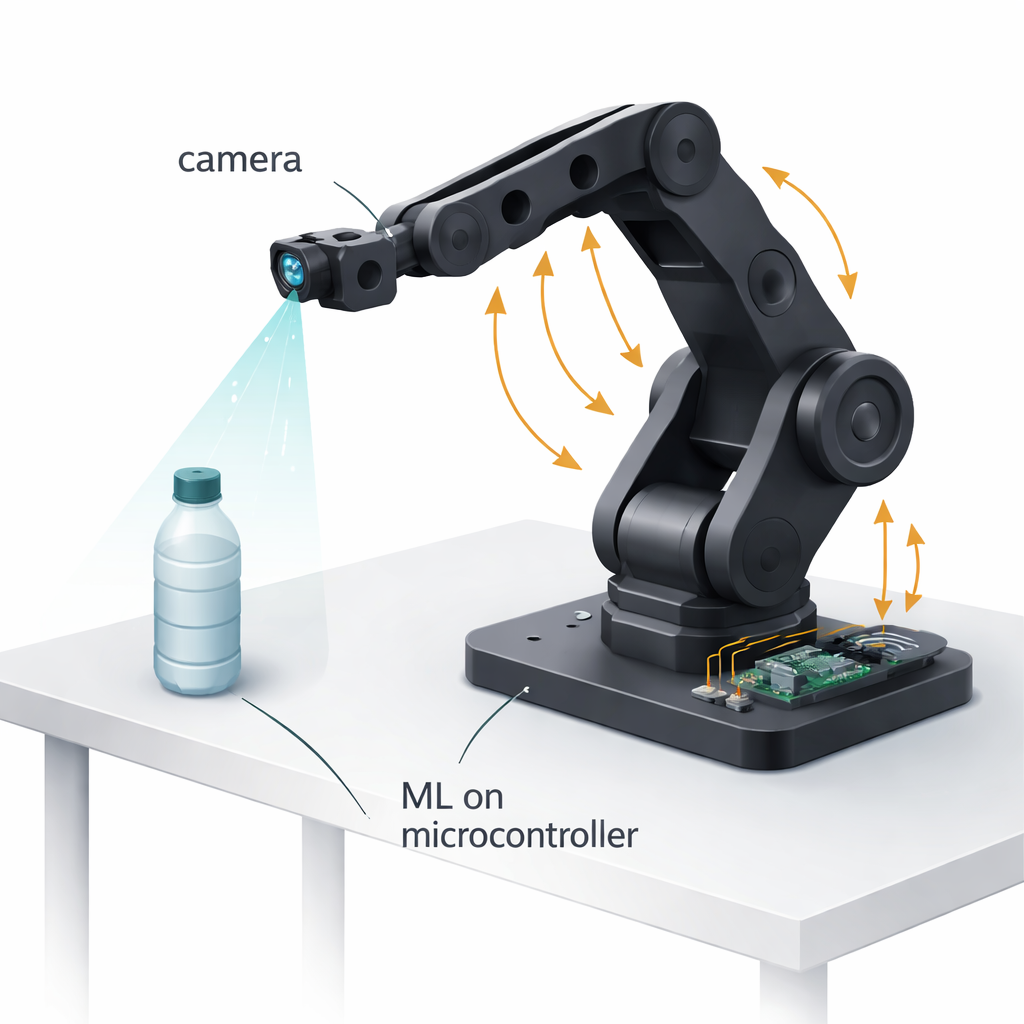

Das Team entwarf einen sechsfach gelenkten Roboterarm von Grund auf und verwendete größtenteils 3D‑gedruckte Kunststoffteile, um ihn leicht und preiswert zu halten. Hochdrehmomentige Hobby-Servomotoren bewegen jedes Gelenk, und die Forschenden modifizierten diese Motoren so, dass sie ihre genauen Winkel in Echtzeit zurückmelden können, was eine präzise Closed‑Loop‑Regelung ermöglicht. Ein eigener Zweifinger‑Greifer an der Spitze enthält einen einfachen Stromsensor: Indem das System misst, wie viel elektrischer Strom der Greifmotor zieht, kann es abschätzen, wie stark er zudrückt, und die Kraft automatisch anpassen, um Objekte festzuhalten, ohne sie zu zerquetschen oder fallen zu lassen. Am «Handgelenk» des Arms ist eine kleine Full‑HD‑Kamera montiert, die sich mit dem Arm bewegt und dem System eine Ich‑Perspektive der Szene vor dem Greifer liefert.

Einem winzigen Chip beibringen, Flaschen zu sehen

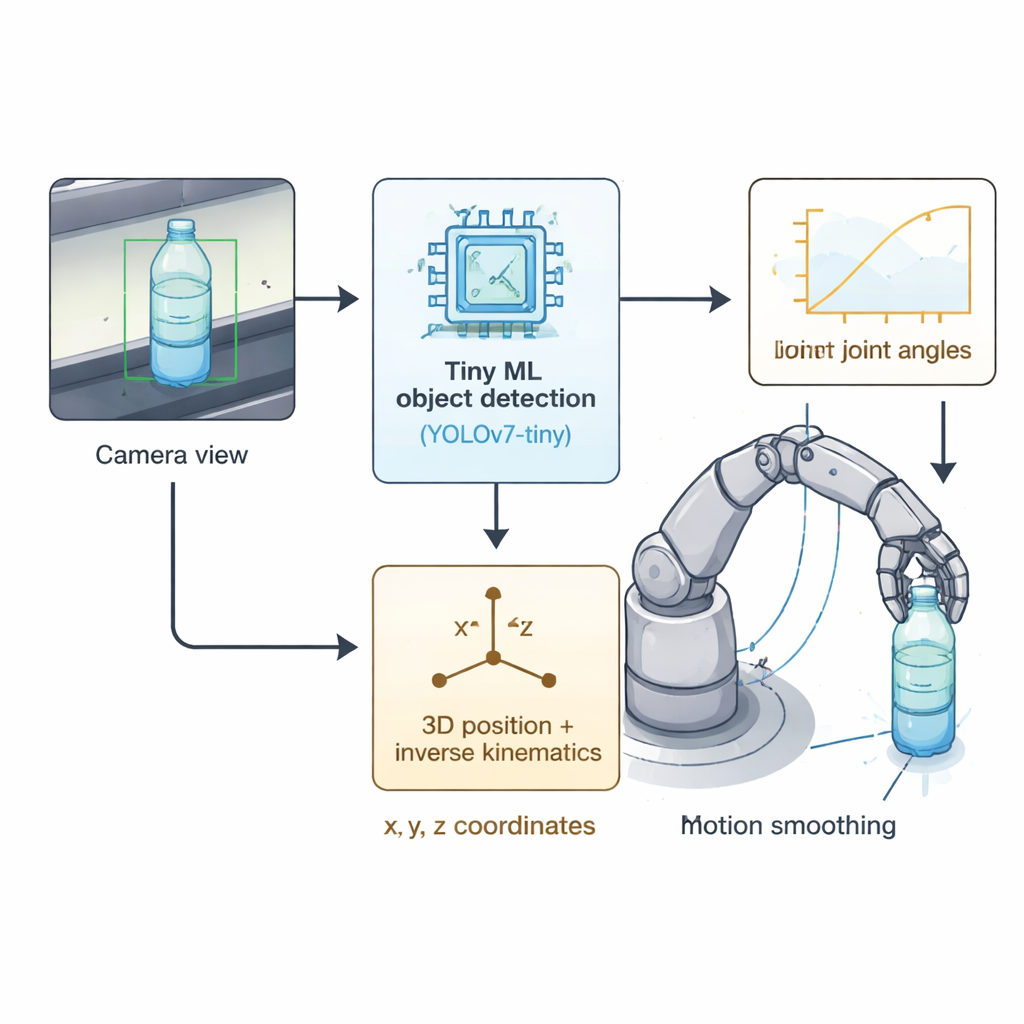

Im Kern der visuellen Wahrnehmung des Systems steht eine kompakte Version eines populären Objekterkennungsnetzes namens YOLOv7‑tiny. Die Forschenden trainierten dieses Modell mit mehr als 2.500 Bildern von Plastik‑Wasserflaschen, aufgenommen unter einer großen Bandbreite an Lichtverhältnissen, Entfernungen und teilweisen Verdeckungen. Nach dem Training auf einer leistungsfähigen Grafikkarte komprimierten sie das Modell in eine 8‑Bit‑Tiny‑ML‑Form, damit es in den begrenzten Speicher und die Rechenleistung des AMB82‑Mini‑Mikrocontrollers passt. Selbst in dieser abgespeckten Form erreichte das Modell etwa 88 % Genauigkeit beim Erkennen von Flaschen und lief schnell genug — rund 7–8 Bilder pro Sekunde — für Echtzeit‑Pick‑and‑Place‑Arbeiten direkt auf dem Mikrocontroller, ohne PC oder Cloud.

Von Pixeln zu präziser Bewegung

Sobald die Kamera eine Flasche erkennt, berechnet das System das Zentrum des Erkennungsfeldes im Bild und schätzt die Entfernung des Objekts anhand seiner Pixelgröße. Daraus ergeben sich x‑, y‑ und z‑Koordinaten im Raum. Ein maßgeschneiderter mathematischer Solver übersetzt diese Koordinaten dann in die sechs Gelenkwinkel, die der Arm erreichen muss, wobei Standardrobotergeometrie verwendet und für eine schnelle Ausführung auf dem kleinen Prozessor optimiert wurde. Die Steuerungssoftware ist als einfache Zustandsmaschine organisiert und durchläuft die Schritte: Objekt finden, darauf zu fahren, den Greifer mithilfe des Stromsensors als Tastsensor schließen und das Objekt zu einem festen Ablagepunkt transportieren. Um Bewegungen glatt zu halten und Vibrationen zu vermeiden, nutzt das Team sorgfältig geformte Bewegungs‑„Easing“-Kurven und eine spezielle Spannungsmodulationsmethode, die Motorenrasseln und Überschwinger reduziert.

Realwelt‑Tests und ihre Aussagen

In wiederholten Experimenten zeigte das integrierte System, dass es zuverlässig Plastikflaschen bis zu einem Gewicht von 300 Gramm mit einer Erfolgsrate von 100 % greifen und ablegen konnte und auch bei schwereren Lasten bis 500 Gramm noch gut funktionierte. Simulationen und Messungen ergaben, dass Positionsfehler typischerweise um ein Millimeter lagen — ausreichend genau für viele Sortier‑ und Verpackungsaufgaben. Verglichen mit einfacheren Steuerungsansätzen reduzierte die Motorsteuerungsstrategie der Autor:innen Vibrationen, verkürzte die Einschwingzeit des Arms und beseitigte ruckartiges Verhalten. Zwar konzentrierten sich die Tests auf einen Objekttyp und feste Abstände unter kontrollierten Innenraumbedingungen, dennoch liefern sie überzeugende Belege dafür, dass ernsthafte Roboterwahrnehmung und -steuerung auf einer einzelnen, sehr bescheidenen eingebetteten Platine untergebracht werden können.

Was das für alltägliche Automatisierung bedeutet

Für Nicht‑Spezialist:innen ist die wichtigste Erkenntnis: Fortgeschrittene Fähigkeiten im «Sehen» und «Bewegen» sind nicht mehr auf teure, leistungsstarke Roboter beschränkt. Durch die Kombination aus winzigen Machine‑Learning‑Modellen, kluger Geometrie und sorgfältiger Motorsteuerung auf einem kostengünstigen Mikrocontroller zeigt diese Arbeit einen Weg zu kompakten, eigenständigen Roboterarmen, die kleine Hersteller, Schulen und Hobbyanwender realistisch übernehmen könnten. Wenn zukünftige Versionen auf mehr Objekttypen und vielfältigere Umgebungen ausgeweitet werden, könnten ähnliche eingebettete Systeme unauffällig zahllose einfache Pick‑and‑Place‑Aufgaben automatisieren und intelligente Robotik für deutlich mehr Personen und Orte zugänglich machen.

Zitation: Almaliki, H.H., Mazinan, A.H. & Modaresi, S.M. Design and implementation of a 6-DoF robot arm control with object detection based on machine learning using mini microcontroller. Sci Rep 16, 6842 (2026). https://doi.org/10.1038/s41598-026-35508-3

Schlüsselwörter: eingebettete Robotik, tiny machine learning, Roboterarmsteuerung, Objekterkennung, Industrielle Automatisierung