Clear Sky Science · de

Ein neuartiger Deep‑Learning‑Ansatz zur Bestimmung von Mückenarten über eine Dual‑Head‑Struktur und eine kalibrierungsbewusste Fusionsarchitektur

Warum eine intelligentere Mückenidentifikation wichtig ist

Mücken sind zwar winzig, übertragen aber einige der gefährlichsten Krankheiten weltweit. Gesundheitsbehörden stützen sich immer häufiger auf Smartphone‑Fotos von gefangenen Insekten, um nachzuverfolgen, wo welche Arten auftreten. Das Problem: Viele Mücken sehen einander verwirrend ähnlich, und Feldaufnahmen sind oft unscharf, schlecht beleuchtet oder mit sehr unterschiedlichen Kameras gemacht. Diese Studie stellt ein neues System der künstlichen Intelligenz vor, das ähnlich aussehende Mückenarten mit Labor‑Niveau unterscheiden kann und zugleich anzeigt, wie sicher es sich bei jeder Entscheidung ist – eine Fähigkeit, die entscheidend ist, wenn diese Entscheidungen reale Maßnahmen zur Krankheitsbekämpfung leiten.

Von Handyfotos zu verlässlichen Bestimmungen

Die Forschenden konzentrieren sich auf Bilder, die denen ähneln, die ein Feldarbeiter oder Citizen Scientist aufnehmen könnte: ganze Mücken, fotografiert mit Smartphones vor unordentlichen, realen Hintergründen. Ihr Ziel ist zweigeteilt. Erstens soll das System acht Kategorien korrekt unterscheiden können, darunter mehrere krankheitsübertragende Aedes‑ und Culex‑Arten sowie eine Gruppe „andere/unklar“. Zweitens muss es seine Vorhersage so mit einer Vertrauensangabe versehen, dass diese der Realität entspricht, damit Behörden verlässlich Schwellen festlegen können – etwa entscheiden, wann ein Folgeeinsatz in einem Stadtviertel ausgelöst wird. Schlecht kalibrierte Systeme mögen sicher klingen, sind aber oft falsch, wenn sie an neuen Orten oder mit anderen Kameratypen eingesetzt werden.

Zwei Sehpfade, die zusammenarbeiten

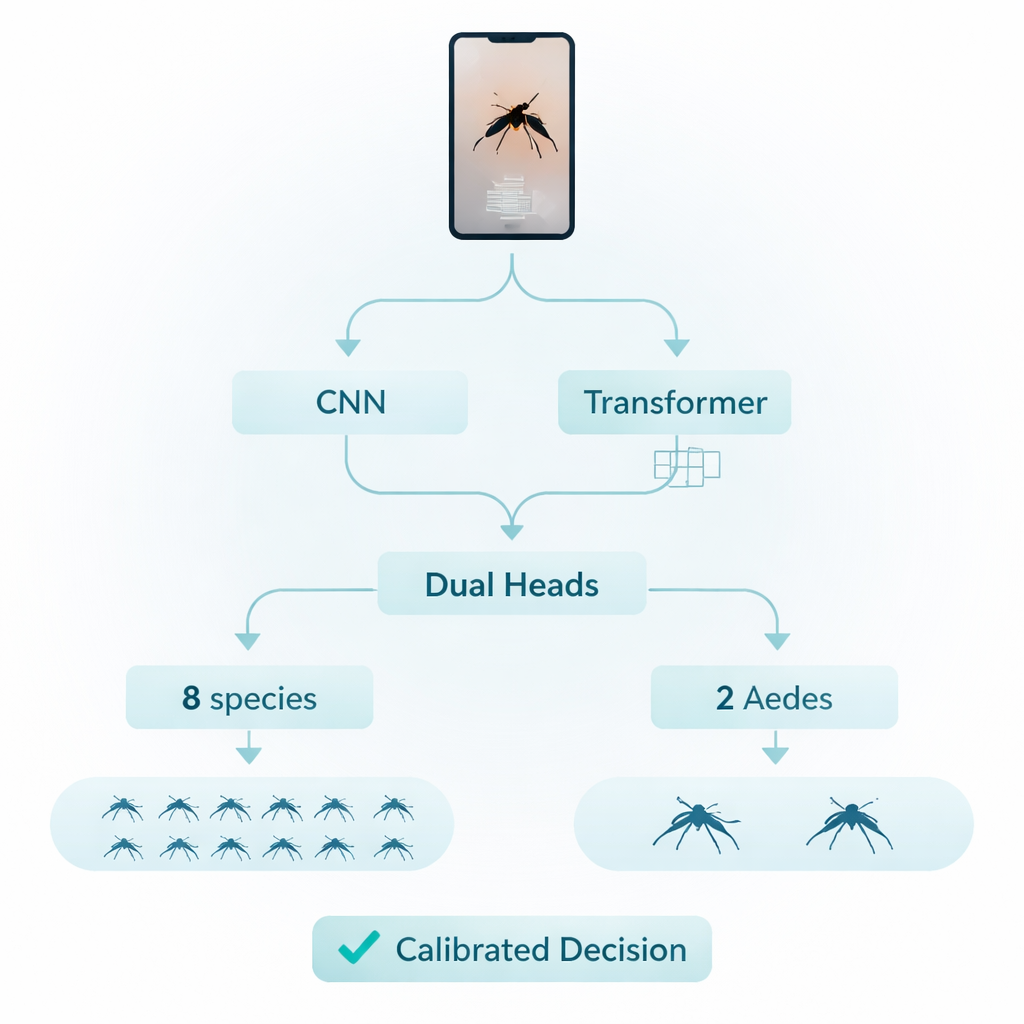

Um diese Ziele zu erreichen, bauen die Autorinnen und Autoren eine Bild‑Analyse‑Pipeline, die zwei komplementäre „Sichtweisen“ kombiniert. Ein Pfad nutzt konventionelle Convolutional Neural Networks (CNNs), die besonders gut lokale Texturen wie Schuppen, Streifen und Flügeladern erfassen. Der andere Pfad verwendet ein neueres Design, den Transformer, der besser das Gesamtensemble der Körperteile über das Bild hinweg erfasst, zum Beispiel die Proportionen von Flügeln, Thorax und Abdomen. Beide Pfade verarbeiten dasselbe Mückenfoto parallel und geben ihre Einschätzungen an ein gemeinsames Entscheidungsmodul weiter. Diese vielfältige Architektur erhöht die Zuverlässigkeit auch bei variierenden Posen, Schärfegraden oder Geräten.

Gleichzeitig feine und grobe Labels lernen

Eine zentrale Neuerung liegt darin, wie das System beim Training Arten „denkt“. Statt nur eine Aufgabe zu lernen, lernt es zwei gleichzeitig. Ein "Head" sagt die acht Kategorien des Hauptdatensatzes voraus. Ein zweiter "Head" konzentriert sich nur darauf, zwei eng verwandte Aedes‑Arten zu unterscheiden, die für die öffentliche Gesundheit besonders relevant sind. Durch das gemeinsame Erlernen dieser feinen und groben Unterscheidungen schärft das Modell die Grenzen zwischen leicht verwechselbaren Arten, erkennt aber weiterhin die breitere Klasse. Während des Trainings gleichen die Autorinnen und Autoren die Daten gezielt aus, sodass seltene Arten stärker gewichtet werden und das System nicht einfach die häufigsten Mücken bevorzugt.

Rohwerte in vertrauenswürdige Sicherheit umwandeln

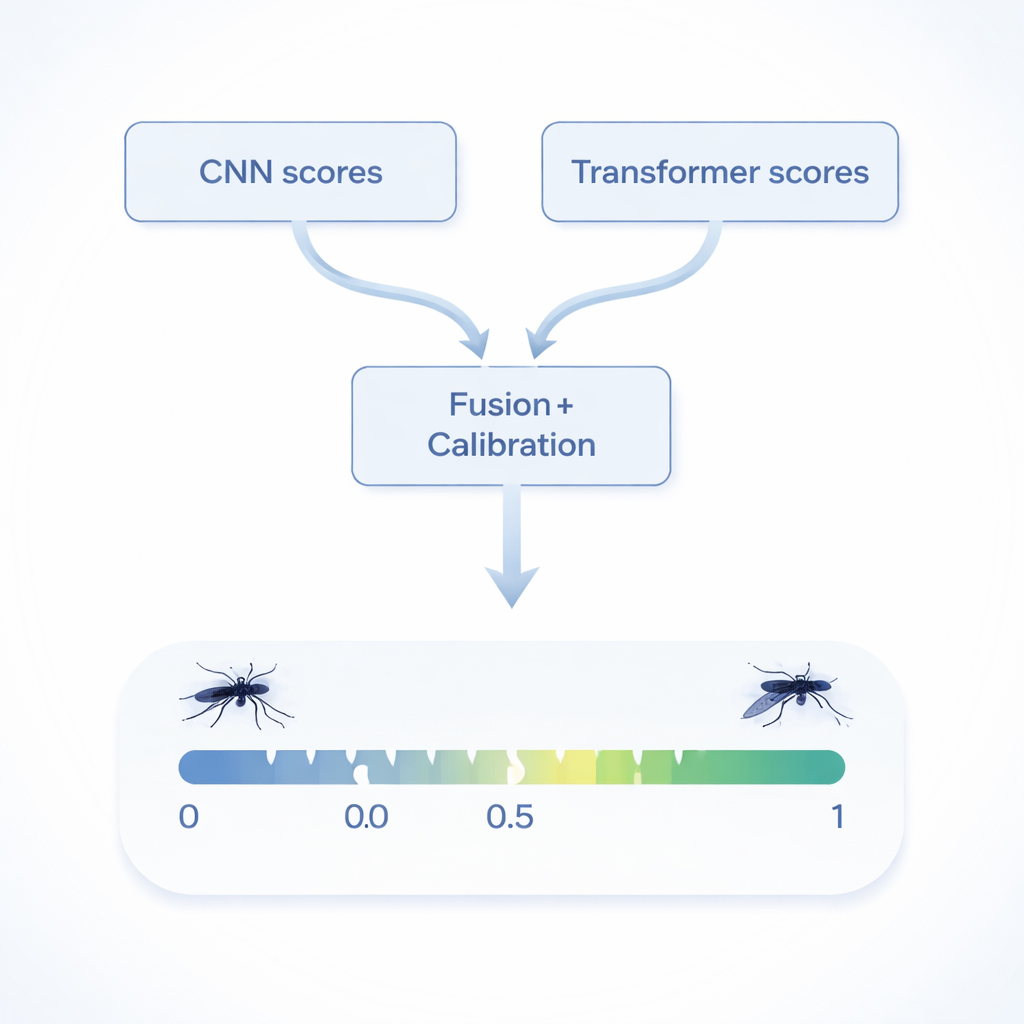

Ein weiterer zentraler Fortschritt betrifft die Fusion der Informationen aus den beiden Sehpfaden und den zwei Heads. Statt deren Vorhersagen einfach zu mitteln, lernt das Modell, wie viel Vertrauen es jeder internen Quelle basierend auf vergangener Leistung schenken sollte – ein Verfahren, das als calibrated stacking bekannt ist. Anschließend wird die kombinierte Score‑Verteilung durch einen einfachen Anpassungsschritt namens Temperature Scaling geleitet, der die Schärfe der Vertrauensangaben feinjustiert. Das Team testet außerdem jedes Bild mehrmals mit leicht veränderten Ausschnitten und Spiegelungen und bildet den Durchschnitt der Ergebnisse, um zufällige Schwankungen zu reduzieren. Gemeinsam sorgen diese Schritte dafür, dass die finalen Konfidenzwerte eng mit den tatsächlichen Fehlerraten übereinstimmen, selbst wenn das System auf einem bislang unbekannten Datensatz angewandt wird.

Nahezu perfekte Genauigkeit im Labor und im Feld

Um die Leistungsfähigkeit praktisch zu prüfen, trainieren und optimieren die Autorinnen und Autoren ihr Modell an einer großen Smartphone‑Bildsammlung mit acht Klassen und bewerten es dann sowohl auf ausgesparten Bildern desselben Sets als auch auf einem vollständig separaten Aedes‑Datensatz, der ausschließlich zum Testen verwendet wird. Bei der ursprünglichen Acht‑Klassen‑Aufgabe erreicht ihre Methode rund 99,5 Prozent Genauigkeit und übertrifft damit leicht, aber beständig starke Einzelmodelle und einfache Ensemble‑Strategien. Auf dem unbekannten Zwei‑Arten‑Testset identifiziert sie über 99 Prozent der Bilder korrekt. Ebenso wichtig ist, dass ihre Vertrauensangaben gut kalibriert sind: Wenn das System 90 Prozent Sicherheit meldet, liegt die Fehlerrate bei etwa einem von zehn Fällen – eine Eigenschaft, die viele frühere Mückenerkennungssysteme nicht gemessen oder garantiert haben.

Was das für die öffentliche Gesundheit bedeutet

Für Nicht‑Spezialisten lautet die Schlussfolgerung: Diese Arbeit liefert nicht nur einen sehr genauen Artenbestimmer, sondern eines, dessen selbstberichtete Sicherheit vertrauenswürdig ist. Diese Kombination erlaubt es Behörden, stabile Regeln festzulegen – etwa „untersuche jeden Ort, an dem das Modell mindestens zu 80 Prozent sicher ist, eine gefährliche Art gesehen zu haben“ – und zu erwarten, dass diese Regeln über verschiedene Telefone, Regionen und Lichtverhältnisse hinweg ähnlich funktionieren. Zwar bleiben Herausforderungen in Extremfällen wie stark verschwommenen oder verdeckten Insekten, doch das vorgeschlagene System bietet eine praktische, einsatzbereite Basis für flächendeckende Mückenüberwachung und legt den Grundstein für künftige Werkzeuge, die neue Arten, neue Geräte und sogar zusätzliche Sensorik‑Modalitäten wie Ton verarbeiten können.

Zitation: Nazari, M.Z., Zarchi, M.S., Emadi, S. et al. A novel deep learning approach for mosquito species classification via a dual-head structure and calibration-aware fusion architecture. Sci Rep 16, 7208 (2026). https://doi.org/10.1038/s41598-026-35453-1

Schlüsselwörter: Mückenbestimmung, Deep Learning, Vektorüberwachung, kalibrierte KI, Bildklassifizierung