Clear Sky Science · de

Die Rolle der Aussagekraft bei der Beurteilung von Roboterkompetenz

Warum Fehlleistungen von Robotern uns alle betreffen

Roboter und KI-Systeme dringen schnell aus Laboren in Fabriken, Krankenhäuser und auf unsere Straßen vor. Wenn wir anfangen, uns auf sie zu verlassen, wird eine Frage zentral: Wie entscheiden Menschen, ob ein Roboter wirklich kompetent ist? Dieser Beitrag untersucht, wie wir einen Roboter beurteilen, der meist gut arbeitet, aber gelegentlich einen überraschenden Fehler macht — oder unerwartet Erfolg hat. Die Ergebnisse erklären, warum unser Bauchgefühl gegenüber Maschinen von dem abweichen kann, was wir laut aussprechen, und warum ein einzelner Fehler entweder als Bagatelle abgetan werden kann oder unser Vertrauen dauerhaft verändert.

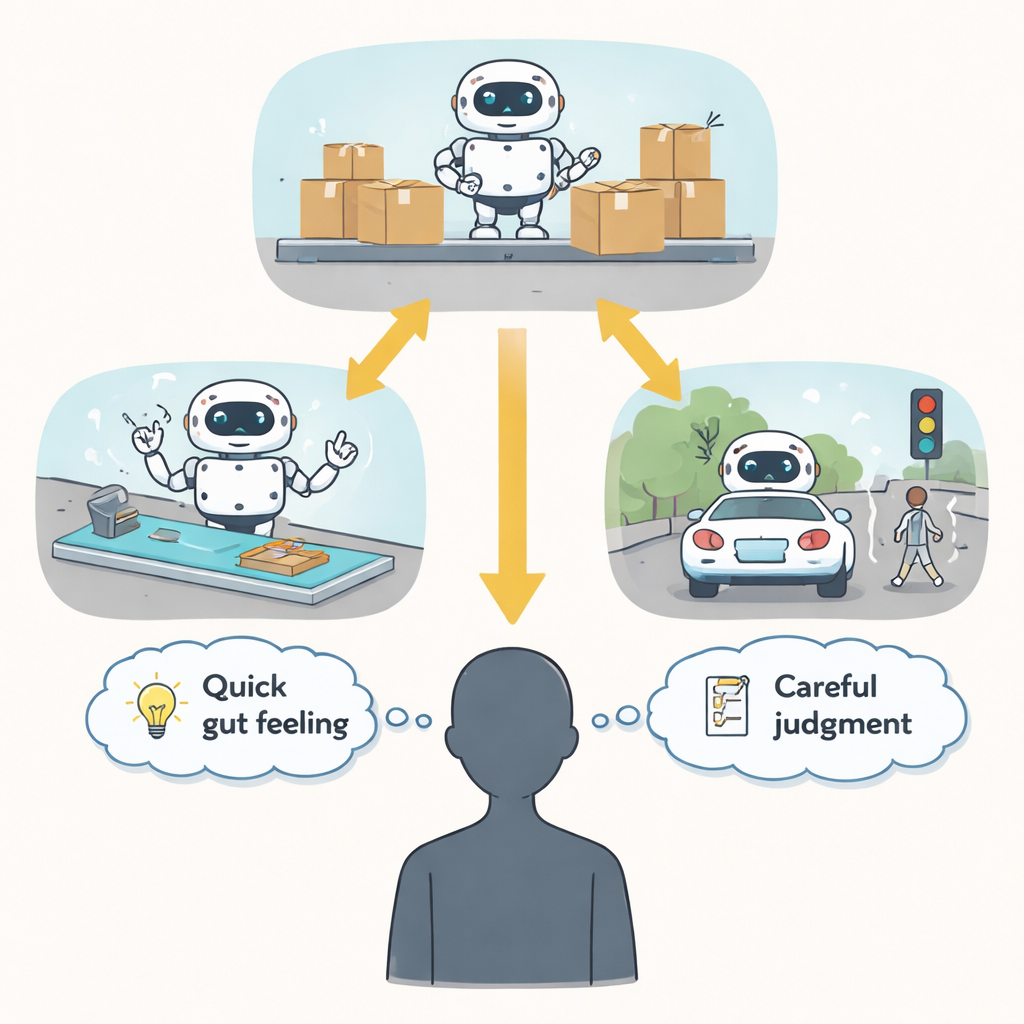

Zwei Wege, wie unser Geist Maschinen bewertet

Psychologen unterscheiden zwei Arten von Eindrücken. Explizite Eindrücke sind Urteile, die wir direkt berichten können, etwa wenn wir einen Roboter auf einer Skala von 1–7 in Sachen Kompetenz bewerten. Implizite Eindrücke sind automatischer und zeigen sich in schnellen Reaktionen, die Menschen ohne bewusste Bewertung geben. Frühere Arbeiten legten nahe, dass explizite Eindrücke sich schnell ändern, wenn wir neues Verhalten sehen, während implizite Eindrücke langsamer reagieren. Diese Studie fragt, ob dieser Unterschied wirklich auf verschiedene mentale Systeme zurückgeht — oder ob er davon abhängt, wie aussagekräftig, also diagnostisch, das neue Verhalten für die tatsächlichen Fähigkeiten des Roboters erscheint.

Von Fabrikhallen bis zu Operationssälen und Autobahnen

In neun Online-Experimenten mit über 3.700 Teilnehmenden zeigten die Forschenden Menschen verschiedene Roboter in realistischen Szenarien: einen Industrieroboter, der sich durch ein überfülltes Lager bewegt, einen Operationsroboter, der präzise Bahnen nachfährt, und ein selbstfahrendes Auto, das auf Hindernisse reagiert. Manchmal war der Roboter durchgehend geschickt oder durchgehend ungeschickt. In anderen Fällen war er meist kompetent, machte aber einen klaren Einzel‑Fehler, oder er war meist inkompetent, zeigte aber einen herausragenden Erfolg. Nach kurzen Sequenzen dieser Leistungen wurden die Eindrücke der Teilnehmenden auf zwei Wegen gemessen: mittels direkter Selbstberichte und mittels indirekter Aufgaben, die schnelle, automatische Reaktionen erfassen.

Wenn eine einzelne Auffälligkeit übergroße Bedeutung bekommt

In diesen realistischen Szenarien spiegelten die expliziten Bewertungen der Roboter sowohl das allgemeine Leistungsbild als auch den seltenen „Ausreißer“-Durchgang wider. Ein einzelner Fehler unter vielen Erfolgen konnte die expliziten Ratings merklich drücken, und ein einzelner Erfolg unter vielen Misserfolgen konnte sie anheben. Implizite Eindrücke erzählten jedoch eine andere Geschichte. Sie reagierten stark auf das typische Verhalten des Roboters — ob er gewöhnlich kompetent war oder nicht — und ignorierten größtenteils den einzelnen Ausreißer. Diese Dissoziation blieb bestehen, selbst als die Forschenden ihre Messinstrumente so umgestalteten, dass die „expliziten“ und „impliziten“ Aufgaben äußerlich und gefühlt möglichst ähnlich waren und sich hauptsächlich darin unterschieden, ob die Teilnehmenden bewusst angewiesen wurden, den Roboter zu bewerten.

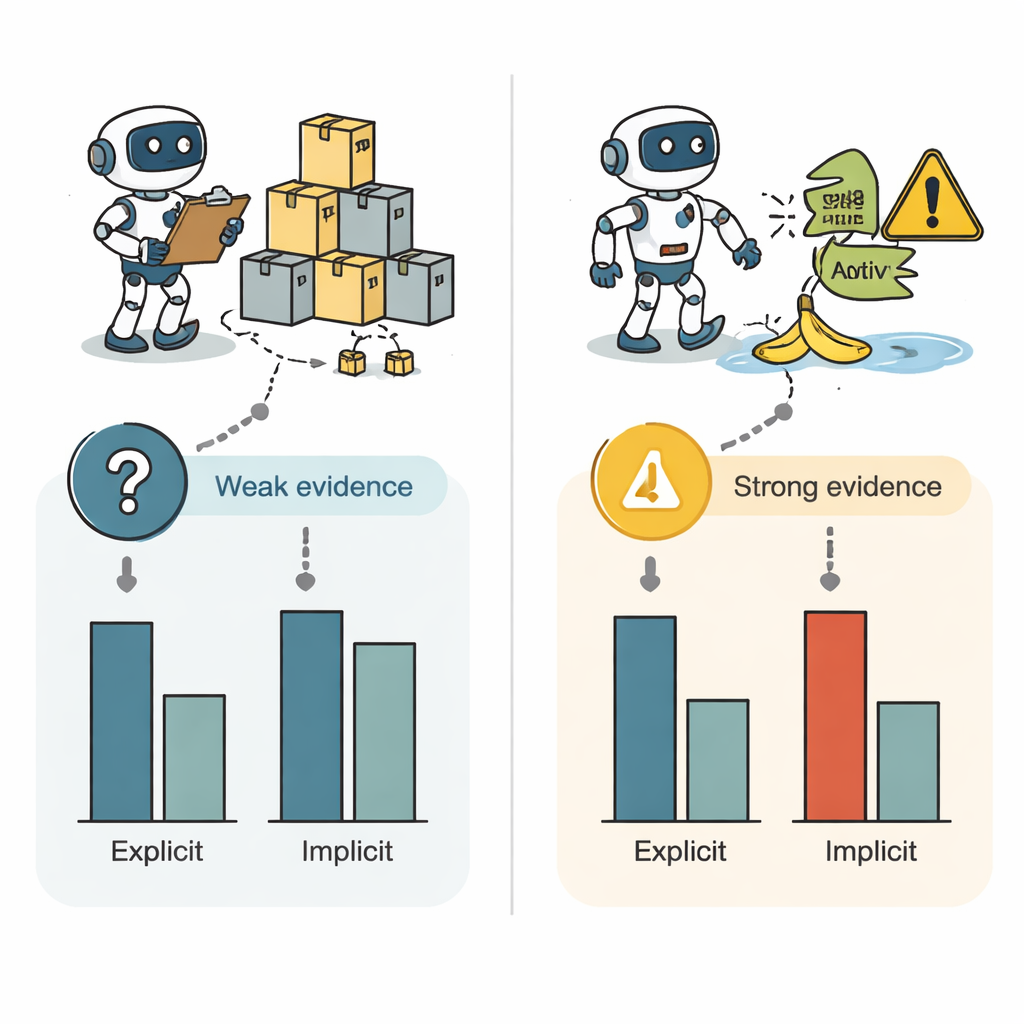

Was einen Roboterfehler wirklich aussagekräftig macht

Das Team prüfte dann eine Schlüsselidee: dass die Wirkung eines Ausreißerereignisses davon abhängt, wie diagnostisch es erscheint — ob Menschen denken, dass es wirklich etwas Dauerhaftes über den Roboter offenbart. In neuen Studien sahen Teilnehmende zunächst mehrere fehlerfreie Durchgänge, gefolgt von einem oder mehreren Ausfällen. Wenn die späteren Fehler als wichtig, aktuell oder als wiederholte Vorkommnisse dargestellt wurden, oder wenn mehrere Fehler sich aufsummierten und so das Ausmaß der vorherigen Erfolge ausglichen, verschoben sich sowohl explizite als auch implizite Eindrücke. Entscheidend ist: Unter diesen hochdiagnostischen Bedingungen reichte selbst ein einzelner Fehler aus, um automatische, implizite Eindrücke zu beeinflussen. Wenn derselbe Fehltritt jedoch als veraltet, unwichtig oder als einmaliges Missgeschick beschrieben wurde, änderten sich implizite Eindrücke kaum, obwohl explizite Bewertungen weiterhin reagierten.

Warum das für das alltägliche Vertrauen in KI wichtig ist

Insgesamt deuten die Befunde darauf hin, dass unsere schnellen, automatischen Eindrücke von Roboterkompetenz nicht blind gegenüber neuen Informationen sind, sondern stärkere oder deutlichere Belege verlangen, bevor sie sich ändern. Unsere ausgesprochenen Bewertungen hingegen sind sehr reaktionsfreudig, selbst gegenüber schwachen oder mehrdeutigen Ereignissen — teilweise weil wir das Bedürfnis haben, bei einer direkten Nachfrage irgendeine verfügbare Information zu nutzen. Für Designer, Ingenieurinnen und Entscheidungsträger bedeutet das: Vertrauen in Roboter zu managen heißt nicht nur, Fehler zu reduzieren, sondern auch, wie diese Fehler gerahmt und verstanden werden. Ein einziger offensichtlicher Ausfall — etwa wenn ein Auto nicht anhält, obwohl es deutlich hätte tun müssen — kann sowohl unser Bauchgefühl als auch unsere geäußerten Urteile verändern, mit direkten Konsequenzen dafür, wie bereit wir sind, intelligente Maschinen zu übernehmen und ihnen zu vertrauen.

Zitation: Surdel, N., Ferguson, M.J. The role of diagnosticity in judging robot competence. Sci Rep 16, 7578 (2026). https://doi.org/10.1038/s41598-026-35375-y

Schlüsselwörter: Roboterkompetenz, Mensch-Roboter-Interaktion, implizite Voreingenommenheit, Vertrauen in KI, diagnostische Informationen