Clear Sky Science · de

Multiklassen-Klassifizierung von Augenerkrankungen mittels Deep Learning und EfficientNetB0-Fusionstechniken

Warum frühe Augenuntersuchungen wichtig sind

Sehverlust schleicht sich oft leise ein. Häufige Augenprobleme wie Katarakte, Glaukom und diabetische Schädigungen der Netzhaut können das Sehvermögen lange vor offensichtlichen Symptomen stehlen. Weltweit gibt es nicht genug Augenfachärzte, um alle rechtzeitig zu untersuchen, insbesondere in ländlichen oder einkommensschwachen Regionen. Diese Studie untersucht, wie ein intelligentes Computersystem, das Fotos vom Augenhintergrund auswertet, Ärzten helfen könnte, mehrere wichtige Augenerkrankungen frühzeitig und zuverlässig zu erkennen, mithilfe derselben Art von künstlicher Intelligenz, die moderne Bildersuche und Gesichtserkennung antreibt.

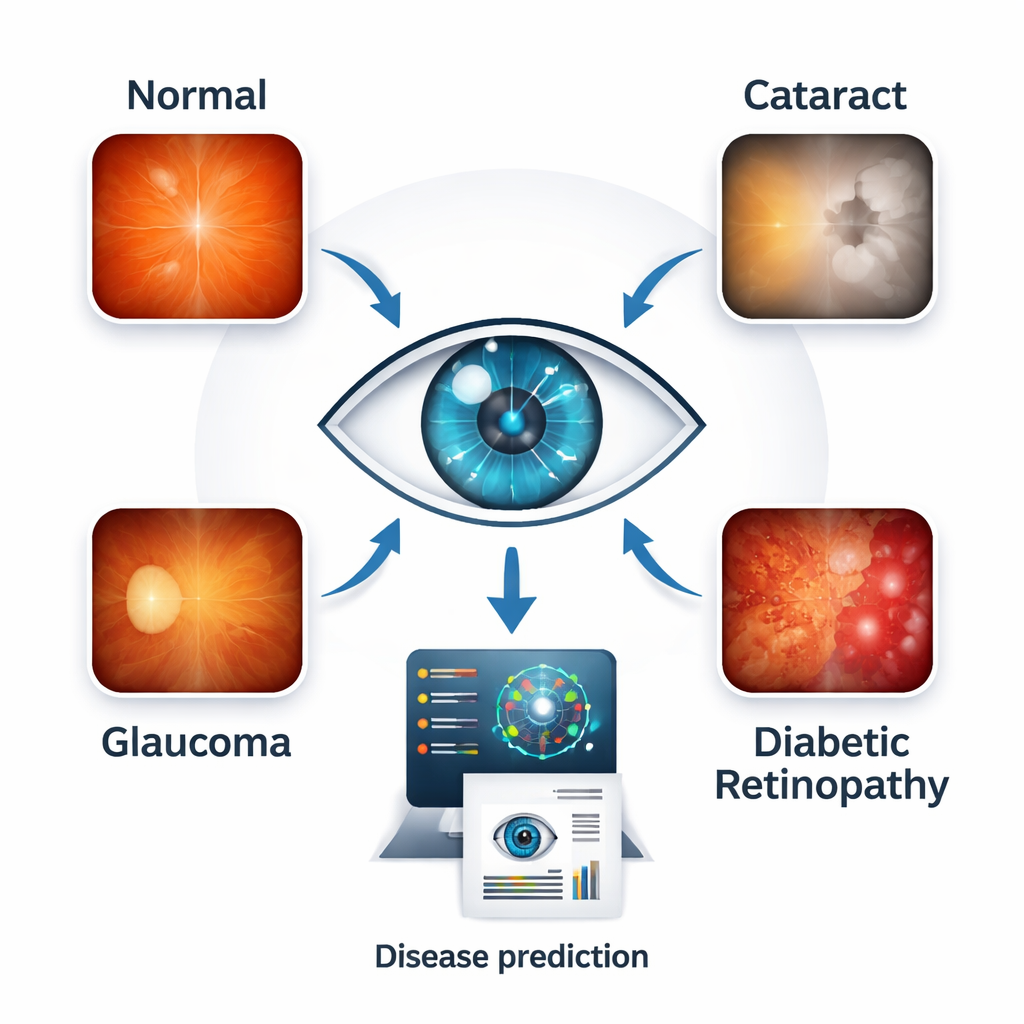

Krankheit in einem einzigen Schnappschuss sehen

Augenärzte verwenden bereits Farbfotos der Netzhaut – der lichtempfindlichen Schicht am Augenhintergrund – um nach Erkrankungen zu suchen. Auf diesen Bildern zeigen sich Katarakte als Eintrübung im optischen Weg, Glaukom verändert die Form des Sehnervs, und diabetische Retinopathie bedeckt die Netzhaut mit winzigen Lecks und Narben. Die Forschenden sammelten 4.217 hochauflösende Netzhautbilder, gleichmäßig verteilt auf vier Gruppen: gesunde Augen, Katarakt, Glaukom und diabetische Retinopathie. Durch die Arbeit mit einer ausgeglichenen Sammlung aus mehreren öffentlichen Quellen verringerten sie das Risiko, dass der Computer Abkürzungen lernt, die an ein einzelnes Krankenhaus, eine Kamera oder einen Erkrankungstyp gebunden sind, anstatt an die tatsächlichen Krankheitszeichen.

Zwei „Gehirne“ zusammenarbeiten lassen

Moderne Bildauswerteprogramme, sogenannte Deep‑Learning‑Modelle, sind sehr gut darin, Muster zu erkennen, doch jedes hat seine eigenen Stärken und blinden Flecken. Statt sich auf ein einzelnes Modell zu verlassen, baute das Team „Dual‑Backbone“-Systeme, die zwei bekannte Bildnetzwerke parallel laufen lassen und dann ihre Erkenntnisse verschmelzen. Eines dieser Netzwerke, EfficientNetB0, ist ein kompaktes, effizientes Modell, das die allgemeine Struktur von Bildern erfasst; es wurde stets als Basis verwendet. Es wurde nacheinander mit drei anderen Modellen kombiniert – ResNet50, InceptionV3 und AlexNet –, die sich auf tiefere, multiskalige oder ressourcenschonende Mustererkennung spezialisieren. Die Systeme kombinierten dann die beiden Merkmalsmengen auf verschiedene Weisen: durch einfaches Zusammenfügen, Addieren, unterschiedliche Gewichtung oder indem jedes Modell über die endgültige Antwort abstimmen durfte.

Das System auf die Probe stellen

Die Forschenden trainierten und optimierten 12 verschiedene Modellkombinationen mit dem Großteil ihrer Netzhautbilder und hielten einige zurück, um die Leistung zu prüfen. In diesem internen Test erzielte der beste Ansatz, der Merkmale von EfficientNetB0 und ResNet50 zusammenführte, etwa 95 % Gesamtgenauigkeit und einen nahezu perfekten Wert bei einer Standardkennzahl für diagnostische Qualität. Ähnliche Kombinationen mit InceptionV3 und AlexNet schnitten ebenfalls gut ab. Um zu prüfen, ob das System mit realer Vielfalt umgehen kann, statt nur sein Trainingsset auszuwerten, testete das Team anschließend alle Modelle an 400 Bildern aus zwei unabhängigen Sammlungen, die in verschiedenen Krankenhäusern mit unterschiedlichen Kameras aufgenommen wurden. Hier stieg die Genauigkeit sogar noch an, auf etwa 95 % bis 98 %, und alle Modelle hielten sehr hohe Werte dafür, wie gut sie kranke von gesunden Augen unterscheiden konnten.

Ins schwarze Kästchen hineinschauen

Ärztinnen, Ärzte und Aufsichtsbehörden fragen zunehmend nicht nur „Wie genau ist es?“, sondern auch „Warum trifft es diese Entscheidung?“. Um dies zu beantworten, nutzten die Autorinnen und Autoren Visualisierungstools wie Score‑CAM und LIME. Diese Werkzeuge heben hervor, welche Bildbereiche das Urteil des Modells am stärksten beeinflussen, und verwandeln die „Aufmerksamkeit“ des Systems in Heatmaps, die auf der Netzhaut überlagert werden. Bei der diabetischen Retinopathie stimmten die hervorgehobenen Bereiche mit undichten Blutgefäßen und Flecken in der Nähe der Makula, dem Zentrum des scharfen Sehens, überein. Beim Glaukom lag der Fokus auf dem Sehnervenkopf und dem umliegenden Gewebe, wo Schäden auftreten. Kataraktbezogene Entscheidungen betonten diffuse Eintrübungen entlang des optischen Pfads. Entscheidenderweise zeigten normale Augen keine starken, fehlplatzierten Hotspots. Diese enge Übereinstimmung zwischen dem Modellfokus und der Lehrbuchanatomie deutet darauf hin, dass das System dieselben Merkmale nutzt, auf die Klinikerinnen und Kliniker in der Praxis achten.

Was das für die Routinediagnostik bedeuten könnte

Für Nicht‑Spezialisten ist die Quintessenz, dass ein einzelnes Netzhautfoto, aufgenommen mit einer Standardkamera, demnächst dabei helfen könnte, mehrere Hauptursachen von Erblindung auf einmal zu screenen. Das Dual‑Netzwerk‑Design und kluge Fusionstechniken ergaben nicht nur hohe Genauigkeit, sondern auch stabile Ergebnisse, wenn Bilder aus neuen Kliniken und Geräten stammten – eine Voraussetzung für den Einsatz in der Praxis. Zwar sind weitere Tests an größeren und vielfältigeren Populationen nötig, besonders bevor die Technologie Behandlungsempfehlungen eigenständig leiten kann, doch zeigt diese Arbeit, dass die Kombination unterschiedlicher künstlicher „Augen“ schnelle, verlässliche Zweitmeinungen liefern kann. In überlasteten Krankenhäusern, kleinen Praxen oder mobilen Screening‑Einheiten könnten solche Werkzeuge helfen, Menschen zu identifizieren, die dringend einen Augenarzt aufsuchen müssen, und so möglicherweise Millionen von Menschen das Augenlicht bewahren.

Zitation: Sah, U.K., Chatterjee, J.M. & Sujatha, R. Multi-class eye disease classification using deep learning EfficientNetB0 fusion techniques. Sci Rep 16, 6368 (2026). https://doi.org/10.1038/s41598-026-35357-0

Schlüsselwörter: Augenerkrankung, retinale Bildgebung, Deep Learning, Glaukom, diabetische Retinopathie