Clear Sky Science · de

Ein multimodaler Ansatz zur Erkennung von Falschmeldungen und einflussreichen Knoten bei deren Verbreitung mithilfe von Deep Learning und Netzwerkanalyse

Warum das im Alltag wichtig ist

Jeden Tag scrollen Millionen Menschen durch soziale Medien und stoßen auf Beiträge zu Gesundheit, Politik, Geld und mehr. Unter nützlichen Informationen mischen sich Gerüchte und Falschmeldungen, die Angst, Verwirrung oder sogar reale Schäden auslösen können. Diese Studie stellt eine leistungsfähige Methode vor, die zwei Dinge zugleich leistet: erstens automatische Erkennung falscher oder irreführender Beiträge und zweitens die Kartierung dessen, wer in einer Online‑Gemeinschaft am meisten zur Verbreitung beiträgt. Die Arbeit konzentriert sich auf Twitter‑Nachrichten zu Covid‑19, doch die Ideen könnten Plattformen, Journalistinnen und Journalisten und die Öffentlichkeit dabei helfen, schneller und gezielter auf schädliche Desinformation in vielen Lebensbereichen zu reagieren.

Wie Gerüchte durch Online‑Massen schwappen

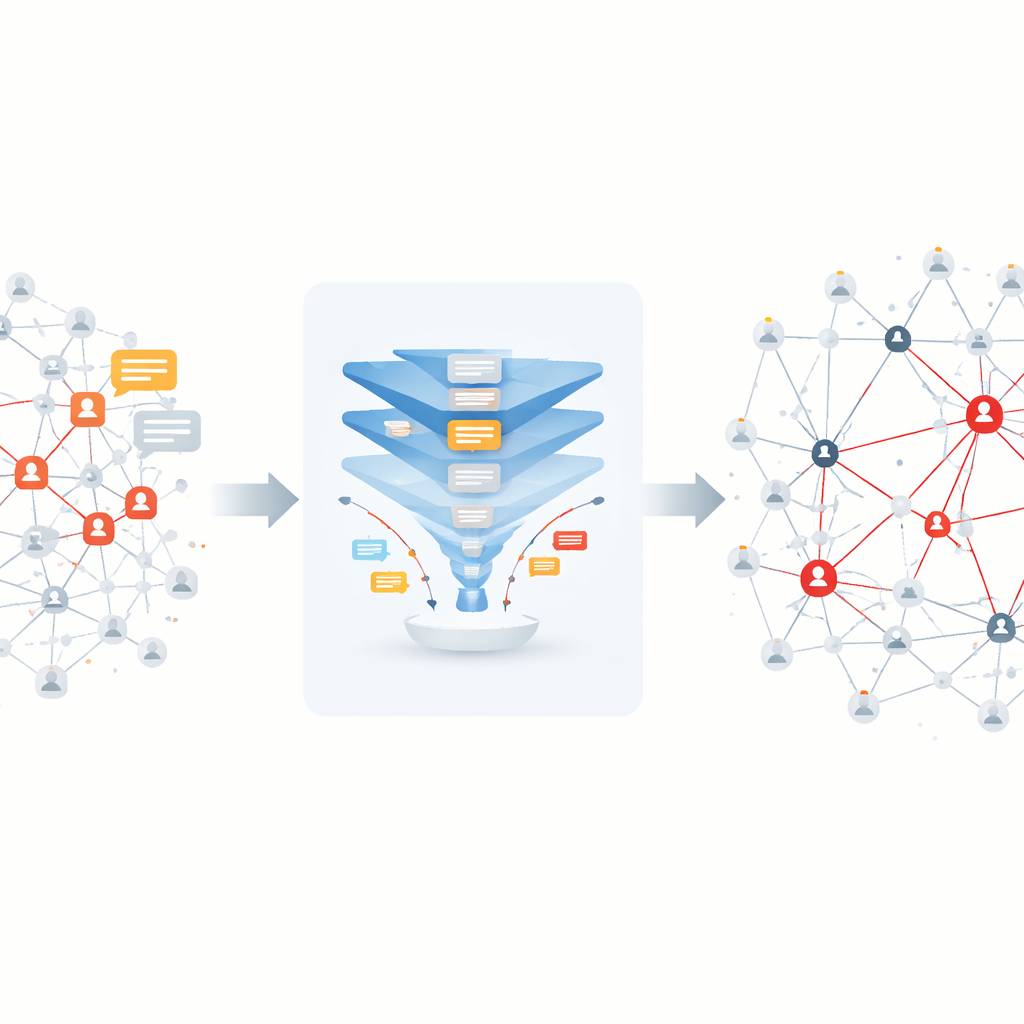

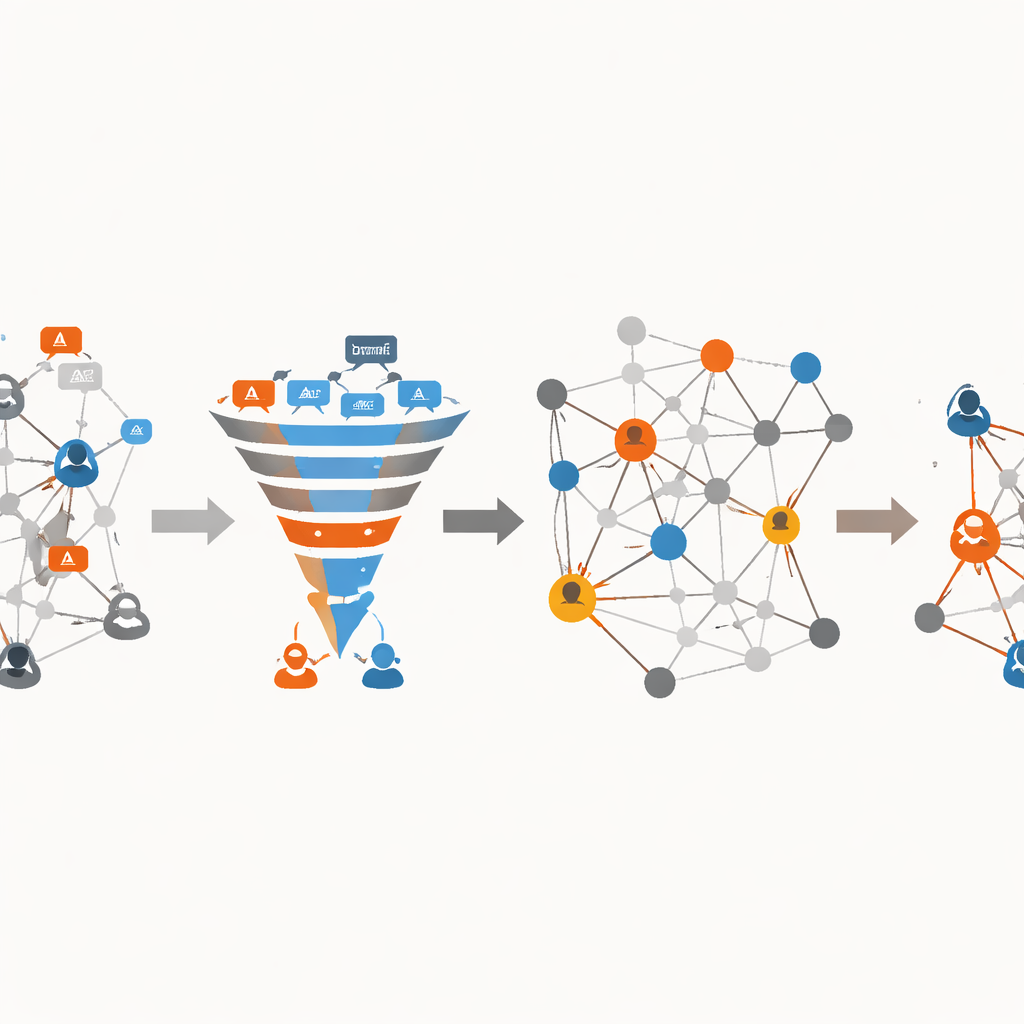

Soziale Netzwerke wie Twitter, Facebook oder Messenger lassen sich als riesige Netze von Personen (Knoten) darstellen, die durch ihre Interaktionen (Kanten) verbunden sind. Wenn ein Nutzer eine Nachricht postet und andere darauf antworten oder sie teilen, kann sich diese Information schnell durchs Netz ausbreiten. Gerüchte — unbestätigte oder falsche Behauptungen — verhalten sich ähnlich wie ansteckende Krankheiten: Sie springen von Person zu Person, wachsen rasch und sind schwer zu stoppen. Frühere Forschung hat zwei Fragen oft getrennt behandelt: wie man erkennt, ob ein Beitrag ein Gerücht ist, und wie man die zentralen „Verbreiter“ findet, die ein Gerücht weit tragen. Die Autorinnen und Autoren argumentieren, dass die gleichzeitige Bearbeitung beider Fragen — verbunden mit Blick auf die Netzwerkstruktur und zeitliche Veränderungen der Aktivität — ein deutlich klareres Bild liefert, wie falsche Geschichten sich bewegen.

Einem Computer beibringen, zweifelhafte Beiträge zu lesen und zu markieren

Der erste Teil der Methode konzentriert sich auf den Inhalt jedes Tweets. Die Forschenden behandeln jeden Tweet als kurzes Dokument und säubern ihn, indem sie Störzeichen entfernen, Weblinks und E‑Mail‑Adressen durch einfache Platzhalter ersetzen und häufige Füllwörter entfernen, die wenig Bedeutung beitragen. Anschließend übersetzen sie jedes Wort in einen numerischen Vektor mithilfe einer weit verbreiteten Technik namens GloVe, die erfasst, wie Wörter in großen Textsammlungen typischerweise zusammen auftreten. Durch das Mittel dieser Wortvektoren wird jeder Tweet zu einer kompakten numerischen Zusammenfassung seiner Bedeutung. Diese Zusammenfassungen werden dann in ein eindimensionales Faltungsneuronales Netzwerk eingespeist — eine Form des Deep Learning, die subtile Muster erkennen kann —, um zu entscheiden, ob ein Tweet authentisch ist oder ein Gerücht.

Die Schlüsselausbreiter im Netzwerk finden

Nachdem das System Gerüchte‑Tweets von echten Beiträgen getrennt hat, wendet sich der zweite Teil dem Aufbau des sozialen Netzwerks zu. Jeder Nutzer ist ein Punkt in einem gerichteten, gewichteten Graphen, und jede Antwort oder Retweet wird zu einer Kante, deren Stärke widerspiegelt, wie häufig ein Nutzer auf die Nachrichten eines anderen reagiert. Mit diesen Informationen clustern die Autorinnen und Autoren zunächst Nutzer in Gemeinschaften — Gruppen, die stärker untereinander interagieren als mit Außenstehenden —, indem sie eine spezielle Baumdarstellung des Netzwerks erstellen und eng verbundene Teilgruppen anhand ihres Zusammenhalts zusammenführen. Innerhalb dieser Communities berechnen sie, wie oft jeder Nutzer auf den wichtigsten Pfaden zwischen anderen liegt, ein Maß, das als Betweenness bekannt ist. Nutzer, die immer wieder auf pfadwichtigen Stellen erscheinen, gelten als einflussreiche Verbreiter. Die Gewichtungen der Verbindungen werden dann aktualisiert, sodass sowohl die Häufigkeit der Interaktion als auch die Zentralität der verbundenen Nutzer einfließt, wodurch die wahrscheinlichsten Routen aufgedeckt werden, die Gerüchte im Zeitverlauf durchs Netzwerk nehmen.

Was die Covid‑19‑Fallstudie ergab

Um ihr Framework zu testen, wandten die Forschenden es auf einen umfangreichen Twitter‑Datensatz zu Covid‑19 an: nahezu 100 Millionen Tweets von mehr als 150.000 Nutzern, aus denen sie über 14.000 eindeutige Nachrichten extrahierten, die entweder als authentische Informationen oder als Gerüchte gekennzeichnet waren. Auf diesen Daten klassifizierte ihr Deep‑Learning‑Modell etwa 99 Prozent der Tweets korrekt und übertraf damit mehrere vorhandene Methoden, einschließlich anderer fortgeschrittener Falschmeldungsdetektoren. In der zweiten Phase verglichen sie ihre Liste einflussreicher Nutzer mit einem bekannten mathematischen Modell zur Informationsverbreitung und fanden die höchste Übereinstimmung unter den getesteten Methoden. Sie zeigten außerdem, dass sich bei Analyse längerer Zeiträume — 120, 240 und 360 Tage — die Fähigkeit des Modells, Schlüsselverbreiter und Hauptgerüchternetzwerke zu identifizieren, verbesserte und dies mit geringerer Rechenzeit als konkurrierende netzwerkbasierte Techniken gelang.

Was das für den Kampf gegen Desinformation bedeutet

Kurz gesagt zeigt die Studie, dass es möglich ist, ein System zu bauen, das nicht nur mit sehr hoher Genauigkeit wahrscheinliche Falschmeldungen erkennt, sondern auch nachverfolgt, wie sie sich ausbreiten und wer am meisten für ihre Verbreitung verantwortlich ist. Anstatt alle Nutzer und Verbindungen gleich zu behandeln, hebt die Methode eine kleinere Anzahl von Communities und Individuen hervor, deren Verhalten für die Kontrolle schädlicher Geschichten am wichtigsten ist. Obwohl die Arbeit an anonymisierten Twitter‑Daten zu Covid‑19 durchgeführt wurde und nicht zwangsläufig auf jede Plattform oder jedes Thema direkt übertragbar ist, weist sie den Weg zu gezielteren, datenbasierten Maßnahmen gegen Online‑Gerüchte — etwa gezieltes Fact‑Checking, Warnhinweise oder Plattforminterventionen dort einzusetzen, wo sie am wirkungsvollsten sind — und berücksichtigt dabei den Schutz der Privatsphäre und ethische Nutzungsaspekte.

Zitation: Zhang, W., Qian, M. & Zhang, Q. A multi-modal approach for recognizing fake news and influential nodes in spreading them using deep learning and network analysis. Sci Rep 16, 9775 (2026). https://doi.org/10.1038/s41598-026-35342-7

Schlüsselwörter: Falschmeldungen, soziale Netzwerke, Gerüchteverbreitung, Deep Learning, einflussreiche Nutzer