Clear Sky Science · de

Ein Echtzeit‑Erkennungsalgorithmus für aquatische Pflanzen auf Mobilgeräten basierend auf Deep Learning für intelligente Ökologieüberwachung

Warum das Erkennen von Wasserpflanzen mit dem Telefon wichtig ist

Wasserpflanzen sind weit mehr als Zierde für Teiche und Seen: Sie filtern Schadstoffe, liefern Sauerstoff und bieten Fischen und Insekten Schutz. Verbreiten sich jedoch falsche Arten zu schnell, können sie Gewässer verstopfen und ganze Ökosysteme aus dem Gleichgewicht bringen. Diese Studie stellt eine neue Methode vor, mit der sich verschiedene Wasserpflanzenarten automatisch mithilfe eines handelsüblichen Smartphones erkennen lassen, sodass Wissenschaftler und Gewässermanager empfindliche Ökosysteme in Echtzeit überwachen können, statt sich nur auf langsame, manuelle Erhebungen zu verlassen.

Die Herausforderung, Leben unter der Oberfläche zu beobachten

Gesunde Seen und Flüsse basieren auf einem empfindlichen Gefüge heimischer Wasserpflanzen. Sie entziehen dem Wasser Nährstoffe und Schadstoffe, sorgen für bessere Klarheit und bieten Nahrung und Verstecke für die Tierwelt. Invasive Arten können sich dagegen schnell ausbreiten, die Schifffahrt behindern, den Sauerstoffgehalt senken und Fischbestände schädigen. Traditionell bedeutete die Bestimmung dieser Pflanzen, Experten ins Feld zu schicken, die Proben sammeln und per Hand klassifizieren — ein zeitaufwändiger, kostspieliger Prozess, der sich nur schwer oft genug wiederholen lässt, um rasche Veränderungen durch Klima und menschliche Aktivitäten zu erfassen.

Von sperrigen Rechnern zu pflanzen-erkennenden Hosentaschengeräten

In den letzten Jahren hat die künstliche Intelligenz gelernt, Objekte in Fotos und Videos mit beeindruckender Genauigkeit zu erkennen, und Forschende haben sie auf Unkräuter, Nutzpflanzen und einige Wasserpflanzen angewandt. Die meisten dieser Systeme laufen jedoch auf leistungsstarken Desktop‑Computern oder Servern. Leichte Versionen, die auf Telefonen oder Drohnen laufen sollen, opfern meist zu viel Genauigkeit oder erfordern mehr Rechenleistung, als kleine Geräte bereitstellen können. Die Autorinnen und Autoren konzentrieren sich auf diesen Engpass: Wie lässt sich die Erkennung schnell und präzise halten, während das Modell so verkleinert wird, dass es auf einem Mobiltelefon am Ufer flüssig läuft?

Eine schlauere, sparsamere Methode, Pflanzen in komplexen Gewässern zu erkennen

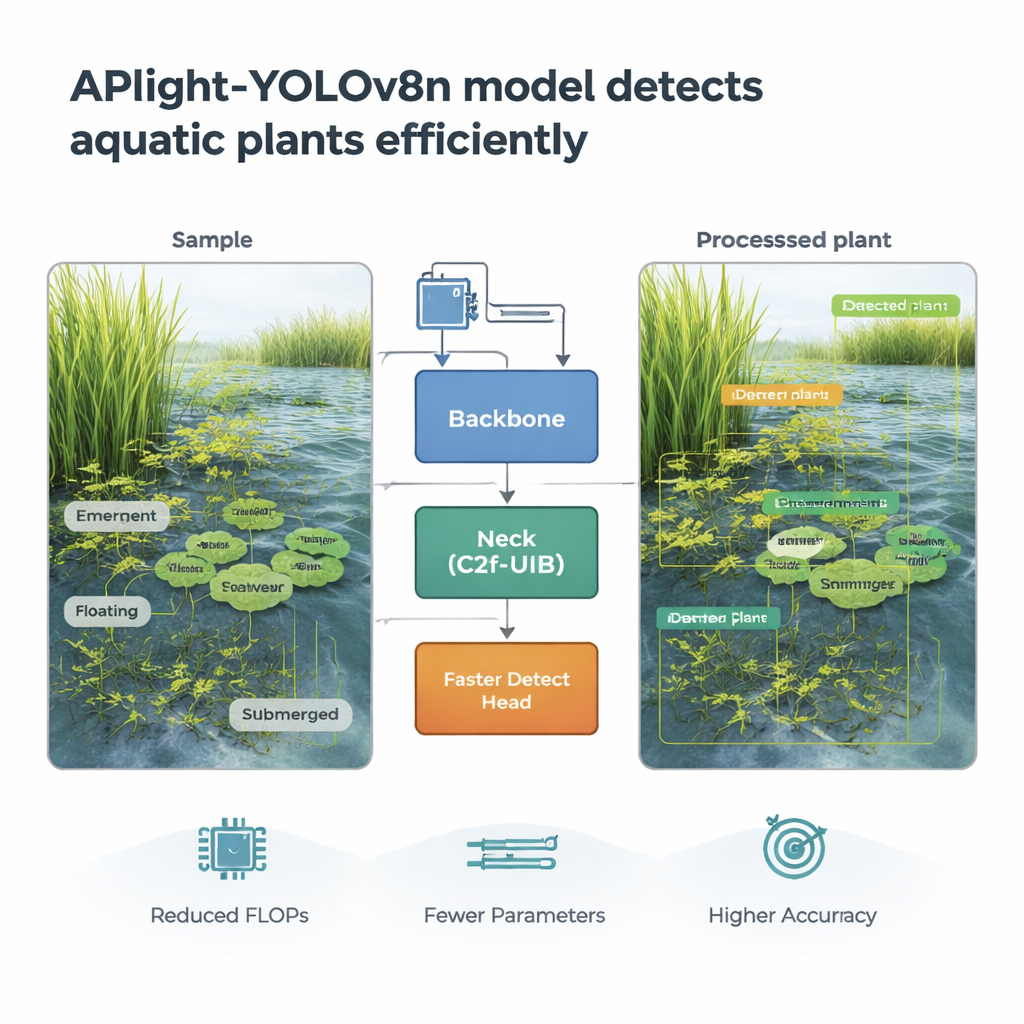

Das Team baut auf YOLOv8n auf, einem beliebten „you only look once“-Objekterkennungsmodell, das bereits relativ kompakt konzipiert ist. Sie überarbeiten zwei Schlüsselkomponenten der internen Pipeline, um besser mit kleinen und mittelgroßen Wasserpflanzen in unruhigen, spiegelnden Hintergründen zurechtzukommen. Erstens konzentriert ein neuer „Faster Detect“-Kopf die Aufmerksamkeit auf die Pflanzen‑Größen, die in der Praxis am häufigsten vorkommen, und verbessert so das Umreißen und Beschriften. Zweitens mischt ein neu gestalteter „C2f‑UIB“-Feature‑Verarbeitungsblock feine Details und breitere Szeneninformationen effizienter, so dass das Netzwerk ähnlich aussehende Arten besser unterscheiden kann, während es weniger Rechenaufwand benötigt. Zusammen ergeben diese Änderungen ein neues Modell, APlight‑YOLOv8n, das speziell für die Überwachung von Wasserpflanzen zugeschnitten ist.

Feldtest des Modells

Um zu prüfen, ob APlight‑YOLOv8n auch außerhalb des Labors funktioniert, trainieren und testen die Autorinnen und Autoren es an mehr als zweitausend hochauflösenden Fotos von Flüssen, Feuchtgebieten und Fischteichen. Die Aufnahmen decken zwölf Pflanzenarten in vier Wuchsformen ab: terrestrisch aufwachsend (emergent), frei schwimmend, mit schwimmenden Blättern und untergetaucht. Die Bilder zeigen trübes Wasser, überlappende Blätter und teilweise verdeckte Pflanzen. Im Vergleich zum ursprünglichen YOLOv8n und mehreren anderen bekannten Erkennungsmodellen ist das neue Design kleiner und leistungsfähiger: Es reduziert die Anzahl lernbarer Parameter und die erforderlichen Rechenoperationen um mehr als ein Viertel, erkennt Pflanzen jedoch genauer — besonders bei emergenten und frei schwimmenden Arten. Auf einem Android‑Smartphone installiert, verarbeitet es etwa 33 Videobilder pro Sekunde beim Scannen nach Pflanzen, schnell genug für Echtzeitanwendungen an Ufern oder von kleinen Booten aus.

Grenzen, nächste Schritte und Bedeutung für sauberes Wasser

Obwohl APlight‑YOLOv8n insgesamt gut abschneidet, hat es weiterhin Schwierigkeiten mit untergetauchten Pflanzen, deren schwache Konturen durch trübes Wasser, Spiegelungen und geringe Beleuchtung leicht verwischen. Der aktuelle Datensatz umfasst zudem nur eine begrenzte Artenauswahl aus einer bestimmten Region; zusätzliche Bilder aus anderen Klimazonen und Pflanzen‑gemeinschaften werden nötig sein, um das System global zuverlässig zu machen. Die Forschenden schlagen vor, die Sensitivität für schwache, unterwasser liegende Signale zu verbessern und das Modell für andere mobile Plattformen wie Drohnen und energiearme Embedded‑Boards anzupassen.

Ein neues Werkzeug für schnelleren, intelligenteren Gewässerschutz

Für Nicht‑Spezialisten ist die Kernbotschaft klar: Diese Studie zeigt, dass ein gewöhnliches Smartphone, ausgestattet mit einem sorgfältig entwickelten KI‑Modell, viele Arten von Wasserpflanzen in Echtzeit schnell erkennen kann. Indem die Überwachung günstiger, schneller und flexibler wird, könnte APlight‑YOLOv8n Gewässermanager dabei unterstützen, invasive Arten zu verfolgen, Maßnahmen zur Pflanzenbekämpfung zu planen und aquatische Lebensräume zu schützen, bevor Probleme außer Kontrolle geraten. Es ist ein früher, aber vielversprechender Schritt, fortschrittliche ökologische Überwachungsinstrumente direkt in die Hände derjenigen zu legen, die am Wasser arbeiten.

Zitation: Wang, D., Dong, Z., Yang, G. et al. A real-time mobile aquatic plant recognition algorithm based on deep learning for intelligent ecological monitoring. Sci Rep 16, 5075 (2026). https://doi.org/10.1038/s41598-026-35310-1

Schlüsselwörter: Wasserpflanzen, invasive Arten, ökologische Überwachung, mobiles Deep Learning, Objekterkennung