Clear Sky Science · de

Verbessertes YOLOv11n zur Erkennung kleiner Objekte in UAV-Bildern: höhere Genauigkeit bei weniger Parametern

Warum das Erkennen winziger Objekte aus der Luft wichtig ist

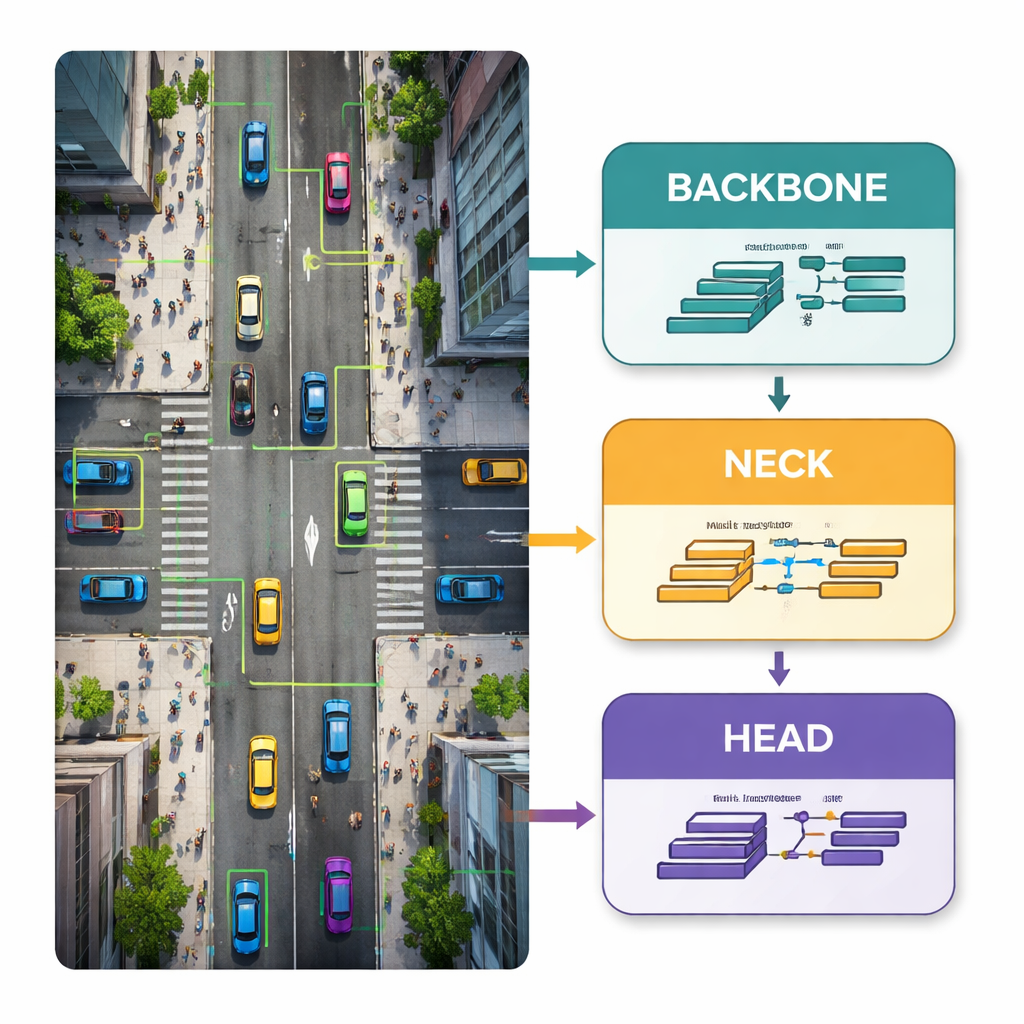

Kleine fliegende Roboter werden schnell Teil des Alltags – von Verkehrsüberwachung und Katastrophenhilfe bis hin zur Paketzustellung. Ein hartnäckiges Problem bleibt jedoch: Wenn eine Drohne aus mehreren hundert Metern Höhe nach unten blickt, schrumpfen Menschen, Autos und Boote auf nur wenige Pixel. Standard-Computer-Vision-Systeme übersehen diese Punkte häufig oder verwechseln sie mit Hintergrundstörungen. Dieses Paper stellt eine schlankere, intelligentere Version eines verbreiteten Detektors, YOLOv11n, vor, die speziell darauf abgestimmt ist, winzige Objekte in Drohnenbildern zu finden und dabei effizient auf leichten Bordcomputern zu laufen.

Mehr sehen in winzigen, verschwommenen Details

Drohnenaufnahmen sind harte Einsatzbedingungen für Algorithmen. Die meisten Ziele sind kleiner als 32×32 Pixel, viele weniger als 16 Pixel breit. Bewegung, Vibrationen, wechselndes Licht, Dunst und unruhige Stadt-Hintergründe erschweren das Erkennen noch weiter. Gleichzeitig setzen Drohnen oft auf bescheidene Prozessoren und begrenzte Energie, sodass schwere Modelle unpraktisch sind. Die Autoren bauen auf YOLOv11n auf, einem kompakten Echtzeit-Detektor, und überarbeiten seine internen Komponenten, um aus kleinen, kontrastarmen Bereichen mehr verwertbare Informationen herauszuholen, ohne das Modell aufzublähen. Ihr Ziel ist klar, aber anspruchsvoll: deutlich höhere Genauigkeit bei kleinen Objekten bei gleicher oder geringerer Anzahl lernbarer Parameter und akzeptabler Geschwindigkeit auf Edge-Hardware.

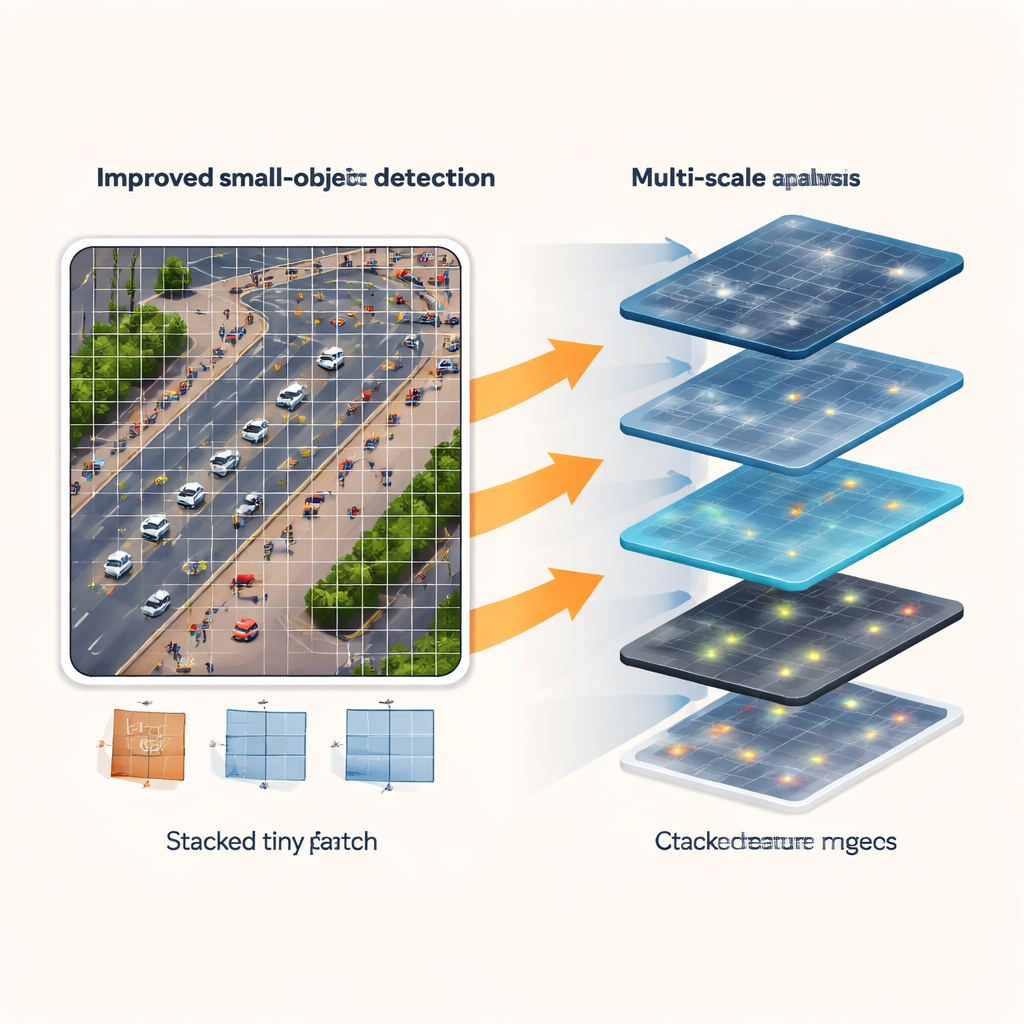

Aus der Szene auf vielen Skalen lernen

Die erste Verbesserung betrifft, wie das Netzwerk die Szene »sieht«. Anstatt durch ein einzelnes Fenster fester Größe zu blicken, beobachtet das neue Multiscale Edge-Feature Adaptive Selection (MSEAF)-Modul das Bild gleichzeitig auf mehreren Skalen. Grobe Ansichten erfassen das übergeordnete Layout von Straßen, Gebäuden und Menschenmengen, während feinere Ansichten einzelne Autos oder Personen verfolgen. Ein Kantenschärfungs-Schritt betont Grenzen und Formen, die für Menschen leicht erkennbar sind, aber in winzigen Bildausschnitten oft verloren gehen. Ein intelligenter Fusionsmechanismus verstärkt dann die informativsten Regionen und unterdrückt Hintergrundrauschen. Diese multiskalige, kantenbewusste Darstellung liefert dem restlichen Netzwerk einen reichhaltigeren Ausgangspunkt, um schwer sichtbare Objekte zu finden.

Feine Objekte durch die Pipeline hinweg erhalten

Konventionelle YOLO-Netze verkleinern Feature-Maps wiederholt, wenn die Information vom Eingang zum Ausgang fließt. Für große Objekte ist das unproblematisch, für winzige kann es jedoch fatal sein: Nach mehreren Downsampling-Schritten belegt eine Person im internen Feature-Map vielleicht nur noch ein oder zwei Pixel oder verschwindet ganz. Um das zu verhindern, formen die Autoren den mittleren »Neck«-Teil des Netzwerks um und fügen einen neuen P2-Detektionskopf hinzu, der auf höher aufgelösten Merkmalen arbeitet. Eigene Module namens ScalCat und Scal3DC kombinieren Informationen aus verschiedenen Schichten so, dass feine Details aus flacheren Layern und reichere Zusammenhänge aus tieferen Layern sich gegenseitig verstärken. Das Ergebnis ist ein Detektor, der kleine Autos und Personen über mehrere Skalen hinweg verfolgt, statt sie zugunsten der Geschwindigkeit aufzugeben.

Schärfere Entscheidungen mit weniger Parametern

Der abschließende Schritt strafft die Vorhersagestufe, den sogenannten Detection Head. Im Originaldesign widmeten sich tiefere Layer mit vielen Kanälen überwiegend großen Objekten, die in Drohnenszenen relativ selten sind. Der neue Shared Re-parameterized Detection (SRepD)-Kopf gleicht die Kanalanzahl über die Skalen aus und nutzt einen cleveren Trainingstrick: Während des Trainings erkunden mehrere spezialisierte Faltungszweige verschiedene Möglichkeiten, Merkmale hervorzuheben; zur Inferenzzeit werden diese Zweige mathematisch zu einer einzigen, einfachen Faltung zusammengeführt. Dieses geteilte, re-parametrisierte Design verbessert die Merkmalsfusion und reduziert gleichzeitig die Anzahl der Parameter, wobei die Berechnungen für Edge-Geräte handhabbar bleiben.

Was die Zahlen in realen Tests sagen

Das verbesserte Modell wurde auf drei herausfordernden öffentlichen Datensätzen getestet: VisDrone2019 (gemischte urbane Szenen), TinyPerson (extrem kleine Personen über Land und Meer) und HazyDet (Fahrzeuge in starkem Dunst aus Drohnenperspektive). Auf VisDrone2019 steigert das neue Design eine wichtige Genauigkeitskennzahl (mAP50) und die Präzision um 4,6 Prozentpunkte gegenüber dem ursprünglichen YOLOv11n, während die Parameterzahl um etwa 8,5 Prozent sinkt. Bei TinyPerson sind die Verbesserungen noch größer – etwa 5,9 Prozentpunkte in mAP50 und 5,6 in der Präzision – bei ähnlicher Reduktion der Parameter, und das kompakte Modell übertrifft sogar ein deutlich größeres YOLOv11s, das viermal so viele Parameter nutzt. Unter dunstigen Bedingungen übertrifft der aufgerüstete Detektor ebenfalls die Ausgangsbasis in Genauigkeit und Robustheit, und das bei Echtzeitgeschwindigkeit auf einem energieeffizienten Huawei Atlas 200 DK Edge-Board.

Warum das für den täglichen Drohneneinsatz wichtig ist

Für Nicht-Fachleute ist die Kernaussage: Diese Arbeit zeigt, dass Drohnen gleichzeitig schärfer sehen und ressourceneffizienter werden können. Indem die Autoren überdenken, wo und wie das Netzwerk nach Details sucht, hochauflösende Informationen für winzige Ziele bewahren und die Vorhersageeinheit vereinfachen, durchbrechen sie den üblichen Zielkonflikt zwischen Genauigkeit und Modellgröße. Das resultierende System ist besser darin, kleine, entfernte Personen und Fahrzeuge in überfüllten, dunstigen oder komplexen Szenen zu erkennen, ohne sperrige Hardware zu verlangen. Solche Fortschritte rücken zuverlässige, echtzeitfähige Luftüberwachung für Verkehrssicherheit, Suche und Rettung sowie Umweltbeobachtung näher an den Alltagsbetrieb.

Zitation: Zhu, H., Xie, X. Enhanced YOLOv11n for small object detection in UAV imagery: higher accuracy with fewer parameters. Sci Rep 16, 5536 (2026). https://doi.org/10.1038/s41598-026-35301-2

Schlüsselwörter: Objekterkennung mit Drohnen, Erkennung kleiner Objekte, YOLO-Neuronales Netzwerk, Luftbildanalyse, Edge-AI für UAVs