Clear Sky Science · de

Automatische Segmentierung und Klassifizierung mittels Deep Learning zur Erkennung von Brusthalskrebs mithilfe eines verbesserten U-Net und Ensemble‑Methoden

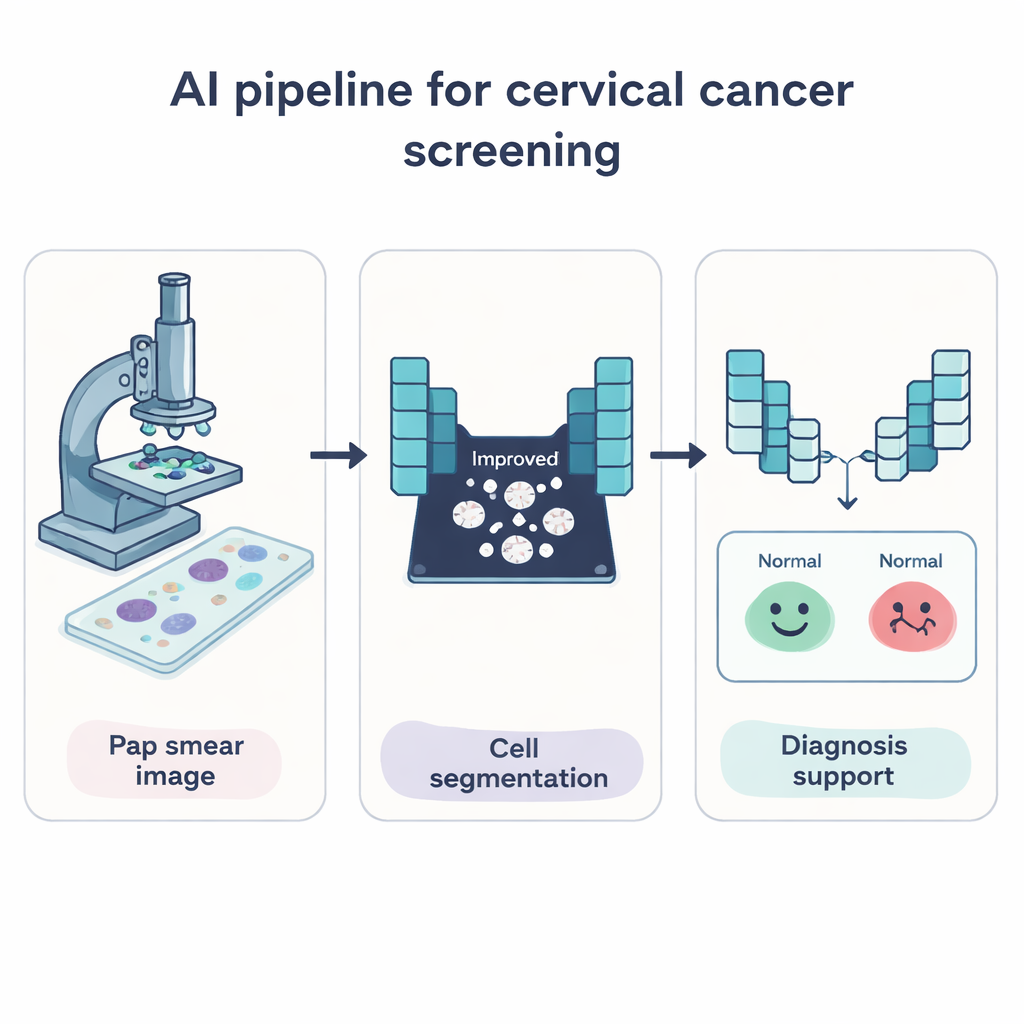

Warum Pap-Tests noch digitale Unterstützung brauchen

Gebärmutterhalskrebs gehört zu den wenigen Krebsarten, die bei frühzeitiger Erkennung gut vermeidbar sind, dennoch sterben viele Frauen, weil gefährliche Zellveränderungen übersehen oder zu spät entdeckt werden. Der vertraute Pap-Test rettet bereits Leben, doch das manuelle Auswerten tausender Zellbilder ist langsame, ermüdende Arbeit, bei der selbst Expertinnen und Experten zu unterschiedlichen Einschätzungen kommen können. Diese Arbeit untersucht, wie moderne künstliche Intelligenz als unermüdliche Assistenz dienen kann, indem sie Zellen auf Pap‑Abstrichbildern automatisch findet und klassifiziert, sodass Ärztinnen und Ärzte frühe Warnzeichen schneller und zuverlässiger erkennen können.

Computern beibringen, auffällige Zellen zu erkennen

Die Forschenden entwickelten ein System, das zwei zentrale Aufgaben erledigt: erstens jede Zelle auf einem Pap‑Abstrichbild vom Hintergrund abzugrenzen, und zweitens zu entscheiden, ob die Zelle normal aussieht oder Zeichen aufweist, die mit Krebs in Verbindung stehen. Dafür setzten sie Deep Learning ein, eine Form der KI, die Muster direkt aus zahlreichen Beispielbildern lernt statt aus handgeschriebenen Regeln. Ihr System konzentriert sich auf die gesamte Zelle—sowohl den dunklen Kern (Nukleus) als auch das umgebende Material (Zytoplasma)—weil Änderungen in Größe, Form und Textur über die ganze Zelle hinweg auf Erkrankungen hinweisen können.

Ein intelligenterer Weg, Zellen zu umreißen

Im Zentrum des Systems steht eine verbesserte Variante eines verbreiteten medizinischen Bildmodells namens U‑Net, das besonders gut darin ist, präzise Konturen von Objekten in Bildern zu zeichnen. Die Autorinnen und Autoren modifizierten U‑Net so, dass es Bilddetails gleichzeitig auf mehreren Skalen betrachten kann und stabil bleibt, auch wenn es mit kleinen Datenpaketen trainiert wird—eine häufige Einschränkung in der Medizin. Dieses aufgerüstete Netzwerk lernt, über jedes Bild eine einfache Maske zu legen: weiß, wo eine Zelle vorhanden ist, schwarz für den Hintergrund. Indem nur die Zellbereiche isoliert werden, können spätere Schritte der Pipeline sich auf das Wesentliche konzentrieren, statt von Färbungen, Schmutz oder leerem Raum abgelenkt zu werden.

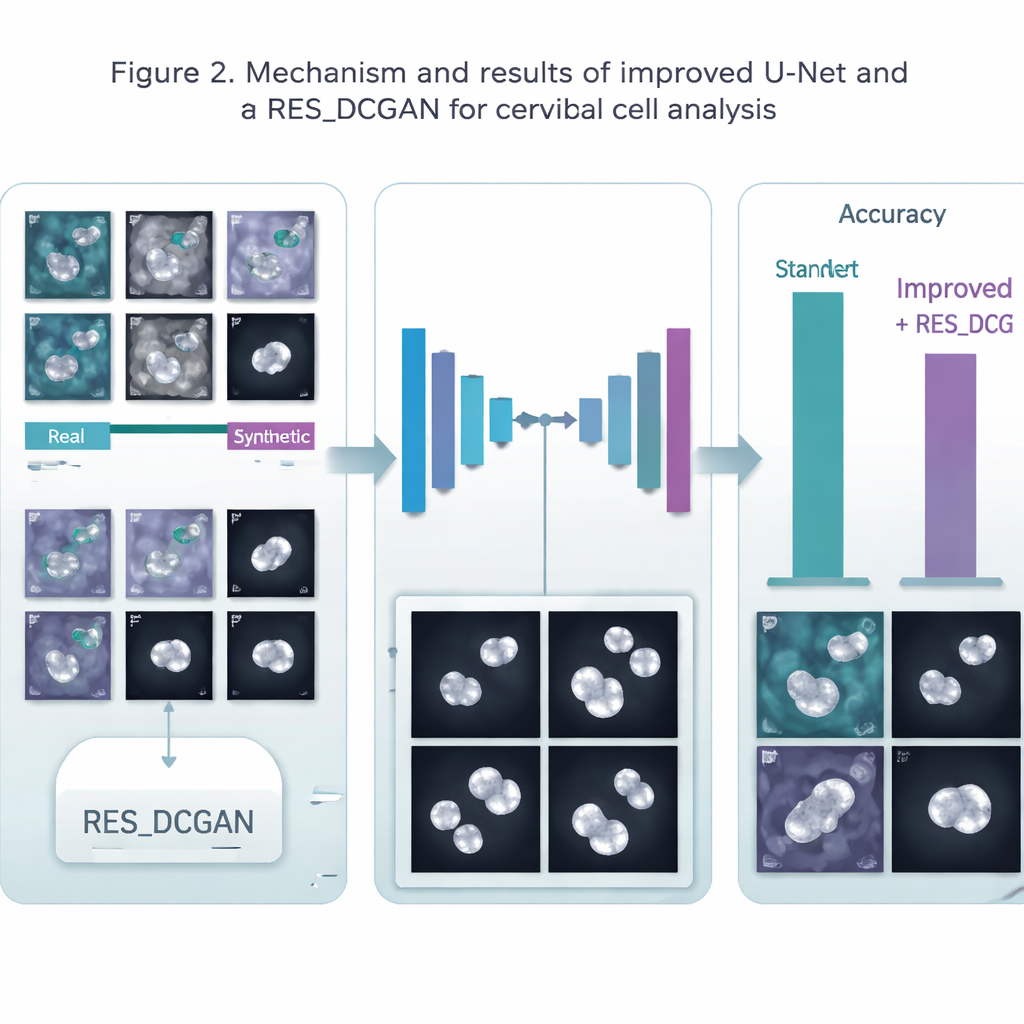

Mehr Trainingsbeispiele aus dem Nichts erzeugen

Ein großes Problem in der Medizin ist, dass qualitativ hochwertige, gelabelte Bilder knapp und teuer sind. Zur Bewältigung dieses Problems verwendete das Team ein generatives Modell namens RES_DCGAN, das lernt, realistische synthetische Pap‑Abstrichbilder auf Basis der echten Bilder zu erzeugen. Diese zusätzlichen „erfundenen, aber überzeugenden“ Bilder werden in den Trainingsprozess eingemischt—sowohl vor dem Segmentierungsschritt als auch danach im Klassifizierungsschritt. Durch das Sehen vieler weiterer Zellvariationen—einschließlich seltener und subtiler Muster—wird die KI robuster und neigt weniger dazu, sich an eine kleine Patientengruppe oder spezifische Aufnahmebedingungen übermäßig anzupassen.

Von Umrissen zu Frühwarnungen

Sobald die Zellen segmentiert sind, übernimmt eine zweite Gruppe von Deep‑Learning‑Modellen die Klassifizierung jeder Zelle als normal oder als zu verschiedenen abnormen Kategorien gehörend. Die Autorinnen und Autoren nutzten ein leistungsfähiges Bilderkennungsmodell namens ResNet50V2 und kombinierten es mit mehreren anderen bekannten Netzwerken in einem „Ensemble“, bei dem mehrere Modelle über die endgültige Entscheidung abstimmen. Sie testeten sechs verschiedene Verarbeitungspipelines an drei Datensätzen aus Polen (Pomeranian), Dänemark (Herlev) und Griechenland (SIPaKMeD) und deckten dabei sowohl einfache Normal‑gegen‑Abnormal‑Fälle als auch detailliertere Mehrklassenprobleme ab. In diesen Tests verbesserte die Segmentierung der Zellen vor der Klassifizierung durchweg die Genauigkeit, und das Hinzufügen synthetischer Bilder steigerte die Leistung im Allgemeinen noch etwas, besonders beim Umreißen der Zellen.

Wie gut schlug sich die digitale Assistenz?

Das System erzielte sehr hohe Werte. Bei der Zellsegmentierung erreichte die Genauigkeit in einem Datensatz etwa 99,5 % und in einem anderen rund 98 %, und übertraf damit deutlich ein Standard‑U‑Net. Bei der Bestimmung des Zelltyps klassifizierte das Ensemble in den komplexeren Aufgaben ungefähr 95–96 % der Zellen korrekt und erreichte in einfacheren Ja/Nein‑Krebsrisiko‑Entscheidungen bis zu 99 %. Diese Ergebnisse entsprechen oder übertreffen viele frühere Studien und zeigen zudem, dass eine einheitliche Pipeline über unterschiedliche Labore und Datenquellen hinweg funktionieren kann. Die Verbesserungen waren in einem besonders heterogenen Datensatz moderater, was hervorhebt, dass die Vielfalt realer Daten weiterhin Herausforderungen darstellt.

Was das für Patientinnen und Ärztinnen bedeutet

Praktisch bedeutet diese Arbeit, dass eine KI‑Assistenz lernen kann, Gebärmutterhalszellen sorgfältig nachzuzeichnen und sie mit bemerkenswerter Konsistenz in Risikogruppen einzusortieren. Sie ersetzt die Pathologin oder den Pathologen nicht, kann aber Vorsortierungen durchführen, verdächtige Zellen hervorheben und das Risiko verringern, dass frühe Anzeichen in überlasteten Kliniken oder Regionen mit wenigen Spezialistinnen und Spezialisten übersehen werden. Mit weiteren Prüfungen an größeren, komplexeren Stichproben und von Expertinnen und Experten validierten Masken könnten solche Systeme dazu beitragen, zuverlässiges Screening auf Gebärmutterhalskrebs weltweit mehr Frauen zugänglich zu machen, gefährliche Veränderungen früher zu erkennen und die Erfolgschancen einer Behandlung zu verbessern.

Zitation: Wubineh, B.Z., Rusiecki, A. & Halawa, K. Deep learning-based automatic segmentation and classification for cervical cancer detection using an improved U-Net and ensemble methods. Sci Rep 16, 5184 (2026). https://doi.org/10.1038/s41598-026-35299-7

Schlüsselwörter: Brusthalskrebs-Screening, Pap-Abstrich‑Bilder, Deep Learning, medizinische Bildsegmentierung, computerunterstützte Diagnose