Clear Sky Science · de

Attention-verbesserte MobileNetV2-Modelle für robuste Waldbrand-Erkennung und -Klassifizierung

Warum schnellere Feuerwarnungen wichtig sind

Weltweit werden Waldbrände heißer, größer und teurer zu bekämpfen. Minuten können den Unterschied ausmachen zwischen einem kleinen, eindämmbaren Brand und einer regionalen Katastrophe, die Ökosysteme schädigt, Städte mit Rauch füllt und Milliarden kostet. Diese Studie untersucht, wie kompakte Künstliche-Intelligenz-(KI)-Modelle die allerersten Anzeichen von Waldbränden in normalen Bildern und Videos erkennen können — schnell genug, um auf Drohnen, Überwachungskameras und energiearmen Sensoren zu laufen, die in gefährdeten Landschaften verteilt sind.

Den Wald mit smarten Kameras überwachen

Traditionelle Feuerwachtürme und menschliche Beobachter, die Live-Video überwachen, kommen bei weiten Waldflächen besonders nachts oder bei rauchigen, dunstigen Bedingungen an ihre Grenzen. Die Autoren gehen das Problem an, indem sie die Waldbrand-Erkennung auf eine einfache Ja‑/Nein‑Frage reduzieren: Enthält dieses Bild Feuer oder nicht? Sie stellen eine ausgewogene Sammlung von 5.121 Bildern zusammen, die sowohl Brand- als auch Nicht‑Brand‑Szenen aus Wäldern, Städten und Industrieanlagen zeigen und bei Tageslicht, nachts sowie durch Rauch oder Nebel aufgenommen wurden. Durch sorgfältiges Ausbalancieren des Datensatzes und manuelle Überprüfung der Labels wollen sie KI‑Systeme lehren, wie echte Flammen in der Natur aussehen — nicht nur in idealen Laborbeispielen.

Schlanke KI für den Feldeinsatz

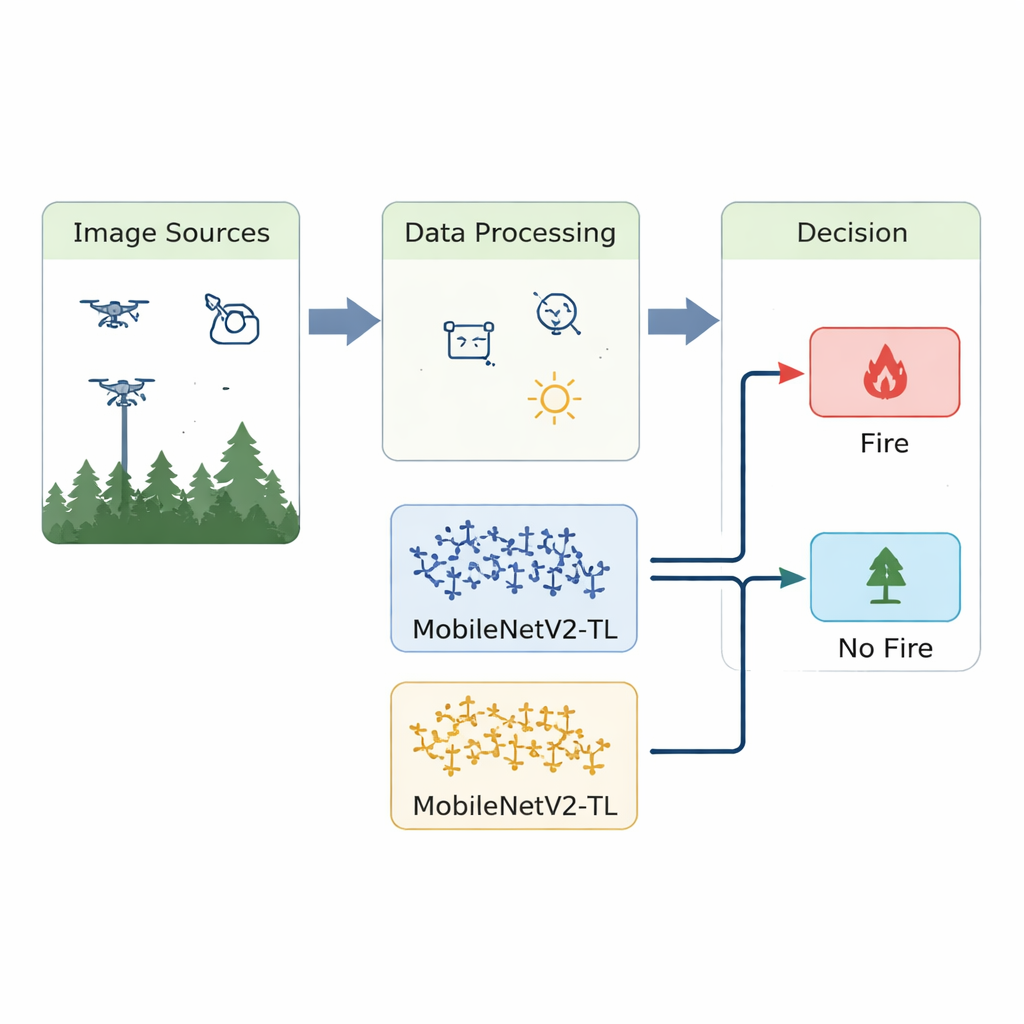

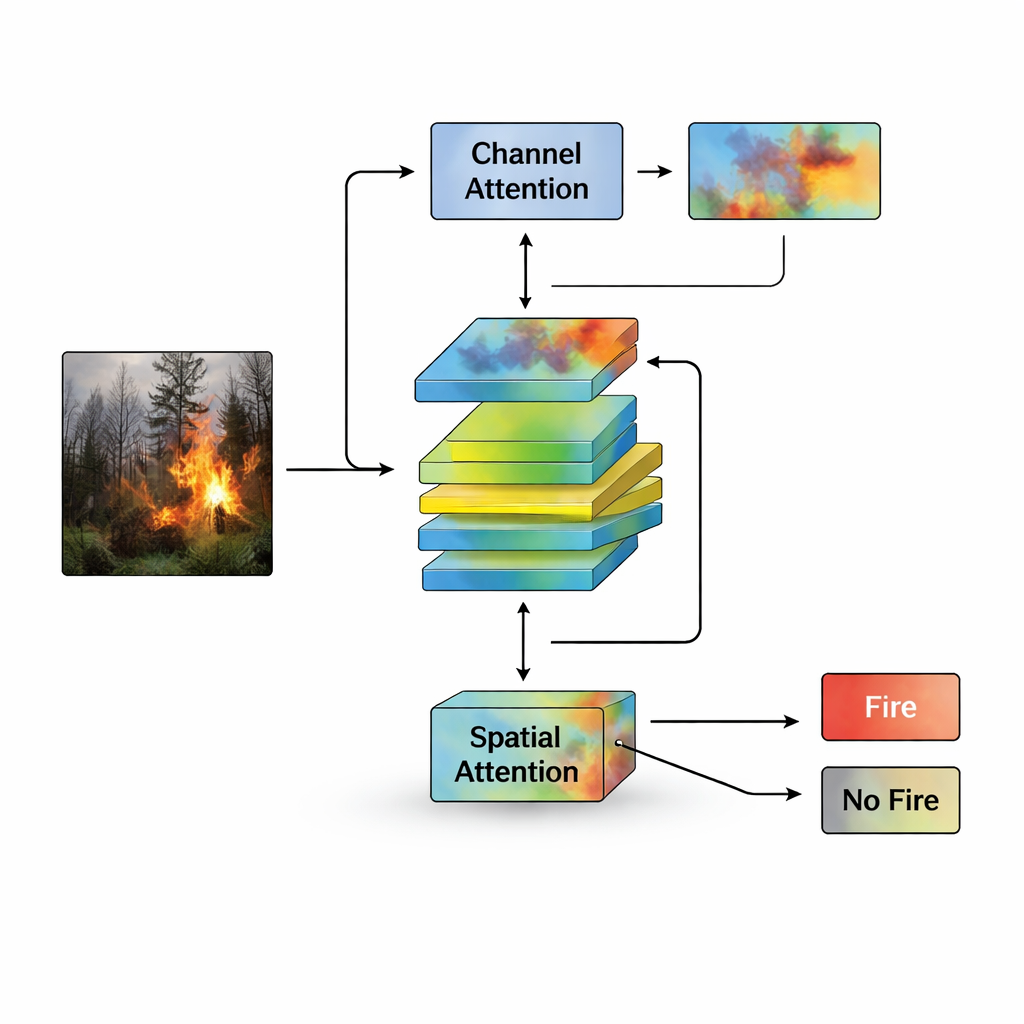

Viele leistungsfähige Bilderkennungssysteme sind zu ressourcenintensiv, um auf den kleinen Computern in Drohnen oder kostengünstigen Überwachungskameras zu laufen. Um dieses Problem zu vermeiden, baut die Studie auf MobileNetV2 auf, einer Familie von neuronalen Netzen, die auf Geschwindigkeit und geringen Speicherbedarf ausgelegt ist. Das erste Modell, Att-MobileNetV2, ergänzt einen "Attention"-Mechanismus, der dem Netzwerk hilft, sich auf charakteristische Flammenfarben, -texturen und -kanten zu konzentrieren und Ablenkungen wie sonnenbeschienene Wolken oder helle Gebäudebeleuchtung zu ignorieren. Das zweite Modell, MobileNetV2-TL, setzt auf Transfer Learning: Es nutzt visuelle Fähigkeiten, die aus Millionen allgemeiner Fotos gelernt wurden, wieder und trainiert nur einen kleinen, auf die Aufgabe zugeschnittenen Kopf für Feuer vs. Nicht‑Feuer, wodurch Verarbeitungszeit und Energieverbrauch gering bleiben.

Training für harte reale Bedingungen

Um die unordentlichen Bedingungen der echten Brandüberwachung nachzuahmen, tun die Forscher mehr als nur unterschiedliche Bilder sammeln. Sie wenden kontrollierte Modifikationen an jedem Trainingsbild an — etwa leichte Drehungen, Spiegelungen sowie Änderungen von Helligkeit oder Kontrast — um verschiedene Kamerawinkel und Beleuchtungsszenarien zu simulieren. Beide Modelle werden dann nach denselben Regeln trainiert und bewertet, mit standardisierten Messgrößen wie Genauigkeit, Präzision und Recall und indem geprüft wird, wie oft sie Brände übersehen oder Fehlalarme auslösen. Att-MobileNetV2 erreicht eine Genauigkeit von etwa 99,6 %, während MobileNetV2-TL rund 98,4 % erreicht. Entscheidend ist, dass diese Ergebnisse mit nur wenigen Millionen Parametern und einem Bruchteil einer Milliarde Operationen pro Bild erzielt werden, sodass Entscheidungen in nur 10–12 Millisekunden auf einer einzelnen Grafikkarte möglich sind.

Leistung größerer Systeme mit weniger Ressourcen übertreffen

Die beiden kompakten Modelle werden sowohl klassischen Machine‑Learning‑Methoden als auch komplexeren tiefen Netzwerken gegenübergestellt. Unter identischen Trainings‑ und Testbedingungen bietet Att-MobileNetV2 die beste Gesamtausgewogenheit zwischen korrekten Feuererkennungen und korrekten „Gefahr frei“-Entscheidungen, während MobileNetV2-TL besonders hohen Recall erzielt, was bedeutet, dass tatsächliche Brände selten übersehen werden — eine wichtige Eigenschaft für Frühwarnsysteme. Ein Ensemble, das beide Modelle kombiniert, schneidet sogar noch leicht besser ab, was darauf hindeutet, dass die Arten, wie sie eine Szene „sehen“, komplementär sind. Tests an einem unabhängigen öffentlichen Datensatz zeigen, dass die Modelle auch bei neuen Bildern starke Leistungen erbringen, was auf eine gute Generalisierung über die spezifischen Trainingsbilder hinaus hinweist.

Was das für die künftige Brandsicherheit bedeutet

Einfach gesagt zeigt diese Arbeit, dass kleine, effiziente KI‑Modelle Waldbrände früh und zuverlässig erkennen können, selbst wenn sie auf bescheidener Hardware auf Drohnen, Türmen oder Straßenrandkameras laufen. Durch den Einsatz von Attention, um sich auf die richtigen Bildbereiche zu konzentrieren, und Transfer Learning, um zuvor erworbenes visuelles Wissen wiederzuverwenden, erreichen die vorgeschlagenen Systeme eine Genauigkeit, die mit deutlich größeren Modellen konkurriert oder sie übertrifft. Obwohl in dichtem Nebel weiterhin Herausforderungen bestehen, weist der Ansatz in Richtung Netzwerke intelligenter, erschwinglicher Sensoren, die Warnungen früher auslösen könnten, damit Einsatzkräfte schneller reagieren und kleine Funken womöglich daran gehindert werden, in katastrophale Waldbrände überzugehen.

Zitation: Ul Haq, I., Husnain, G., Iqbal, A. et al. Attention-enhanced MobileNetV2 models for robust forest fire detection and classification. Sci Rep 16, 4805 (2026). https://doi.org/10.1038/s41598-026-35207-z

Schlüsselwörter: Waldbrand-Erkennung, Überwachung von Waldbränden, Deep Learning, Edge-AI, Computer Vision