Clear Sky Science · de

Verfolgung sich entwickelnder Gemeinschaften in Fake-News-Kaskaden mithilfe temporaler Graphen

Warum sich Gerüchte online in engen Gruppen verbreiten

Wenn falsche Geschichten sich in sozialen Medien schnell verbreiten, reisen sie selten allein. Stattdessen werden sie von Clustern von Nutzern vorangetrieben, geteilt und wiederholt, die gemeinsam agieren. Diese Studie stellt eine einfache, aber drängende Frage: Können wir nachverfolgen, wie sich diese Online-Gruppen im Zeitverlauf bilden und verändern, und dieses Wissen nutzen, um die Ausbreitung von Fake News zu verlangsamen — ohne überhaupt den Inhalt der Beiträge zu lesen?

Den Pfaden irreführender Geschichten folgen

Die Forschenden konzentrieren sich auf „Informationskaskaden“ auf Plattformen wie Twitter — Ketten von Retweets und Antworten, die sich nach dem Auftauchen einer Geschichte entfalten. Anstatt Nutzer als isolierte Individuen zu betrachten, schauen sie darauf, wie sich Menschen in Gemeinschaften zusammenfinden, während ein Gerücht sich ausbreitet. Diese Gemeinschaften können engagierte Förderer der falschen Geschichte, skeptische Kommentatoren oder gewöhnliche Zuschauer sein, die mitgerissen werden. Die Herausforderung besteht darin, dass sich Online-Mengen ständig verändern: Menschen kommen und gehen, Gespräche spalten sich oder verschmelzen, und die Struktur des Netzwerks verschiebt sich von Stunde zu Stunde.

Ein schrittweises Framework zur Verfolgung von Gemeinschaften

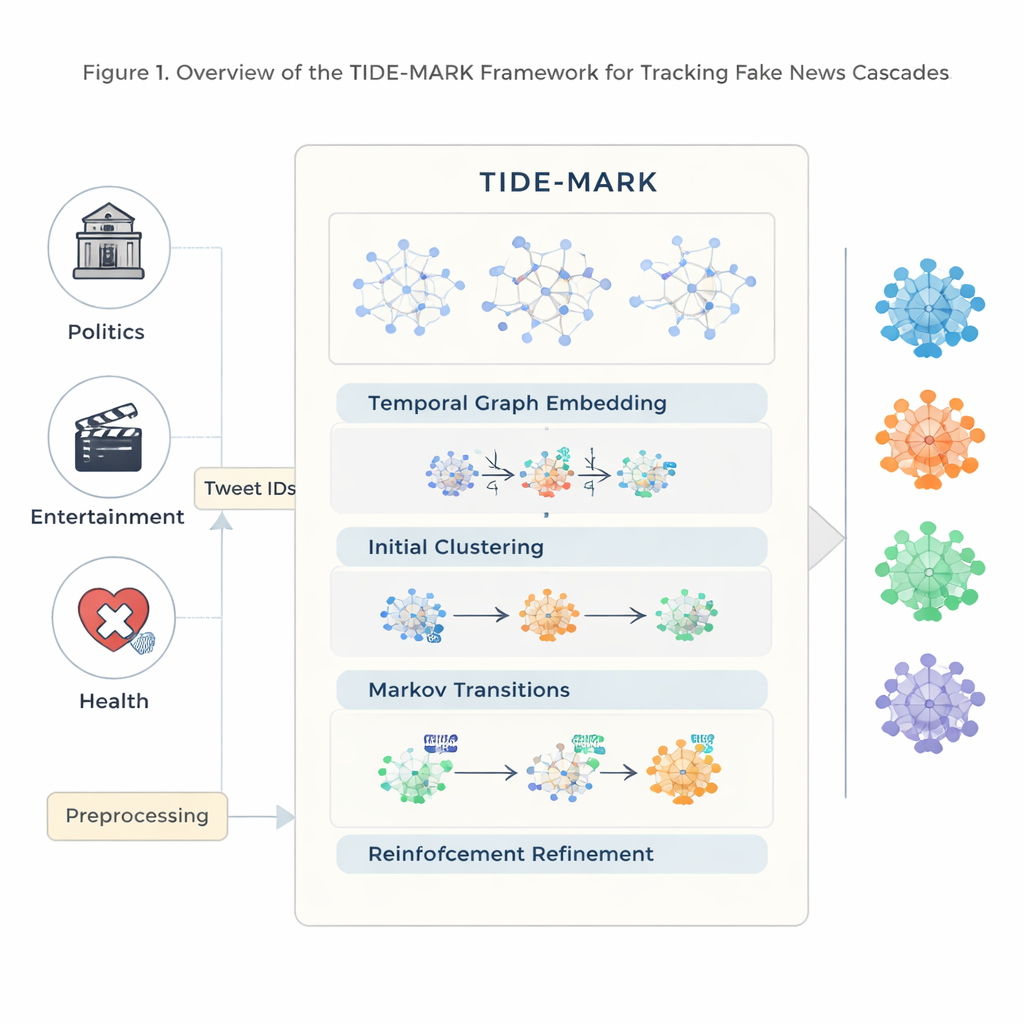

Um dem zu begegnen, stellen die Autoren TIDE-MARK vor, ein mehrstufiges Framework, das entwickelt wurde, um sich entwickelnde Nutzergemeinschaften über die Zeit zu verfolgen. Zuerst rekonstruieren sie jede Kaskade aus rohen Tweet-IDs und wandeln sie in eine Reihe stündlicher Schnappschüsse um, in denen Knoten Nutzer und Verbindungen Retweets oder Antworten darstellen. Sie ergänzen jeden Nutzer um einfache Profilinformationen und eine numerische Zusammenfassung der geteilten Tweets. Anschließend lernt ein zeitbewusstes neuronales Netzwerk, wie sich die Verbindungen und das Verhalten jedes Nutzers über die Schnappschüsse hinweg ändern, und erzeugt ein kompaktes „Fingerprint“ für jeden Nutzer in jeder Stunde.

Aus unscharfen Massen werden stabile Gruppen

Mithilfe dieser Fingerprints gruppiert TIDE-MARK ähnliche Nutzer zu vorläufigen Communities. Danach modelliert es, wie sich Communities von einem Schnappschuss zum nächsten verändern, und schätzt ab, wie wahrscheinlich es ist, dass Mitglieder einer Gruppe zusammenbleiben, sich aufspalten oder einer anderen Gruppe anschließen. Schließlich bereinigt ein Verstärkungslern-Modul die unscharfen Grenzen zwischen Gruppen. Es testet wiederholt kleine Änderungen — etwa einzelne Nutzer von einer Community in eine andere zu verschieben — und behält die Änderungen bei, die Gruppen innerlich stärker verbinden, während sie mit früheren Zeitpunkten konsistent bleiben. Das Ergebnis ist ein klareres, stabileres Bild darüber, wer mit wem koordiniert, während sich die Kaskade entfaltet.

Wie Fake- und echte News-Gemeinschaften aussehen

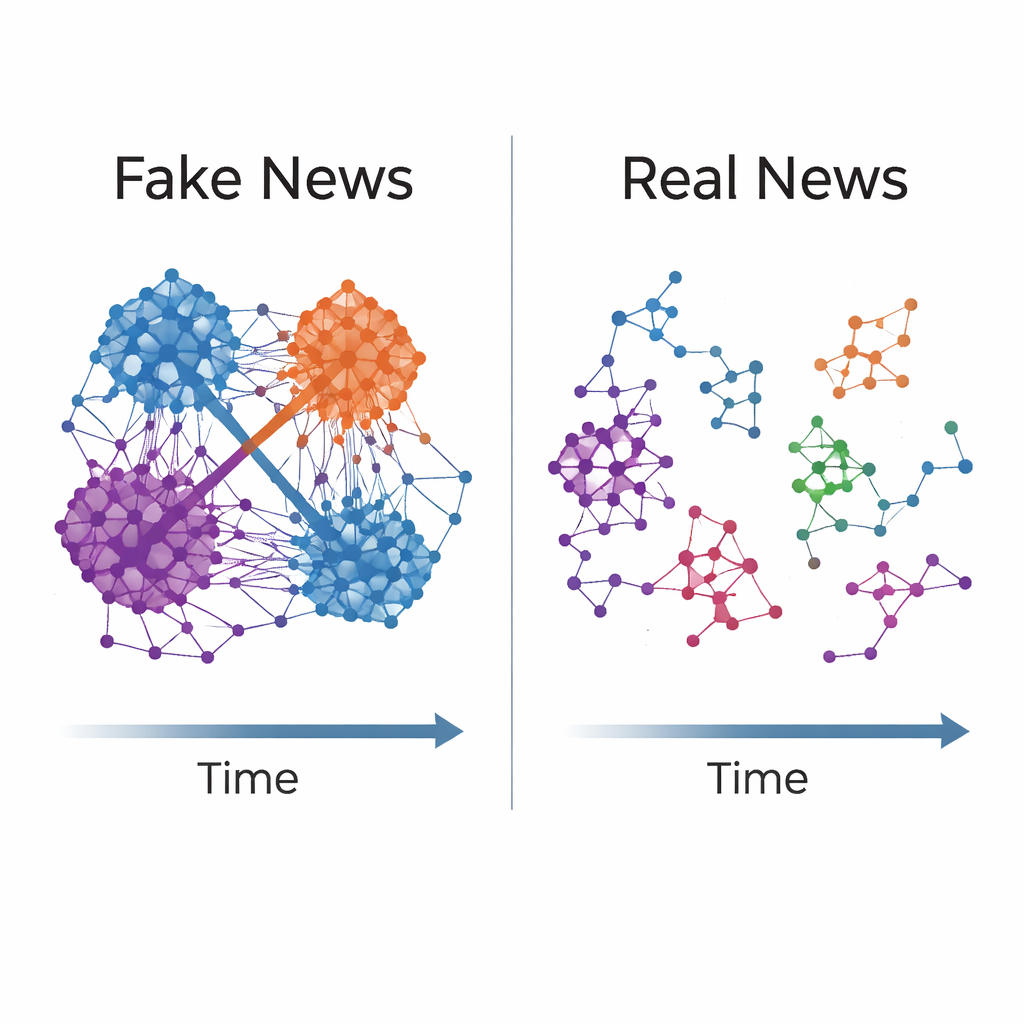

Das Team wendet TIDE-MARK auf drei große Fake-News-Datensätze an, die Politik, Promi-Klatsch und COVID-19-Gesundheitsinformationen abdecken. In allen Fällen finden sie dasselbe Muster: Falsche Geschichten tendieren dazu, durch engere, beständigere Gemeinschaften als wahre Geschichten zu fließen. Diese Fake-News-Gruppen sind intern dichter vernetzt, haben schärfere Abgrenzungen zum Rest des Netzwerks und behalten über die Zeit hinweg ungefähr die gleiche Mitgliederstruktur. Echte Nachrichten hingegen verbreiten sich durch lockerere, verstreute Gruppen, die sich neu konfigurieren, wenn sich die Diskussionen weiterentwickeln. Bemerkenswerterweise sind die strukturellen Merkmale, die TIDE-MARK extrahiert — wie kohärent und stabil Gemeinschaften sind — stark genug, um einfachen Klassifikatoren zu helfen, Fake- von echten Kaskaden zu unterscheiden, selbst ohne den Text zu betrachten.

Testen von Methoden zur Unterbrechung schädlicher Kaskaden

Da TIDE-MARK eine Sicht auf Gemeinschaftsebene liefert, kann es auch zur Simulation von Interventionen genutzt werden. Die Forschenden testen, was passiert, wenn man früh in einer Fake-News-Kaskade nur wenige hochgradig vernetzte Nutzer aus der beständigsten Community entfernt — ein idealisiertes Pendant zu Kontosperrungen oder Reichweitenbegrenzungen. In Simulationen schwächt dieses gezielte Entfernen die Struktur der Kaskade deutlich und verkleinert ihren größten verbundenen Cluster, was darauf hindeutet, dass strukturorientierte, inhaltsneutrale Strategien die Verbreitung von Fehlinformationen merklich verlangsamen könnten.

Was das für den Kampf gegen Fehlinformationen bedeutet

Alltäglich ausgedrückt zeigt diese Arbeit, dass Fake News oft durch langlebige „Fanclubs“ koordinierter Nutzer reisen, während echte Nachrichten durch fluidere Gruppen gehen. TIDE-MARK bietet eine Möglichkeit, diese Gruppen in Echtzeit zu sehen und zu verfolgen, ohne den Inhalt selbst zu lesen oder zu bewerten. Das macht es zu einem vielversprechenden Werkzeug für Plattformen, Forschende und politische Entscheidungsträger, die riskante Muster der Koordination identifizieren und sorgfältige, gezielte Interventionen entwerfen wollen — womöglich, um schädliche Kaskaden zu entschärfen, bevor sie sich voll entfalten.

Zitation: Ma, Y., Qu, D. & Wang, Y. Tracking evolving communities in fake news cascades using temporal graphs. Sci Rep 16, 4952 (2026). https://doi.org/10.1038/s41598-026-35175-4

Schlüsselwörter: Fake News, soziale Netzwerke, Community-Erkennung, Verbreitung von Fehlinformationen, Moderation sozialer Medien