Clear Sky Science · de

Energie- und Makespan-optimierte Aufgabenverteilung in fog-fähigen IoT-Anwendungen: ein hybrider Ansatz

Warum klügere Clouds für Alltagsgeräte wichtig sind

Von Fitness-Trackern und intelligenten Thermostaten bis zu vernetzten Autos und Krankenhausmonitoren senden Milliarden von Geräten ständig Daten, die irgendwo im Internet verarbeitet werden müssen. Wenn dieses „irgendwo“ ein weit entferntes Cloud-Rechenzentrum ist, können die Entfernungen Verzögerungen verursachen und Energie verschwenden. Dieses Papier untersucht einen neuen Ansatz zur Entscheidung, wo diese digitalen Aufgaben ausgeführt werden sollten, damit vernetzte Geräte schnell Antworten erhalten und das Gesamtsystem weniger Strom verbraucht.

Die Cloud näher an die reale Welt bringen

Das heutige Internet der Dinge (IoT) verlässt sich oft auf riesige Cloud-Rechenzentren, um Informationen zu speichern und zu analysieren. Das funktioniert gut für viele Fälle, doch nicht für Aktivitäten, die blitzschnelle Reaktionen erfordern – etwa autonomes Fahren, Online-Gaming oder Fernüberwachung der Gesundheit – bei denen schon kleine Verzögerungen schädlich oder lästig sein können. Um dem zu begegnen, setzen Ingenieure zunehmend auf „Fog Computing“, bei dem kleinere Server näher an den Orten platziert werden, an denen Daten entstehen. Die Autoren untersuchen eine Dreischichten-Architektur: ganz unten Alltagsgeräte, in der Mitte nahegelegene Fog-Knoten und oben leistungsfähige Cloud-Server. Die meisten Aufgaben sollten idealerweise in der Fog-Schicht bearbeitet werden, nur die schwersten Jobs werden in die Cloud geschickt.

Die Planungsherausforderung hinter den Kulissen

Zu entscheiden, welcher Server welche Aufgabe übernimmt, ist überraschend komplex. Jede ankommende Aufgabe hat eine Größe und eine Ankunftszeit, während jede virtuelle Maschine Grenzen bei Verarbeitungsgeschwindigkeit, Arbeitsspeicher und Netzwerkbandbreite hat. Werden Aufgaben ungünstig verteilt, stehen einige Maschinen untätig, während andere überlastet sind – das führt zu langen Wartezeiten und Energieverschwendung. Das Papier konzentriert sich gleichzeitig auf drei Ziele: alle Aufgaben so schnell wie möglich zu beenden (geringer Makespan), so wenig Energie wie möglich zu verbrauchen und die Arbeit gleichmäßig zu verteilen, damit keine Maschine zum Engpass wird. Statt nur ein Ziel zu optimieren behandeln die Autoren dies als eine kombinierte, konkurrierende Zielmenge, die sorgfältig abgewogen werden muss.

Ein schwarminspiriertes Verfahren zur Lastverteilung

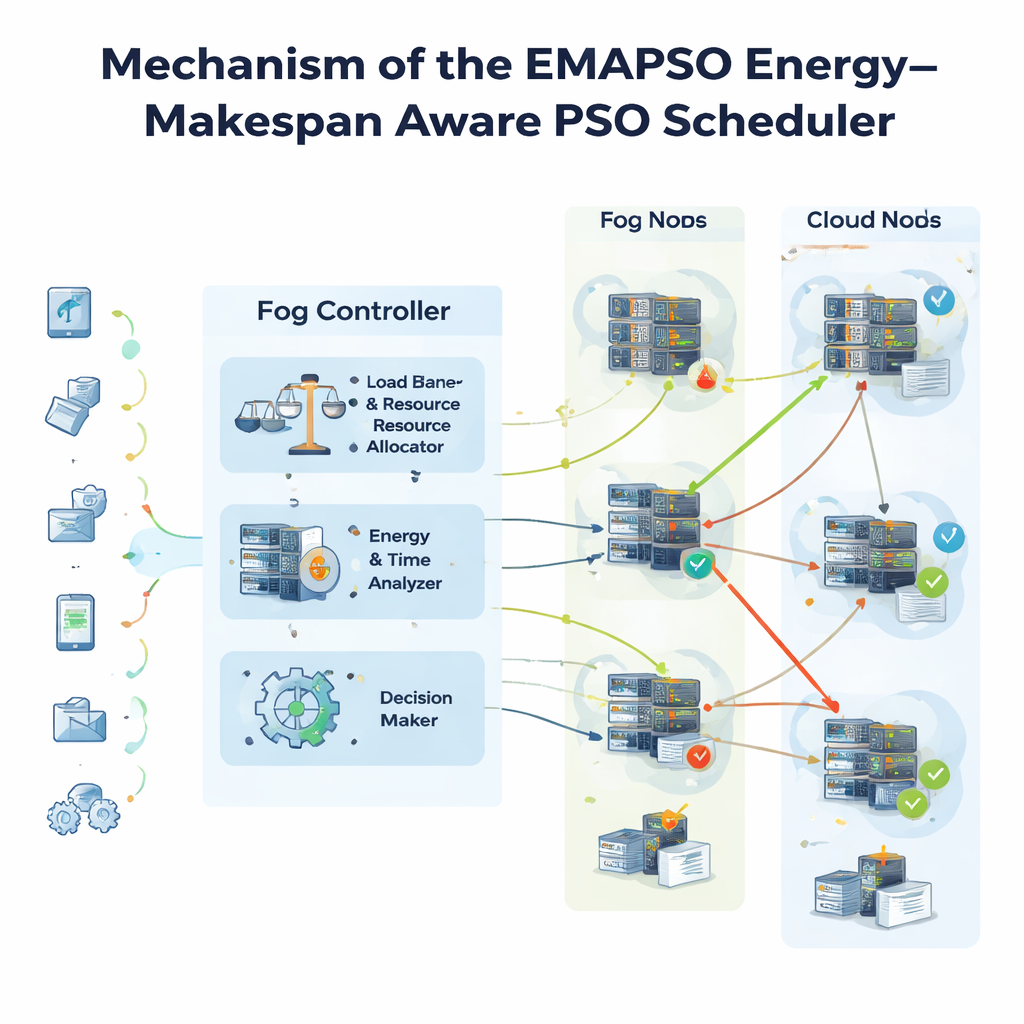

Um diese Balance zu erreichen, bauen die Forscher auf Partikelschwarmoptimierung (PSO) auf, einer Technik, die von Schwarmverhalten bei Vögeln oder Fischen inspiriert ist. Bei PSO „fliegen“ viele Kandidatenlösungen – hier verschiedene Arten, Aufgaben Maschinen zuzuweisen – durch den Lösungsraum und passen ihre Positionen anhand dessen an, was für sie selbst und ihre Nachbarn bisher am erfolgreichsten war. Die Autoren schlagen eine verbesserte Version namens EMAPSO (Energy Makespan‑Aware PSO) vor. Sie beginnt mit einer intelligenten Startlösung, die Maschinen mit den kürzesten Fertigstellungszeiten bevorzugt, und aktualisiert dann fortlaufend die Aufgabenverteilungen mithilfe einer Fitness-Bewertung, die Energieverbrauch und Gesamtabschlusszeit kombiniert. EMAPSO beobachtet außerdem die Auslastung jeder Maschine und vermeidet es, neue Arbeit an bereits stark belastete Server zu schicken.

Wie sich die neue Methode in der Praxis verhält

Das Team testete EMAPSO in einer simulierten Fog–Cloud-Umgebung und verglich es mit mehreren bestehenden Ansätzen, darunter standardmäßige PSO-Varianten und andere schwarminspirierte Algorithmen, die sich an Vogel- und Bienenverhalten orientieren. Sie variierten sowohl die Anzahl der Aufgaben als auch die Anzahl der virtuellen Maschinen, um unterschiedliche reale Bedingungen nachzubilden. In allen Tests schloss EMAPSO dieselbe Arbeitslast durchgehend schneller und mit geringerem Energieaufwand ab. In einer Versuchsreihe reduzierte es den Energieverbrauch um etwa 35 Prozent, während die Abschlusszeiten der Jobs konkurrenzfähig oder besser blieben. Statistische Tests zeigten, dass diese Verbesserungen nicht zufällig waren: Die Gewinne bei Geschwindigkeit und Energie waren über wiederholte Läufe signifikant.

Was das für die Alltags-Technologie bedeutet

Für Nicht-Fachleute ist die zentrale Botschaft: Klügere Planung im Netzwerk kann vernetzte Geräte reaktionsschneller erscheinen lassen, gleichzeitig die Stromrechnung senken und den Druck auf Rechenzentren verringern. EMAPSO bietet einen flexiblen Weg, Geschwindigkeit und Energieverbrauch gegeneinander abzuwägen – Systembetreiber können den Algorithmus so einstellen, dass er während Spitzenzeiten schnelle Reaktionen priorisiert oder bei geringem Verkehr Energieeinsparung in den Vordergrund stellt. Zwar basieren die Ergebnisse auf Simulationen, doch sie weisen auf zukünftige Fog–Cloud-Systeme hin, die automatisch Millionen winziger digitaler Aufgaben jonglieren, sodass Ihr Auto, Telefon oder medizinischer Sensor in Echtzeit reagieren kann, ohne im Hintergrund unbemerkt Energie zu verschwenden.

Zitation: Tripathy, N., Sahoo, S., Alghamdi, N.S. et al. Energy and makespan optimised task mapping in fog enabled IoT application: a hybrid approach. Sci Rep 16, 5210 (2026). https://doi.org/10.1038/s41598-026-35065-9

Schlüsselwörter: Fog Computing, Internet der Dinge, Aufgabenplanung, Energieeffizienz, Partikelschwarmoptimierung