Clear Sky Science · de

Automatisiertes Bild-Inpainting zur Restaurierung historischer Artefakte durch Hybridisierung von Transferlernen mit tiefen generativen Modellen

Warum die Wiederherstellung antiker Kunst mit KI wichtig ist

Museen und Archäologen weltweit ringen gegen die Zeit. Antike Wandmalereien, Fresken und bemalte Wände bröckeln, verblassen und reißen nach Jahrhunderten der Einwirkung von Feuchtigkeit, Verschmutzung und unsachgemäßer Behandlung. Eine manuelle Restaurierung ist langsam, teuer und manchmal irreversibel. Diese Studie stellt ein neues System der künstlichen Intelligenz vor, das beschädigte Abbildungen historischer Kunstwerke digital reparieren kann und Kuratoren sowie Forschern eine sichere Möglichkeit bietet, zu visualisieren, wie verlorene Szenen ausgesehen haben könnten, und sie für künftige Generationen zu bewahren.

Rissige Wände, fehlende Farbe und ein digitales Sicherheitsnetz

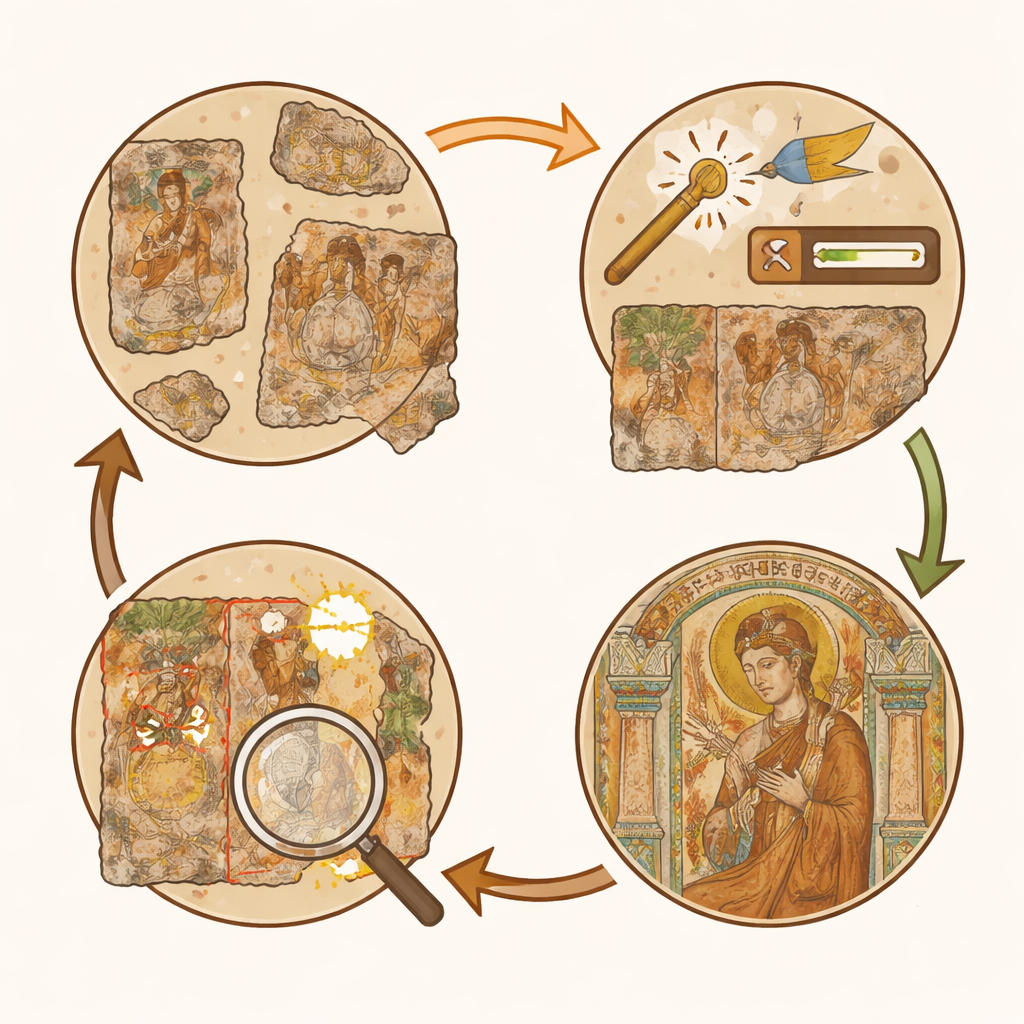

Traditionelle Restaurierung bedeutet oft, dass ein Konservator das Werk physisch retuschiert und an Stellen, an denen Farbe fehlt, neu aufträgt. Selbst bei sorgfältigem Vorgehen sind diese Eingriffe nicht leicht rückgängig zu machen und können moderne Einschätzungen einfließen lassen. Die digitale Restaurierung verfolgt einen anderen Weg: hochauflösende Fotografien beschädigter Wandmalereien werden von Algorithmen verarbeitet, die vorschlagen, wie fehlende Bereiche ausgefüllt werden könnten. Weil alles in Software geschieht, lassen sich vorgeschlagene Rekonstruktionen vergleichen, überarbeiten oder vollständig verwerfen, ohne das physische Objekt zu berühren. Die Autoren konzentrieren sich auf Wandmalereien aus Dunhuang in China — ein bekannter Komplex von Höhlentempeln, dessen Wandgemälde unter Rissen, Abblätterungen, Schimmel und großen Fehlstellen leiden. Ihr Ziel ist es, ein System zu entwickeln, das solche Bilder automatisch repariert und dabei Stil, Farben und feine Details so weit wie möglich bewahrt.

Von verrauschten Fotos zu klaren Ausgangspunkten

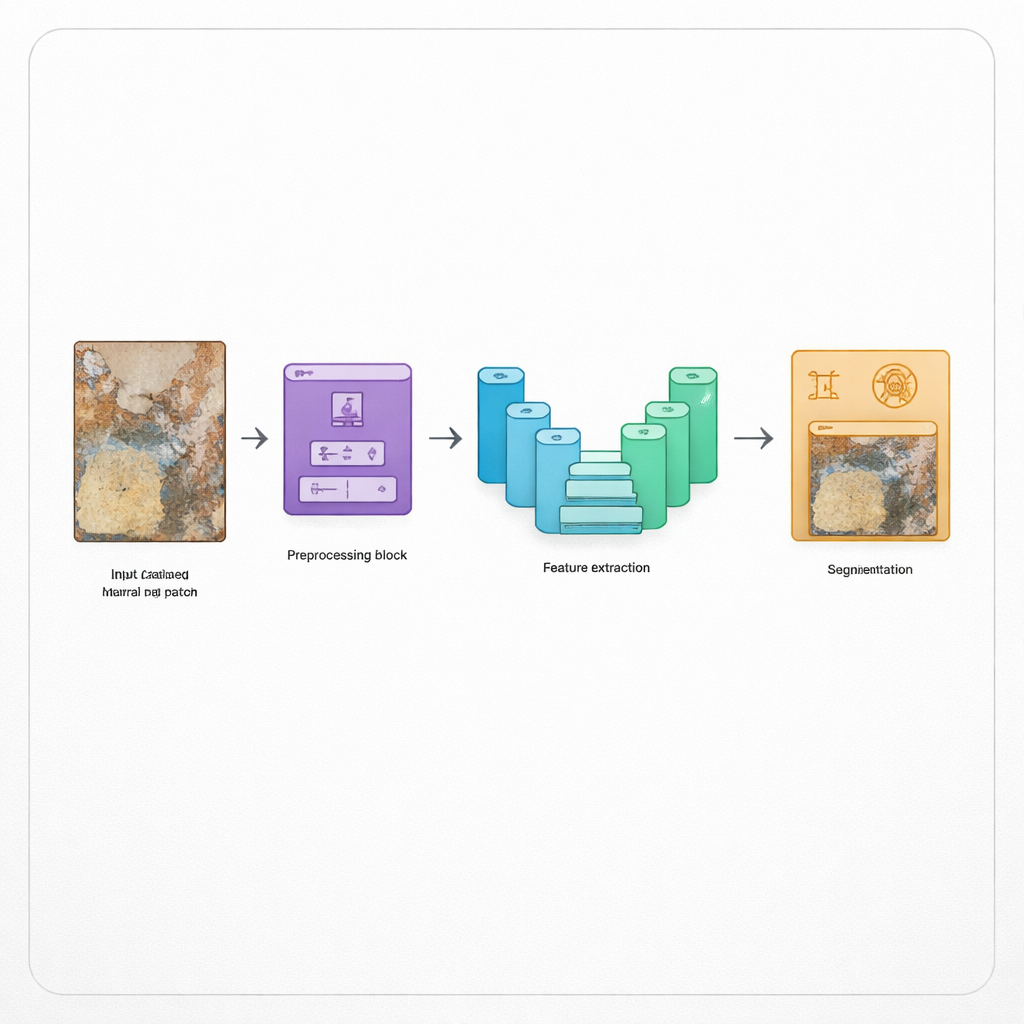

Der erste Schritt im System besteht darin, die Eingangsfotografien zu bereinigen, damit spätere Verarbeitungsschritte nicht durch Kamerarauschen oder ungünstige Beleuchtung fehlgeleitet werden. Die Methode nutzt einen adaptiven Medianfilter, eine Technik, die Sprenkel und zufällig helle oder dunkle Pixel glättet, während scharfe Kanten erhalten bleiben, etwa Konturen in einer Wandmalerei. Anschließend wird der Kontrast verstärkt, sodass schwache Linien und verblasste Farben besser erkennbar werden. Diese Anpassungen wirken wie ein behutsames Reinigen einer staubigen Linse: Sie erfinden keine neuen Inhalte, machen aber vorhandene Details sichtbarer. Durch sorgfältiges Abstimmen dieser Phase vermeiden die Autoren ein Überglätten, das zarte Pinselstriche, die für Forschende wichtig sind, auslöschen könnte.

Dem System beibringen, Schäden zu erkennen

Sobald das Bild bereinigt ist, muss das Modell entscheiden, welche Bereiche einer Wandmalerei intakt und welche beschädigt sind. Dafür verwenden die Autoren ein kompaktes, aber leistungsfähiges neuronales Netzwerk namens SqueezeNet, ergänzt um einen Aufmerksamkeitsmechanismus, damit es sich auf informative Regionen konzentriert. Dieses Netzwerk lernt die bildliche Sprache von Wandmalereien zu lesen — Putztexturen, Pigmentmuster und Formen von Rissen oder blanker Wand. Seine Ausgabe wird an ein weiteres Netzwerk namens U-Net weitergegeben, das für präzise "Ausschneide"-Aufgaben konzipiert ist. U-Net kennzeichnet jedes Pixel als gesunde Farbe, fehlende Stelle oder andere Formen der Verschlechterung. Dank Skip-Verbindungen sowie hinzugefügter Attention- und Residual-Blöcke behält es sowohl die grobe Anordnung (wo eine Figur oder ein Rahmen liegt) als auch winzige Details (wie feine Haarlinien und Ornamente) im Blick und kartiert genau, wo Inpainting erforderlich ist.

Ein KI-Maler füllt die Lücken

Mit markierten Schadensbereichen besteht die letzte Phase darin, sich vorzustellen, wie diese Zonen ursprünglich ausgesehen haben könnten. Hier kombinieren die Autoren zwei Spitzenideen: Generative Adversarial Networks (GANs), die besonders gut realistische Bilder erzeugen, und Transformer-Netzwerke, die langfristige Beziehungen erfassen. Ihr hybrides "transformer-basiertes GAN" betrachtet sowohl die umliegende intakte Farbe als auch das gesamte Wandbild, um plausible Texturen, Formen und Farben für die fehlenden Bereiche zu erschließen. Es kopiert nicht einfach benachbarte Pixel; vielmehr synthetisiert es neue Inhalte, die sich nahtlos in die Szene einfügen und die globale Komposition respektieren, etwa die Symmetrie von Mustern oder die Kontinuität von Gewändern und architektonischen Linien.

Wie gut der digitale Restaurator arbeitet

Um ihr System zu testen, nutzten die Forschenden einen spezialisierten Datensatz von Dunhuang-Wandmalerei-Bildern, der künstlich beschädigte Versionen und die Originalreferenzen enthält. So können sie messen, wie nah die digital restaurierten Ergebnisse an den unbeschädigten Referenzen liegen. Sie berichten, dass ihre Methode, genannt HDLIP-SHAR, mehrere starke bestehende Techniken übertrifft bei verschiedenen Qualitätsmaßen, einschließlich Gesamtklarheit (PSNR), struktureller Ähnlichkeit (SSIM) und einer modernen Wahrnehmungsmetrik (LPIPS), die menschliche visuelle Urteile besser widerspiegelt. Das Modell arbeitet außerdem effizient und benötigt weniger Rechenressourcen und Zeit als viele konkurrierende Ansätze — ein wichtiger Punkt, wenn Museen große Sammlungen verarbeiten wollen.

Was das für das Bewahren von Geschichte bedeutet

Für Nicht-Spezialisten lautet die Kernbotschaft: Dieses KI-System fungiert eher wie ein vorsichtiger, reversibler Assistent als wie ein übermütiger Maler. Es kann Vorschläge machen, wie fehlende Gesichter, Muster oder Szenen in antiken Wandmalereien ergänzt werden könnten, und bietet Forschenden ein mächtiges Visualisierungswerkzeug, ohne die Originale zu gefährden. Zugleich weisen die Autoren auf Grenzen hin: Die Methode ist weiterhin auf einigermaßen klare Referenzmaterialien angewiesen, stößt bei extrem schwerer Beschädigung an Grenzen und integriert noch nicht historisches Fachwissen oder materialwissenschaftliche Analysen in ihre Vermutungen. Trotzdem markieren hybride Ansätze wie HDLIP-SHAR einen wichtigen Schritt hin zu einer Nutzung von KI, die nicht nur hübsche Bilder verbessert, sondern dabei hilft, unersetzliches Kulturerbe transparent, überprüfbar und nicht-invasiv zu schützen.

Zitation: Swathi, B., Rao, D.B.J. Automated image inpainting for historical artifact restoration using hybridisation of transfer learning with deep generative models. Sci Rep 16, 4810 (2026). https://doi.org/10.1038/s41598-026-35056-w

Schlüsselwörter: digitale Wandmalerei-Restaurierung, Bild-Inpainting, Deep Learning, kulturelles Erbe, GAN-Transformer-Modelle